LLM + Robotics에 흥미를 이끈 논문

1. 개요

-

로봇이 손과 눈 역할을 하고

언어 모델이 높은 수준의 지식을 제공하는 아이디어

-

즉, 로봇에게 사람과 같은 추론 능력을 부여하자

Q) "어떻게 LLM을 물리적 Task 해결에 사용할 수 있을까?"

A) LLM에서 High-level 지식을 이끌어내는 연구 -

구현하기 위해서 지시(instruction)에 대한 실행 가능성 평가도 진행

- Affordance functions을 이용한다.

- Affordance functions을 이용한다.

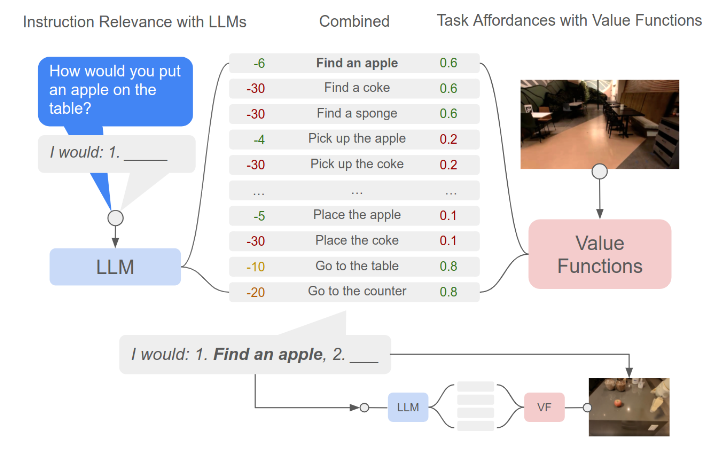

LLM(Say) + affordance functions(Can)

LLM : high-level goal을 위한 유용한 동작들 결정

affordance functions : 계획에 따라 실행할 수 있는 것이 무엇인지 결정하는 기반 제공 (RL 사용)

2. 방법

-

High-level task를 low-level로 분해하는 작업이 필요

- prompt 엔지니어링으로 어느 정도는 할 수 있지만 한계점이 존재

- prompt 엔지니어링으로 어느 정도는 할 수 있지만 한계점이 존재

-

먼저 LLM이 지시문에 맞는 여러가지 답변들을 생성

- 그 다음에 실행 가능성이 있는 답변들을 찾기 위해 value function을 활용하여 scoring

- LLM이 생성한 답변들에 대한 점수와 value function이 측정한 점수를 합산하여 답변 선택

-

이로 인해 답변들에 대한 해석력이 증가한다.

function을 계산할 때 BC-Z, MTOpt 등 강화학습 내용이 등장...

강화학습은 꼭 추후 공부 필요

3. 모델 및 Metric

- 540B PaLM

- decoder만 사용한 Transformer 모델

- 언어 이해 및 생성, 추론, 코드 생성 및 오류 생성 Task에서 뛰어나다.

(Chain-of-Thought도 사용되었음)

- Metric

- Plan success rate : 절차 성공률

- Execution success rate : 실행 성공률

※ 평가하는 항목

- 언어 제거

- Value function 제거

- LM 제거

4. 한계

- long-horizon task에서 약하다

- 부정 표현, 모호한 표현 등에서 잘못된 판단이 보인다.

- 부정 표현, 모호한 표현 등에서 잘못된 판단이 보인다.

- 장기적인 추론, 지시에 대한 추상적 이해, 환경과 로봇의 능력에 대한 지식이 필요

- 추후 연구에서 생각해봐야하는 부분들

5. 결과

- 더 큰 데이터로 학습한 LM을 사용한 것이 당연히 성능은 좋다

- 하지만 그 이유에 대해서는 불분명하기 때문에 확신하지는 못한다.

- 하지만 그 이유에 대해서는 불분명하기 때문에 확신하지는 못한다.

- 현실에서 평가를 진행했고 완벽하지는 않지만 성공률이 나쁘지 않다.

새로운 능력

1. '서랍 열기'처럼 새로운 기술을 시스템에 결합시키기 쉽다..

2. CoT 활용하면 복잡한 Task도 해결 가능성이 있다.

3. 별도 설정없이 다국어 가능하다.

장기적인 Task에 대한 추론 능력이 중요해보인다.

이전 리뷰한 논문에서도 발견된 문제인 주변 환경 정보를 파악하는 능력이 있으면 해결 가능성이 조금 있을지도..