Pytorch

1.Thumbnail

2.baseline

3.AutoGrad & Loss Function

Train을 시킬려면 기준이 필요하다. 그때 loss function을 사용하는데 이는 작을 수록 좋다. 즉 loss value가 작아지는 방향으로 parameter를 이동시킨다.그래서 진짜 간단하게 다음과 같은 식을 쓸수있다.$loss\\space\\space val

4.Image_preprocessing

긴 aixs를 기준으로 나머지는 0(Black)으로 채우되 중심은 유지

5.check, initialize and freeze parameters

https://stackoverflow.com/questions/63785319/pytorch-torch-no-grad-versus-requires-grad-falsewith torch.no_grad()와 requires_grad = False의 차이(?)기본

6.save and load best parameters(model) then continue

3 transfer learning

7.transfer learning (1)

https://discuss.pytorch.org/t/module-children-vs-module-modules/4551/11https://pytorch.org/vision/stable/models.htmlpre-trained parameter를 가

8.transfer learning (2)

이제 바꿔보자.test_model의 마지막을 바꿔보자.이렇게 하면 될줄 알았는데 안된다.그래서 찾아보다가 model을 보는 데 굳이 앞에서 처럼 for문을 사용할 필요가 없다는 것을 알았다.다음을 보자.즉, 그냥 list보 바로 반환 해준다.이어서 ...........

9.transfer learning (3)

이제 앞의 내용을 바탕으로 transfer learning을 해보자.baseline은 vgg16을 하고

10.transfer learning (4)

transfer learning의 마지막 전체 code이다.

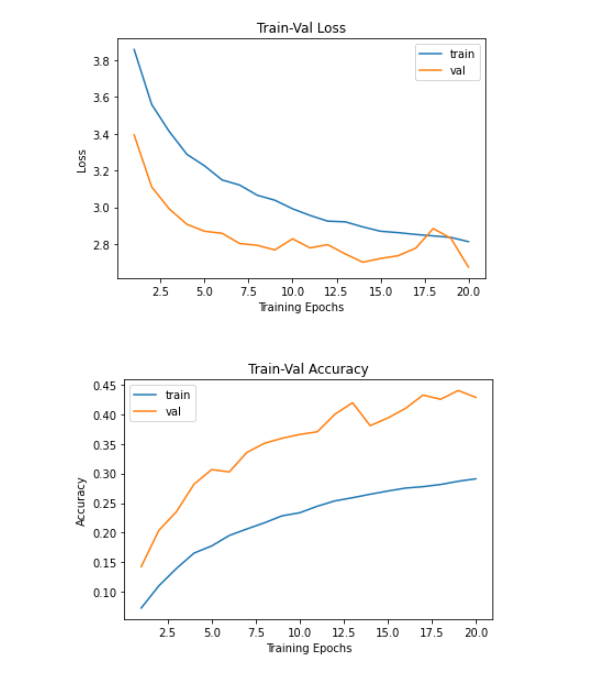

11.own trainer

기존의 trainer에 문제가 있어 원인을 찾고 수정한다.dataset은 STL-10 = classification with 10 classess기존 code물론 학습이 되는데는 전혀 지장이 없으나 살짝 애매한 부분이 있다.문제점은 batch학습에서 일어 났다.일단 m