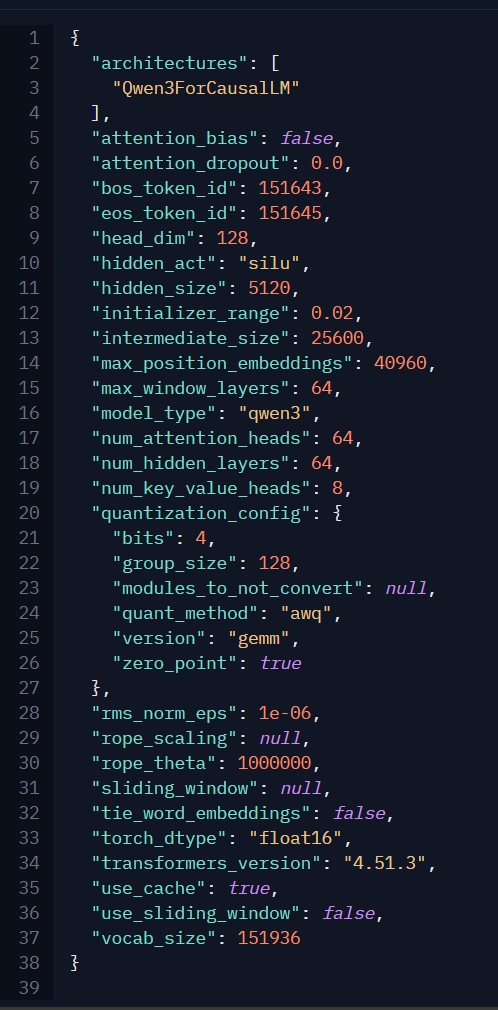

config.json

모델의 구조와 특징을 파악할 수 있는 제일 핵심적인 파일이다.

model architecture 관련

architectures

transformers 모듈에서 사용되는 모델 class명이며, AutoModelForCausalLM.from_pretrained() 함수를 통해 해당 class의 인스턴스로 모델이 반환됩니다.

head_dim

attention head의 차원 수

hidden_act

활성화 함수. 대부분 silu를 사용한다.

hidden_size

은닉층의 차원수

intermediate_size

Feed-Forward Network의 차원 수

num_attention_heads

attention head의 수

num_hidden_layers

Transformer block의 수

num_key_value_heads

key, value head의 수

Positional Embedding 관련

max_position_embeddings

최대 컨텍스트 길이. 모델이 한번에 볼 수 있는 최대 길이를 의미한다.

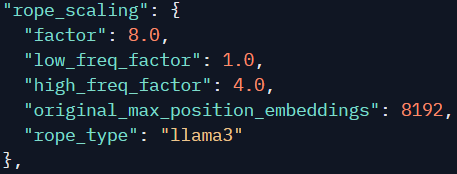

rope_scaling

Rotary Positional Embedding 스케일링 적용 여부.

(RoPE : 기존 절대위치 정보 대신 상대위치를 반영하는 방법으로 긴 시퀀스에서 안정적으로 작동하게 함.)

sliding_window

sliding window 적용 여부. 최대 컨텍스트를 초과하는 입력이 들어왔을때 일정한 window 사이즈로 조금씩 겹치면서 처리하는 방식

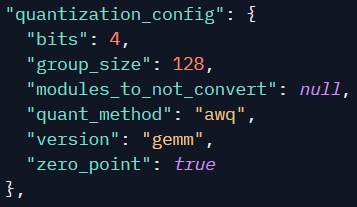

Quantization 관련

양자화 방식에 따라 설정 파라미터들이 다르다.

bits

양자화 변환한 bit

quant_method

양자화 방식. awq, gptq, fp8, int8 등.

group_size

양자화시 그룹화한 크기.