NVIDIA DGX Spark - 데스크톱에 데이터센터 기능을 제공하는 AI Appliance [link]

NVIDIA DGX Spark - 데스크톱에 데이터센터 기능을 제공하는 AI Appliance [link] 약간 맥미니 같이 생겼다

약 한 달 전쯤, NVIDIA에서 DGX Spark을 공개하면서 <AI 컴퓨팅의 개인화>라는 새로운 패러다임을 제시했다. 기본적으로 트랜스포머형 모델 하나를 학습하려면 수십 kWh의 전력과 대형 서버 Rack이 필요하지만, 이 DGX Spark는 1.13리터, 240W짜리 귀여운 박스 하나로 데이터센터 수준의 성능을 낼 수 있다고 홍보되고 있다.

우리 회장님들도 좋아하는 DGX Spark... [link]

우리 회장님들도 좋아하는 DGX Spark... [link] 출시가를 보면 대량 한화 600만원 쁠마 알파 정도이다.

DGX Spark는 Grace Blackwell GB10 Superchip (= Blackwell 아키텍처 GPU와 20코어 Arm CPU)을 NVLink-C2C로 묶어 PCIe 5.0보다 최대 5배 빠른 내부 대역폭을 확보했다고 한다. CPU & GPU가 물리적으로 분리된 구조가 아니라 하나의 통합 연산 Fabric처럼 만든게 전통적 PC와의 아키텍쳐적 차이라는 듯.

- 성능: FP4 기준 최대 1 PFLOPS (희소성 포함)

- 메모리: 128GB LPDDR5X 통합 메모리, 273GB/s 대역폭

- Llama 3.1 8B FP4: 동시성 128에서 ~924 tok/s

- Qwen3 Coder 30B-A3B FP8: 배치 64에서 ~483 tok/s

- NVIDIA NeMo 프레임워크와 결합하면 8B 모델의 Full Fine-Tuning 가능

- 네트워크: ConnectX-7 SmartNIC (200Gb/s)

- 스토리지: M.2 2242 폼팩터 PCIe Gen5 NVMe (최대 4TB)

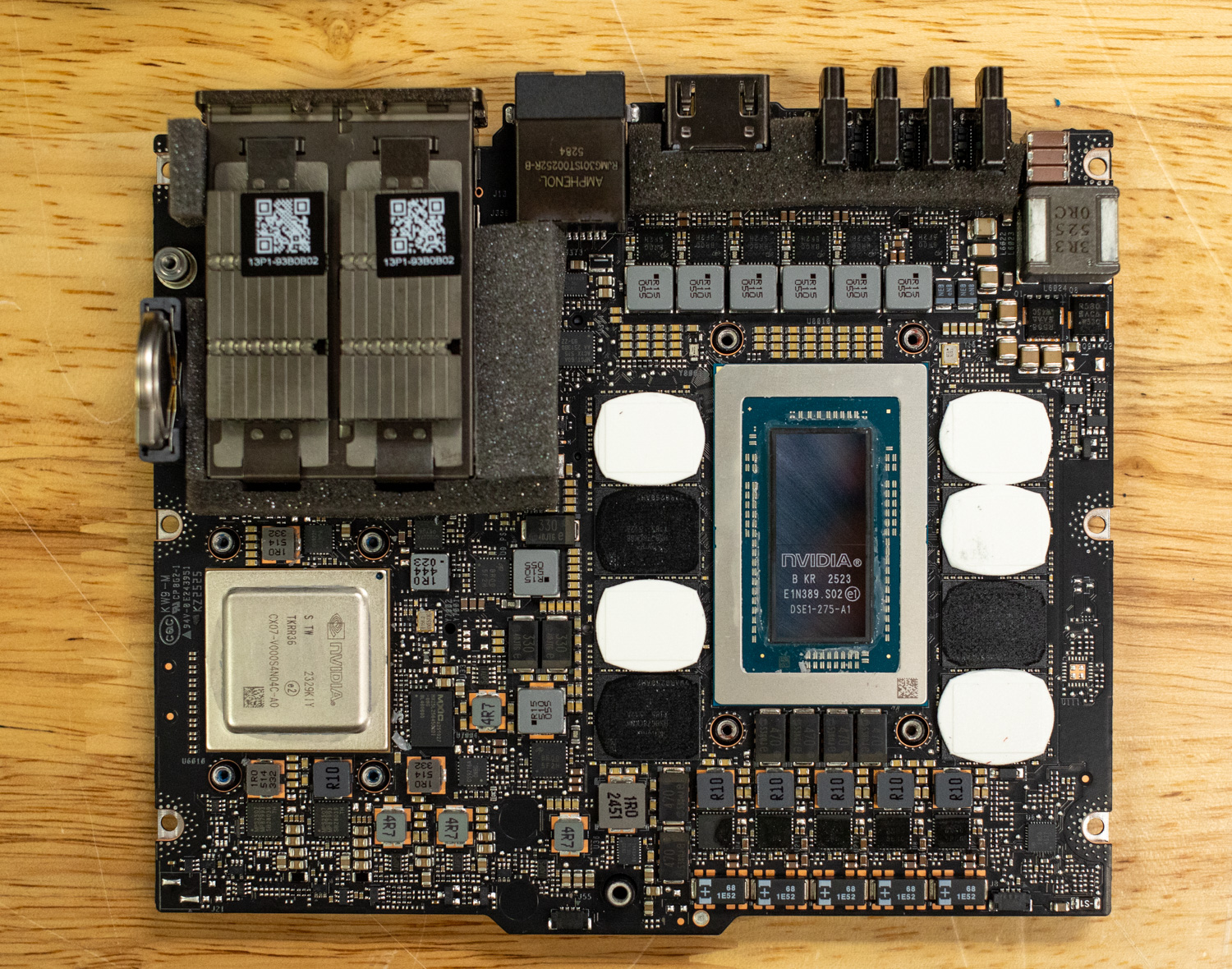

박스와 방열판을 제거해보면 이렇게 생겼다... [link] CPU는 Cortex-A725 효율 코어 10개와 Cortex-X925 성능 코어 10개로 구성되어 있다고 함. ConnectX-7 슬롯까지 야무지게 조립되어 있다.

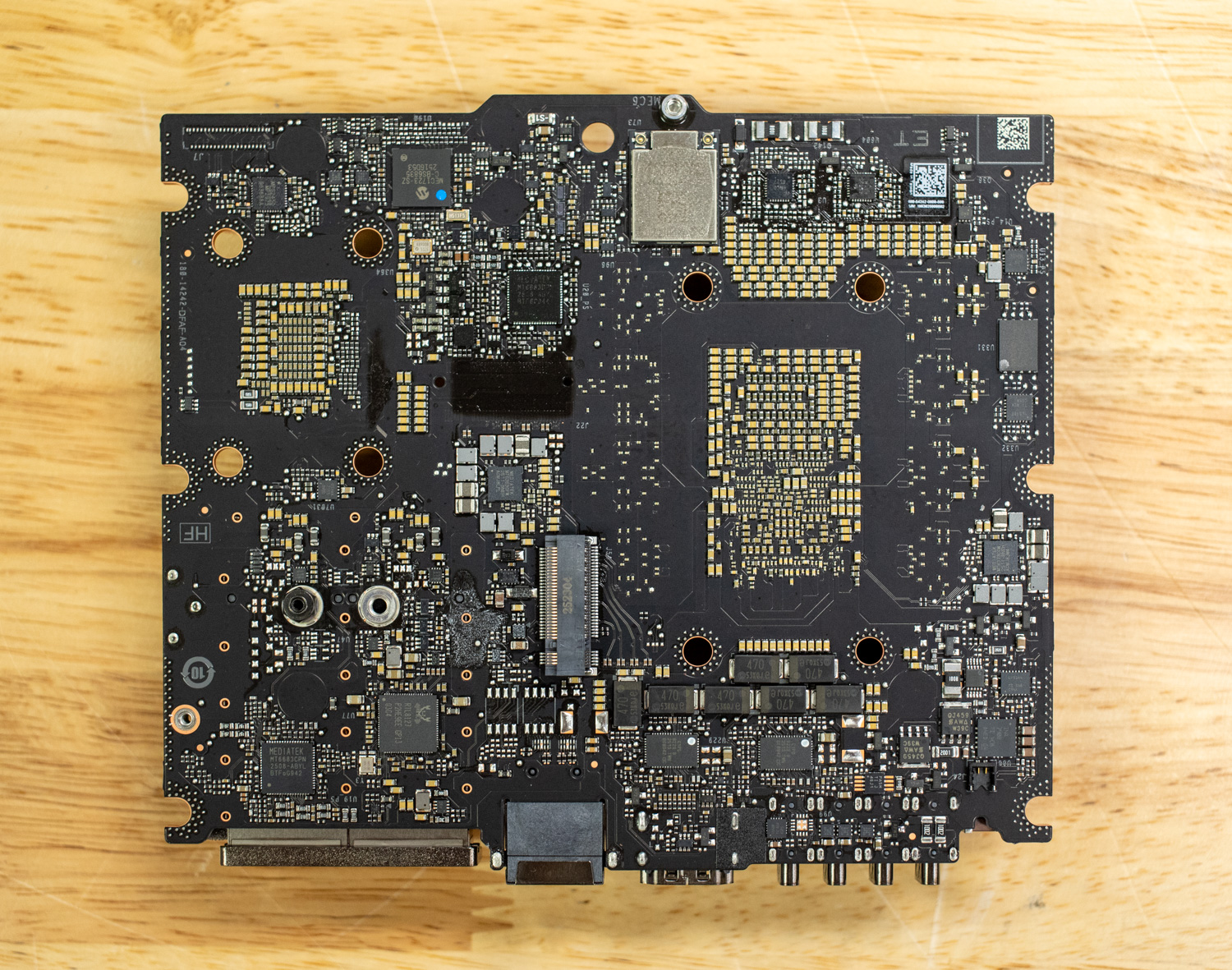

박스와 방열판을 제거해보면 이렇게 생겼다... [link] CPU는 Cortex-A725 효율 코어 10개와 Cortex-X925 성능 코어 10개로 구성되어 있다고 함. ConnectX-7 슬롯까지 야무지게 조립되어 있다.  M.2 슬롯은 뒷면에 있음. [link] PCIe Gen3x1 MediaTek Wi-Fi 어댑터도 확인 가능.

M.2 슬롯은 뒷면에 있음. [link] PCIe Gen3x1 MediaTek Wi-Fi 어댑터도 확인 가능.  옆면을 보면 C타입도 충분히 있다... [link]

옆면을 보면 C타입도 충분히 있다... [link] 대충 이런식으로 사용하는 형상이라고 생각하면 됨 [link]

대충 이런식으로 사용하는 형상이라고 생각하면 됨 [link]진짜 맥미니랑 비슷한 느낌

Workflow 관점에서 NVIDIA에서 강조하는 것은, Spark의 핵심 기능은 바로 AI 개발 전주기를 하나의 환경에서 다룰 수 있도록 설계됐다는 것이다. 주로 하기 사항들을 Feature로서 홍보하고 있다.

- DGX OS (Ubuntu 기반): CUDA, cuDNN, TensorRT, AI Workbench 내장

- 컨테이너 기반: JupyterLab, VS Code, Ollama, ComfyUI, NeMo 등

- ComfyUI를 통해 Stable Diffusion 기반 생성 모델을 노드 그래프 형태로 자유롭게 만들 수 있다. Blackwell GPU의 Tensor 코어가 샘플링을 가속하며 일반적으로 15~30초 내에 이미지 생성이 완료된다고 한다.

- NVIDIA Sync를 통한 원격 접근, 자동 SSH 터널 관리

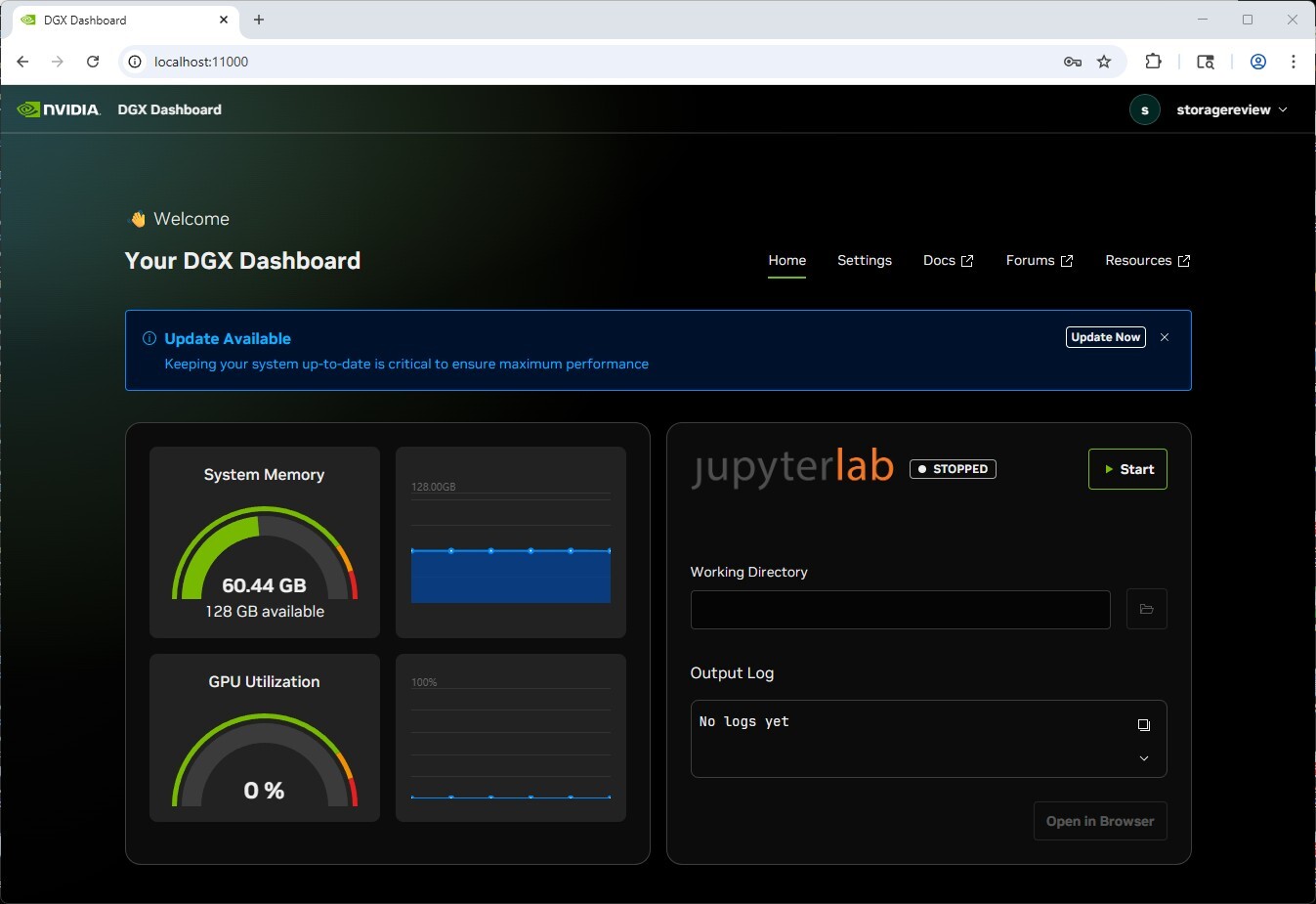

DGX 대쉬보드 메인화면 [link]

DGX 대쉬보드 메인화면 [link] DGX Spark의 내부 스토리지로 2242 Gen5 NVMe SSD가 있긴 하지만, 무거운 워크로드에서는 NVMe-oF RDMA 스토리지 확장을 추천한다고 한다. ConnectX-7 200Gb NIC를 기반으로 외부 NVMe Pool과 NVMe-oF 연결을 갖춰놓으면 그 환경에서도 GPU Direct Storage (GDS)를 사용할 수 있는데, 이를 통해 11~12GiB/s의 실측 처리량을 확보할 수 있는데, 내부 NVMe SSD의 처리량도 11.4 GiB/s도 수준이라 성능 하락 없이 지속적으로 워크로드를 돌릴 수 있는게 큰 장점이라고 한다.

마무리

난 처음에 굳이 이런 플랫폼을 사용하는 사람이 있을까? 잘 팔릴까? 의문이 들었다. 5000달러 수준의 거금을 들여서 이걸 집에 둘 사람이 얼마나 있을까, 싶었던 것이다. 그런데, 좀만 더 생각해보고 눈을 돌려보면, 의외로 꽤 큰 시장일수도 있겠다는 생각도 들었다. 다음과 같은 기관/조직/인원들이 요즘 시대에 정말 많지 않은가.

- 로컬 LLM, Diffusion 모델을 구동하는 AI 연구/개발자

- 사내 데이터를 다루며 코드 보안, 프라이버시를 관리하는 소규모 조직

- 빠른 실험과 재현성을 요구하는 데이터 과학·로보틱스 연구팀

- AI 개발 (흔히 바이브 코딩이라 일컫는), AI Agent 시스템을 실험하는 스타트업 또는 소규모 연구소

이런 계층에게 상당히 매력적인 옵션이 될 수 있겠다 싶었다. 앞으로 시장에서 어떤 임팩트를 남기게 될지 궁금하다.

한편, 요즘 NVIDIA는 정말 모든걸 다하고 있는거 같다. GPU, CPU, 메인보드, Rack단위 플랫폼, PC급 플랫폼, NIC, DPU, Interconnect, ..., 정말 다 하고 있고, 무엇보다 이들이 사실상 현대 데이터센터 구축의 표준처럼 자리매김하고 있다는 점이 정말 대단하다. 얼마전 NVIDIA에서 Press로 내보낸 자료를 보면, TOP100 HPC 시스템의 85%가 GPU를 탑재해 사용 중이고 (2019년에는 70%가 CPU-only), Top500 슈퍼컴퓨터의 78%를 차지해 총 388개 시스템에서 사용 중이라고 한다. 이중에서 362개 시스템은 NVIDIA 네트워크 제품들도 운용 중이라고 한다. 최근 발표된 미국의 TACC Horizon 슈퍼컴퓨터의 경우 4천개 이상의 NVIDIA Blackwell GPU + Quantum-X800 InfiniBand 스위치를 기반으로 총 80 ExaFLOPS의 AI 인프라를 갖춰 다양한 Scientific 연구들에 사용할 예정이라고 한다 (서버는 Dell PowerEdge이고, IRSS(Integrated Rack Scalable Systems) 형태로 구축한 듯함). 최근 일본 RIKEN도 NVIDIA GB200 Superchip과 NVIDIA Quantum-X800 InfiniBand를 기반으로 차세대 슈퍼컴퓨터를 구축할 것이라고 발표했다.

이러한 일련의 결과물들은 결국 NVIDIA의 공격적인 인재 확보 + 공격적인 인수 합병 등의 산물이라 볼 수 있을 것이다. 역사를 돌이켜보면 사업 아이템을 너무 확 늘리다 중구난방해지는 기업들이 많았던 반면, NVIDIA는 아직까진 전혀 그런 모습 없이 오히려 더 폼이 좋아지고 있다. 비단 공격적 인재 확보나 인수 합병 뿐만 아니라, 사내에서 말단 엔지니어부터 리더급까지 다같이 좋은 비전과 공동 목표를 공유하고 추진력있게 나아가고 있는게 아닐까 싶다.

본 글에 담긴 Claim격의 서술은 모두 제 개인의 의견일 뿐이며 아무런 대표성을 가지지 않습니다.