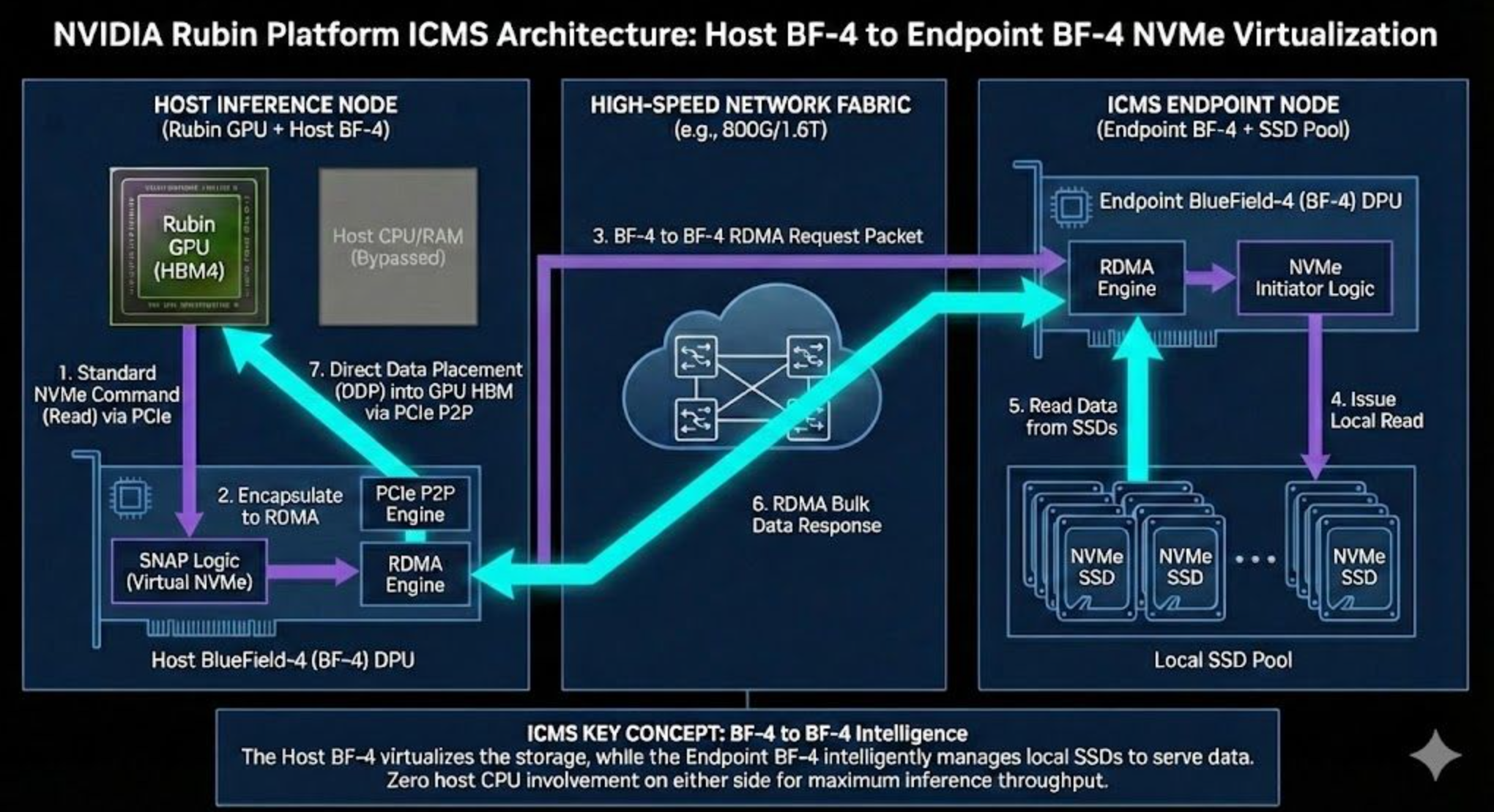

올초 CES에서 발표된 NVIDIA의 ICMS (Inference Context Memory Storage) 아키텍쳐는 내 입장에서 굉장히 반가웠다. 3년 전 DPU가 점점 주목받기 시작했던 시기에 이 DPU가 도대체 어떻게 어디서 쓰일 수 있을지 Reference Architecture를 다양하게 그려봤었는데, 그 당시 상상했던 후보 중에 가장 괜찮다고 생각했던 형상이 ICMS에 그대로 담겨 있었기 때문이다.

일단 아래 그림을 봐보자.

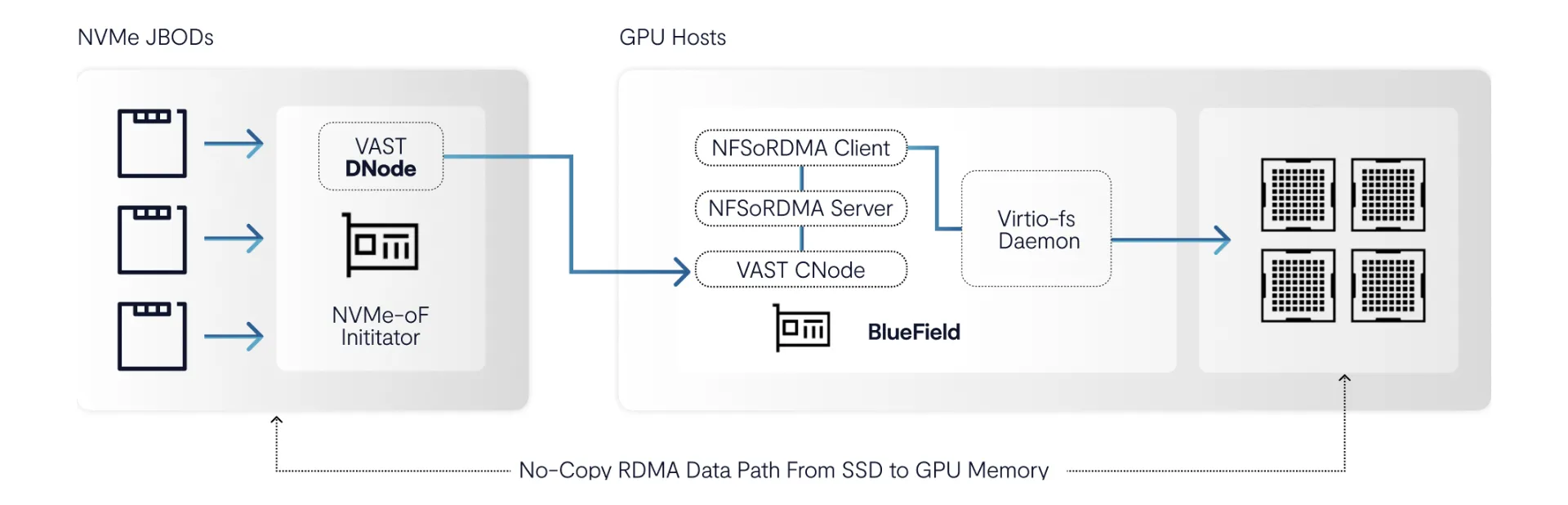

(그림1. Vast Data에서 공개한 그림)

(그림2. 출처 네이버 블로그 꿈꾸는 공돌이)

사실 DPU 좀 봤던 사람들한텐 크게 색다를건 없다.

추론 시스템이 있고, 거기에 최소 아래 세 개 요소가 있다고 보자 (Remote Storage를 구축한 상황).

- GIDS (GPU-Initiated Direct Storage)가 서포트되는 GPU

- GPU 서버에 꽂힌 BlueField-4 DPU

- 스토리지 서버에 꽂힌 BlueField-4 DPU

이 세 개가 있다고 할때,

- (1) GIDS를 통해 GPU 서버의 CPU Involvement 없이 GPU CUDA Kernel에서 Direct로 NVMe Command를 생성 및 Issue

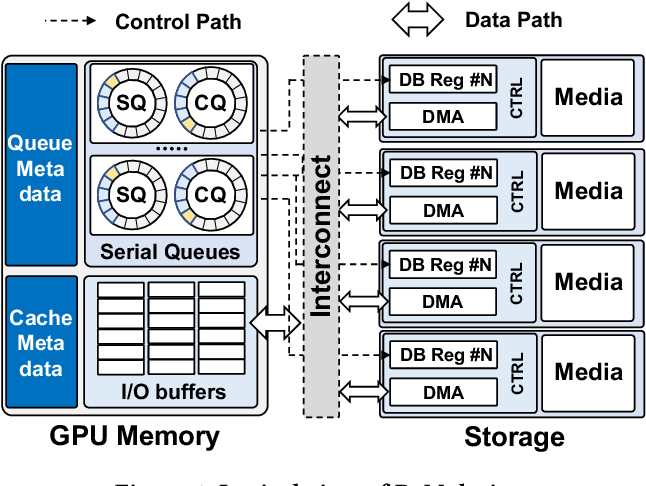

- GIDS는 아래 그림처럼 GPU Memory상에 PCIe BAR 영역과 NVMe I/O Queue들이 맵핑되어 돌아가는 구조임. Doorbell Register나 Tail Pointer Update 같은걸 다 GPU에서 직접 때리는 형태.

- 기존 CPU-SSD 간의 NVMe over PCIe와 사실상 동일하게 동작함. GPU-SSD 사이에서 작업이 벌어지고 있는게 다를뿐. 다만, GPU 특성상 Thread가 전통적 서버 대비 훨씬 많다보니까 SQ/CQ 접근 간 락킹 병목이 발생할 수 있어서 Aggregation, Batching하는 기법이 적용되어 있다고 함.

- GIDS는 아래 그림처럼 GPU Memory상에 PCIe BAR 영역과 NVMe I/O Queue들이 맵핑되어 돌아가는 구조임. Doorbell Register나 Tail Pointer Update 같은걸 다 GPU에서 직접 때리는 형태.

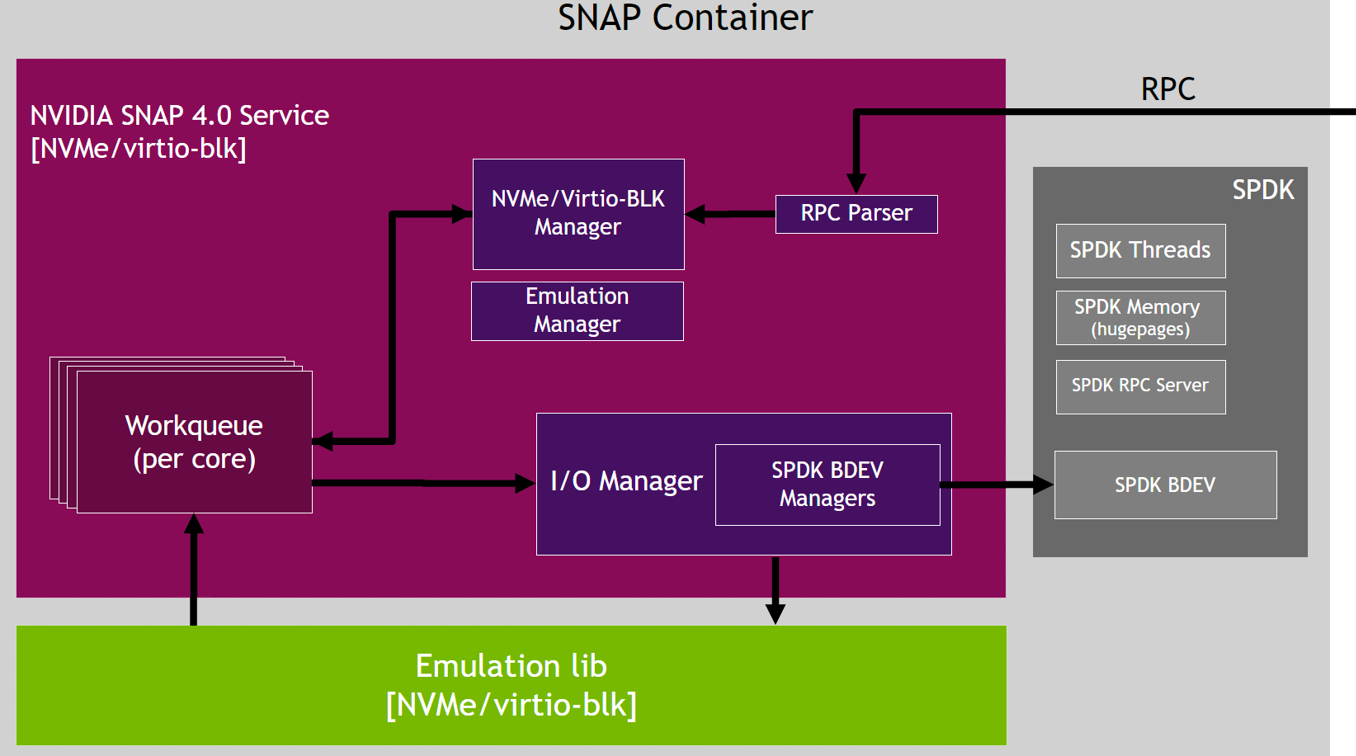

- (2) GPU 서버에 꽂힌 DPU에서 SNAP (Software-defined Network Accelerated Processing)을 통해 서버가 DPU에 연결된 NVMe Array를 Local NVMe처럼 보이게 가상화해주고, 그 내부에선 GPU에서 Init된 NVMe over PCIe DMA Req를 적절한 NVMe-oF RDMA Req로 변환해주는 것임.

- DOCA Docs에 나와있는것처럼 SPDK NVMe-oF Target BDEV를 그대로 사용함.

- (3) 스토리지에 꽂힌 DPU에서 RDMA Req를 받아서 SSD들에 I/O & Orchestrate

이 과정에서 CPU 기반의 Copy가 아예 Zero가 되는게 핵심적인 Architectural Benefit이다.

기존 GIDS랑 뭐가 다르냐고? 또는 핵심이 뭐냐고?

내 생각엔 다음처럼 정리되지 않나 싶다.

(1) 기존 GIDS의 Context가 Local NVMe SSD였다면 ICMS는 GIDS가 똑같이 돌아가되 Local SSD로 가상화된 NVMe Storage Cluster가 들어온다는 것이다.

(2) 그러한 Remote Storage 환경을 BlueField-4 DPU가잘만들어줄 수 있다.

그간 DPU의 셀링 포인트가 뭐였나? 경제성이었다. 이걸 쓰면 CPU의 뭐가 줄어서 어떻다, 스토리지 서버 두뇌를 대체하면 기존보다 더 경제적이다, 등등, 이런 논리였다.

기본적으로 틀린 말이 아니지만, 보고 듣는 사람으로 하여금 그렇게 인상적인, 맛있는 Claim은 아니었음을 부정할 수 없다. 특히나, 실제품이나 Prototype이 미비하던 초기에는 그냥 상상 정도로 취급받았다.

근데 작년부턴 분위기가 조금 달라진거 같다. DPU 기반 스토리지 서버가 슬슬 등장하고 있다. 여기서 스토리지 서버라 함은, 단순히 Dell PowerStore에 DPU를 꽂은 형상 뿐만 아니라, 그냥 DPU 기반 NVMe Enclosure (JBOF 예시)까지 포함하는 것이다.

그리고, 이러한 DPU 기반 스토리지를 토대로 Vast Data나 Weka 등에서 자기들 SW를 올려서 Reference Architecture를 선보이기 시작했다. 얘네가 당시에 단순히 경제성 뿐만 아니라 추론 성능 개선까지 언급하기 시작했는데, 처음엔 좀 의아했던 기억이 난다. 어떻게? DPU 스펙이 아무리 훌륭하다 해도 기본적으로 DPU는 Remote Storage Cluster 셋업이 들어가야하는데 거기서 KV Cache 같은걸 어떻게 그렇게 잘 서빙할까 궁금했다.이번 NVIDIA ICMS는 이러한 궁금증에 어느 정도 해답을 준것이다. 그냥 GIDS였다. 다만, 그게 GPU Memory부터 Remote NVMe SSD의 On-board Memory까지 Round-Trip하는 동안 CPU 개입이 Compute단부터 Storage단까지 모두 배제되도록 만들었다는 것이다. 그리고 위의 그림들에서도 바로 알 수 있듯, 저러한 시스템은 정말 Viable하다. 구현 가능하다. Infiniband의 초고속을 떠올려보면 Zero-Copy를 통한 성능 개선이 정말로 믿긴다.

뭐, 지켜봐야겠지만, 엔비디아의 파워를 생각해보면, 이러한 ICMS 같은 Architecture가 AI 추론 시스템 구축의 de facto가 될 수도 있을거 같다.

그래서?

ICMS를 토대로 올해~내년 스토리지 트렌드를 다음과 같이 두 가지를 예상해본다.

NAND 전성 시대 개막

요즘 많은 언론에서 말하듯, 그리고 저번 포스팅에서도 얘기했듯, (데이터센터 내) NVMe의 시대는 이미 왔다. 특히나 ICMS 같은 아키텍쳐가 일반화된다면 더욱이 NVMe SSD 수요를 급증시킬 수 있으리라 본다. 국내의 하이닉스, 삼성뿐만 아니라, NAND Vendor들에겐 이만한 호재가 없을 것이다. 이미 알려진 것처럼, 내년도 물량까지 수주가 끝난 기업들이 많다. 공급을 얼마나 잘하느냐가 기업들 간의 사소한 성패를 가를 것으로 보이나, 산업 전반적으로 봤을 때 손해를 보는 기업은 거의 없으리라.

다만, NVMe SSD 수준으로 시각을 조금 좁혀보면, 좀 더 두각을 나타낼 기업이 몇군데 보이긴 한다. 하이닉스가 모기업으로 있는 Solidigm이 대표적이다. Enterprise SSD의 선두주자로서, 최근 공격적인 Large Capacity SSD 출시와 판매를 통해 수익성 개선을 이룬게 익히 알려져 있다. 엔비디아의 측근이라고도 부를 수 있는 Vast Data와 지속적으로 협업 중이기도 하다 (따로 확인은 안해봤지만, 아마 저 Reference 시스템에 솔리다임 제품이 들어갔을 것임). 앞으로 하이닉스와 솔리다임의 시너지가 더더욱 기대되는 부분이다.

NVIDIA발 스토리지 솔루션 등장 가능성

나는 엔비디아가 결국 HW적이든 SW적이든 어떤 형태든간에 스토리지 솔루션을 조만간 내놓을 것이라고 본다. 근거로, 이번 ICMS 소개 (공식) 블로그 글을 보면, NVMe Key-Value Extension에 대한 언급이 뜬금없이 등장한다. 엔비디아에서 NVMe Command Set 수준까지 언급하는건 굉장히 이례적인 것으로, 그 내용은 아래와 같다.

"These crypto and integrity accelerators are designed to be used as part of the KV pipeline, securing and validating KV flows without adding host CPU overhead. By leveraging standard NVMe and NVMe-oF transports, including NVMe KV extensions, ICMS maintains interoperability with standard storage infrastructure while delivering the specialized performance required for KV cache. "

이걸 복선이라고 바라보면, 조만간 DOCA에 KVS가 공식적으로 Deploy될 수 있다. GPU 서버에서 I/O Issue할 때 File & Block Interface 대신 KV Interface로 더욱 더 SW Stack을 간소화해서 I/O를 보내고, DPU에서 KV Index 관리를 해 완벽한 Disaggregation을 이루는 것이다. 그 이상, KV-SSD 컨셉까지 바라보면 스토리지 업계에서 더더욱 좋은 소식이겠지만, 거기까진 성급한 예상인거 같고, 딱 DPU 기반 KVS를 통해 컴퓨트단 SW Stack 간소화, 이정도를 타겟하고 있을 것 같다. 근래에 엔비디아가 Vast Data와 같은 기업과 협업을 통해 무언가 오버헤드가 분석된게 있지 싶다.

암튼, NVIDIA에서 스토리지 솔루션을 내놓을 것 같고, 만약 그렇게 된다면 정말로 NVIDIA는 이제 Processing Unit뿐만 아니라 서버, Rack-Scale Pod, Network, Mini Workstation, Storage까지 데이터센터의 모든 부분을 총괄하는 기업이 될 수도 있을 것이다.

지켜보자!

본 글에 담긴 Claim격의 서술은 모두 제 개인의 의견일 뿐이며 아무런 대표성을 가지지 않습니다.