LangChain이 뭐야?

LLM 기반 앱을 빠르고 유연하게 개발할 수 있도록 도와주는 프레임워크

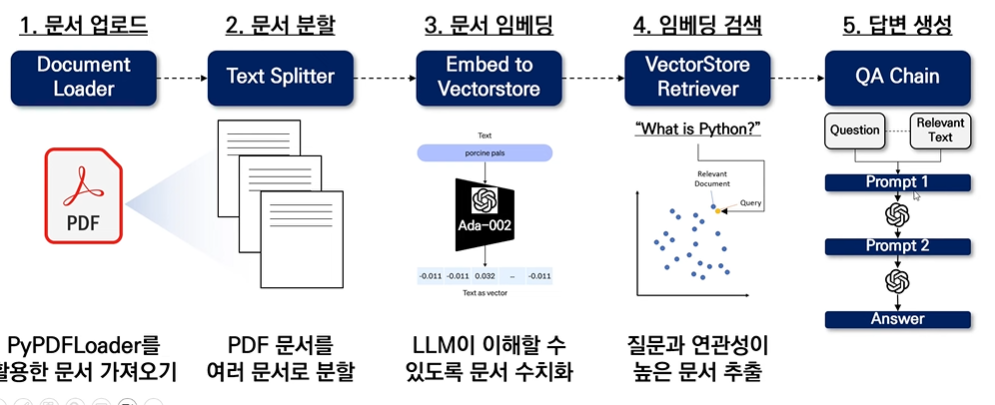

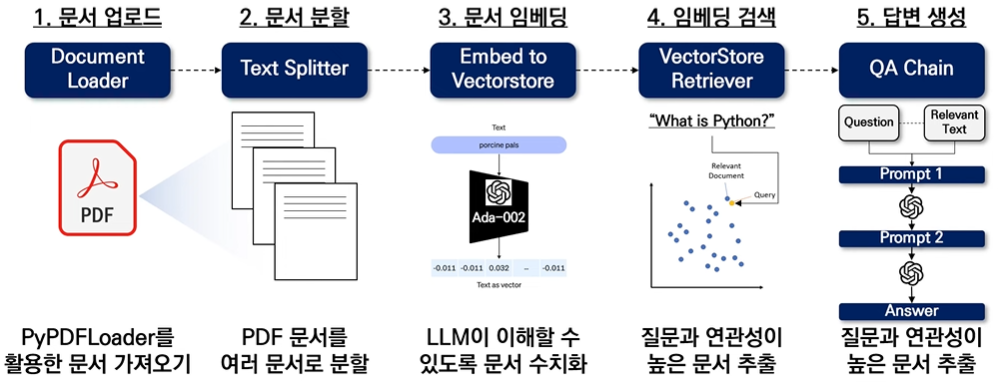

구성요소

LLM(엔진) + Prompts(입력) + Index(문서 탐색 모듈) + Memory(채팅 이력) + Chain(연속적인 LLM 호출) + Agent(LLM 자체적으로 구동하는 모듈)

ChatGPT 개량

1) Fine-Tuning

기존 모델의 weight를 조정하여 원하는 용도로 업데이트

2) N-shot Learning

n개의 출력 예시 제시 > 원하는 용도의 출력 조정

3) In-context Learning

문맥 제시 > 문맥 기반의 모델 출력 조정

그럼 N-shot Learning과 In-context Learning의 차이는?

GPT 왈, In-context Learning ⊃ N-shot Learning

N-shot Learning의 경우, 예시 기반 답변

Q: 서울의 수도는 어디인가요?

A: 서울은 대한민국의 수도입니다.

Q: 도쿄는 어느 나라의 수도인가요?

A: 도쿄는 일본의 수도입니다.

Q: 파리는 어느 나라의 수도인가요?

A: (모델이 위의 예시를 기반으로 답변 생성)

를 입력하세요In-context Learning의 경우, 프롬프트 내 목적 배치

Prompt: "다음 문장을 영어로 번역하세요.

안녕하세요, 만나서 반갑습니다."

모델 답변: "Hello, nice to meet you."

(모델은 입력 문맥의 내용을 기반으로 즉석에서 대응함)https://www.youtube.com/watch?v=WWRCLzXxUgs&list=PLQIgLu3Wf-q_Ne8vv-ZXuJ4mztHJaQb_v