[논문 리뷰] Complementary pseudo multimodal feature for point cloud anomaly detection

2025 동계 Paper Review

본 Paper Review는 고려대학교 스마트생산시스템 연구실 2025년 동계 논문 세미나 활동입니다. 논문의 전문은 여기에서 확인 가능합니다.

Abstract

- 포인트 클라우드 이상 탐지는 계속 성장하는 연구 분야임.

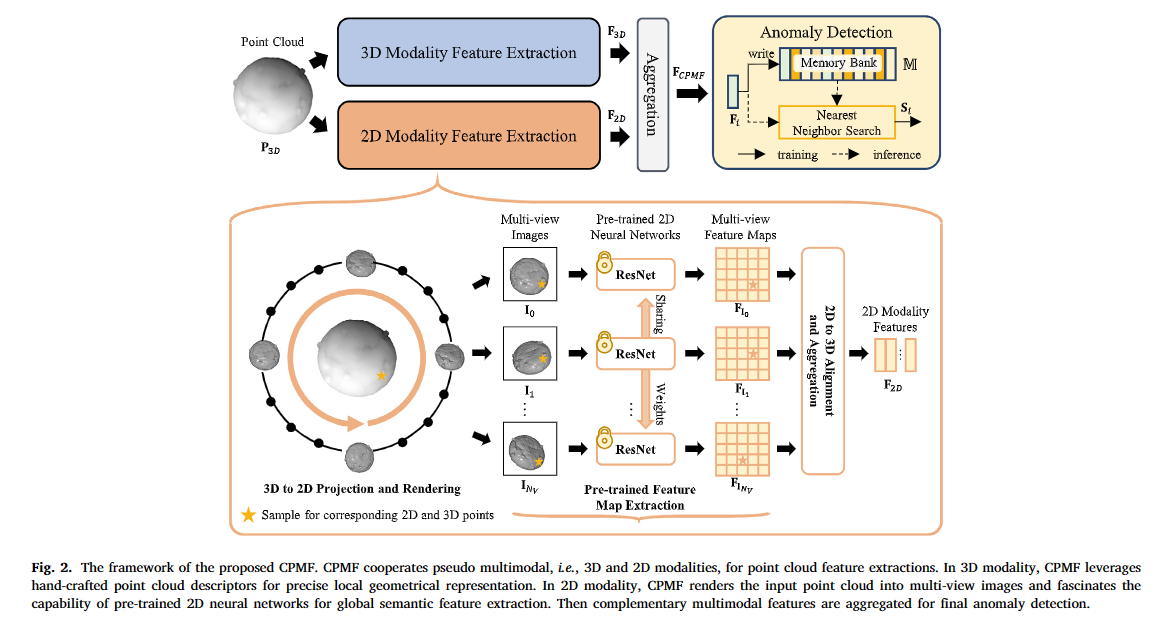

- 해당 과업에서 특징 표현력이 중요하기 때문에, 본 연구는 Complementary Pseudo Multimodal Feature (CPMF)를 도입하여 3D 수작업 기술자에 의해 추출된 지역 기하학적 정보와 2D 사전 훈련된 신경망에서 추출된 전역 의미 정보를 결합함.

- 특히, 2D 사전학습된 신경망을 활용하여 point-wise 특징 추출을 위해, 본 연구는 원본 포인트 클라우드를 다양한 관점의 이미지로 사영함.

- 이러한 이미지들은 사전학습된 2D 신경망에 입력되어 정보성이 높은 2D 모달리티 특징 추출을 수행함.

- 2D-3D 대응에 따라, 다중 시점 2D 모달리티 특성이 다시 3D 공간으로 투영되고 집합되어 point-wise 2D 모달리티 특성이 생성됨.

- 최종적으로, point-wise 3D 와 2D 모달리티 특징이 융합되어 포인트 클라우드 이상탐지를 위한 CPMF가 도출됨.

- MVTec 3D와 Real3D 데이터셋 광범위한 실험이 수행되어 성능이 검증됨.

1. Introduction

최근 3D 센서와 장치들이 많아지면서, 실제 객체의 기하적 형태를 나타내는 포인트 클라우드 (PCD)가 인기를 얻고 있다. 한편 PCD 이상 탐지, 3D 구조의 정상 패턴에서 벗어난 이상 포인트를 찾아내는 과업,는 산업 검사와 의료 진단 분야에서 유망한 접근법으로 여겨지고 있다. 하지만 그 인기에 비해 실제현장에 적용하기에는 성능이 많이 아쉬운 상황이다. 본 연구는 PCD 이상 탐지에 집중해서 실용적인 성능 요구사항을 만족하기 위해 지역 기하학적 특성과 전역 의미적 단서를 통합하여 PCD 이상 탐지를 수행한다.

이전에 이미지 혹은 그래프에서의 이상 탐지 방법들은 분별력 있는 특징 표현이 핵심이라는 것을 보여줬다. 유사하게 최근 PCD 이상 탐지에서도 표현 학습이 중요하게 여겨진다. 초기 PCD 표현들은 수작업 혹은 휴리스틱한 디자인에 의존했다. 딥러닝 모델들의 발전으로 최근 방법들은 학습 기반 방식을 채택한다.

풍부한 PCD 표현들을 기반으로, 3D-ST는 자기지도학습 방식으로 PCD 이상 탐지를 수행한 적 있다. 해당 모델은 baseline 모델들보다는 뛰어났지만 여전히 성능이 부족했다. BTF는 특징 설명력이 PCD 이상 탐지에서 특히 중요하다는 것을 밝혀냈다. 기대와 달리, 전통적인 수작업 방식의 PCD 특징 설명자가 학습 기반 사전 학습된 특징보다 뛰어났다. BTF는 해당 현상이 목표 객체와 사전 훈련된 데이터셋 간의 도메인 분포 차이 때문임을 밝혀내고, 이 때문에 사전 학습된 PCD 특징의 전이 능력이 저하됨을 증명했다. 하지만 수작업된 특징들이 아무리 성능이 좋더라도, 지역 구조 정보를 반영하는데 한계가 있고 전역 의미 맥락을 포착하지 못한다. 전역 의미 맥락은 의미적인 이상성을 탐지하는데 필수적이기 때문에, 이를 수작업된 특징의 기하학적 모델링 능력에 통합하는 것은 잠재적으로 큰 성능 향상이 있을 것이다.

PCD 이상 탐지에 비교했을 때, 이미지 이상 탐지가 더욱 복잡하고 더욱 광범위하게 연구되었다. 초기 이상 탐지 방법론은 정상 데이터로부터 분별력 있는 특징을 학습하는 것에 집중했으나 그렇게 만족스러운 성능을 거두지는 못했다. 많은 연구를 통해, 최근 방법들은 사전 학습된 2D 신경망으로부터 얻은 표현들이 이상 탐지에 적합함을 밝혀냈고 사전 훈련된 표현에 숨겨진 기하적, 의미론적 정보를 그 이유로 제시했다. 구체적으로, ImageNet과 같은 대규모 이미지 데이터셋의 알려진 사전 정보를 이용해서 의미있는 전역 의미 단서를 포착하여 효과적인 전이 능력을 획득했다.

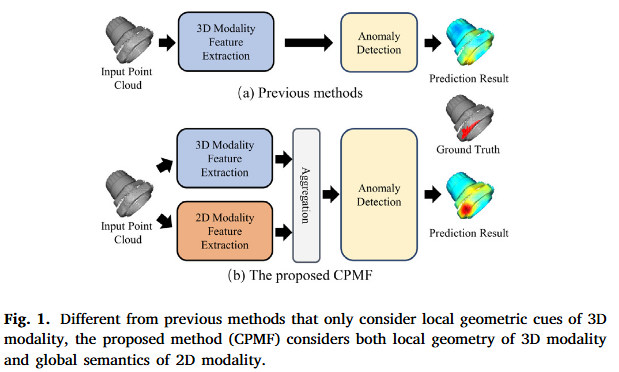

기존의 PCD와 이미지 이상 탐지에 힘입어, 본 논문은 지역 기하 구조와 전역 의미 맥락을 온전하게 이용하는 통합된 PCD 표현을 제안한다, Complementary Pseudo Multimodal Feature (CPMF). 특히 CPMF는 수작업으로 만든 PCD 설명자를 설명적인 사전 훈련된 2D 신경망과 보완하는 방법을 제안한다. 기존 방법들은 오직 특징 추출로 나온 3D에서만 작동했다면, 제안하는 방법은 생성된 pseudo 멀티모달 데이터로 종합적인 구조적, 의미적 단서를 포착하여, PCD 이상 탐지를 향상시킨다.

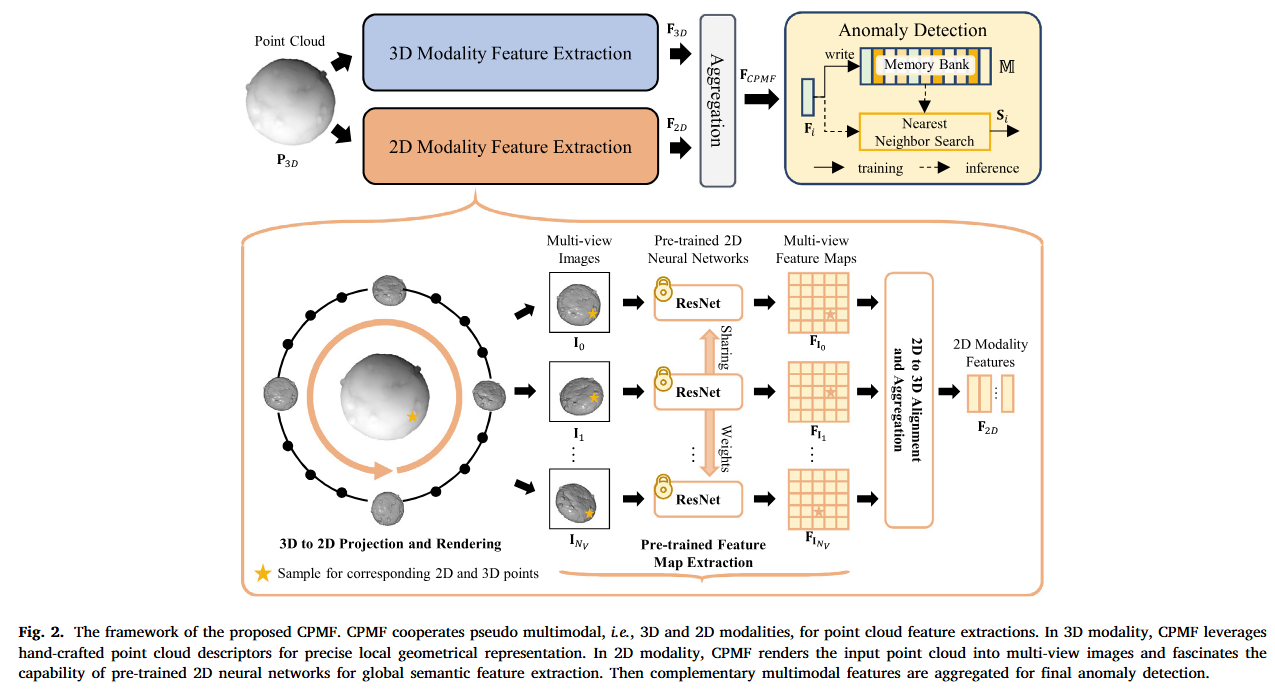

기술적으로, 3D 특징 추출을 위해 CPMF는 PCD의 정확한 지역 기하적 정보를 포착하기 위해 전통적인 수작업 설명자를 사용한다. 또한 PCD에 내재된 의미 정보를 이용하고 보완하기 위해 2D 특징 추출 모듈과 결합하여 사전 학습된 2D 신경망의 향상된 설명 능력을 이용한다. 이 모듈은 3D를 2D로 사영하고 렌더링하는 방식으로 원본 3D PCD를 여러 관점의 2D 이미지를 포함하는 pseudo 2D 모달리티로 변환한다. 그 후, 여러 관점의 이미지의 강력한 의미적 특징 맵을 추출하기 위해 사전 학습된 2D 신경망을 사용한다. 2D에서 3D로 할당하고 통합하는 과정에서, 특징 맵은 각 관점에 2D-3D 사영이 일치하도록 point-wise 특징으로 매핑된다. 최종 2D 모달리티 point-wise 특징을 획득하기 위해 여러 관점으로부터 단서들을 모아 이러한 하나의 관점의 point-wise 특징들은 통합된다. 추출된 3D & 2D 모달리티 특징들은 굉장히 종합적이다.

(1) 3D 수작업된 특징들은 지역 구조는 잘 묘사하지만 전역 의미 정보는 포착하지 못한다.

(2) 2D 사전학습된 네트워크들은 거대 이미지 데이터셋으로부터 깊은 지식을 포함하고 있고, 이에 따라 의미 특징은 잘 포착하지만 거대한 receptive field로 인해 정확하게 지역 구조를 표현하지는 못한다.

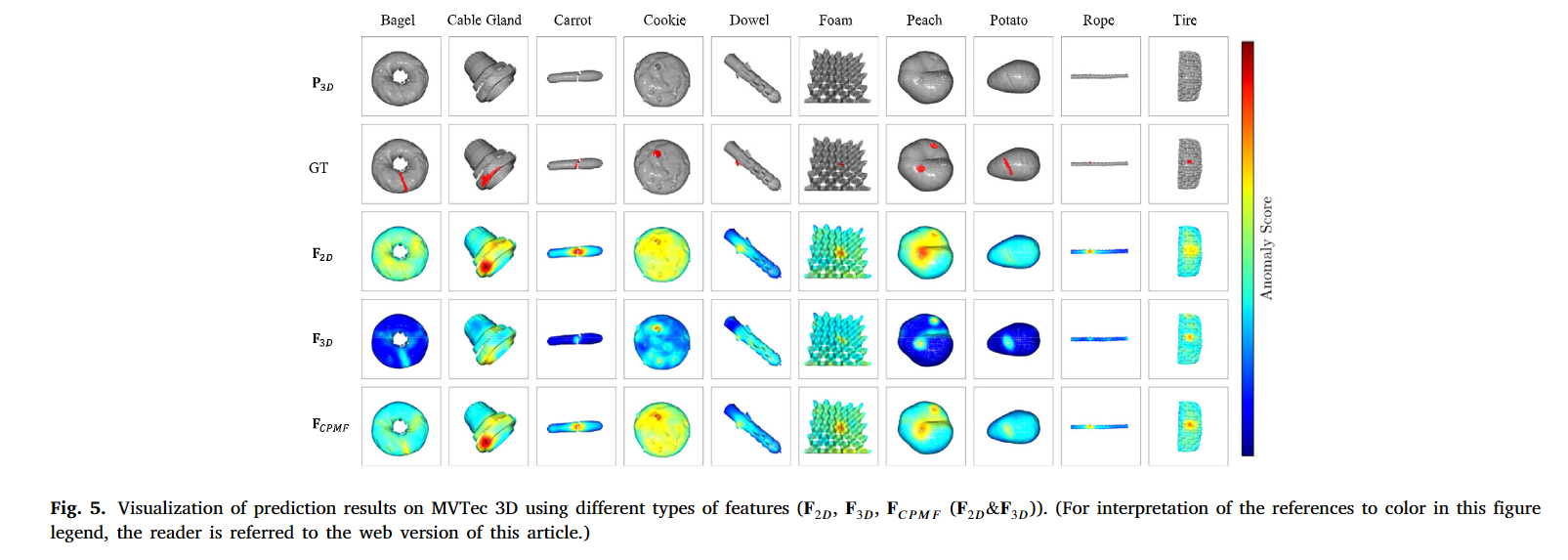

그러므로 CPMF는 3D와 2D 모달리티 특징들을 합쳐서 전역 의미와 지역 기하 정보를 포함하는 특징들을 만들어낸다. 위의 Fig. 1이 그러한 의미이고 이는 질적으로 다른 방법들을 앞선다.

본 연구의 기여점은 다음과 같다.

- PCD 이상탐지를 위해, pseudo multimodality의 PCD 특징을 추출함으로써 PCD에 존재하는 지역 기하 정보와 전역 의미 단서를 통합하는 CPMF를 개발하였다.

- 사전 학습된 2D 신경망을 통해 point-wise한 의미적인 PCD 특징을 획득하여 훌륭한 특징 설명력을 보이는 방법을 제안했다.

- 3D와 2D 모달리티 특징들 사이의 보완적인 능력을 검증하였고 CPMF가 다른 PCD 이상탐지 성능을 크게 뛰어넘는다는 것을 증명하였다.

2. Related work

2.1. 2D image anomaly detection

2D 이미지 이상 탐지는 그동안 정말 많이 이뤄졌고, 보통 MVTec AD 데이터셋을 주로 사용했었다. 2D 이미지 이상탐지 방법들은 크게 두개의 모듈로 구성되어 있는데 특징 추출과 특징 모델링이다. 특징 추출 모델은 정상과 이상 특징들 사이의 구별 가능한 분포와 동일하게 분별력 있는 특징을 생성해내는 것을 목표로 한다. 특징 모델링 모듈은 정상 특징들의 분포를 특징화할 수 있도록 학습되어 비정상 특징들을 처리할 때 얼마나 벗어나는지에 따라 탐지하는 것을 목표로 한다.

초기 연구에서는 처음부터 분별력 있는 특징을 학습하는 것에 집중했다. 이상 탐지에서 괄목할만한 성능을 얻었음에도 불구하고, 사전 학습된 2D 네트워크로부터의 표현이 오히려 이상 탐지에 효과적이라는 사실이 밝혀졌다. 이러한 기술적인 사전학습된 표현들을 사용해서 지식 증류, 메모리 뱅크, flow 기반 방식등 여러 연구에서 특징 모델링 방법들이 제안되었다.

자세한 모델들은 논문을 살펴보자.

2.2. 3D point cloud anomaly detection

2D 이미지 이상 탐지는 굉장히 많이 연구된 반면, 3D PCD 이상 탐지는 여전히 연구가 많이 안되었다. 그치만 MVTec 3D와 Real3D 데이터셋이 등장하면서 인기를 얻고 있다.

PCD 이상탐지는 이미지 이상탐지랑 동일한 모듈들로 구성되어 있긴 한데, 다른 점이 있다면 이미지 데이터셋에 비해 PCD 데이터셋이 너무 적은 양으로만 존재해서, 사전 학습된 PCD 네트워크를 사용하는 것이 그렇게 강건하지 않다는 것이다. 그 결과, 존재하는 PCD 이상 탐지 방법들은 특징 추출 파트에 더욱 집중한다. 초기에 MVTec 3D 벤치마크 이전 방법들은 원본 depth 데이터를 재복원함으로써 PCD 이상을 탐지했다. 그 후의 3D-ST, IMRNet 같은 방법들은 자기지도 학습을 통해 PCD 특징 추출기를 구성했다. 특히 3D-ST는 직접적인 재구성을 통해 특징 추출기를 학습했고, IMRNet은 마스킹하고 재복원하는 패러다임을 사용해서 더 나은 표현 설명력을 획득했다.

몇몇 방법들은 PCD 특징과 RGB 특징들을 결합하곤 했는데, BTF가 대표적이며 이는 PCD 특징과 RGB 특징들을 수작업된 기술자와 사전 학습된 2D 네트워크로부터 추출한다. 유사하게, M3DM은 PCD 특징과 RGB 특징을 추출하는데 상호간의 유사한 정보를 더 많이 포함하도록 하기 위해 patch-wise한 대조학습을 채택했다.

하지만 수작업 PCD 기술자와 사전학습된 PCD 네트워크는 지역 기하적 정보 탐지에는 뛰어나지만 전역 의미 추출에는 부족하다. 그러므로 본 연구는 PCD를 이미지로 변환함으로써 부족했던 전역 의미를 보완하고 사전 학습된 2D 네트워크를 이용해 표현을 추출하고자 했다.

2.3. Point cloud feature learning

기존에 지배적인 접근 방법은 3D 모달리티의 PCD 특징을 직접적으로 추출하는 것이었다. 전통적인 방법들은 기하적 정보를 모델링하기 위해 휴리스틱한 디자인에 의존했다. FPFH, PointNet, PointNet++, PCGF 등이 있으니 논문을 참고하자.

위 방법들 말고, 몇몇 접근법들은 잘 구성된 2D 표현을 사용하고자 원본 PCD를 여러 관점의 2D 모달리티로 렌더링하였다. Multiview CNN, Local shape descriptors 등이 있으니 논문 참고하자.

본 연구는 PCD 이상 탐지를 타겟으로 하고, 특히 기술적인 PCD 특징 학습에 집중한다. 제안하는 CPMF는 PCD 데이터를 종합적으로 표현하기 위해 생성된 pseudo 2D 모달리티와 3D 모달리티를 통합한다. 2D와 3D 모달리티 특징들간의 보완적인 능력을 이용하여, 최종 PCD 표현은 지역 구조 정보와 전역 의미 지식을 통합하여 PCD 이상탐지 성능을 높인다.

3. CPMF

3.1. Problem definition

3D PCD는 N개의 포인트를 입력으로 해서 각 포인트별 이상 스코어를 출력하는 것을 목표로 한다. 높은 스코어일수록 이상인 것이다. 그 후 이상 스코어에 따라 이상 구역을 찾아낸다. 추가로 PCD의 이상 정도를 결정하기 위해 객체 단위의 이상 스코어도 필요하다. 일반적으로 PCD 이상 탐지는 비지도 학습 방식을 따른다. 즉, 학습 단계에서는 정상 PCD만 존재한다고 가정한다. 테스트 단계에서는 포인트 단위로 객체 단위로 이상 스코어를 산출해야 한다.

3.2. Pipeline overview

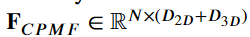

위 그림에서 볼 수 있듯, CPMF는 3D 모달리티 특징 추출 모듈과 2D 모달리티 특징 추출 모듈로 구성되어 있다. 각각은 포인트 단위의 기술적인 PCD 특징을 추출한다. CPMF는 먼저 입력으로 PCD를 두 모듈로 보내고 3D 모달리티 특징과 2D 모달리티 특징을 추출한다. 3D 모달리티 특징 추출을 위해 수작업된 PCD 기술자가 이용되어 PCD의 지역 구조를 표현한다. 다음으로 2D 모달리티 특징 추출 모듈은 3D PCD를 여러 관점의 2D 모달리티로 사영한다. 사영된 멀티 뷰 이미지는 사전학습된 2D 신경망으로 전달되어 분별력 있는 의미적인 피쳐 맵을 추출한다. 그 후, 피쳐맵들은 3D 공간에 할당되어 포인트 단위의 2D 모달리티 특징을 생성한다. 3D 특징과 2D 특징은 보완적인 지식을 포함하기 떄문에 다른 방향으로 이용된다. 3D 특징은 이웃 포인트들 사이의 지역 정보, 2D 특징은 넓은 receptive fields와 깊은 의미 지식을 가지고 있는 사전 학습된 2D 신경망으로부터 비롯된 강한 의미 정보를 포함한다. CPMF는 그들을 통합해서 보완적인 pseudo 멀티모달 특징 를 생성한다. 최종적으로 성능 좋은 메모리 뱅크 기반 이상탐지 모델인 PatchCore와 결합되어 PCD 이상탐지를 수행한다.

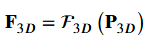

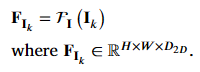

3.3. 3D modality feature extractor

PCD 특질 추출은 오래 연구되긴 했지만, 특정 과업에서는 좋아도 PCD 이상탐지에 있어서는 수작업으로 뽑힌 특징들보다는 안 좋았다. 그러므로, 본 연구는 BTF 방법을 차용해서 PCD의 지역 기하학 정보를 직접적으로 이용하기 위해 수작업된 기술자를 이용하기로 했다. 3D 특질 추출함수에 의해 뽑힌 3D 특징은 아래와 같이 표현된다.

3.4. 2D modality feature extractor

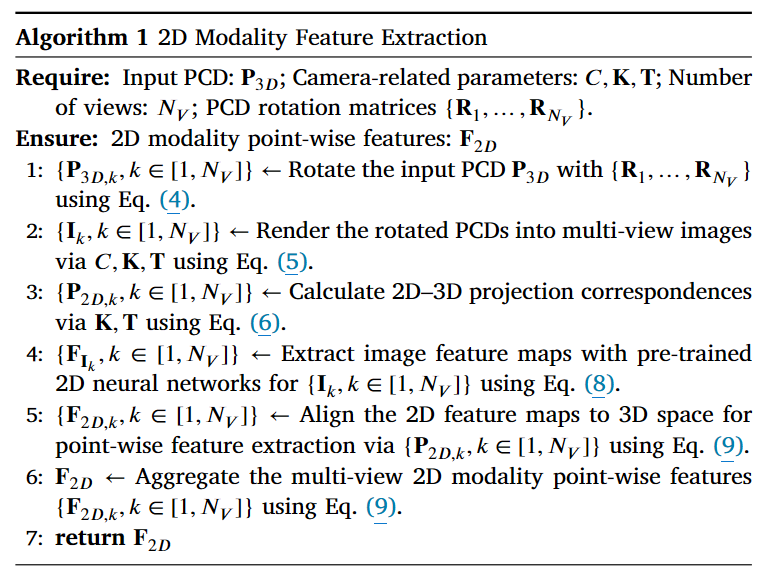

전역 의미 부족을 보완하기 위해, 본 연구는 사전학습된 2D 신경망을 통해 pseudo 2D 모달리티 포인트 단위 특징 생성 방법을 제안한다. 특히 입력 PCD에 대해 2D로 사영하고 렌더링하는 작업은 먼저 멀티뷰 이미지를 생성하는 것이다. 그 후, 사전학습된 특징 맵 추출을 위해, 사전학습된 2D 신경망이 사용된다. 이후의 2D를 3D로 할당하기 위해서, 특징 맵은 원본 이미지와 같은 크기로 up-sampling된다. 최종적으로, 이미지 특징 맵이 원본 3D 공간에 할당되어 포인트 수준의 2D 모달리티 특징을 획득한다.

3.4.1. 3D to 2D projection and rendering

잘 만들어진 사전학습된 2D 신경망으로부터 얻은 표현의 장점을 살리기 위해, 본 연구는 이미지 렌더링 연산을 통해 멀티뷰 이미지를 생성하고 이 이미지들을 2D 신경망에 보내서 멀티뷰 이미지 특징 맵을 추출한다. 렌더링 작업은 아래 연산과 같다.

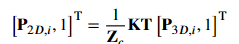

2D에서 3D로 할당하고 합치기 위해서 3D 포인트와 2D 픽셀 좌표에서의 위치를 일치시켜줄 필요가 있다. 이를 2D-3D correspondences라고 한다. 이에 대해서는 아래와 같이 수식화된다.

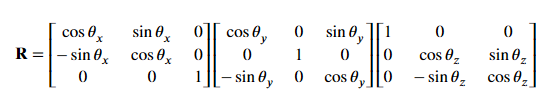

3D를 2D로 렌더링하는 작업은 정보 손실을 야기할 수도 있다. 이를 방지하기 위해 본 연구는 3D를 서로 다른 각도 행렬에 따라 연속적으로 회전한다. 이에 대한 수식은 아래와 같다.

지금까지 위에 적어놓은 내용에 대해 그림을 살펴보면 이해가 쉬운데 이는 아래와 같다.

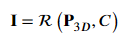

3.4.2. Pre-trained feature map extraction

앞서 멀티뷰 렌더링으로, 멀티뷰 이미지가 얻어졌다. 다음으로 이를 사전학습된 2D 신경망으로 보태 이미지 특징 맵을 추출한다.

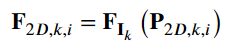

3.4.3. 2D to 3D alignment and aggregation

이미지 특징 맵은 사전학습된 2D 신경망이 거대 이미지 데이터셋으로부터 유익한 지식을 많이 포함하게 되었기 때문에 상당히 분별력 있다. 본 연구는 이후 k번째 뷰로부터 포인트 수준의 2D 모달리티 특징을 획득한다.

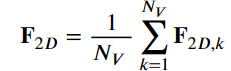

그 후 여러 뷰의 포인트 수준 특징들은 결합되어 사용된다.

지금까지 2D 모달리티 PCD 표현 추출과정에 대한 알고리즘은 다음과 같다.

3.5. Aggregation

3D와 2D 모달리티 특징들의 능력을 상호보완하기 위해, 본 연구는 이들을 함께 정규화하고 집중해서 CPMF 특징을 얻는다.

이들을 unit 벡터로 정규화하고 같은 크기를 같도록 한다음에 추후 이상탐지에 활용한다.

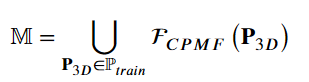

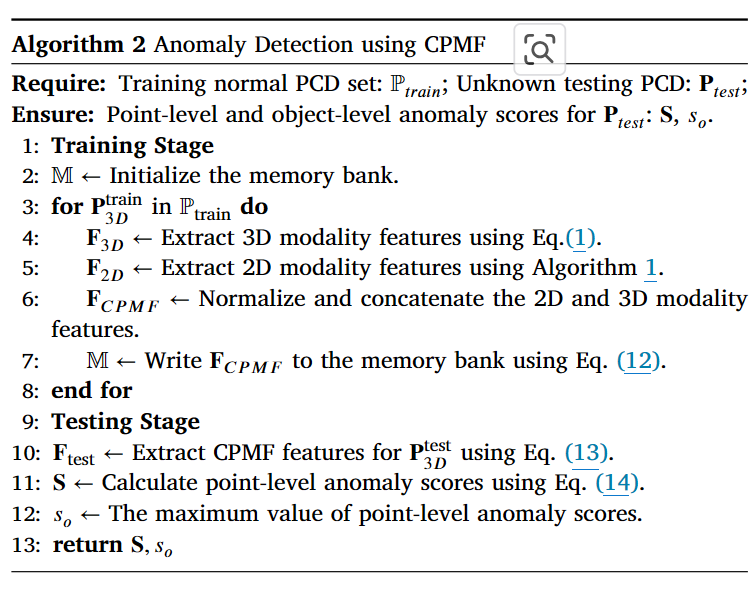

3.6. Point cloud anomaly detection

본 연구는 이상탐지 과업에는 PatchCore를 사용한다. 학습 단계에서, 모든 학습 PCD를 사용해서 memory bank를 만든다.

해당 메모리 뱅크는 모든 PCD 포인트 셋에 대한 CPMF 특징을 포함한다.

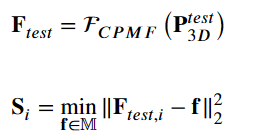

테스트 단계에서는 테스트 PCD에 대해 이상 스코어를 추론하기 위해서, CPMF 특징들을 추출하고 nearest neighbor search를 사용하여 이상 스코어를 계산한다.

포인트 수준의 이상 스코어 중 최대값을 객체 수준의 이상 스코어로 활용한다. 전반적인 과정은 아래 알고리즘으로 정리된다.

4. Experiments

4.1. Experimental settings

4.1.1. Dataset

실험에 사용한 데이터셋은 MVTec 3D 데이터셋과 Real3D이다. MVTec 3D는 10개의 카테고리, Real3D는 12개의 카테고리로 구성되어 있고 모두 3D센서를 통해 얻어진 데이터이다.

비록 대부분의 이상들은 구조적인 문제지만, 몇몇 이상들은 텍스쳐 기반 이상이기 때문에 RGB 데이터에 의존할 수밖에 없다.

4.1.2. Implementation details

Data Preprocessing

MVTec 3D 데이터셋에 대해서는 BTF 논문을 따라가서 배경을 제거했다. 추가로, MVTec 3D는 2.5D PCD를 제공하는 반면, Real3D는 풀 3D 데이터를 제공하고, 2.5D를 테스트에 사용하도록 했다. 그래서 MVTec 3D와 맞게 Real3D도 2.5D로 바꿔서 사용했다.

3D Modality Feature Extraction

BTF와 FPFH를 사용해서 3D 모달리티 특징 추출했다. FPFH 속도 높이려고 다운 샘플링도 진행했다.

2D Modality Feature Extraction

멀티 뷰 이미지를 렌더링을 통해 만들 때는 Open3D 라이브러리 사용했다. 모든 이미지는 ImageNet dataset의 평균과 분산을 사용해서 정규화되었다.

CPMF는 학습 파라미터가 없고 대신 수작업 3D 기술자만 이용한다. 그러므로, CPMF는 최적화 과정이 없다.

4.1.3. Evaluation metrics

Object-level AUROC

Point-level PRO, AUROC

4.1.4. Comparison methods

MVTec 3D : 3D-ST, BTF, M3DM, Shape-Guided

Real3D : BTF, M3DM, Reg3D-AD

4.2. Comparisons on mvtec 3D

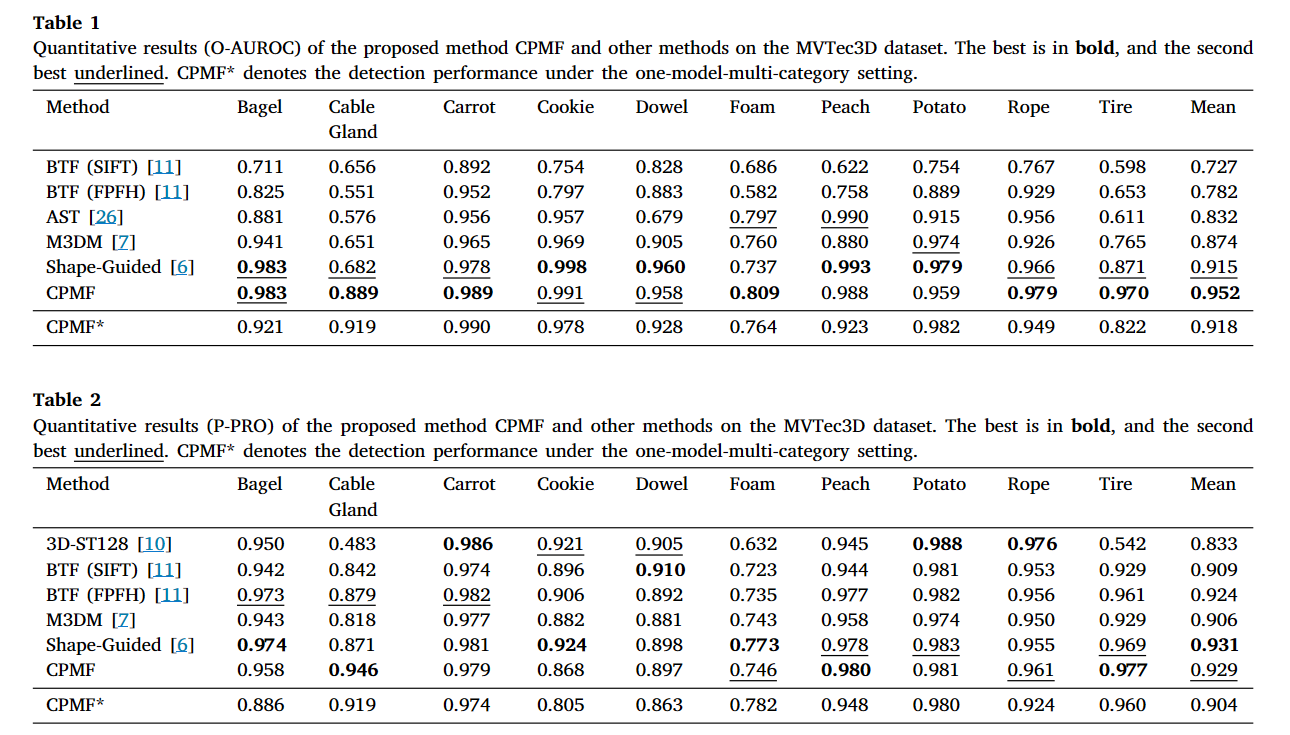

카테고리 별로 차이는 있지만, 제안하는 CPMF가 가장 훌륭하다.

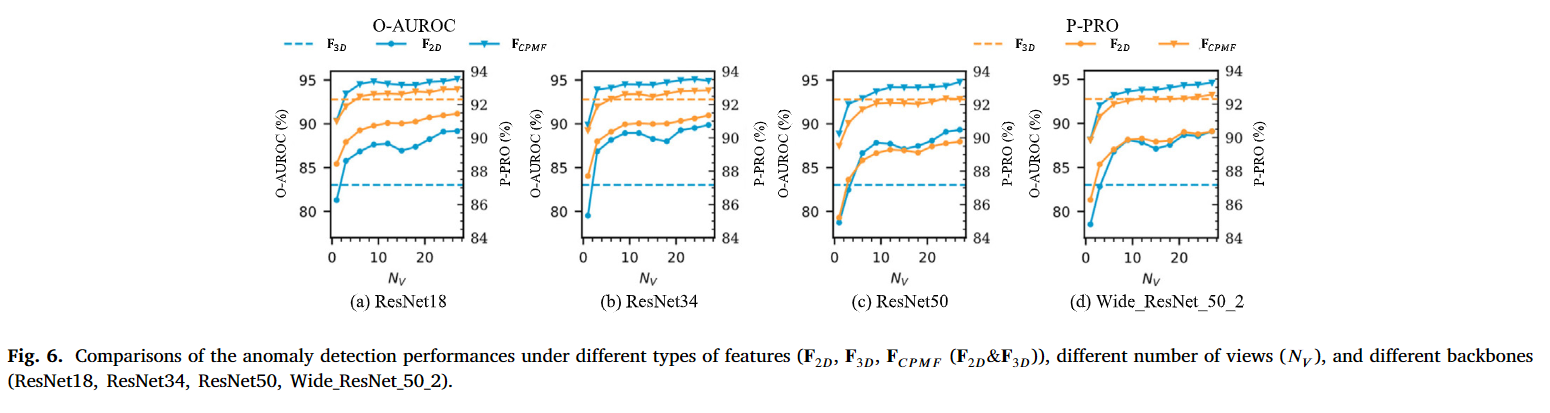

4.3. Ablation study

어떤 특징들, 뷰의 개수, 다른 backbone을 사용했는지에 따른 성능 차이를 보여준다.

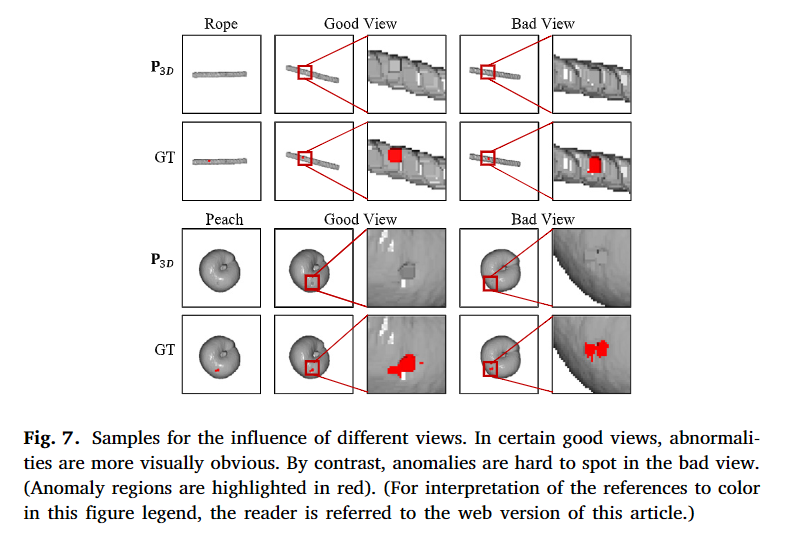

좋은 뷰와 그렇지 않은 뷰를 보여준다.

5. Conclusion

본 논문은 어려운 과업인 PCD 이상 탐지를 수행했으며 CPMF를 제안해서 성능을 높였다. 복잡한 수작업의 PCD 기술자와 사전 학습된 2D 신경망으로부터의 특징들을 통합하여 PCD 데이터를 세밀하게 묘사하여 지역 기하적 정보와 전역 의미 단서를 이용할 수 있었다.

MVTec 3D와 Real3D를 사용해서 성능을 검증했고, SOTA 성능을 달성했다.

추가적인 실험으로 2D Backbone을 더욱 최신 모델들로 변경해서 실험해볼 필요가 있다.