아래 내용은 claude가 생성한 답변입니다.

1. 전체 요약:

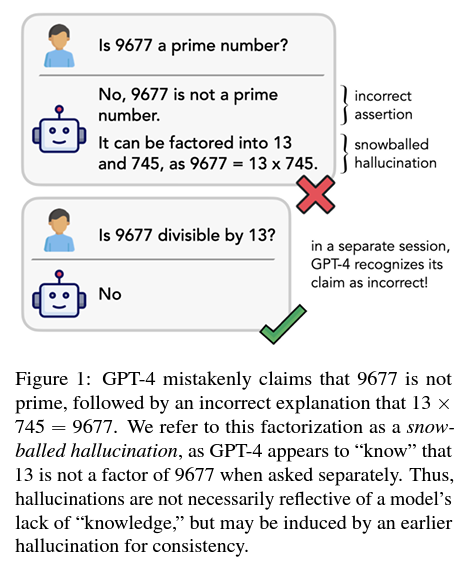

언어 모델의 환각(hallucination) 현상이 눈덩이처럼 커지는 현상을 연구한 논문입니다. ChatGPT와 GPT-4가 잘못된 답변을 한 후, 그 답변을 정당화하기 위해 추가적인 잘못된 주장을 하는 현상을 발견했습니다.

Introduction:

언어 모델이 실제 응용에서 부정확한 진술을 하는 환각 현상이 주요 위험요소

기존에는 지식 격차 때문이라고 여겨졌으나, 이전 잘못된 답변을 정당화하기 위해 추가 오류를 만드는 현상 발견

ChatGPT와 GPT-4는 자신의 실수를 각각 67%와 87% 식별 가능함에도 이런 현상 발생

2. Method:

초기 답변 후 설명을 요구하는 질문 형식 설계

모델이 잘못된 답을 한 후 그것을 정당화하기 위한 추가 설명 분석

별도 세션에서 해당 설명의 정확성 검증

3. Data:

세 가지 데이터셋 구축 (각 500개 문제):

소수 판별 테스트

미국 상원의원 학력-출신주 검색

도시간 항공편 연결 확인

4. Experiment:

ChatGPT와 GPT-4에 대해 zero-shot 테스트 진행

다양한 temperature 값과 프롬프트 방식 시도

모델의 답변과 설명의 정확성 평가

5. Result:

두 모델 모두 낮은 정확도 기록 (ChatGPT 39.87%, GPT-4 16.6%)

잘못된 답변에 대한 환각 인식률:

ChatGPT: 67.37%

GPT-4: 87.03%

"단계별 생각하기" 프롬프트로 정확도는 향상되었으나 환각 현상은 지속

6. Conclusion:

언어 모델의 환각 현상이 단순한 지식 부족이 아닌 이전 답변과의 일관성 유지를 위해 발생할 수 있음

모델 훈련 시 사실 확인과 답변 수정 능력 강화 필요성 제기

향후 연구에서 모든 모델 개발 단계에서 이 문제를 고려해야 함을 강조