신경망을 수식으로 분해해보기

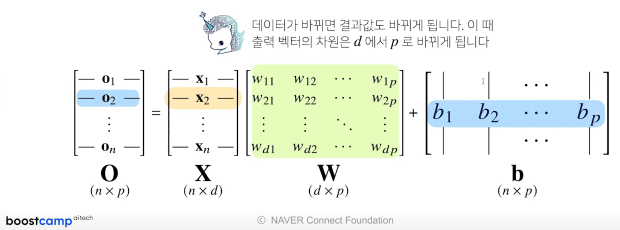

위 그림은 선형모델의 형태이고, O = XW+b의 형태로 표현이 가능하다

입력으로 넣어준 d개의 변수로 p개의 모델을 만들어서 p개의 잠재 변수 를 설명하는 선형모델이라고 설명할 수 있다.

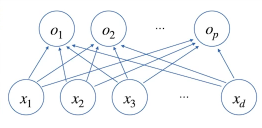

이 그림이 수식으로 표현된 선형모델을 그림으로 나타낸 것이다.

는 X의 행벡터를 나타내고, 는 마찬가지로 O의 행벡터이다. 화살표의 개수는 n*p개가 될텐데 이는 W행렬의 총 원소수와 동일하다.

소프트맥스(Softmax) 연산

- 소프트맥스 함수눈 모델의 출력을 확률로 해석할 수 있게 도와주는 연산이다.

- 분류 문제를 풀 때 선형모델과 소프트맥스 함수를 결합하여 예측한다.

위 선형모델에 softmax 연산을 적용하면 출력 벡터 에 softmax 함수를 합성하면 확률 벡터가 되므로 특정 클래스 에 속할 확률이라고 해석할 수 있습니다.

예를들어 라고 했을때 softmax연산을 거치면 가 되는데, 이는 각 값이 어떤 클래스에 속할 확률이 된다.

선형모델로 얻은 결과가 확률이 아닌 경우가 이는데 이를 총 합이 1인 확률벡터로 바꿔주기 때문에 softmax연산을 사용한다.

대신 분류가 아닌 추론을 하는 경우에는 softmax대신 one-hot인코딩을 이용해 최대값을 가진값만 1로 출력하게끔 해준다.

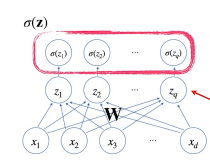

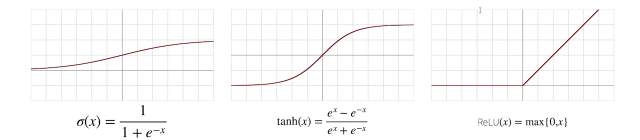

활성함수

신경망은 선형모델과 활성함수를 합성한 함수이다. 위그림을 보면 원래의 신경망에 활성함수를 적용하는 노드가 추가되었다.

- 시그모이드(sigmoid) 함수나 하이퍼볼릭 탄젠트(tanh)함수는 전통적으로 많이쓰이던 활성함수이고, 현대 딥러닝에서는 주로 ReLU 함수를 많이 쓰고 있다.

- 활성함수는 비선형함수로서 딥러닝에서 매우 중요한 개념이고, 활성함수가 없으면 딥러닝은 선형모형과 차이가 없다.

라 할때, 입력값 x를 무수히많은 f에 통과를 시켜도 그 결과는 다시 선형모델이 되게된다. 이는 모델을 딥(deep)하게 만들어도 입력,출력만 있는 모델과 전혀 다를바가 없어진다.

위 3개가 활성함수의 대표적 모델이며 왼쪽부터 sigmoid, tahn, Relu이다.

더 깊은 모델

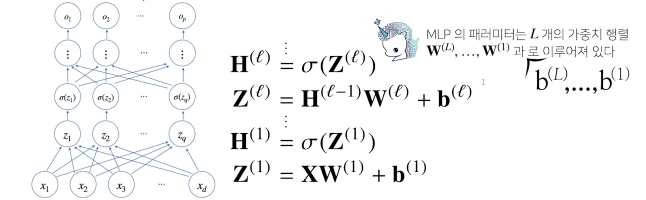

- 위의 모델에서 신경망을 여러층 쌓게되면 다층(multi-layer) 퍼셉트론(MLP)라고 부른다.

그럼 왜 층을 여러개를 쌓는가?

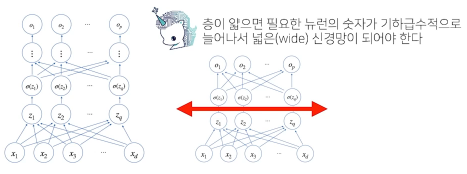

→ 이론적으로는 2층신경망(은닉층 x)으로도 연속함수 근사가 가능하다. 그러나 층이 깊을수록 목적함수를 근사하는데 필요한 뉴런(노드)의 숫자가 훨씬 빨리 줄어들어 좀 더 효율적인 학습이 가능해진다.

그러나 층이 깊다고 해서 복잡한 함수를 근사는 할 수 있겠지만 최적화가 쉽다는 것은 아니다. 복잡한 함수를 근사할때는 최적화에 더 많은 노력을 기울여야하고 학습에 어려움이 있다. (이부분은 CNN파트에서 다룰 예정)

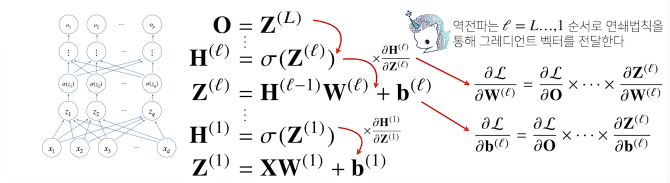

역전파 알고리즘(Backpropagation)

- 딥러닝은 역전파알고리즘을 사용해 각층의 가중치를 갱신해나간다.

- 각 층의 파라미터의 그레디언트 벡터는 윗층(출력층)부터 역순으로 계산하게 된다. 이는 아랫층(입력층 쪽)의 그레디언트 벡터는 그뒤의 모든 층에 영향을 미치고(여러층에 영향을 미치기 때문에 한번에 계산하기 쉽지 않다.), 윗층의 그레디언트 벡터는 아랫쪽보다 상대적으로 적게 영향을 미치기 때문이다.

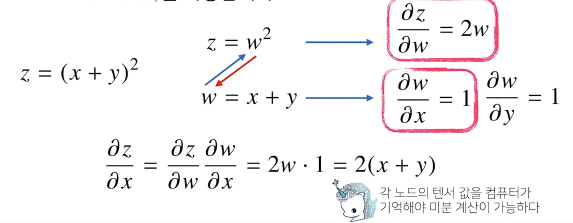

- 역전파 알고리즘은 연쇄법칙(chain-rule)기반으로 사용한다.