Abstract & Introduction

Background

CTTA는 장기적인 적응을 추구하는 과정에서 2가지 문제점이 발생한다.

1. Catastrophc forgetting

2. Error acculmulation이러한 두가지 문제점을 해결하기 위해 최근 CTTA연구들은

1. 모델의대부분의 파라미터를 업데이트

2. Self-trainging을 통한 적응하지만 위와 같은 방법들은 노이즈가 많은 pseudo-lables(가짜 레이블)로 인해 Error acculmulation문제를 악화시키며 모델 전체를 업데이트를 하는 과정에서 높은 비용계산이 발생

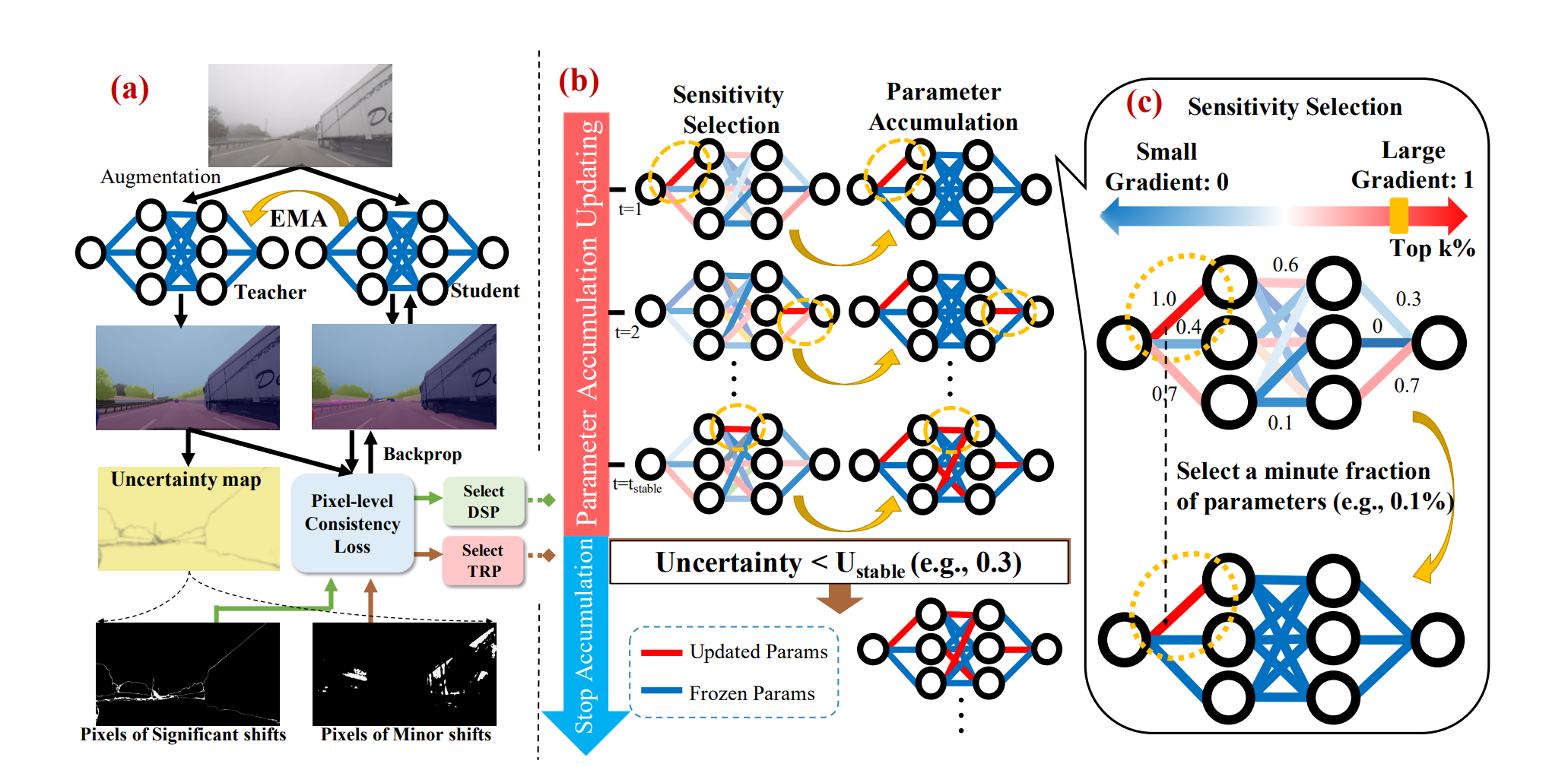

Method

Distribution-Aware Tuning(분포 인식 튜닝) : 데이터 분포를 기반으로 적응 과정에서 두 개의 소규모 학습 가능한 파라미터 그룹을 선택하고 업데이트한다.

1. DSP : 큰 분포 변화를 보이는 출력에 민감하게 반응하여, 오류 축적 문제를 효과적으로 완화

2. TRP는 작은 분포 변화에 반응하는 위치에 할당되며, 이를 미세 조정하여 망각 현상을 방지

CTTA는 시계열 데이터에서 작동하기 때문에 PAU 전략을 도입

PAU(Parameter Accumulation Update) : 데이터가 연속적으로 유입될 때, 한번에 전체 모델을 업데이트 하지 않고 매 프레임마다 아주 적은 양(0.1%)의 파라미터만 업데이트하는 방식. 이렇게 업데이트 된 파라미터는 시간이 지남에따라 누적되어 특정 시점에서 모델이 새로운 도메인에 적응하게 된다.

Method

Distribution-Aware Tuning Framework

A. Preliminary

- CTTA는 추론중에 지속적으로 변화하는 타겟 도메인에 소스데이터 없이 소스에서 사전 학습된 모델을 적응시키는 것을 목표로 한다.

- 모델 : 사전 학습된 모델 𝑓𝜃(𝑥)는 소스 데이터 Xs와 레이블 Ys로 학습된 파리미터 𝜃를 포함한다.

- 도메인의 분포변화 :

타겟 도메인의 분포 (𝑋𝑇1,𝑋𝑇2,...,𝑋𝑇𝑛)는 끊임없이 변화하며 타겟 도메인의 각 샘플은 한번만 사용 가능하다.

전체 과정 설명

A. 초기 입력 및 데이터 흐름 (Teacher-Student Framework)

1. 입력 이미지 및 데이터 증강(Augmentation)

2. 교사(Teacher)와 학생(Student) 모델에 데이터 전달

- 교사 모델:

안정적으로 동작하며, EMA(Exponential Moving Average)를 통해 지속적으로 업데이트- 학생 모델:

현재 타겟 도메인(새로운 환경)에서 직접 학습

- 출력 – 세그멘테이션 맵(Segmentation Map) 생성

- 교사와 학생 모델은 각각의 세그멘테이션 결과를 출력한다.

B. 불확실성 맵(uncertainty map) 생성 및 픽셀 그룹화

4.불확실성 맵 생성

- 교사 모델의 결과와 학생 모델의 결과를 비교해 불확실성 맵을 생성

- 픽셀 그룹화

- Significant Shift (높은 불확실성): 분포 변화가 큰 픽셀 →DSP(Domain-Specific Parameters)로 업데이트

- Minor Shift (낮은 불확실성): 분포 변화가 작은 픽셀

→TRP(Task-Relevant Parameters)로 업데이트C. DSP 및 TRP 선택 (파라미터 선택 과정)

6. 불확실성 기반으로 파라미터 선택

- 불확실성 값이 높은 픽셀에서 DSP를 선택하고, 불확실성 값이 낮은 픽셀에서 TRP를 선택한다.

- 이진 마스크를 사용해 선택된 픽셀에서만 backpropagation을 수행

- 기울기(Gradient) 분석 – 민감한 파라미터 선택

- 역전파 과정에서 기울기 값(Gradient)이 큰 파라미터를 식별합니다.

기울기가 클수록 해당 파라미터가 중요한 역할을 합니다.D. 파라미터 누적 업데이트(PAU, Parameter Accumulation Update)

8. 파라미터 누적 업데이트 진행

- DSP 및 TRP는 단계별로 소량(예: 0.1%)의 파라미터만 업데이트한다.

- 각 프레임에서 업데이트된 파라미터가 누적된다.

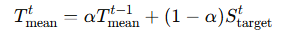

E. EMA (Exponential Moving Average) – 교사 모델 업데이트

- 학생 모델이 업데이트된 후, 교사 모델은 EMA 방식으로 학생 모델을 반영

F. 불확실성 임계값 도달 및 PAU 중단

- 누적 업데이트는 불확실성 맵의 모든 픽셀 값이 U stable =0.3 이하로 떨어질 때 중단

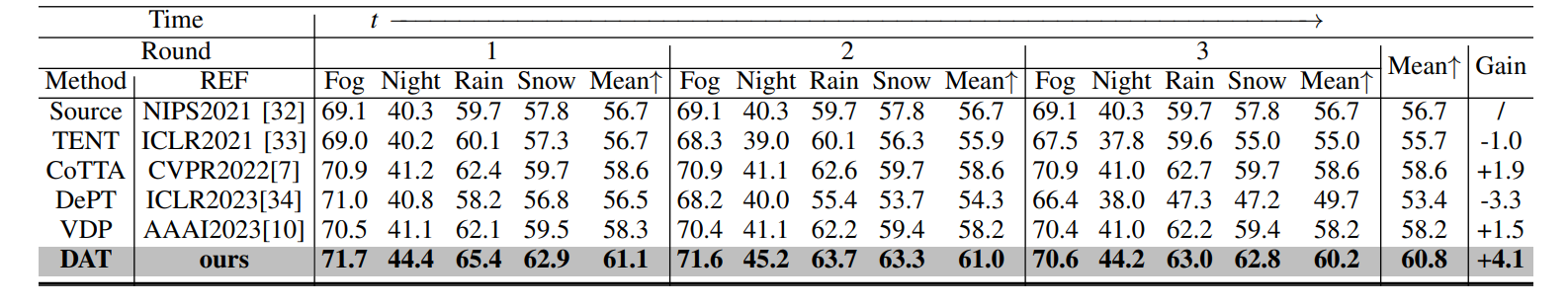

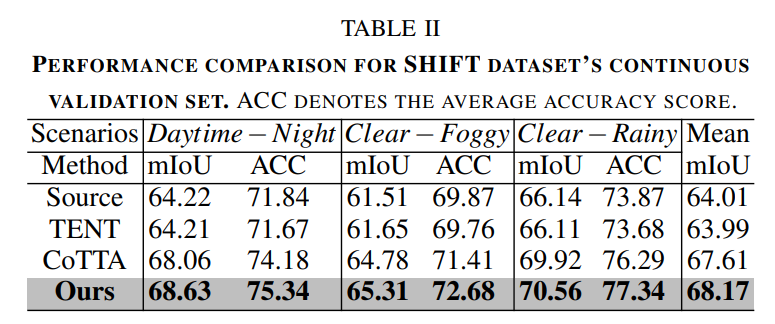

EXPERIMENTS

DataSet : Cityscapes-to-ACDC , SHIFT 데이터셋

1. 성능 비교 – Cityscapes to ACDC

결과 :

DAT는 mIoU 60.8%로 기존 방법보다 4.1% 향상된 성능을 보였다.2.성능 비교 – SHIFT 데이터셋

결과 :

DAT는 CoTTA 대비 Foggy 상황에서 0.53%, 전체 평균 mIoU에서 0.56% 향상하였으며 낮에서 밤으로 변화하는 상황에서도 높은 적응력을 보였다.