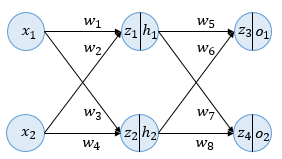

Neural Network?

: input layer / hidden layer / output layer 로 구성된 망을 통해 스스로 학습하여 값을 찾는 알고리즘.

각 뉴런에는 입력을 가공하여 출력을 도출하기 위한 activation function(ex. step/sigmoid)이 있다.

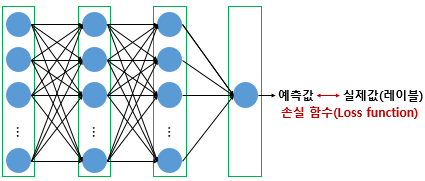

Loss Function?

: 실제값(labeling)과 예측값의 차이를 수치화해주는 함수. 일반적으로 regression에서는 MSE, Classification에서는 Cross Entropy Loss 사용.

#Cross Entropy Loss

y = 실제값(0 or 1), y' = 예측값(확률)

Batch?

: Backpropagation시 parameter를 조정할 때 사용하는 데이터의 양,

트레이닝 데이터를 통째로 신경망에 넣으면 비효율적인 리소스 사용으로 학습 시간 증가하기 때문

Epoch?

: 전체 트레이닝 셋이 하나의 신경망에 적용되어 순전파와 역전파를 통해 신경망을 한 번 통과한 횟수

Iteration?

: 1 epoch를 마치는데 필요한 mini-batch갯수(필요한 파라미터 업데이트 횟수)

즉, 전체 data수 500, mini-batch 100일 때 1 epoch을 돌릴 때 5 iteration이 필요.

Optimizer?

: 손실 함수의 값을 줄여나가며 학습하는 방법

ex. Gradient Descent, Adam

Backpropagation?

: Loss를 weight로 편미분하여 오차를 줄여나가는(=학습을 진행하는) 방법. Chain Rule을 이용.

추가적인 내용 -

https://wikidocs.net/37406