[논문리뷰]Going deeper with convolutions

GoogLeNet

기본정보

->VGGNet에 비해 더 많은 층을 사용하고

->Inception module을 사용

->2014년 이미지넷 대회 우승

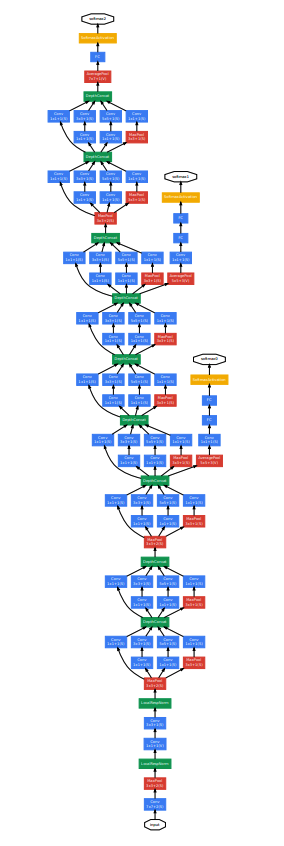

구조

->Inception module:다양한 크기의 합성곱 층을 병렬로 사용함

->1x1 Conv를 사용하여 차원감소

->깊은 층의 학습을 위해 보조 네트워크 (Auxiliary classifier사용)

->FC대신 GAP(Global Average Pooling)사용하여서 가중치 필요를 없앰

특징

->inception module의 사용을 통해 깊은 네트워크의 학습이 가능

->1x1 Conv를 통해 차원을 감소시켜 파라미터 수가 과도하게

늘어나는 것을 방지 (filter개수를 조절)

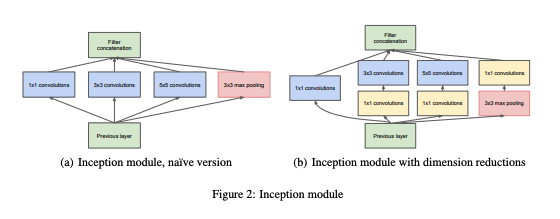

*naive->dimension reduction(tensor를 줄여주는...1x1)

nn의 퍼포먼스를 올리는게 depth나 width를 올리는데에

초점이 맞춰져있는데 이에 따라 발생하는 문제점인 파라미터수의 증가

혹은 computational budget을 해결하면서 퍼포먼스를 올릴 수 있게 한다는 것

이 논문에 핵심

global averageing pooling만 사용해서 오버피팅을 방지.

Inception module을 고안

naive ver. 11,33,5*5를 병렬적으로 배치,

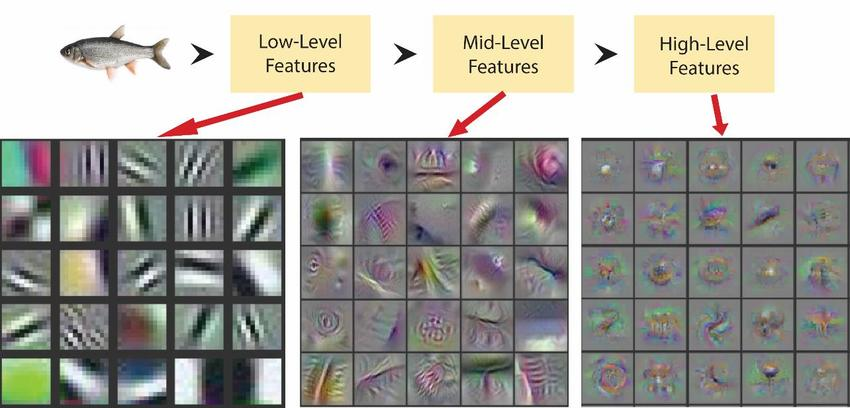

1 x 1, 3 x 3, 5 x 5 Convolutional filter의 수는 망이 깊어짐에 따라 달라지는데, 만약 위 그림처럼 높은 layer에서만 포착될 수 있는 높은 추상적 개념의 특징이 있다면, 공간적 집중도가 감소한다는 것을 의미한다. 따라서 높은 layer를 향해 네트워크가 깊어짐에 따라 3 x 3과 5 x 5 Convolutional filter의 수도 늘어나야 한다.3x3 max pooling은

convolution network의 성공에서 필수적이기 때문에 이득을 취하기 위해 배치

그런데 이때에도 문제가 있음

3x3,5x5의 연산량이 여전히 많음. 따라서

이전에 1x1을 배치하면 연산량을 훨씬 줄일수 있음

연산량을 줄일수있으면서 width와 depth는 늘릴수있음.

추가적으로, Convlution 연산 이후에 추가되는 ReLU를 통해 비선형적 특징을 더 추가할 수 있다.

auxiliary classifier 중간단계에서 예측을 수행함

-> 깊은 네트워크에서 학습이 잘 안될 수 있는 점을

이를 통해 추가적인 gradient를 줌으로써 보완

또한 효율적인 메모리 사용을 위해 낮은 layer에서는 기본적인 CNN 모델을 적용하고, 높은 layer에서 Inception module을 사용하는 것이 좋다고 합니다.

정리해서 보자면 Inception module의 장점으로는

-

과도한 연산량 문제없이 각 단계에서 유닛 수를 상당히 증가시킬 수 있다. 이는 차원 축소를 통해 다음 layer의 input 수를 조절할 수 있기 때문이다.

-

Visual 정보가 다양한 Scale로 처리되고, 다음 layer는 동시에 서로 다른 layer에서 특징을 추출할 수 있다. 1 x 1, 3 x 3, 5 x 5 Convolution 연산을 통해 다양한 특징을 추출할 수 있기 때문이다.

GoogleNet에서 그 외에 성능을 높이기 위해서 사용한 기법들은

동일한 GoogleNet모델의 7가지 버전을 독립적으로 학습하고

cropping방식 적용

final prediction은 mulitiple crop/all the individual classifier에 대한

softmax probability를 평균하여 얻는 방식들을 통해 성능을 높이는데

추가적인 방법을 취했습니다.

computatinal budget을 inception module을 통해 해결하면서 계산량을

조금 증가시키는 것에 비해 성능이 아주 좋아졌습니다.

참고한 출처: https://phil-baek.tistory.com/entry/3-GoogLeNet-Going-deeper-with-convolutions-논문-리뷰 [philBaek (백광록) 개발 일기장:티스토리]