딥러닝 모델을 ONNX(표준 포맷), TensorRT(엔진/런타임) 등으로 변환하면

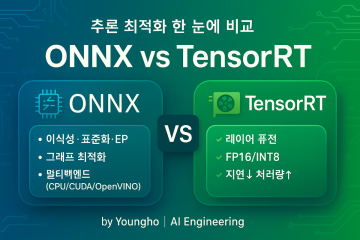

1. 이식성 & 표준화: ONNX는 프레임워크 간 상호운용을 위한 개방형 표준이라 다양한 런타임/하드웨어에서 돌릴 수 있다.

2. 성능 최적화: ONNX Runtime은 그래프 최적화·EP(Execution Provider)로 CPU/GPU/전용 가속기에서 빠르게 추론하고, TensorRT는 NVIDIA GPU에서 레이어 퓨전·커널 자동 튜닝·저정밀(FP16/INT8)로 낮은 지연/높은 처리량을 제공한다.

3. 경량화/비용 절감: ORT/TensorRT의 양자화(INT8) 등으로 메모리와 전력을 줄이고 비용을 낮출 수 있다.

4. 운영 편의: Triton 같은 서빙 스택에서 ONNX/ORT, TensorRT를 표준 방식으로 운영·배치할 수 있다.

| 구분 | ONNX | TensorRT |

|---|---|---|

| 성격 | 모델 포맷(표준) | 고성능 추론 SDK/런타임(엔진) |

| 목적 | 프레임워크/런타임 간 이식성 | NVIDIA GPU에서 지연↓·처리량↑ |

| 최적화 | 그래프 최적화(노드/레이아웃/퓨전)·EP로 하드웨어 가속 | 레이어 퓨전, 커널 선택, 메모리 최적화, FP16/INT8 |

| 실행 | ONNX Runtime + 다양한 EP(CPU/CUDA/TensorRT/OpenVINO 등) | TensorRT 엔진(plan) 실행 |

출처

ONNXdocs_IR

ONNXdocs_Quantization

NVIDIAdocs

NVIDIAdocs

NVIDIAdeveloper