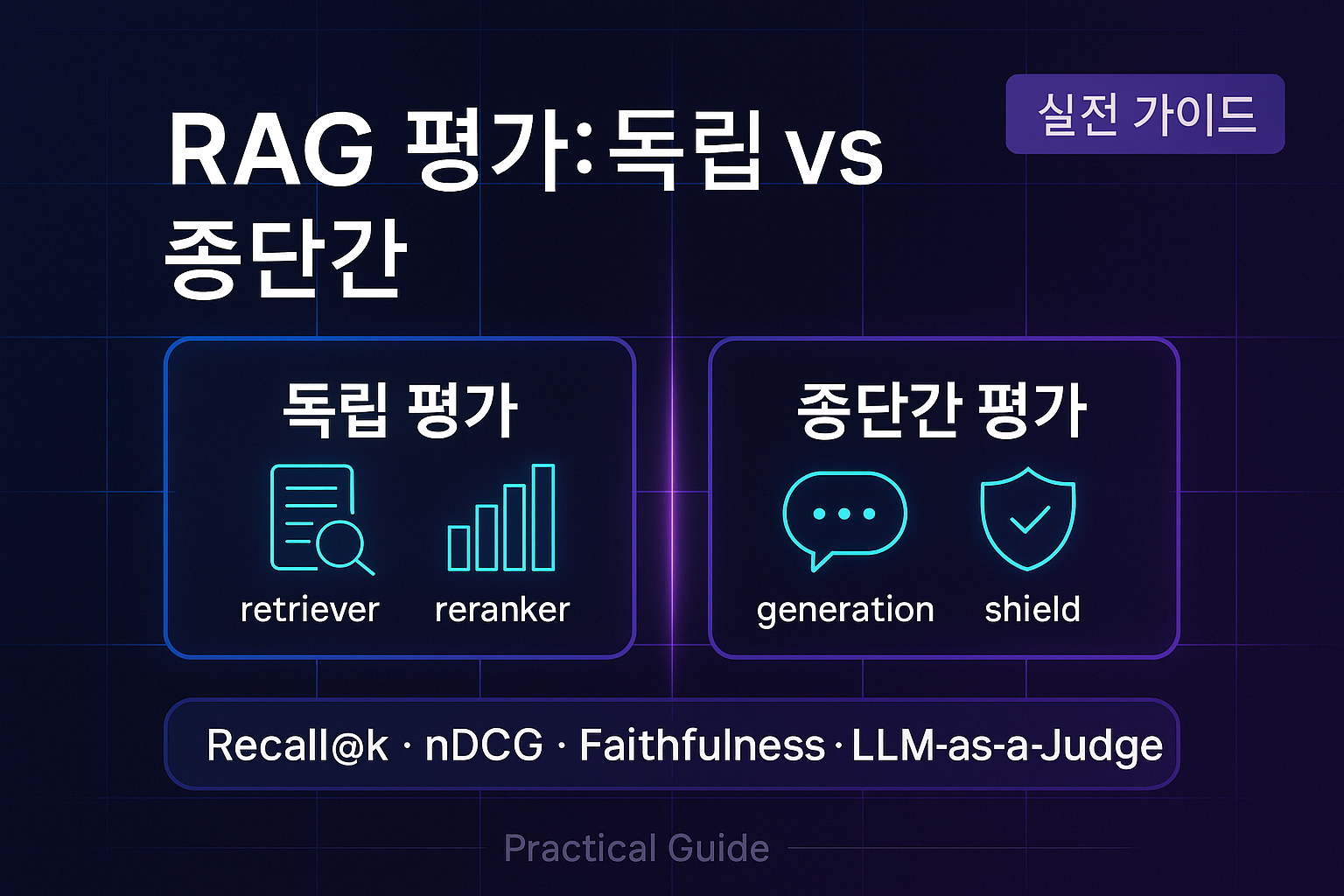

평가 축 2가지:

1. 독립(컴포넌트) 평가—Retrieval·Re-ranking·Generation을 각각 측정

2. 종단간(End-to-End) 평가—질문→최종답변 품질을 한 번에 측정

• 권장 조합: “독립 평가로 병목 파악 → 종단간 평가로 사용자 체감 품질 보증 → 온라인 A/B로 검증”.

독립 평가 vs 종단간 평가

| 구분 | 목적 | 언제 유용한가 | 장점 | 한계/주의 |

|---|---|---|---|---|

| 독립(컴포넌트) 평가 | 각 단계(Retriever, Reranker, Generator, Citation)의 기술적 성능 파악 | 인덱싱/청킹/하이퍼파라미터 튜닝, 모델 교체 전후 비교 | 병목 원인 추적, 재현 쉬움 | 최종 체감 품질과 괴리 가능 |

| 종단간 평가 | 사용자 관점의 최종 답변 품질(정확성·근거·유용성) | 출시 전 품질 게이트, 회귀 테스트, 모델/프롬프트 대체 | 실제 목표와 정렬, 단순한 의사결정 | 원인분석 어려움, 라벨링/심사 비용 |

지표 카탈로그

- Retriever / Reranker (독립 평가)

• Recall@k = (질문 q에 대해 상위 k 결과 중 정답 문서가 포함된 비율) → “필요 문서를 끌어왔는가”

• Precision@k = (상위 k 중 관련 문서 비율) → “노이즈 제거”

• nDCG@k (정답의 순위 가중치 반영), MRR, mAP

• Coverage(정답 근거의 커버율), Redundancy(중복도), Latency p50/p95

실패 유형 매핑: Recall 저하면 k↑/청킹 개선/인덱싱 재생성, Precision 저하면 Reranker/필터링 강화

-

Generation / Citation (독립+종단간 교차)

• Answer Correctness (정답 일치/의미적 유사도)

• Faithfulness / Groundedness (답이 주어진 컨텍스트에 근거하는가; 할루시네이션 방지)

• Citation Precision/Recall (제시한 근거가 실제로 답을 뒷받침하는 정도)

• Conciseness, Toxicity, Style (옵션)

• 비용/지연: tokens, $$, latency p50/p95 -

최종 품질 (종단간)

• EM / Token-F1(QA), Semantic F1(임베딩 유사도 기반), ROUGE/BLEU(요약/서술형)

• LLM-as-a-Judge(루브릭 기반 점수/선호도 비교)

• Human Eval(Likert 1–5: 정확성·근거성·유용성)

• 온라인 지표: 클릭·스크롤·재질문률↓, 수정요청률↓, 채택률↑, 세션당 해결시간↓(TTFR)