오늘 학습 내용

1. 딥러닝의 학습방법

2. 확률론 기초

1. 딥러닝의 학습방법

어제 Day2 에는 비선형이 아닌 선형모델의 학습방법을 공부했었다.

과정을 간략히 말하면, Target Value와 Predict Value 사이의 오차를 구한뒤 이를 최소화 시켜가는 과정을 통해 모델을 학습시키는 것 이며, 이때 사용 되는 방법이 바로 경사하강법이었다.

비선형모델인 신경망(Neural Network)의 경우에도 마찬가지로 경사하강법을 통해 모델을 학습시킨다.

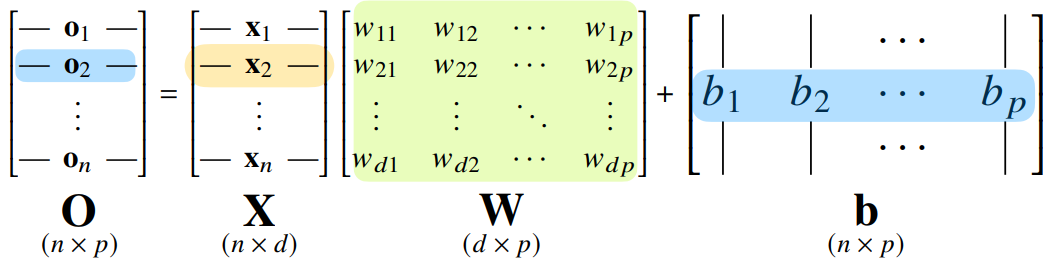

신경망(Neural Network)을 수식으로 나타내면 다음과 같다.

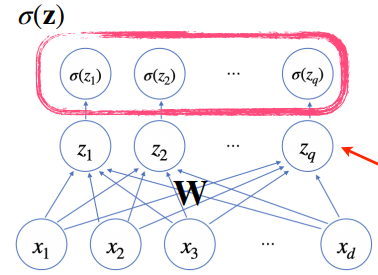

이는 d개의 변수를 통해 p개의 선형모델을 만드는 것으로 생각해 볼 수 있으며, 다음과 같은 그래프로 표현할 수 있다.

그러나, 위의 모델은 선형모델을 가지는 하나의 큰 선형모델일뿐 결코 비선형모델이라고 할 순 없다

따라서, 우리는 위의 선형모델을 비선형모델로 만들기위해 활성함수(Activation Function)이라는 것을 합성해야한다.

활성함수(Activation Function)는 비선형함수로써 각 은닉층의 출력단에 적용하여 새로운 잠재벡터를 만든다.

활성함수의 종류에는 여러가지가 존재하지만, 대표적으로 Sigmoid, tanh, ReLU 함수등이 있다.

그러나, Gradient Vanishing 문제로 인해 현재 ReLu 함수가 가장 많이 사용 되고있다.

역전파(Backpropagiton) 알고리즘

-

신경망의 기본 학습 원리이다.

-

순전파 과정을 통해 모델이 결과를 예측한 후, 출력단으로부터 그레디언트 벡터를 통하여 가중치를 업데이트 해나가는 과정이다.

-

연쇄법칙(Chain-rule) 기반 자동미분(auto-differentiation)을 사용한다.

위 그림은 2개의 레이어로 구성된 신경망에서 첫번째 은닉층의 가중치를 업데이트하는 과정이다.

를 업데이트하기 위하여, 손실함수인 에 대한 의 변화량을 구해야한다.

해당 값은 그림에서 보다시피 연쇄법칙을 적용하여, 각각 의 미분으로 분해가 된다.

위의 수식을 통해 구해진 의 변화량은 선형모델에서의 경사하강법과 마찬가지로 학습률에 해당 값을 곱하고 빼주는 것으로 가중치를 업데이트하게된다.

.

2. 확률론 기초

-

딥러닝은 확률론 기반의 머신러닝 이론에 바탕을 두고있다.

-

Regression에서의 손실함수는 오차의 분산을 최소화 하는 방향으로, Classification에서의 손실함수는 예측 불확실성을 최소화 하는 방향으로 학습한다.

-

확률변수는 데이터공간이 아닌 확률분포에 따라 이산형(discrete)와 연속형(continuous)로 구분된다.

-

이산형(discrete) VS 연속형(continuous)

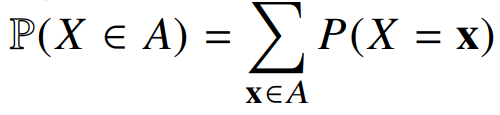

이산형 확률변수의 모델링은 확률변수가 가질 수 있는 모든 경우의 수를 더한다.

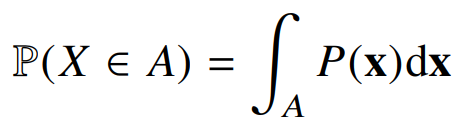

연속형 확률변수의 모델링은 데이터 공간에서 정의된 확률변수 밀도의 적분이다.

이때, 한 지점에서의 밀도는 그 자체로 확률값은 아니다. -

조건부확률 는 입력변수 에 대해 결과값이 일 확률이다.

-

Softmax 또한 입력으로 주어진 값에 대해 해당 결과가 나올 확률을 계산한다.

(Classification에서 해당 카테고리일 확률 계산) -

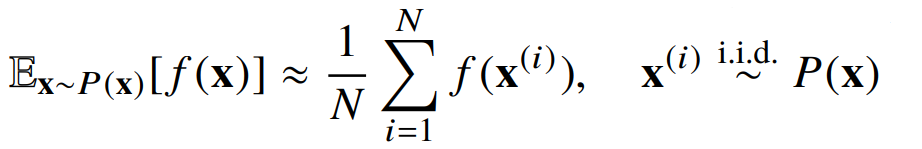

몬테카를로 샘플링은 확률분포를 명시적으로 모를 때 기대값을 계산하기 위해 사용한다.

정확한 값을 계산하는 것이 아닌 근사치를 계산하는 방법이며, 이산형이든 연속형이든 상관없이 성립한다.

독립추출이 보장되기만 한다면 대수의 법칙에 의해 수렴성이 보장된다.

소감

오늘 또한 AI에 있어 중요한 수학적 지식들을 공부하였다. 어제부터 생각했지만, 수학적으로 상당히 부족한 면이 많아 조금더 깊게 공부를 할 필요성을 느끼고있다.그래서, 오늘 부스트캠프 교재란에도 명시되어 있는 이시카와 아키히코 저자의 '인공지능을 위한 수학'이란 책을 주문하였다. 함께 공부를 하고있는 팀원들 또한 필요성을 느껴 같이 구매하였으며, 추후 해당책으로 피어세션 때 스터디를 진행할 예정이다.

하루 공부한 것을 복습하면서 게시물을 포스팅 하는 것만으로도 상당히 벅차지만 기회가 된다면 해당 책의 공부 내용 또한 포스팅 할 수 있도록 하겠다.