[부스트캠프 AI Tech]

1.[부스트캠프 AI Tech] 1주차 Day 1

오늘 학습 내용 1. File System & Terminal 2. Python Overview & Environment 3. Variables, Function, I/O 1. File System & Terminal 파일시스템이란 운영체제(OS)에서 쓰이는 파일

2.[부스트캠프 AI Tech] 1주차 Day 2

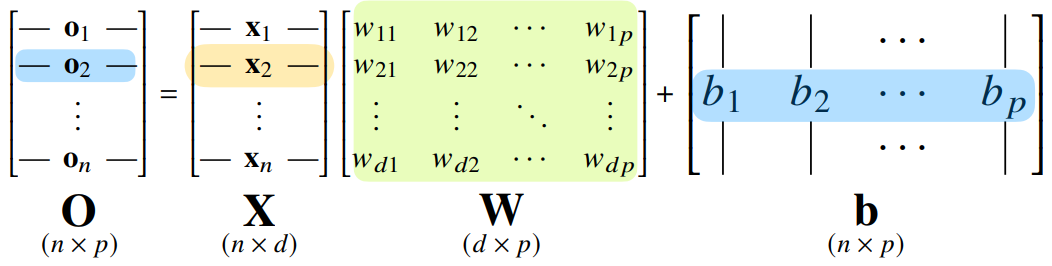

벡터는 숫자를 원소로 가지는 List 또는 Array 이며, 열벡터와 행벡터가 있다.$$X = \\begin{bmatrix}1 \\2 \\3\\end{bmatrix}\\X = \\begin{bmatrix}1&2&3\\end{bmatrix}$$ 파이썬의 Numpy 라이브

3.[부스트캠프 AI Tech] 1주차 Day 3

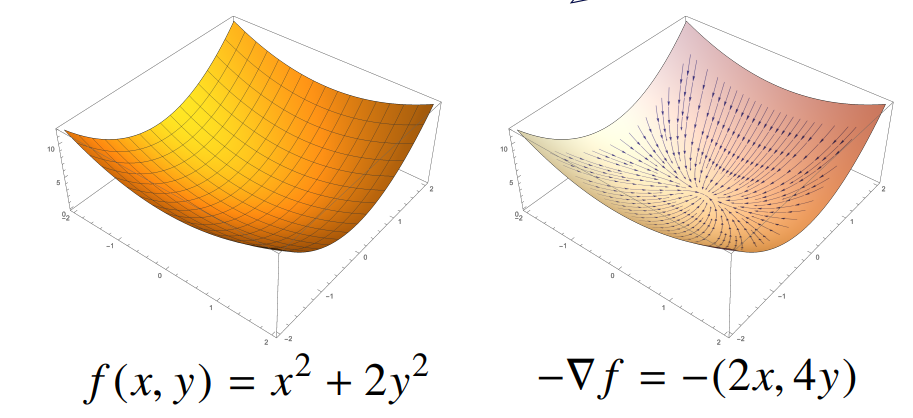

어제 Day2 에는 비선형이 아닌 선형모델의 학습방법을 공부했었다.과정을 간략히 말하면, Target Value와 Predict Value 사이의 오차를 구한뒤 이를 최소화 시켜가는 과정을 통해 모델을 학습시키는 것 이며, 이때 사용 되는 방법이 바로 경사하강법이었다.

4.[부스트캠프 AI Tech] 1주차 Day 4

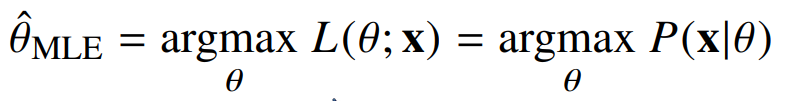

통계적 모델링은 적절한 가정에서 확률분포 추정(Inference) 이 목적이다.유한한 데이터를 이용하여 정확한 분포를 추정하는 것은 불가능 하기 때문에, 근사적으로 추정 할 수 밖에 없다.모수는 특정 모집단의 특성을 나타내는 것으로 모평균, 모분산 등이 이에 해당한다.

5.[부스트캠프 AI Tech] 1주차 Day 5

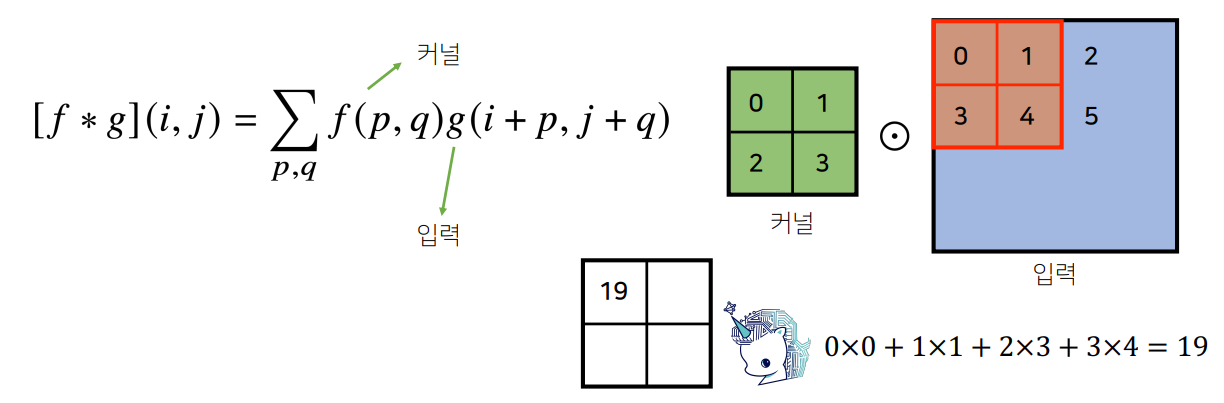

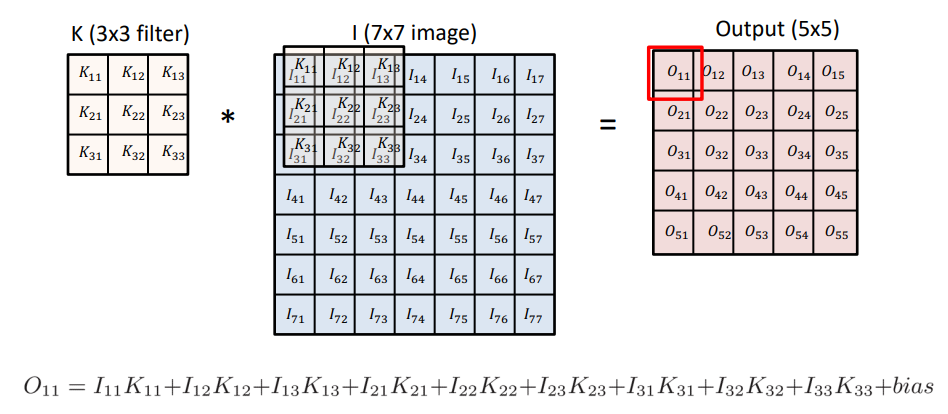

Convolution(합성곱) 연산은 필터(커널)을 입력상에서 움직여가면서 모델과 합성함수에 적용되는 구조이다.Convolution(합성곱) 연산의 수학적 의미는 신호를 증폭 또는 감소시켜 정보를 추출이나 필터링시키는 것이다.2D-Convolution 연산각 벡터의 성

6.[부스트캠프 AI Tech] 2주차 Day 1

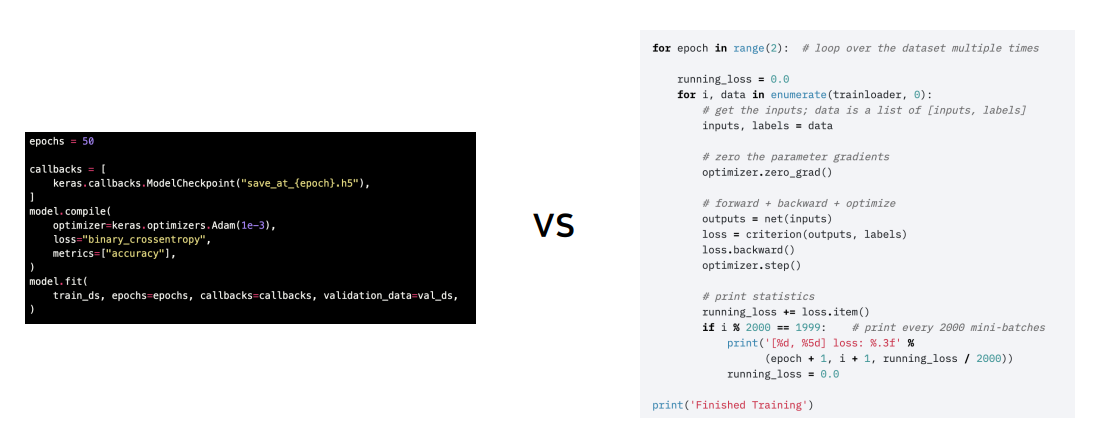

AI 딥러닝 분야에있어 선두적인 라이브러리에는 PyTorch와 TensorFlow 두개가 있다.Keras는 High-Level API 에 해당하며, Warpping 역할의 느낌이다.TensorFlow와 PyTorch는 Keras에 비해 Low-Level이며, 최근 Te

7.[부스트캠프 AI Tech] 2주차 Day 2

오늘 학습 내용 1. PyTorch (AutoGrad & Optimizer) 1. PyTorch (AutoGrad & Optimizer) 딥러닝 모델은 Layer를 겹겹히 반복하여 쌓은 것이다. nn.Module 은 이러한 Layer의 Base Class 이다.

8.[부스트캠프 AI Tech] 2주차 Day 3

오늘 학습 내용 1. Load & Save Model 2. Monitoring tools for PyTorch 1. Load & Save Model 모델 학습에는 많은 시간이 소요되며, 학습 중간에 Weight 등을 저장할 필요가 있다. model.save() 를

9.[부스트캠프 AI Tech] 2주차 Day 4

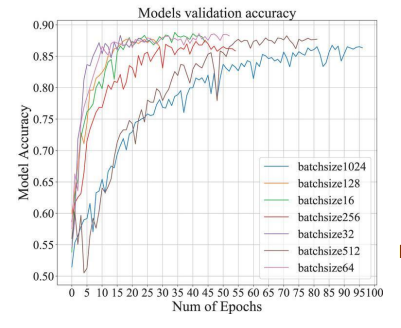

오늘 학습 내용 1. Multi-GPU 학습 2. Hyperparameter Tuning 3. PyTorch Troubleshooting 1. Multi-GPU 학습 Single VS Multi → Sigle은 하나, Multi는 2개 이상을 의미. GPU

10.[부스트캠프 AI Tech] 3주차 Day 1

오늘 학습 내용 1. Visualization(시각화) 2. Bar, Line, Scatter Plot 1. Visualization(시각화) 데이터 * 수치형(Numerical) VS 범주형(Categorical)* 수치형 연속형(Continuous

11.[부스트캠프 AI Tech] 3주차 Day 2

Matplotlib 기반 통계 시각화 Library 이며, 다양한 커스텀 및 쉬운 문법, 깔끔한 디자인이 특징.시각화의 목적과 방법에 따른 API 분류Categorical APIDistribution APIRealational APIRegression APIMultip

12.[부스트캠프 AI Tech] 4주차 Day 2

Convolution(합성곱) 연산은 필터(커널)을 입력상에서 움직여가면서 모델과 합성함수에 적용되는 구조이다.Convolution(합성곱) 연산의 수학적 의미는 신호를 증폭 또는 감소시켜 정보를 추출이나 필터링시키는 것이다.RGB 이미지의 Convolution에서 필

13.[부스트캠프 AI Tech] 4주차 Day 3

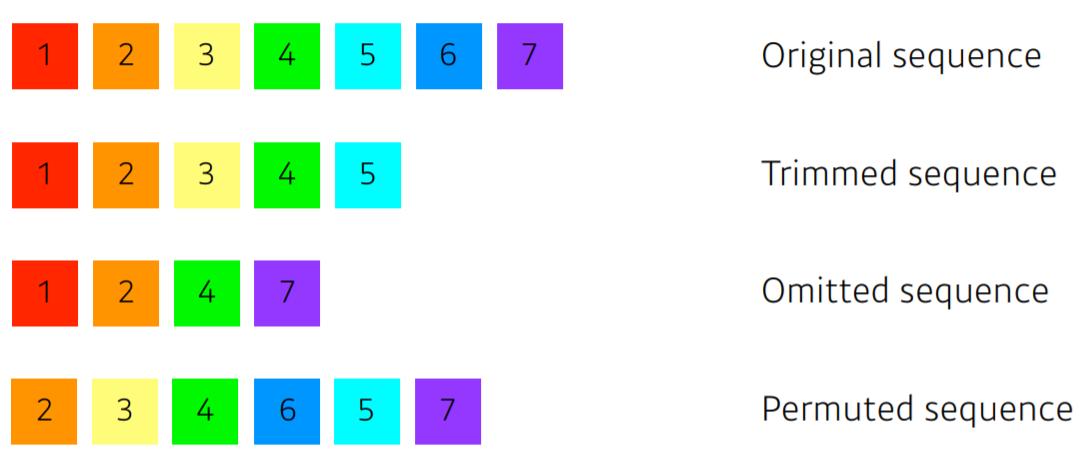

Sequential Data는 아래와 같이 순서의 변형에 취약해 학습시키기 어렵다.Transformer 는 Sequence Data to Sequence Data 의 구조이며, NLP 분야뿐만이 아닌 여러 분야에서 사용이 가능하다.Input 과 Output Data의

14.[부스트캠프 AI Tech] 4주차 Day 4

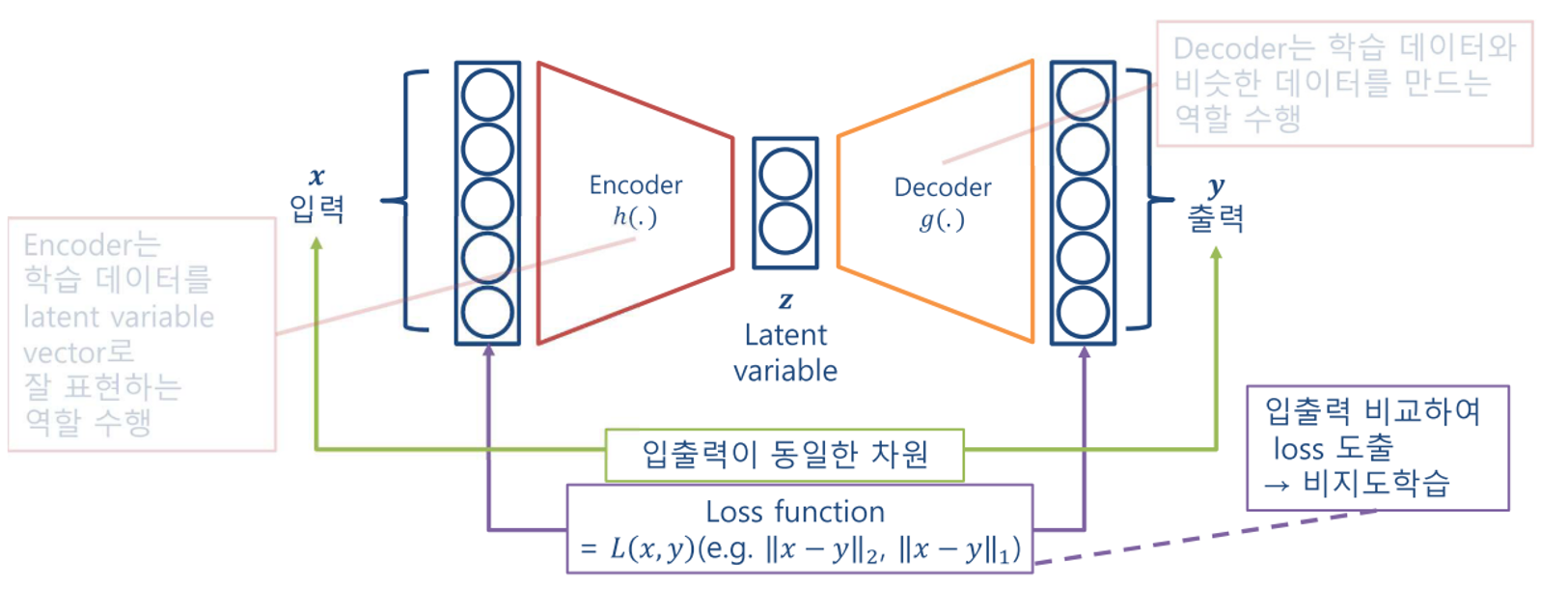

AutoEncoder 는 입력을 낮은 차원의 Latent Vector(잠재벡터)로 변환시킨 뒤 원래 차원으로 복원 시키는 과정을 반복 함으로써 학습하는 방법을 뜻한다.이렇게 하여 학습된 Encoder는 Input Data로 부터 특정한 Feature를 추출 할 수 있다

15.[부스트캠프 AI Tech] 4주차 Day 5

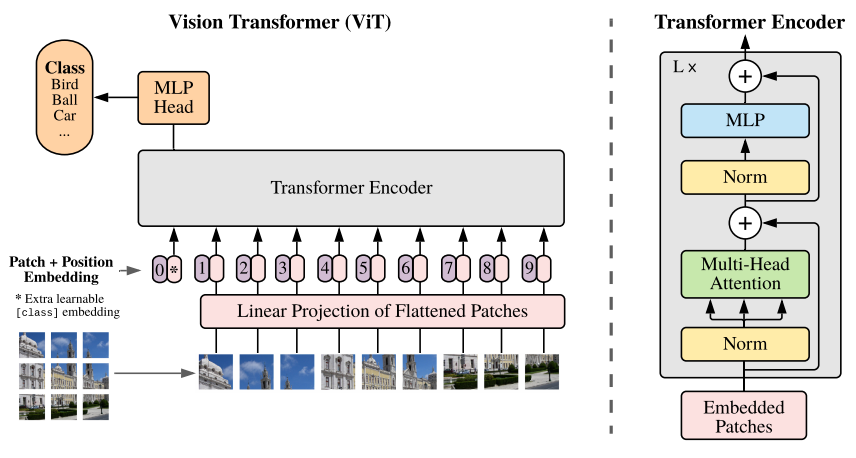

오늘 학습 내용 1. VIT (Vision Transformer) 1. VIT (Vision Transformer) NLP 분야에 있어서 새로운 기준이 되어왔던 Transformer의 Self-Attention을 CV에 적용시키려는 시도에서 시작되었다. 구글에서

16.[부스트캠프 AI Tech] 5주차 Day 1

오늘 학습 내용 1. Linux 2. Shell Command 1. Linux 개인 PC 보다는 서버에서 자주 사용하는 OS 이다. 무료 오픈소스이며, 여러가지 버전이 존재한다. CLI(Command Line Interface)는 Terminal 상에서 작업하

17.[부스트캠프 AI Tech] 5주차 Day 2

오늘 학습 내용 1. Docker 2. MLflow 1. Docker 가상화란 개발을 진행 한 후 배포하는 단계에 있어, 동일한 실행 환경을 보장하기 위해서 사용하는 개념이다. 주로 호스트 머신위에 OS를 포함한 가상화 소프트웨어를 두는 VM(Virtual Ma

18.[부스트캠프 AI Tech] 6주차 Day 2

Model 은 객체, 사람 또는 시스템에 대한 정보의 표현이며, 모형이라고도 부를 수 있다.Pytorch 는 Low-level, Pythonic, Flexibility 의 특징을 가진다.Pytorch의 Model의 모든 Layer는 nn.Module Class를 상속

19.[부스트캠프 AI Tech] 6주차 Warp Up Report -1

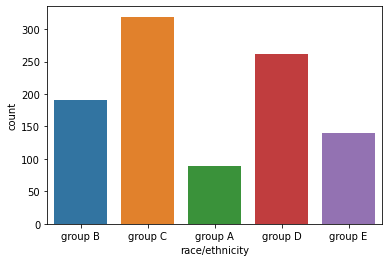

Warp up Report 1. Data Labeling 2. Modeling 1. DataLabeling Data Info Basic Train Data Folder StructureZ Target Train Data Folder Structure Gene

20.[부스트캠프 AI Tech] 7주차 Warp Up Report -2

Private LB Score 0.7270Resnet152, Swin-Transformer, NFnet, Efficientnet 등 여러 가지 모델을 사용 해보았지만, 모델 변경을 통한 성능 향상을 기대하기는 어려웠음적은 Data 때문이라 생각하여, 이후 실험들에서는

21.[부스트캠프 AI Tech] 8주차 Day 1

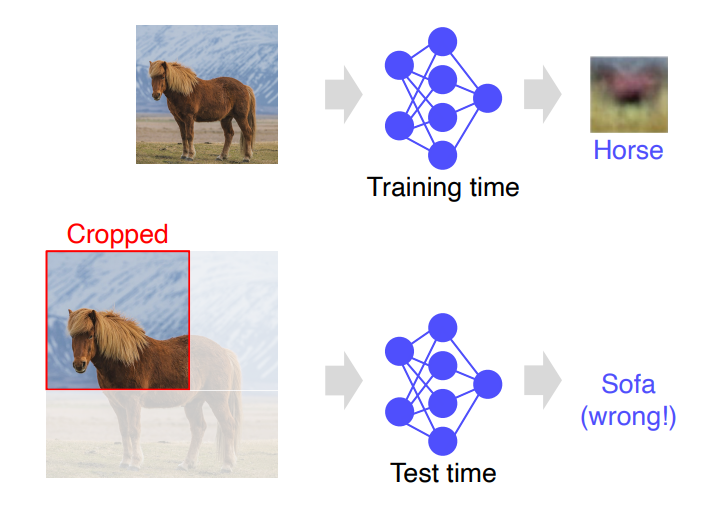

Classifier 는 Image를 하나의 Category 로 Mapping 하는 f() 역할이다.데이터가 존재한다면, 모든 Classificaiton 문제는 K-NN 으로 해결가능하다.→ But, real world의 모든 데이터 저장은 불가능 !Single Full

22.[부스트캠프 AI Tech] 8주차 Day 4

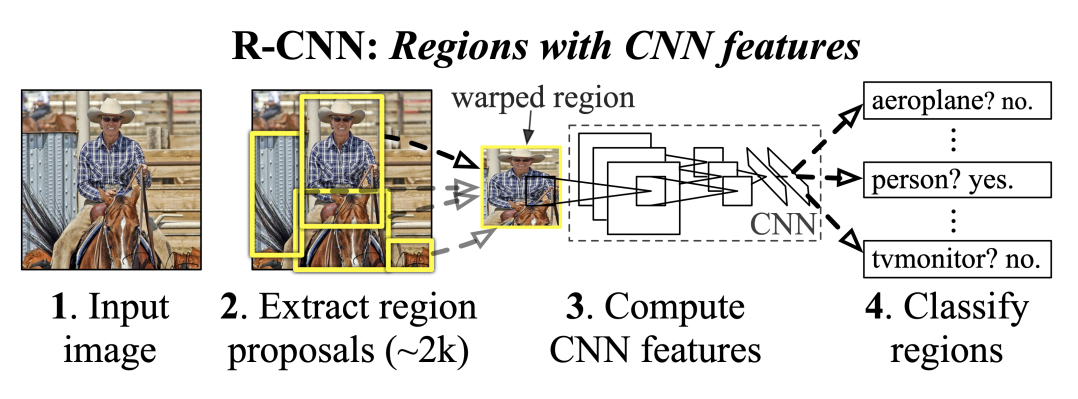

Selective Search 알고리즘은 Segmentation 분야에 주로 사용 되는 알고리즘이다.Over-Segmentation 을 통해 Random 한 bounding box 들을 생성하고, 객체와 주변간의 색감(Color), 질감(Texture) 등의 차이를 통

23.[부스트캠프 AI Tech] 9주차 Day 4

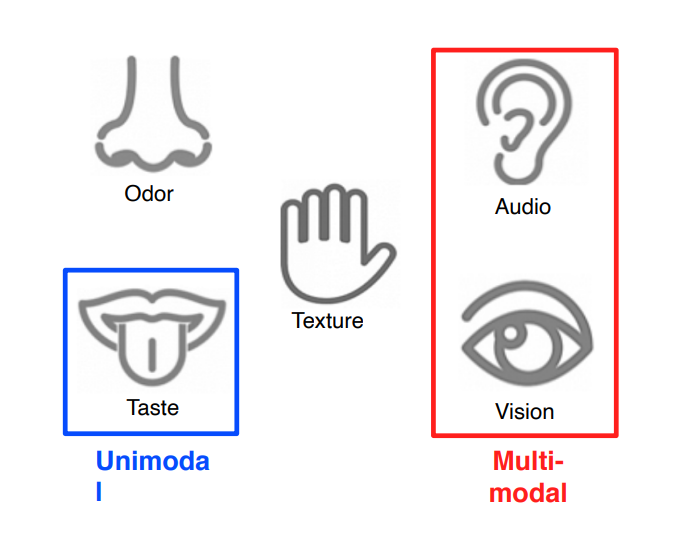

Multi-modal 은 여러 가지 형태와 의미로 컴퓨터와 대화하는 환경을 뜻한다.따라서, Multi-modal Learning 은 다양한 형태의 데이터를 입력 데이터로 사용한다는 의미이다.1\. Different representations between modali