쿨백-라이블러 발산

이 비용 함수는 예측된 확률 분포와 실제 확률 분포 간의 차이를 측정하며, 생성 모델링과 같은 작업에서 일반적으로 사용됩니다.

- 두 확률분포의 차이를 계산하는 데에 사용하는 함수

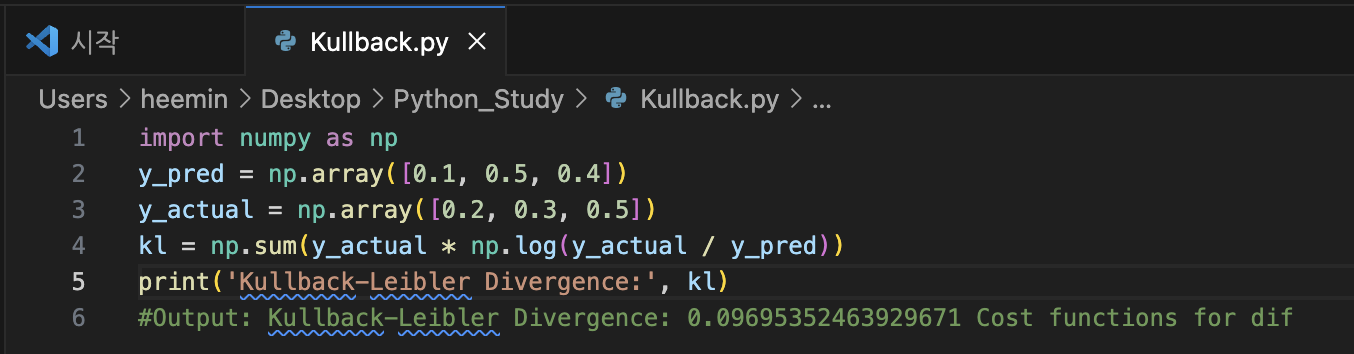

- y_actual : 실제 확률 분포

- y_pred가 예측한 확률 분포

- log(): 자연로그, 확률 분포의 각 항목을 이 함수에 넣어 로그 변환

- y_actual / y_pred: 상대적인 차이 측정

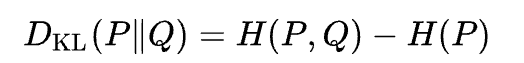

어떤 이상적인 분포에 대하여, 그 분포를 근사하는 다른 분포를 사용하여 샘플링을 한다면 발생할 수 있는 정보 엔트로피 차이를 계산한다. // 상대 엔트로피 (Relative Entropy), 정보 획득량 (Information Gain), 인포메이션 다이버전스 (Information Divergence)라고도 한다.

when to use

- 확률 분포 비교

- 생성 모델링 : 실제 데이터와 유사한 데이터를 생성하려고 함.

when not to use

파이썬 구현

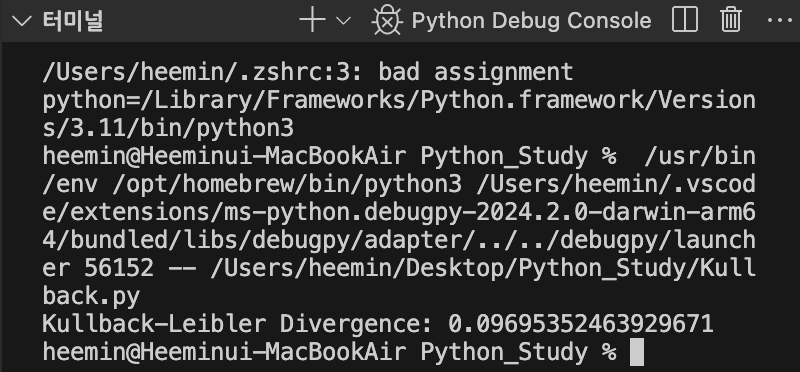

파이썬 구현 결과