DetectGPT: Zero-Shot Machine-Generated Text Detection using Probability Curvature ICML 2023

분야 및 배경지식

- machine-generated text detection

- 거대한 언어모델(=LLM)이 사람에 필적하는 내용을 생성함에 따라, 사람이 작성한 것인지 혹은 모델이 작성한 것인지를 판단하는 문제가 중요해짐

- 별도의 모델을 학습하여 판단 혹은 분류하는 방법

- 학습 데이터를 필요로 할뿐만 아니라 학습 데이터에만 과대적합되어 다른 데이터에 적용 불가할 가능성 존재

- 모델이 생성하는 텍스트에 워터마크를 삽입하는 방법

- 모델이 생성하는 텍스트를 쉽게 감지하도록 변형

- 토큰별 평균 log probability를 사용하는 방법 (zero-shot)

- 학습된 확률함수의 국지적인 구조를 무시 (ignores the local structure of the learned probability function around a candidate passage)

문제점

- 언어모델이 생성한 텍스트와 사람이 작성한 텍스트를 구분할 수 있는 방법 필요

- 과제 등에 악용될 가능성 존재

해결책

DetectGPT

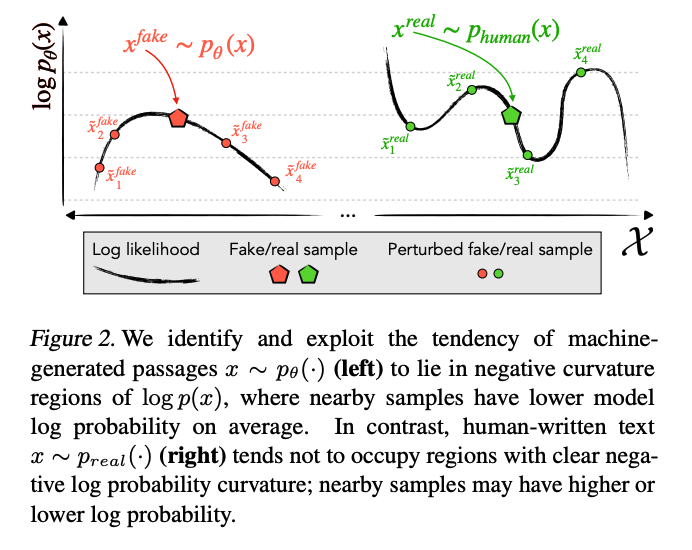

- 원본 텍스트의 log probability와 원본 텍스트에 약간의 변형을 가한(=perturbation) 다른 텍스트 들의 평균 log probability를 비교

- 변형을 가한 텍스트들이 더 낮은 평균 log probability를 보이면 언어모델이 생성한 텍스트일 가능성 높음

- 언어모델이 생성한 텍스트들의 경우 모델의 log probability curvature가 사람이 작성한 텍스트보다 negative

- ... perturbation discrepancy approximates a measure of the local curvature of the log probability function near the candidate passage

- ... proportional to the negative trace of the Hessian of the log probability function

평가

- 데이터셋

- XSum dataset (뉴스)

- Wikipedia paragraphs from SQuAD contexts

- prompted stories from the Reddit WritingPrompts

- English, German of WMT16

- PubMedQA

- 모델

- perturbation을 적용하기 위해 T5-3B, T5-11B, mT5-3B 사용

- GPT-NeoX, GPT-2, GPT-J, GPT-Neo-2.7B, GPT-3, Jusrassic-2 Jumbo로 문장 생성

- 베이스라인

- token log probabilities

- 높은 평균 log probabilities를 가지는 문단이 모델이 생성한 문단일 가능성 높음

- token ranks

- 평균 (로그)순위가 작은 경우 모델이 생성한 문단일 가능성 높음

- predictive entropy

- 엔트로피가 낮은 경우 모델이 예측에 과하게 확신을 가지고 있는 것이기 때문에 모델이 생성할 문단일 가능성 높음

- 많은 경우 예측 엔트로피는 문단의 fakeness와 양의 상관관계를 보임

- token log probabilities

- 평가 지표

- AUROC (area under the receiver operating characteristic curve)

- 분류기가 모델이 생성한 예시에 사람이 작성한 예시보다 더 높은 순위를 정확하게 줄 확률

- AUROC (area under the receiver operating characteristic curve)

한계

- 모델의 log probability를 계산할 수 있다는 white-box 상황 가정

의의

- 별도의 파인튜닝이나 적응(adaptation) 단계 없이 모델 스스로 모델이 생성한 문장을 감지할 수 있는 zero-shot 해결책