강의 링크: https://www.deeplearning.ai/short-courses/chatgpt-prompt-engineering-for-developers/

들어가며

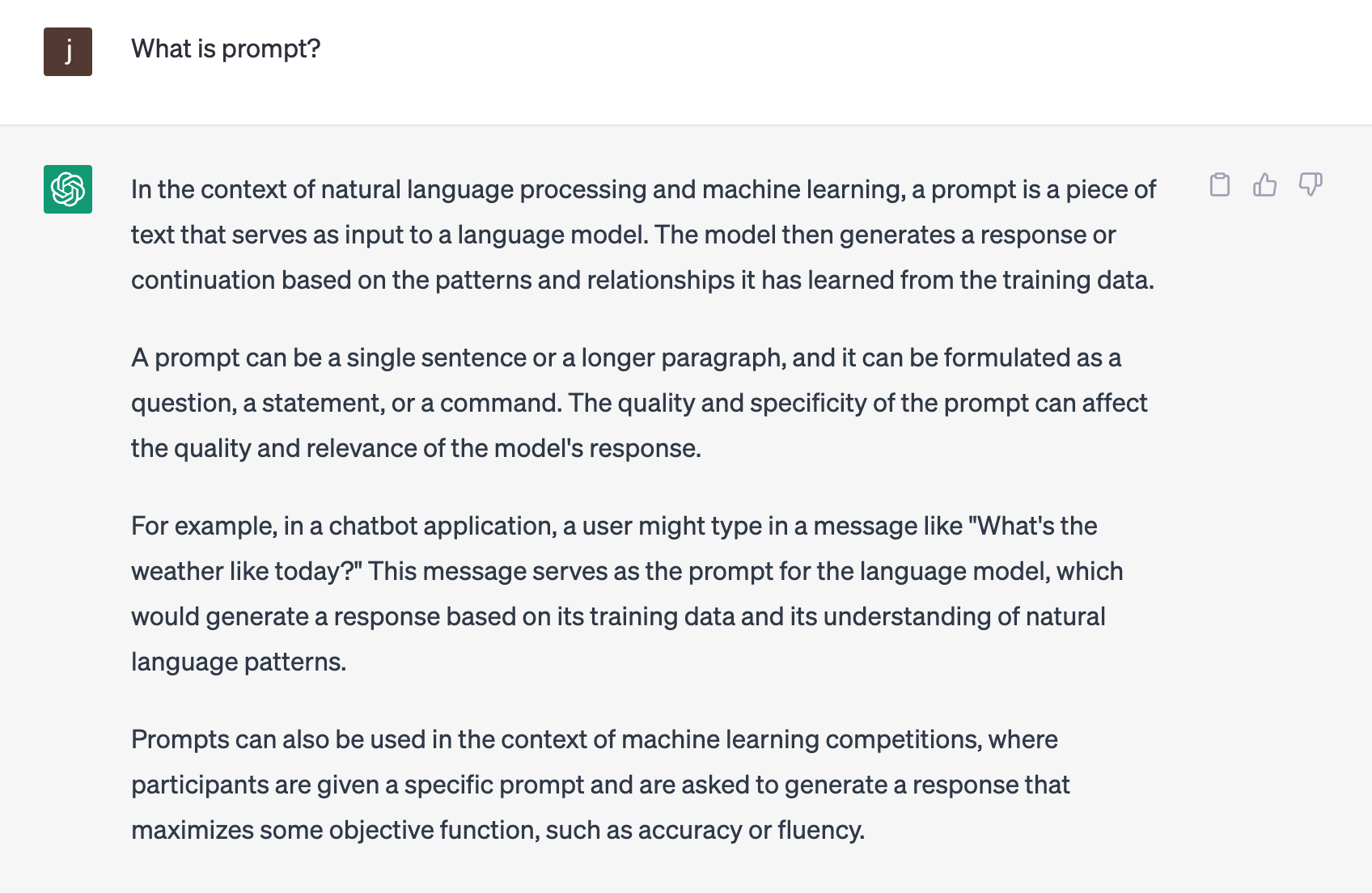

챗GPT의 등장으로 거대한 생성형 언어모델에 대한 관심이 높아진 가운데, 이를 잘 활용하기 위한 프롬프팅에 대한 관심도 높아지고 있다. 프롬프트란 언어모델이 적절한 아웃풋(e.g. 응답)을 낼 수 있도록 하는 인풋(e.g. 질문)인데, 예를 들어 "세종대왕이 맥북 에어를 던진 사건에 대해 설명해줘", "프롬프트가 뭐야?" 등과 같은 질문, 문장, 명령을 모두 아우르는 표현이다.

좋은 프롬프트를 사용해야 언어모델로부터 정확도가 높고 좋은 품질의 답변을 얻을 수 있는데, 아직 어떤 것이 좋은 프롬프트인지에 대한 명확한 규칙은 나오지 않았다. 여러 논문의 결과를 보더라도 사람이 이해할 수 없는 무작위의 단어 나열이 언어모델로부터 좋은 답변을 얻는 경우도 왕왕 존재해서, 좋은 프롬프트를 만들 수 있는 프롬프트 엔지니어링, 프롬프팅이 더욱 각광을 받고 있다.

DeepLearning AI에서는 OpenAI와 협업하여 좋은 프롬프트 엔지니어링에 대한 무료 강의를 공개하였는데 (Beta) 이 포스트는 해당 영어강의의 내용을 요약정리하는 것을 목표로 한다.

Introduction

1강인 introduction(소개)에서는 거대한 언어모델과 기존의 언어모델, 새로이 등장한 설명(instructino) 기반의 언어모델 사이의 차이점을 소개한다.

거대 언어모델 (Large Language Models; LLMs)

최근 등장한 다수의 언어모델은 거대한 규모의 사전학습을 기반으로 한다. 사전학습(pretraining)이란 거대한 규모의 파라미터를 가진 모델로 하여금 대량의 언어 데이터셋을 비지도방식(unsupervised)으로 학습하는 방법을 일컫는데, 학습방식의 예로는 다음 단어를 예측하거나 문장 내 빈 값을 채우는 것 등을 들 수 있다.

기존의 언어모델 (Base LLM)

기존의 언어모델은 위에서 말했던 것처럼, 텍스트 학습 데이터를 기반으로 다음 단어를 예측하는 방식 등을 활용해 학습을 진행하였다. (predicts next word, based on text training data)

하지만 이러한 방식으로 학습한 모델은 "프랑스의 수도가 어디야"와 같은 질문을 마주하였을 때 "프랑스의 가장 큰 도시는 어디야? 프랑스의 인구는 몇이야?"와 같은 응답을 내놓는다.

설명기반의 언어모델 (Instruction tuned LLM)

최근 인기있는 챗GPT와 같은 모델은 기존의 언어모델을 넘어서, 사람의 지시/설명(instruction)을 따르도록 학습되었다. 사람의 설명을 따르도록 파인튜닝되었다고 볼 수 있는데, 이를 위해 사용한 방식이 바로 RLHF(Reinforcement Learning with Human Feedback; 사람의 피드백을 기반으로 한 강화학습)다.

사람에게 도움이 되고(helpful), 정직하고(honest), 해를 끼치지 않는(harmless) 방향을 지향하는 설명 기반의 언어모델은 "프랑스의 수도가 어디야"와 같은 사람의 질문을 마주하였을 때 "프랑스의 수도는 파리"와 같이 더욱 적절한 응답을 내놓게 된다.