확률 공리

- 0≤𝑃[𝐴𝐴]≤1

- 𝑃[Ω] = 1

- 𝑃[𝐴𝐴 ∪ 𝐵𝐵]=𝑃𝑃[𝐴𝐴] + 𝑃𝑃[𝐵𝐵]

랜덤변수

확률을 정의하기 위한 변수

Discreate X

- Probability Mass Function (PMF)

- 반드시 확률은 0보다 클것

- 확률의 합은 반드시 1

Continuous X

- Probability Density Function (PDF)

- 확률은 0보다 크거나 같을 것

- 랜덤변수 x가 A보다 크고 B보다 작을 확률은 적분으로 구할 수 있음

Discrete Distriubution

Bernoulli

두개의 아웃풋을 내는 확률 실험 (0또는1, 동전 뒤집기)

Categorical

강화학습을 확률적으로 모델링하는데 가장 중요한 분포

주사위 던지기 할때, 1-6까지 경우의 수 가능했던 것을 생각해보면,

강화학습에서 현재 상황에서 어디로 갈지 하나를 고르는 문제와 동일

Continuous Distribution

Gaussian

강화학습시 policy를 결정하는데 중요한 역할을 하는 함수

- 평균, 분산의 분포

Uniform

min, max 값이 파라미터로 들어오는 함수

Multivariate Gaussian Distribution

covariance 값에 따라서 모양이 많이 달라진다.

- full

- diagonal

- spherical

In RL

예시

- Frozen Lake example : 현재 상태가 어떠한지, 현재 상태에서 어떤 액션을 취할지 모른다 => 랜덤변수로 정의

-> state와 action은 이산 확률 변수 - Cart Pole example : 현재 막대가 어느정도로 위치해있고, 각도는 어느정도로 틀어져 있는지 모른다. => state 랜덤

액션의 경우 오른쪽으로 갈지, 왼쪽으로 갈지 두개의 액션 존재 => action 이산 (2가지 -> 베르누이) - Pendulum example : 스테이트 : 벡터 연속변수 / 액션 : 스칼라 연속 변수

- 많은 상태, 액션, 보상이 있으나 이 모든 확률을 모아서 (joint) 만드는 것

--

조건부 확률

Random Variable 사이 관계

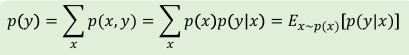

두 확률변수 사이의 관계를 정의하자 : joint 분포

- joint : 두개가 동시에 발생했을때

- marginal : 하나만 일어났을때 확률값

- conditional : 한개의 랜덤변수가 주어졌을때, 다른 하나의 랜덤변수를 결정 가능 => policy 결정하는데 이용

현재 a 상태에 있다고 가정하면 앞으로 어떤 상태로 나아가야 하느냐를 결정하는 것 조건부 확률이자 policy 개념에 해당

independence & Conditional Independence

independence : 𝑋⊥Y

Y가 발생했다고 해서 X에 영향을 미치지 않는다.

n개의 독립변수라면 각각의 합에 의해서 정의

conditional : 𝑋⊥Y | Z

이미 z 확률 변수가 알고있다고 가정했을때, x와 y가 어떻게 만들어지는가

in RL

Policy는 state와 action을 매핑한 함수 => 조건부 확률에 의해 결정

Markov Property : 과거의 상태와 독립적으로 작용하여 미래 결정

State Transition Probability : 다음 상태를 현재상태와 액션에 의해 결정

예시

- Frozen-Lake

-discrete policy : Categorical - Cart Pole

-discrete policy : Categorical - Pendulum

- continuous policy : Gaussian

강화학습의 goal : 끝날때마다 리워드의 합이 달라지고, 언제 끝날지도 모르기 때문에 전체적인 평균이 최대가 되게

조건확률과 베이즈

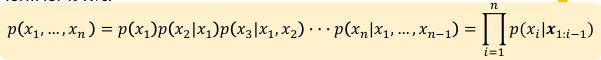

chain-rule

조건부 확률을 n개의 변수에 대한 것으로 확장

상태에서 다음 액션을 하고 다시 상태가 변하고 액션을 하고 ... 체인과 같이 연결

베이즈

이러한 베이즈와 체인룰을 사용해서 조인트에서 conditional, marginal 과의 관계를 정의 가능

conditional expectation

조건에 따라 두가지 유형으로 구분할 수 있다.

- 임의의 값이 주어졌다는 조건 하에

- 하나의 상수로 나온다

- 임의의 랜덤변수가 주어졌다는 조건하에

- 정해지지않아서 그것의 평균을 가져오나 여전히 랜덤변수

가령, 초등학교에 5학년의 키평균을 알고싶다고 가정한다면 값이 오로지 하나 (5학년이라고 특정)

1~6학년 어떤 학년인지 모르나, 그런 경우의 평균은 값이 6개의 값이 가능

후자에 대해서 평균을 다시한번 한다고 생각하면 평균의 평균이 되고, 다음과 같은 식으로 구성

Law of Total Expectation (law of iterated expectation, or Tower property)

E[X] = E[E[X|Y]] 로 표현

다양한 용어 정리

확률 VS 통계

확률 : 현상을 정의하고 어떤 데이터를 예측하고, 생성하는 것

-

데이터가 없지만 확률 모델로부터 예측하거나, 생성할 수 있다는 것

-

데이터를 생성하고, 예측 가능

통계 : DATA를 다루는 것

-

데이터로부터 확률을 추정하거나, 결론을 도출해내는 것

-

데이터에 숨겨진 다양한 특성 (분포)를 꺼낼 수 있음

분포가 갖는 파라미터가 존재한다면

분포로부터 데이터를 만들 수 있으며 (sampling)

sampling methode, generative model (생성형)

데이터가 존재한다면

데이터로부터 분포를 추정할 수 있음 (estimation)

maximum likelihood (ML) estimation method

*큰수의 법칙 : 데이터의 크기가 커질수록 분포에 가까워짐

Monte Carlo (MC) Estimation : 확률과 통계가 만나는 지점

샘플링을 통해서 복잡한 수학적인 값들을 근사화 하겠다.

- 문제 : 주어진 함수의 기댓값은 함수와 pdf의 곱을 적분

만일 주어진 함수가 아주 복잡해진다면 계산이 불가해진다. 그래서 나온 기법 MC

분포를 알면 데이터를 생성할 수 있다. -> 분포에서 N개의 데이터를 샘플링한후 -> 복잡한 주어진 함수에 대입하여 나온값들을 평균하면 실제 평균과 근사해진다. (N이 무한대로 갈때)

Random Process

랜덤변수는 값하나를 할당하는 것

예를 들어, 랜덤변수의 값이 정해지면 그와 매칭되는 하나의 랜덤 확률 P(X=0.4)가 결정되어야함

랜덤프로세스는 랜덤변수의 함수. 변수가 시간/공간에 따라 바뀌는 것 = stocastic process

이는 강화학습에서 상황, 액션, 리워드에 따라 만들어지는 trajectory가 시간에 따라 이어지는 것을 표현하는데 이용되는 개념이다. (이산적인 개념)

시간이 계속 변하나 이를 join해서 하나의 확률로 규정

joint 확률은 시간의 개념을 고려하지않고, 하나의 확률로 규정하는 것인데, 이 시간을 고려하지않는다는걸 지지하는 정리가 markov 이다.

과거의 개념을 잊는다?

이전에 어떻게 움직였든 관계없이 현재 상황에 따라서 액션을 결정하겠다는 것

Stationary Markov Process

시간에 무관하게 값들이 같다.

이 개념은 transiton probability, policy, reward 에 적용