요약

2024/02/07 19:00~22:00 온라인 미팅 (Google Meet)

- 지금까지 작성한 코드를 다시 살펴보고, 개선점을 논의

- 교수님과의 면담을 통해 앞으로 도입해볼 부분, 바꿀 부분을 피드백받음

- 모각소 기간 내에는 전체적인 프로그램의 흐름과, 필요한 기능이 적절히 도입되어 작동하는지의 여부는 확인 가능할 것 같음

의논한 내용

1. Feature Matching의 도입

원래는 real-time으로 동작하는 교통 카메라 등, camera의 motion이 없고 거의 모든 feature와 optical flow가 일정하게 감지되기 때문에 feature matching을 하지 않고도 "어느 정도" feature를 따라가는 것은 가능했다. 하지만 camera의 motion과 object의 motion이 동시에 일어나는 경우, affine이나 homography를 계산해 줄 필요가 있다.

2. 적절한 Motion Model의 도출을 위해서 고려해야 할 것

-

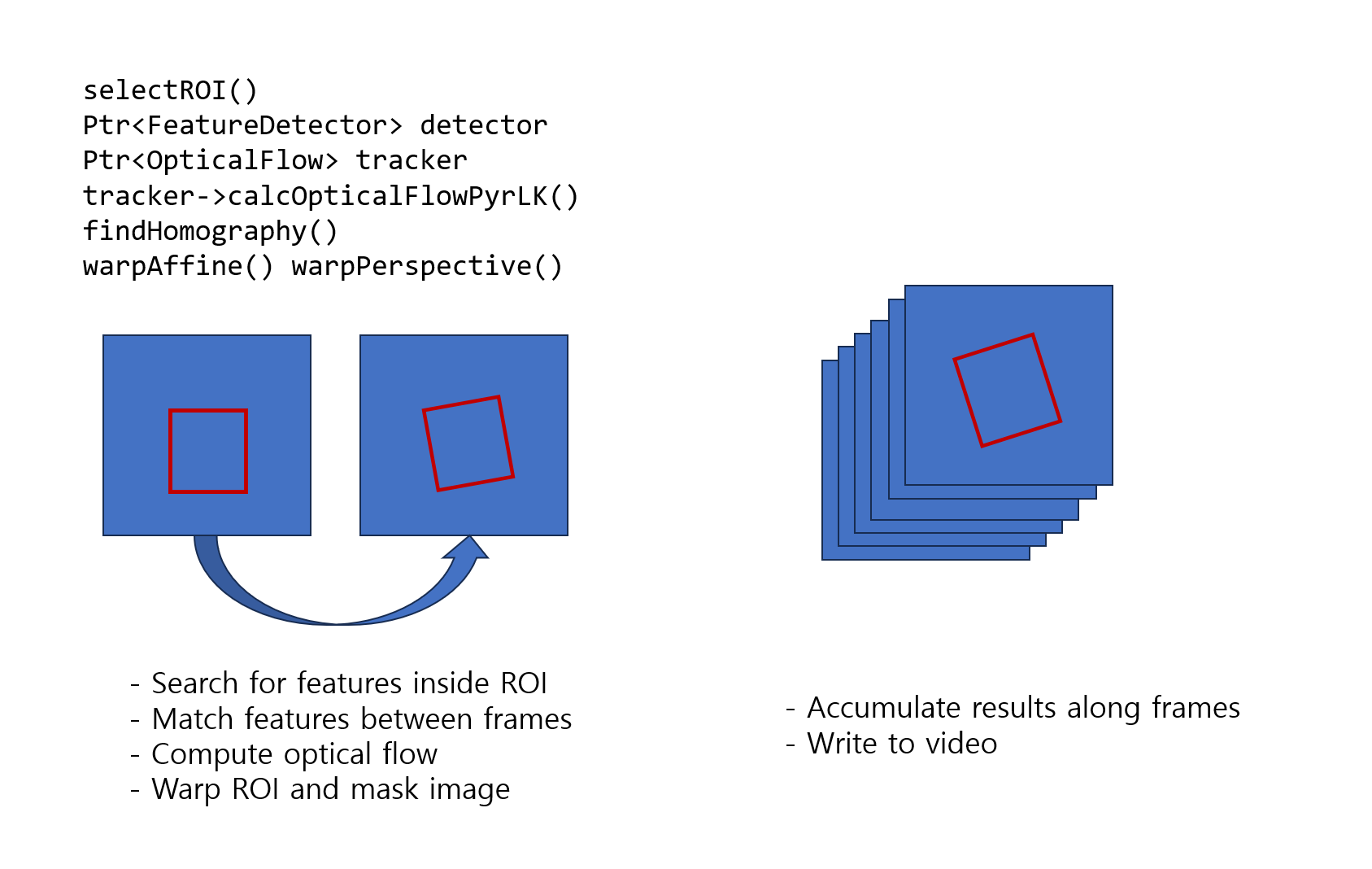

기존과 동일하게, dense motion field를 계산하는 것이 아닌, goodFeaturesToTrack()을 통해 감지한 feature들을 대상으로 calcOpticalFlowPyrLK()를 계산하는 sparse motion field의 방식은 유지한다.

-

다만 motion field로 도출하는 translation만으로는 자유도가 높은 object의 transformation에 대해 대응할 수 있는 motion model에 한계가 있다.

-

sparse motion field를 계산하는 시점에서, 기존에는 feature matching이 도입되지 않았으므로 이를 도입하여 더 정확한 motion field를 도출할 수 있을 것이다.

-

또한 대응되는 feature 사이에서도 더 정확하게 Homography를 계산할 수 있을 것이다. 이전에는 ROI와 mask의 transformation을 분리하지 않았으나, ROI의 transformation과 mask의 transformation을 별도의 단계로 계산하여 조금 더 정확도를 높여보고자 한다.

결론

전체적인 프로그램의 흐름. 계속 수정해봐야 한다.