[ 논문 분석 ] Frequency-domain MLPs are More Effective Learners in Time Series Forecasting(NeurIPS 2023)

[ 논문 분석 ]

✅ 요약 : 기존 MLP 기반 예측은 point-wise mapping 한계(정보 병목)로 성능이 제한됨.

본 논문은 주파수 영역 MLP를 설계해 이를 극복하고, FreTS라는 간단한 아키텍처(채널/시간 두 학습자)로 구현.

13개 벤치마크(단·장기)에서 SOTA/SoTA 수준 성능을 보이며, 파라미터/학습시간에서도 이점을 확인.

1. 서론

문제 정의 및 배경

- 시계열 예측은 기후·교통·에너지 등 산업 전반의 핵심 기술로 오랜 연구가 존재. RNN/Transformer/GNN뿐 아니라 간결한 구조의 MLP 접근도 활발하다. 다만 point-wise 매핑과 정보 병목이 성능을 저해한다.

- 예측 문제 정식화: 길이 L의 입력 창 에서 이 𝜏의 미래 를 예측하는 표준 설정.

연구 목표 및 기여

- 주파수-영역 MLP(FreMLP) 재설계: 복소수 가중치/바이어스로 실·허수 성분을 분리 계산 → 다시 복소수로 합성. 글로벌 관점과 에너지 압축을 이론·시각화로 뒷받침.

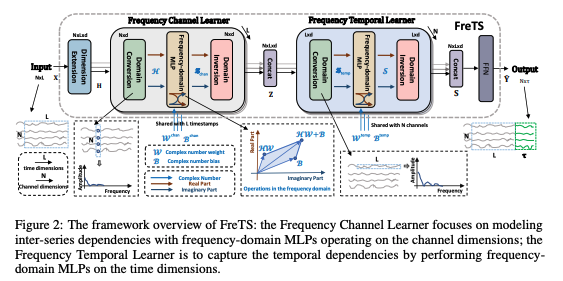

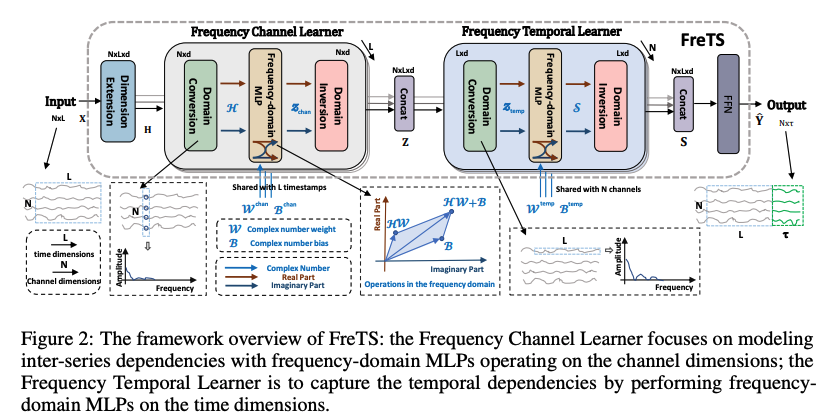

- FreTS 아키텍처 제안: (a) 도메인 변환/역변환(DFT/IDFT), (b) 주파수 채널 학습자(inter-series), (c) 주파수 시간 학습자(intra-series).

- 이론 근거: (i) 에너지 보존(파르세발)—시간/주파수 도메인의 에너지가 동일, (ii) FreMLP 연산 = 시간영역 글로벌 컨볼루션.

- 광범위한 검증: 13개 데이터셋(단기 7, 장기 6)에서 일관된 우수성

2. 관련 연구 정리

-

주파수 도메인 기반 예측: SFM(LSTM 상태를 DFT로 분해), StemGNN(GFT/DFT), Autoformer(FFT 기반 auto-correlation), FEDformer(DFT 기반 주파수 강화 주의), CoST/FiLM(주파수 상호작용/노이즈 제거) 등. 본 연구는 원 아키텍처를 개선하는 수준을 넘어, 채널·시간 의존성을 모두 주파수에서 학습하는 새로운 구조를 제안.

-

MLP 기반 예측: N-BEATS, LightTS, N-HiTS, LTSF-Linear 등 단순 구조의 효율성을 입증. 본 연구의 FreMLP 설계에 영감을 제공

3. 제안 방법론

-

Dimension Extension: 입력 𝑋_𝑡에 학습 가능한 임베딩 를 곱해 획득.

-

Domain Conversion/Inversion: DFT/IDFT로 시간↔주파수 도메인 왕복(실/허수 분리 표기).

-

두 주파수 학습자

- Frequency Channel Learner: 동일한 시간축 가중치 공유로 변수 간 상호작용 학습.

- Frequency Temporal Learner: 동일한 채널축 가중치 공유로 시계열 내부 시간 의존성 학습.

-

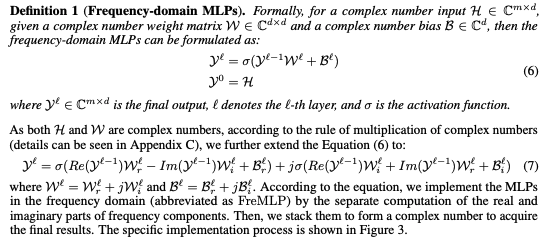

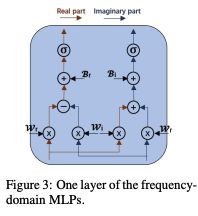

FreMLP = 주파수-영역 MLP: 복소수 가중치/바이어스 로 실/허수 별 연산 후 합성

- 이론 성질

- Theorem 1 (에너지 보존): 시간/주파수 영역 에너지 동일 → 에너지 압축된 소수 성분만으로도 표현 가능.

- Theorem 2 (글로벌 컨볼루션 해석): 𝐻𝑊+𝐵=𝐹(𝐻∗𝑊+𝐵)

→ FreMLP는 시간영역 글로벌 컨볼루션과 동치. - 복잡도/효율: FreTS의 이론 복잡도 O(NlogN+LlogL)

- 이론 성질

4. 실험 설정 및 결과

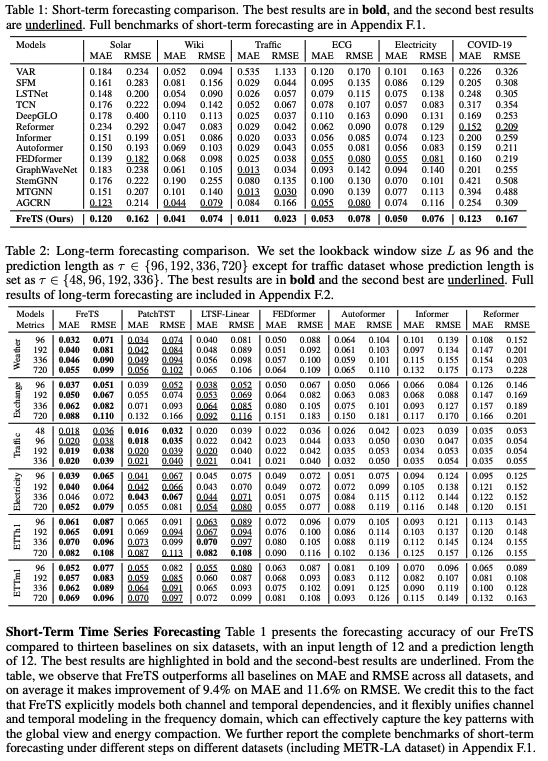

데이터셋: 단기(Solar, Wiki, Traffic, Electricity, ECG, METR-LA, COVID-19), 장기(Weather, Exchange, Traffic, Electricity, ETT). 전처리/분할 비율(7:2:1, COVID-19는 6:2:2).

비교대상: 단기—VAR, LSTNet, TCN, GraphWaveNet, StemGNN, MTGNN, AGCRN 등(+사전 그래프 요구 기법). 장기—Informer/Autoformer/FEDformer/Reformer/LTSF-Linear/PatchTST.

평가지표/세팅: 손실 MSE, 보고 지표 MAE/RMSE, PyTorch 구현/단일 RTX3080 실험.

주요 결과

종합 성능: 표 1·2 결합 결론—FreTS는 단·장기 모두에서 경쟁력/우수성 확인.

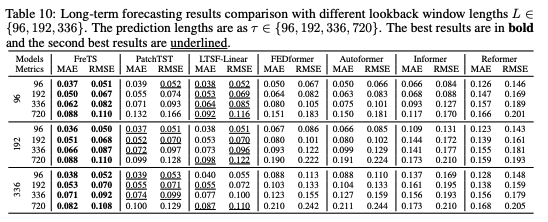

장기·다양한 L에서 견고성: Exchange에서 L∈{96,192,336}, τ∈{96,192,336,720} 전 설정에서 FreTS가 모두 우세. (표 10)

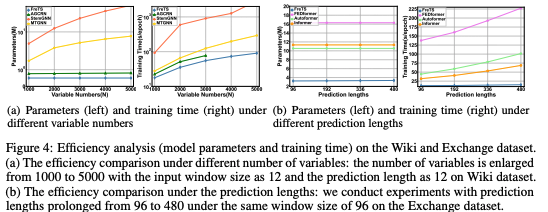

효율성:

변수 수 𝑁 증가 시 파라미터 수 N 무관, AGCRN 대비 파라미터 30%↓, 학습시간 20%↓.

τ 증가 시 Transformer류 대비 파라미터 ≥3배↓, 학습시간 Informer 3배/Autoformer 5배/FEDformer 10배 이상 빠름. (그림 4)

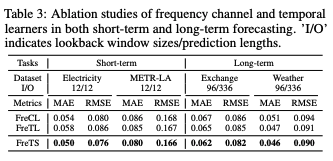

Ablation Study

-

학습자 분리 효과(표 3):

단기: 채널 학습자(FreCL)가 더 중요.

장기: 시간 학습자(FreTL)가 더 효과적이며, 일부 장기 설정에서는 채널 학습자만 쓰면 과적합으로 성능 저하. (E.1)

-

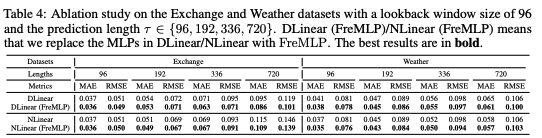

FreMLP 대체 실험(표 4):

DLinear/NLinear의 MLP를 FreMLP로 교체하면 모든 길이에서 개선(Exchange/Weather에서 MAE·RMSE 평균 개선 수치 제시).

5. 결론 및 향후 과제

결론

본 연구는 주파수-영역 MLP 재설계와 FreTS 아키텍처로 시계열 예측에서 성능·효율을 동시에 달성. 글로벌 관점/에너지 압축 특성을 이론적으로 보이고, 다양한 벤치마크에서 우수성을 검증. 시계열에서 간단한 MLP의 잠재력을 재조명했다.

향후 연구 과제

- 불규칙 샘플링·결측/이상치 강건성: DFT 기반 변환의 전제(정규 샘플링)를 완화하는 변형(예: NUDFT/웨이블릿)을 FreMLP에 접목.

- 하이브리드 구조: PatchTST류의 채널 독립 전략과 FreTS의 시간 학습자를 결합해 장기 설정에서의 일반화 향상. (Abla. 논의 반영)

- 온라인·연속 학습: 주파수 스펙트럼의 저차원 에너지 압축을 이용한 경량 적응(Concept Drift 대응).

- 다변량 초대규모 N: 채널 상호작용을 선택적으로 활성화/스파스화하여 확장성 강화.

- 해석 가능성 확대: 실/허수 가중치 시각화(그림 5)를 체계화하여 성분별 기여도/주기성 해석 자동화.