노이즈 추정을 통해 즉각적으로 대응하여 매우 적은 timestep을 통해서도 DDPM을 학습시킬 수 있다.

Abstract

디노이징 스텝을 적게 했을 때도 잘 수행하려면 노이즈 파라미터에 대한 학습 튜닝도 잘 되어 있어야 한다. 때에 맞게 어떤 스텝수가 주어진다 하더라도 그때그때마다 가중치를 변화할 수 있도록 본 논문에서는 노이즈 사용.

더 나아가, 디퓨전 모델의 가중치를 수정하지 않고도 더 적은 스텝 수가 주어졌을 때에도 합성 결과를 향상시킬 수 있도록 한다.

결론적으로, 스텝수는 무시할 수 있을 정도의 실험 결과를 내는 것이 목표.

Method

추론 단계에서 주입되는 노이즈의 양은 모르게 한다.

의 양을 추정하는 네트워크인 를 사용. 추론 단계에서 주입되는 노이즈인 을 가지고 는 노이즈의 수준(noise level)인 를 계산한다.

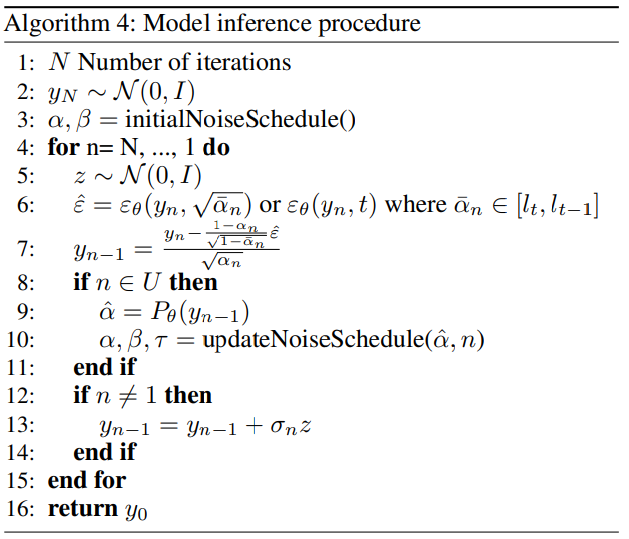

Inference Procedure

위의 과정을 사용. 위 과정에서 포인트는 noise schedule과정을 재수정하는 것이다. 수정은 가 계산한 노이즈 수준인 를 통해 이루어진다.

Experiments

총 3가지의 실험 진행

1. Speech Generation

사용한 모델 : WaveGrad, ConvTASNet( 모델로 사용)

데이터셋 : LJ Speech Dataset

멜스펙토그램 데이터셋으로 훈련시킨다. 추론할 때 timestep은 6단계로 한다. (we performed inference for six iterations with an adjustment of the noise schedule at every step i.e. U = {1, . . . 6}. This noise schedule adjustment uses the Fibonacci method)

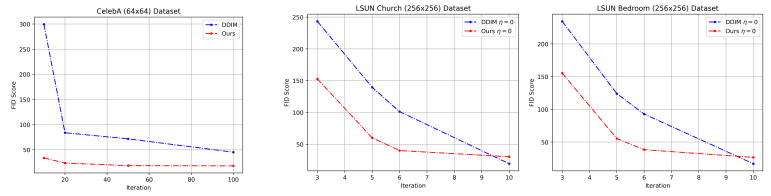

2. Image Generation

사용한 모델 : DDPM, VGG11(모델로 사용)

사용한 데이터셋 : (i) CelebA 64x64, (ii) LSUN Bedroom 256x256, (iii) LSUN Church 256x256

실험결과

Conclusions

매우 적은 스텝으로 디퓨전 생성모델을 학습시킬 때, 합성 과정에서의 스케쥴을 신중하게 선택해야 한다. 위의 논문은 노이즈 파라미터를 즉석에서 수정하고, 프로세스의 후속 상태를 변경한다. 이러한 과정은 를 추정함으로써 이루어진다.