“LLM의 한계를 넘어, 검색으로 강화된 지능형 그래프 만들기.”

LangGraph로 RAG(검색-생성-평가-수정) 루프를 구현한다.

🧩 1. RAG란 무엇인가?

RAG(Retrieval-Augmented Generation)는 검색(Retrieval) 과 생성(Generation) 을 결합한 구조입니다.

단순 LLM은 기억이 제한적이지만, RAG는 외부 지식(예: 문서, DB, 벡터DB)을 검색해 그 결과를 LLM 입력으로 넣어 정확성을 높입니다.

⚙️ 2. LangGraph에서 RAG를 다루는 방식

LangGraph는 기존의 query → retrieval → generation 순차 구조를

그래프 형태로 표현하여 조건 분기, 피드백, 루프 재시도 등을 명시적으로 제어합니다.

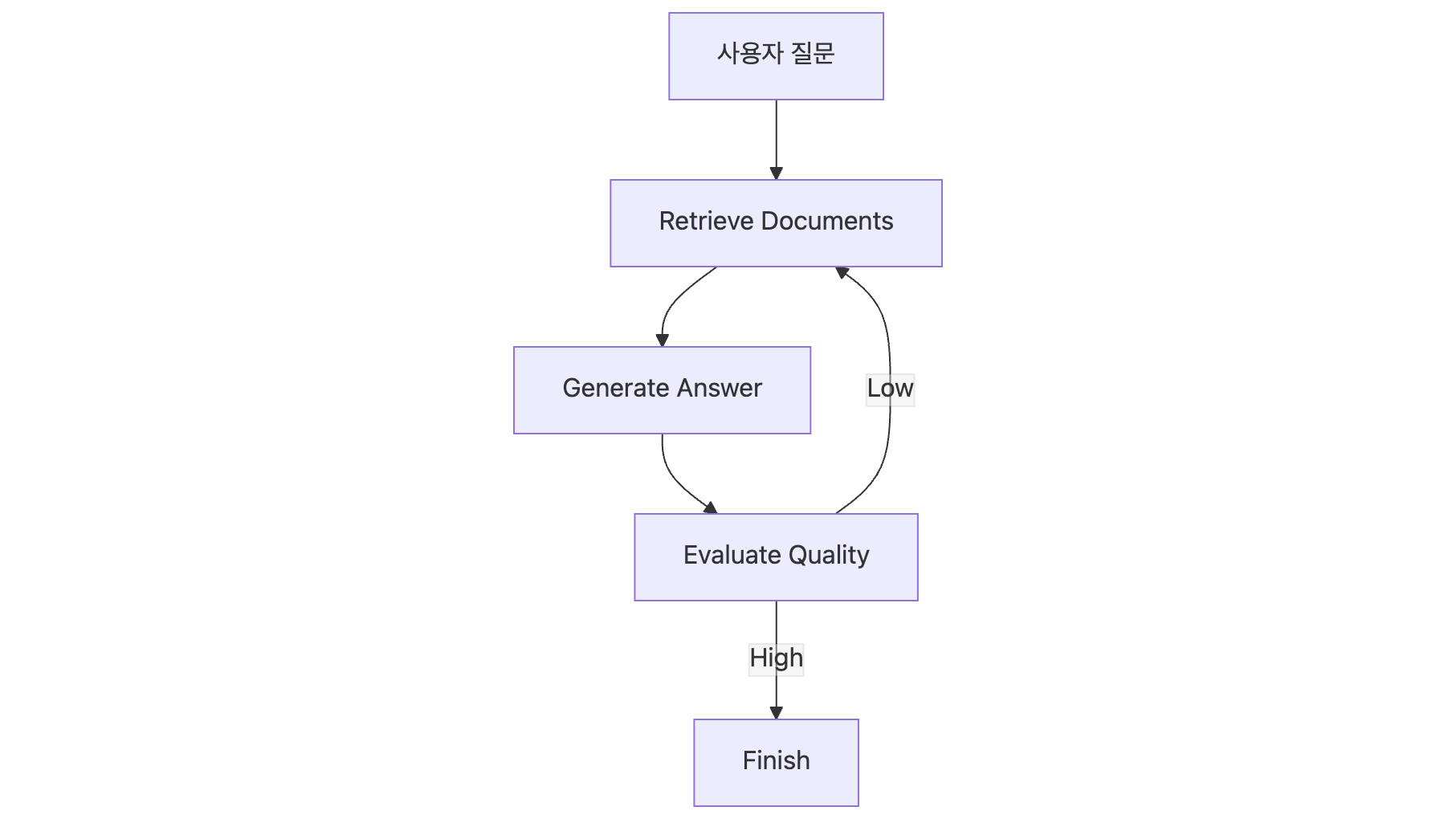

📊 일반적 구조:

이 구조를 그대로 코드로 만들 수 있습니다.

💡 3. 핵심 개념 요약

| 개념 | 역할 | LangGraph 표현 |

|---|---|---|

| Retrieval | 외부 지식 검색 | Node (VectorDB Query) |

| Generation | 검색 결과 기반 응답 생성 | Node (LLM 호출) |

| Evaluation | 응답 품질 평가 | Conditional Edge |

| Correction | 저품질 시 재검색/재생성 | Feedback Loop |

| HITL | Human-in-the-Loop (사람 개입) | SubGraph / Manual Node |

🧠 4. LangGraph로 구현하는 기본 RAG

아래는 “검색 → 생성 → 평가” 3단계 그래프를 구현한 예시입니다.

from langgraph.graph import StateGraph

from langchain_openai import ChatOpenAI

# 상태 정의

class RAGState:

query: str

docs: list[str]

answer: str

score: float

# 검색 노드

def retrieve(state: RAGState):

# 실제로는 VectorDB (예: Pinecone, Chroma) 호출

fake_docs = [

"LangGraph는 LangChain 생태계의 그래프 워크플로우 엔진이다.",

"LangGraph는 노드와 엣지로 LLM 실행 흐름을 제어한다."

]

state.docs = fake_docs

print(f"[Retrieve] {len(fake_docs)}개의 문서 검색됨")

return state

# 생성 노드

def generate(state: RAGState):

llm = ChatOpenAI(model="gpt-4o-mini")

prompt = f"문서 내용:\n{state.docs}\n\n질문: {state.query}\n답변:"

result = llm.invoke(prompt)

state.answer = result.content

print(f"[Generate] 답변 생성 완료")

return state

# 평가 노드

def evaluate(state: RAGState):

llm = ChatOpenAI(model="gpt-4o-mini")

eval_prompt = f"다음 답변의 정확도를 0~1 사이 점수로 평가:\n{state.answer}"

result = llm.invoke(eval_prompt)

try:

state.score = float(result.content.strip())

except:

state.score = 0.7 # 기본값

print(f"[Evaluate] 품질 점수: {state.score}")

return "finish" if state.score >= 0.8 else "retry"

# 그래프 구성

graph = StateGraph(RAGState)

graph.add_node("retrieve", retrieve)

graph.add_node("generate", generate)

graph.add_node("evaluate", evaluate)

graph.add_edge("retrieve", "generate")

graph.add_edge("generate", "evaluate")

graph.add_conditional_edges("evaluate", lambda s: "finish" if s.score >= 0.8 else "retrieve")

graph.set_entry_point("retrieve")

graph.set_finish_point("evaluate")

app = graph.compile()

app.invoke({"query": "LangGraph는 무엇인가?"})🧩 실행 결과 예시:

[Retrieve] 2개의 문서 검색됨

[Generate] 답변 생성 완료

[Evaluate] 품질 점수: 0.85🔁 5. Adaptive / Self / Corrective RAG 구조

LangGraph는 RAG를 단순 실행형에서 지능형 루프형으로 발전시킬 수 있습니다.

| 유형 | 설명 | 그래프 특징 |

|---|---|---|

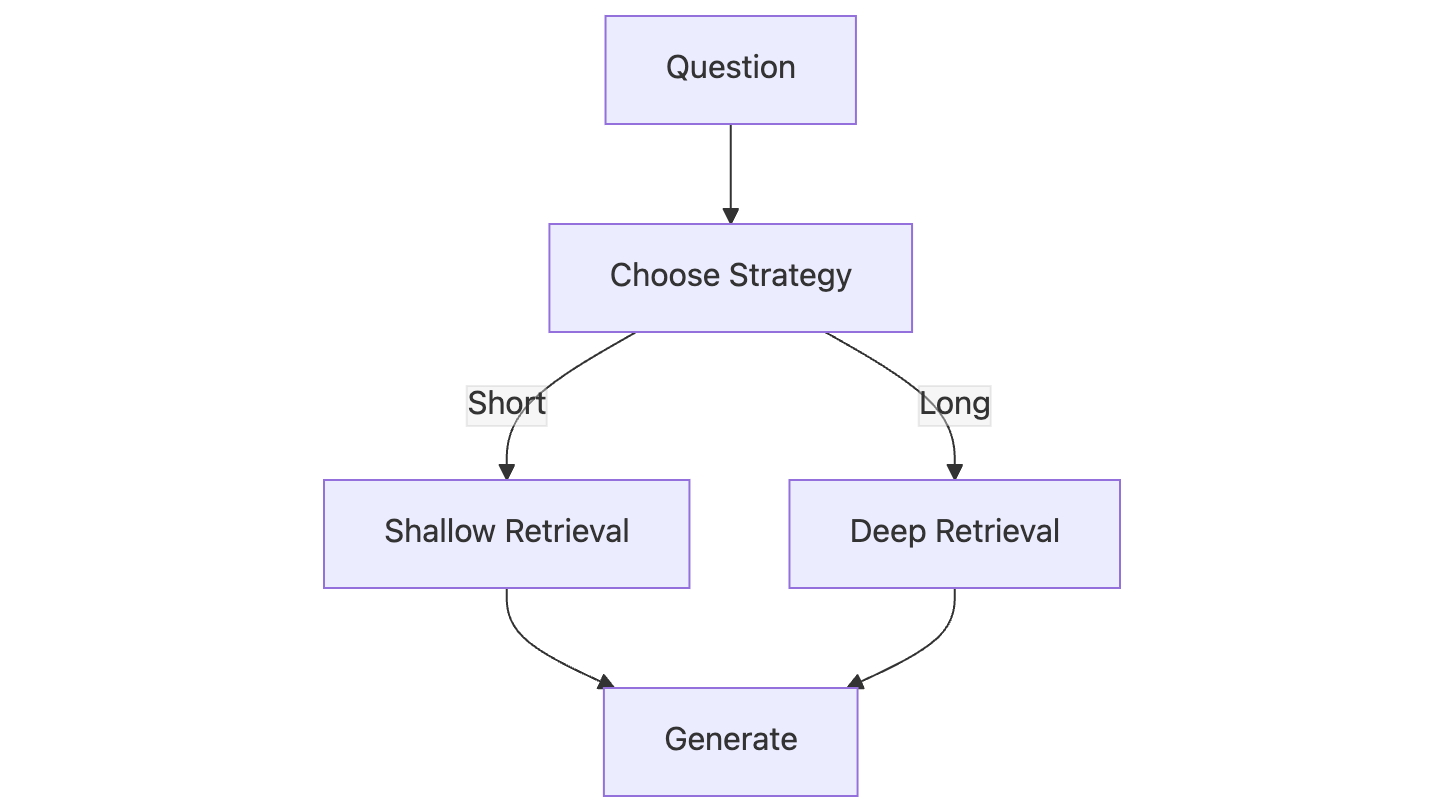

| Adaptive RAG | 질문 난이도에 따라 검색 깊이를 조정 | “질문 길이 or 난이도 기반 조건 분기” |

| Self-RAG | LLM이 스스로 답변 평가 및 수정 | “자체 평가 루프” |

| Corrective RAG | LLM + 사용자 피드백으로 수정 | “HITL + SubGraph 구조” |

🧩 Adaptive RAG 예시 (질문 난이도 기반 검색 깊이)

def choose_strategy(state):

if len(state.query) < 20:

state.depth = "shallow"

else:

state.depth = "deep"

return state

def retrieve_shallow(state): ...

def retrieve_deep(state): ...

graph.add_node("strategy", choose_strategy)

graph.add_node("shallow", retrieve_shallow)

graph.add_node("deep", retrieve_deep)

graph.add_conditional_edges("strategy", lambda s: s.depth)📊 시각화:

🧩 Corrective RAG (피드백 루프 포함)

def human_feedback(state):

feedback = input("답변에 대한 피드백을 입력하세요: ")

state.feedback = feedback

return statehuman_feedback 노드를 그래프에 포함하면 사용자가 루프 중간에 직접 개입(HITL, Human-in-the-loop)할 수 있습니다.

🔍 6. SubGraph로 모듈화하기

LangGraph는 SubGraph 기능을 통해 RAG 전체를 하나의 모듈로 묶어 다른 그래프에서 재사용할 수 있습니다.

from langgraph.graph import SubGraph

rag_module = SubGraph(graph)

main_graph.add_node("RAGPipeline", rag_module)✅ 이렇게 하면 “검색-생성-평가” 단위의 RAG 흐름을 다른 에이전트나 시스템에 그대로 재활용할 수 있습니다.

📈 7. 성능 관리 포인트

대규모 RAG를 운영할 때는 다음을 반드시 고려하세요:

| 포인트 | 설명 |

|---|---|

| 캐싱 (Cache) | 반복 질문에 대한 응답 저장 |

| 비동기 처리 | 검색/생성 동시 실행 (asyncio) |

| 로그 추적 | 각 노드별 latency 기록 |

| 오류 복구 | VectorDB / LLM 호출 실패 시 fallback |

| 병렬 검색 | 여러 소스 동시 query |

LangGraph는 구조적으로 이 모든 제어를 그래프 레벨에서 수행할 수 있습니다.

🧭 8. 다음 회차 예고

👉 7편: LangGraph + UI 통합 (Gradio, Streamlit)

여기서는 지금 만든 RAG 그래프를 시각화하고 조작 가능한 인터페이스로 연결합니다.

사용자가 직접 입력하고 결과를 실시간 확인할 수 있는 LangGraph 대시보드형 환경을 만들어봅니다.

🎓 9. 더 깊이 배우기 위한 고급 확장 학습 가이드

| 주제 | 학습 이유 | 추천 학습 방향 |

|---|---|---|

| VectorDB 최적화 | 검색 속도와 정확도 향상 | Pinecone, Chroma, FAISS 인덱싱 실습 |

| Evaluation Loop 설계 | Self-RAG 구현 핵심 | 모델 평가/스코어링 루프 |

| SubGraph 모듈화 | 대형 그래프 유지보수 효율성 | Graph Composition, Nested Graph |

| LangGraph HITL 설계 | 인간 개입형 평가 시스템 | Human-in-the-Loop workflow |

| LangGraph + LangServe 배포 | RAG 시스템 API화 | LangServe or FastAPI endpoint |

| RAG 성능 지표 설계 | 품질 관리 | Recall@k, F1, Faithfulness metric |

📚 핵심 요약

- LangGraph는 RAG의 검색-생성-평가 루프를 그래프 단위로 제어할 수 있다.

- Adaptive / Self / Corrective RAG로 확장하면 LLM이 스스로 평가·수정할 수 있다.

- SubGraph, Feedback, HITL로 실전 수준의 RAG 파이프라인 설계가 가능하다.

💡 RAG는 단순한 보조 기능이 아니라, LangGraph에서 “지능형 루프의 핵심”이다.