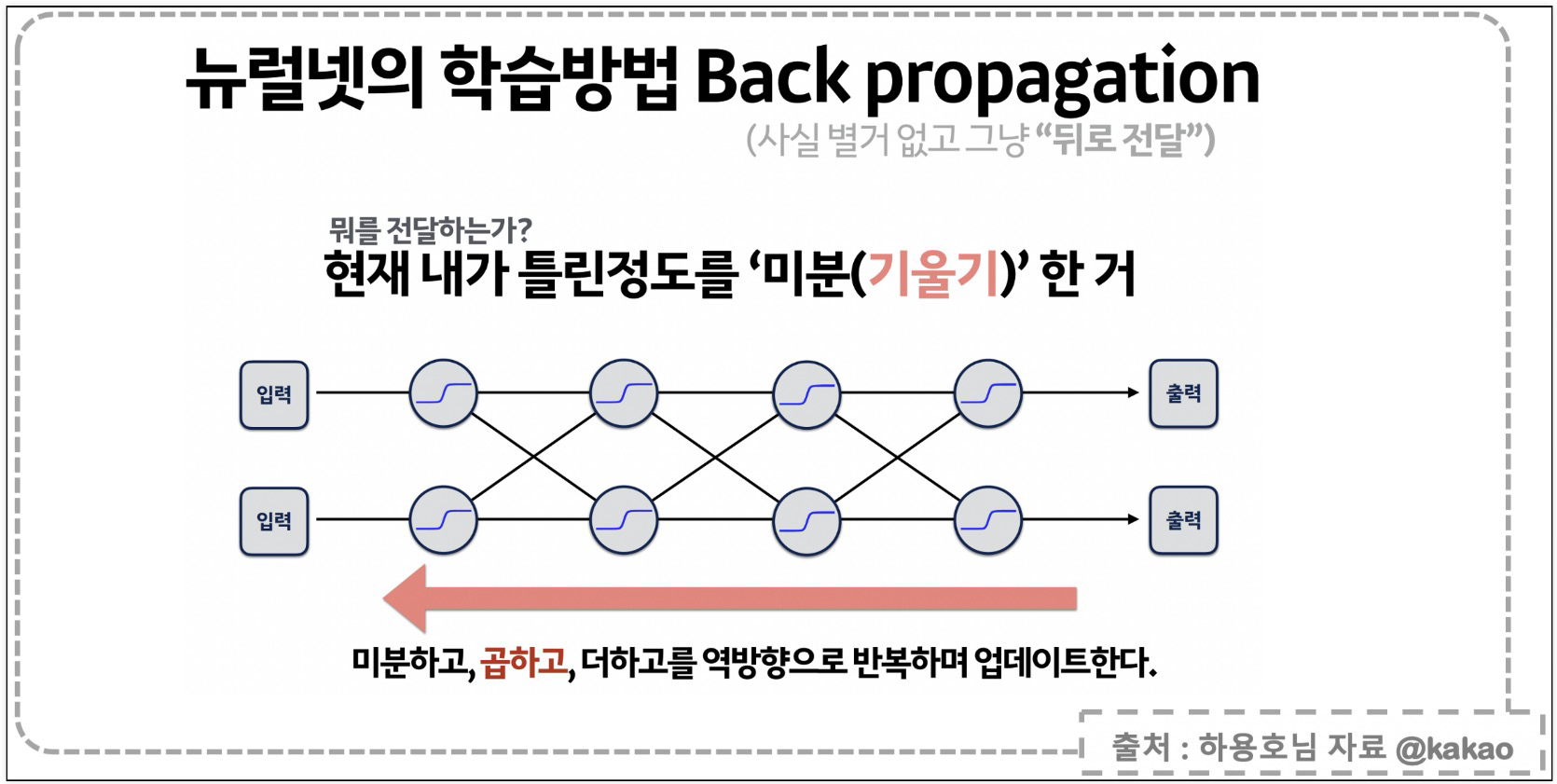

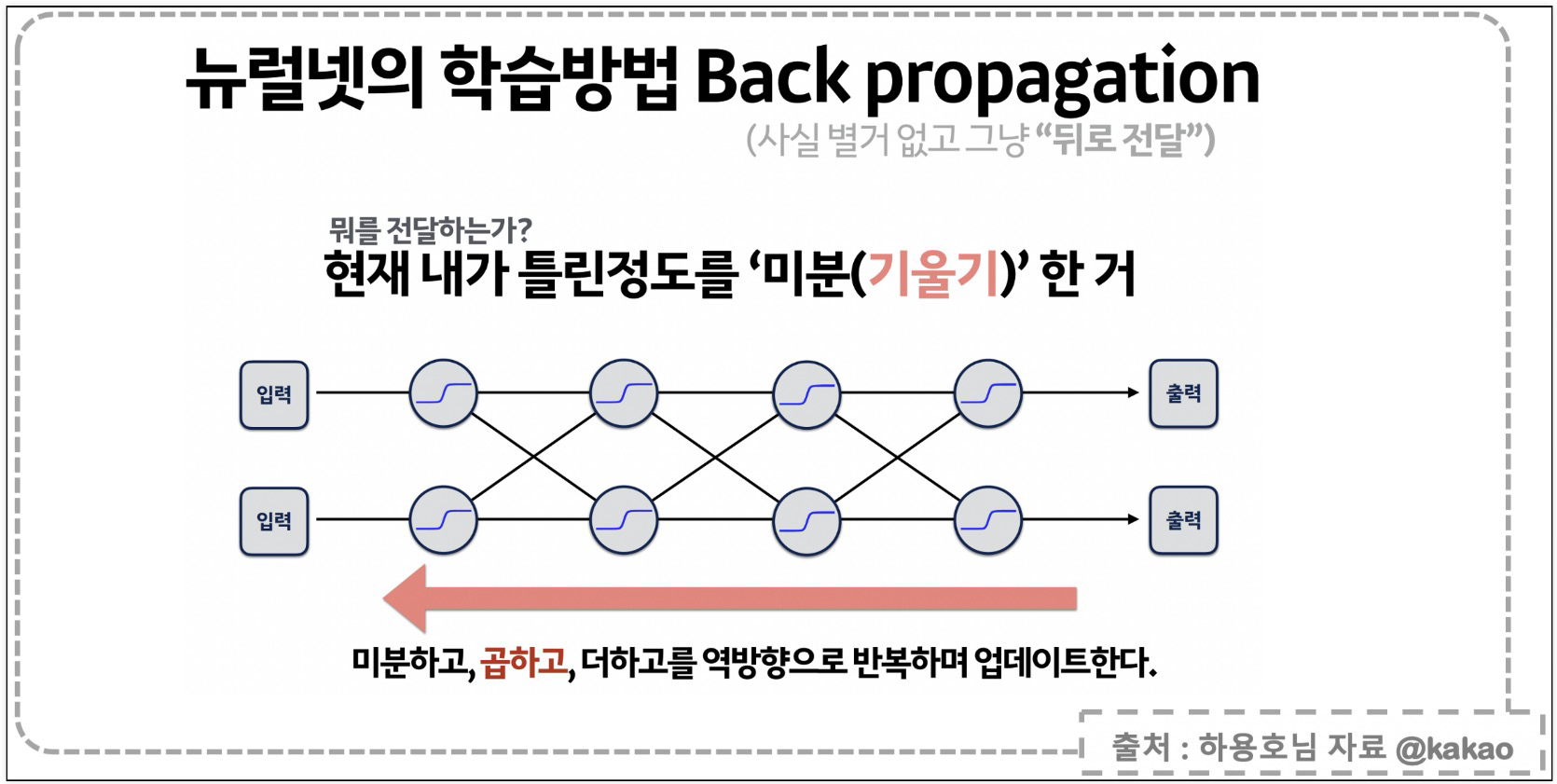

역전파 back-propagation

- 오차를 뒤로 전달해서 사이에서 알 수 없었던 오차 값을 주는 것

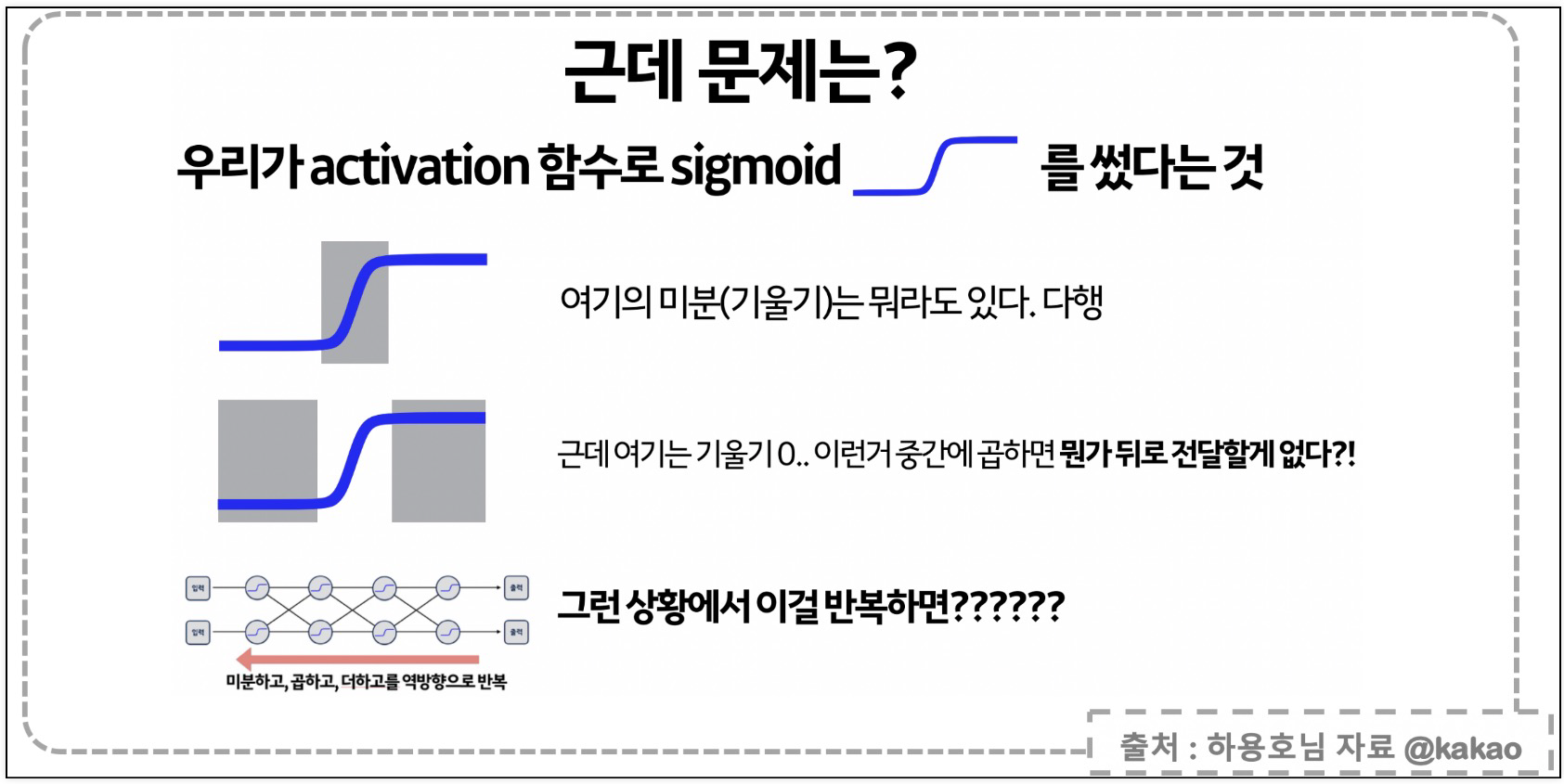

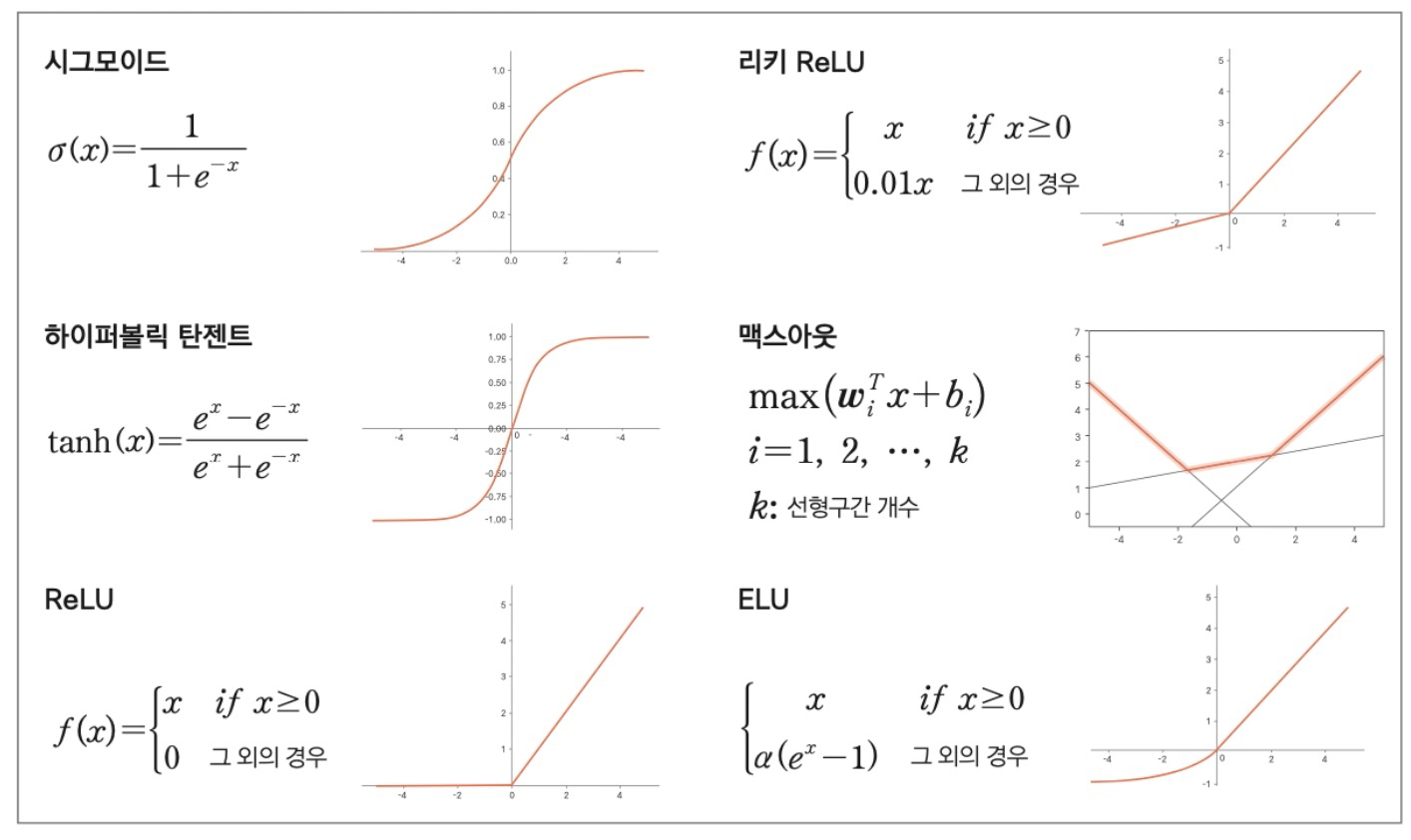

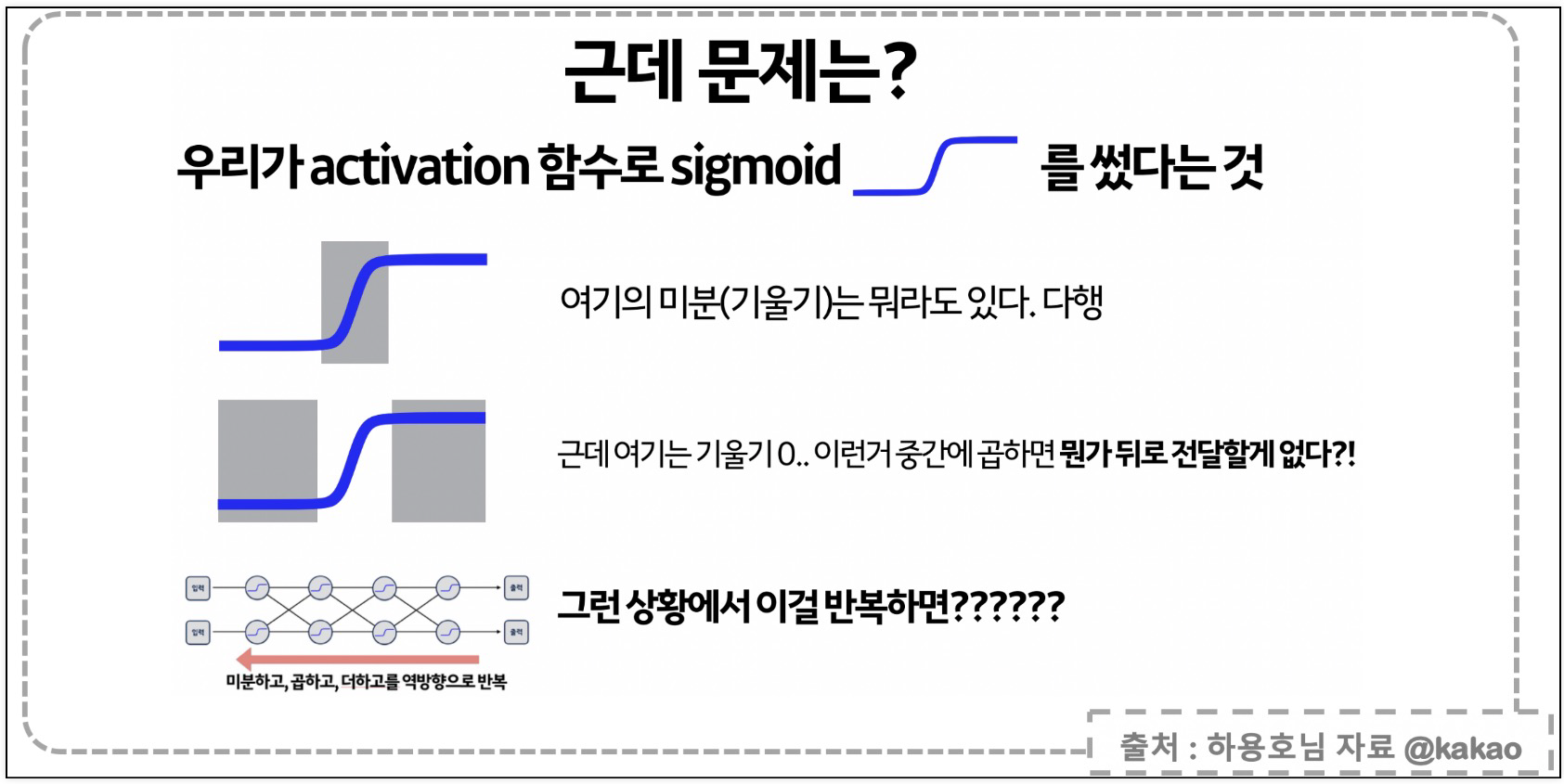

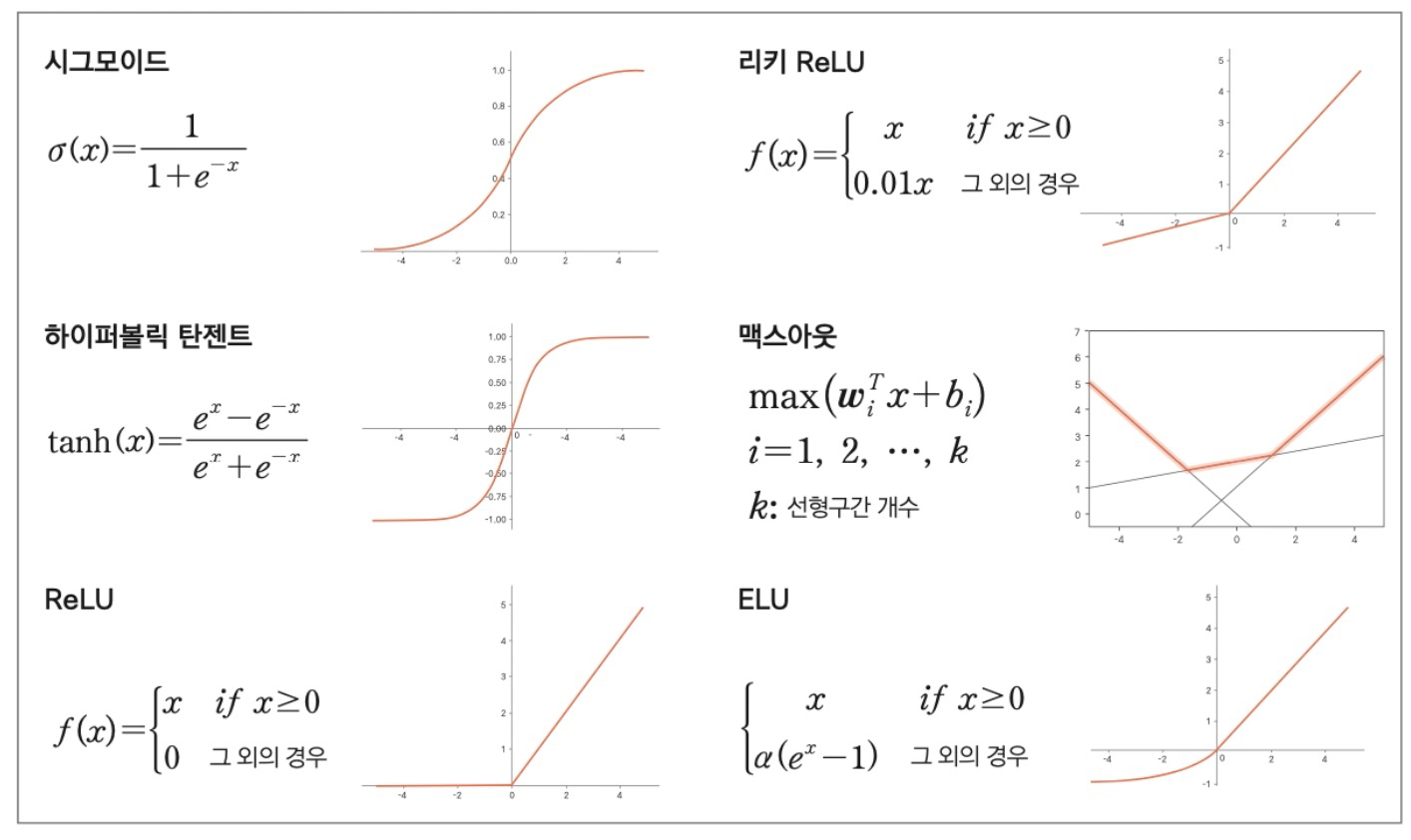

1. 역전파에서 sigmoid 문제가 존재

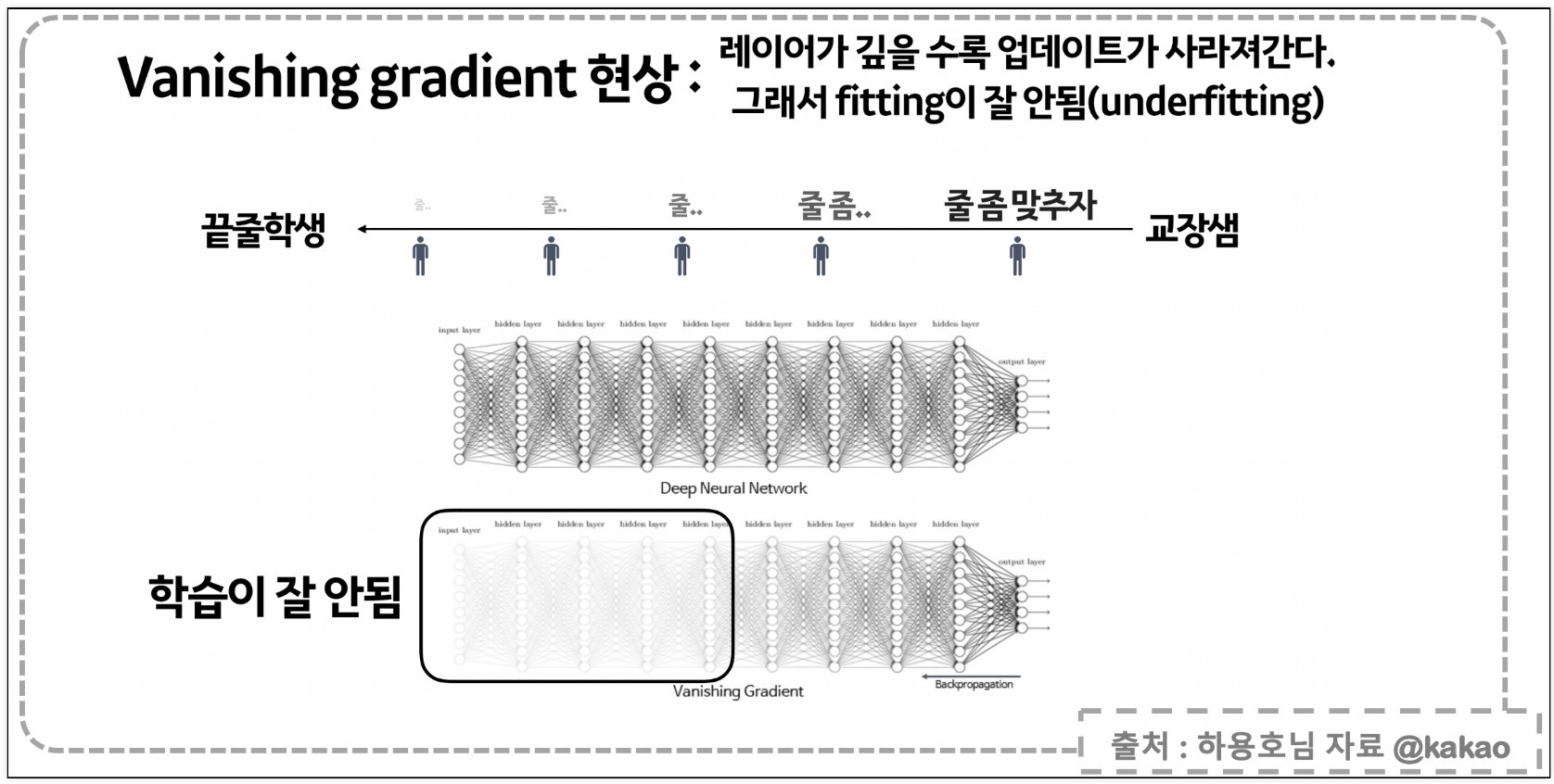

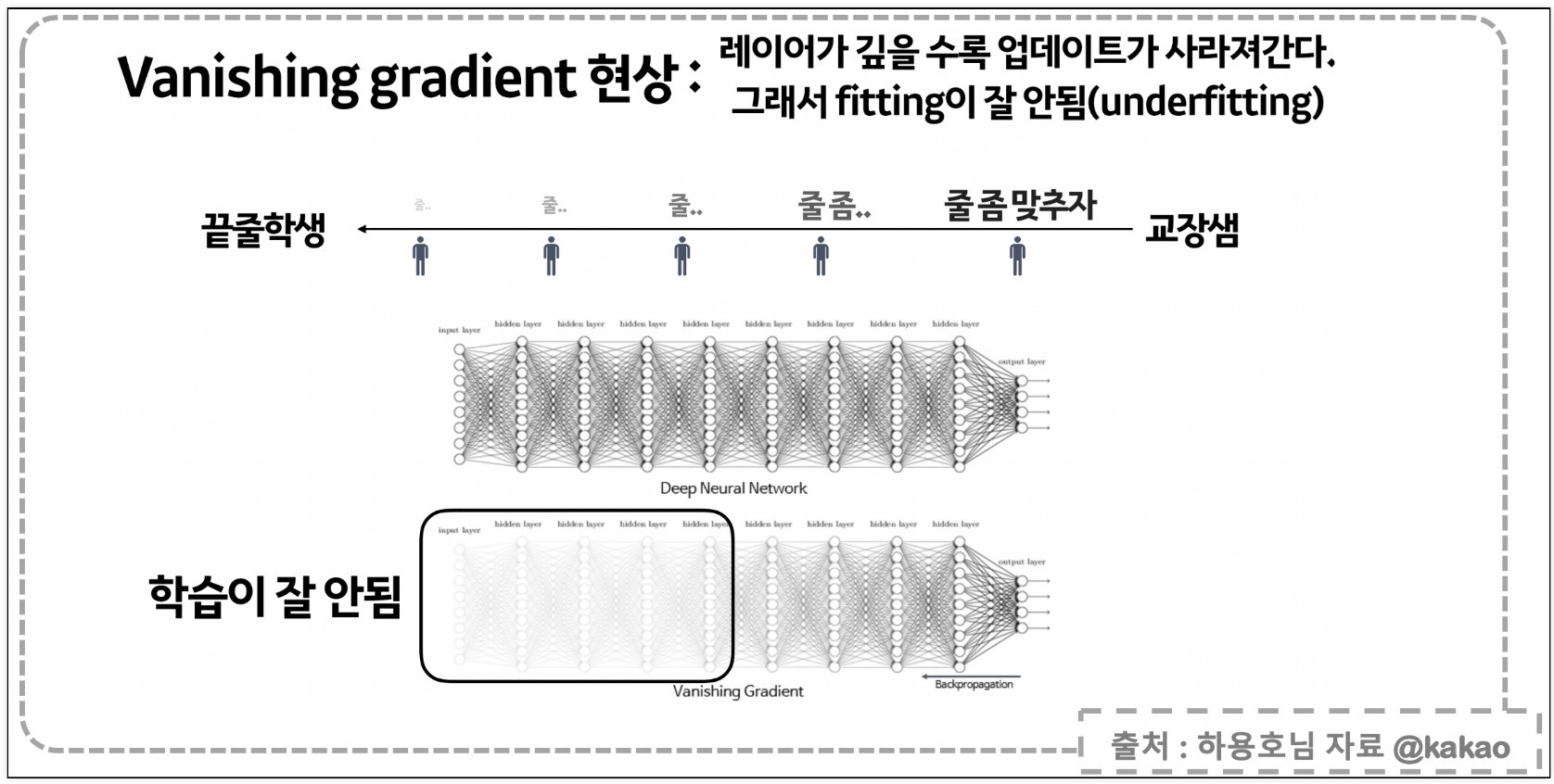

2. gradient vanishing

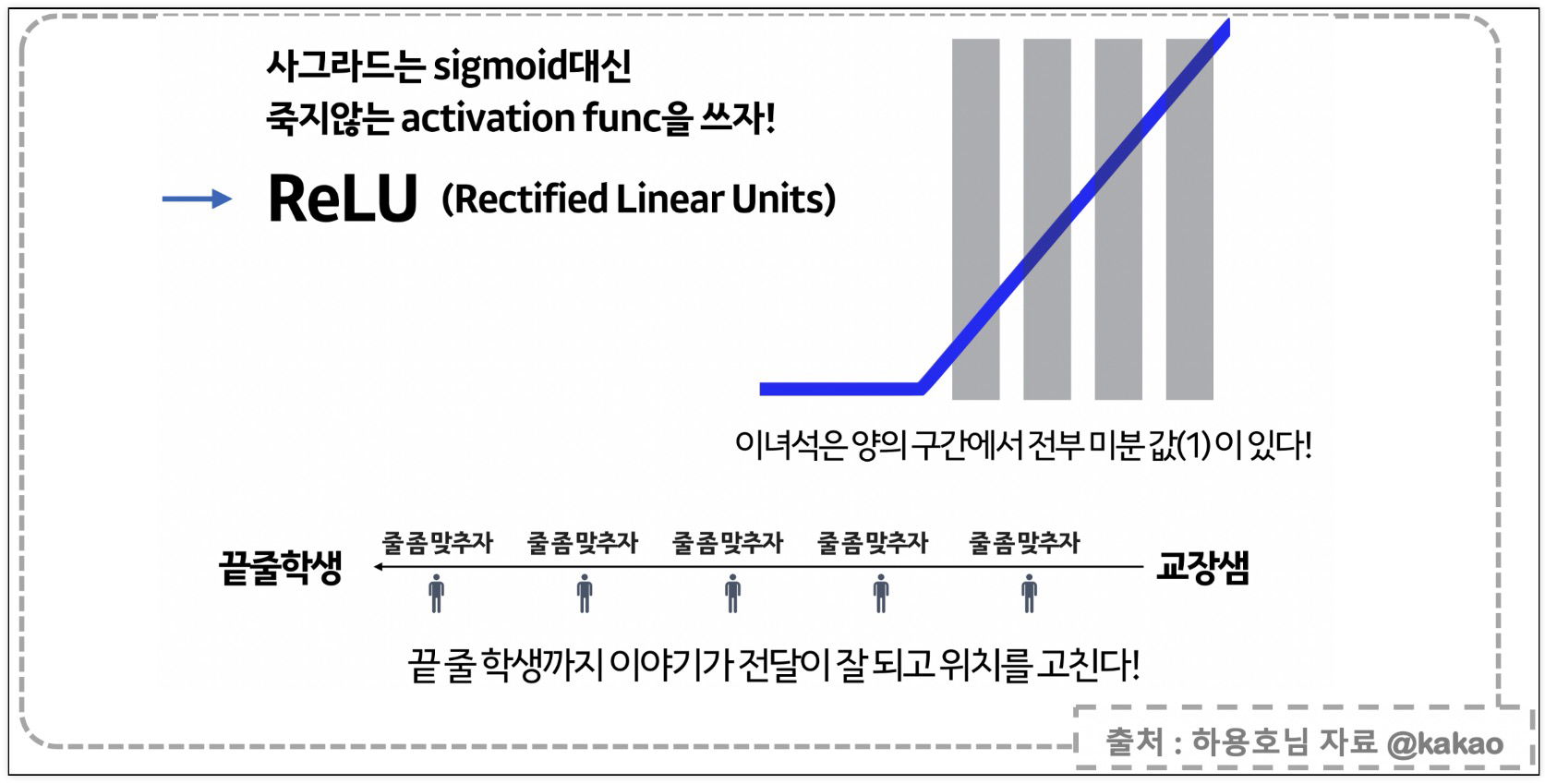

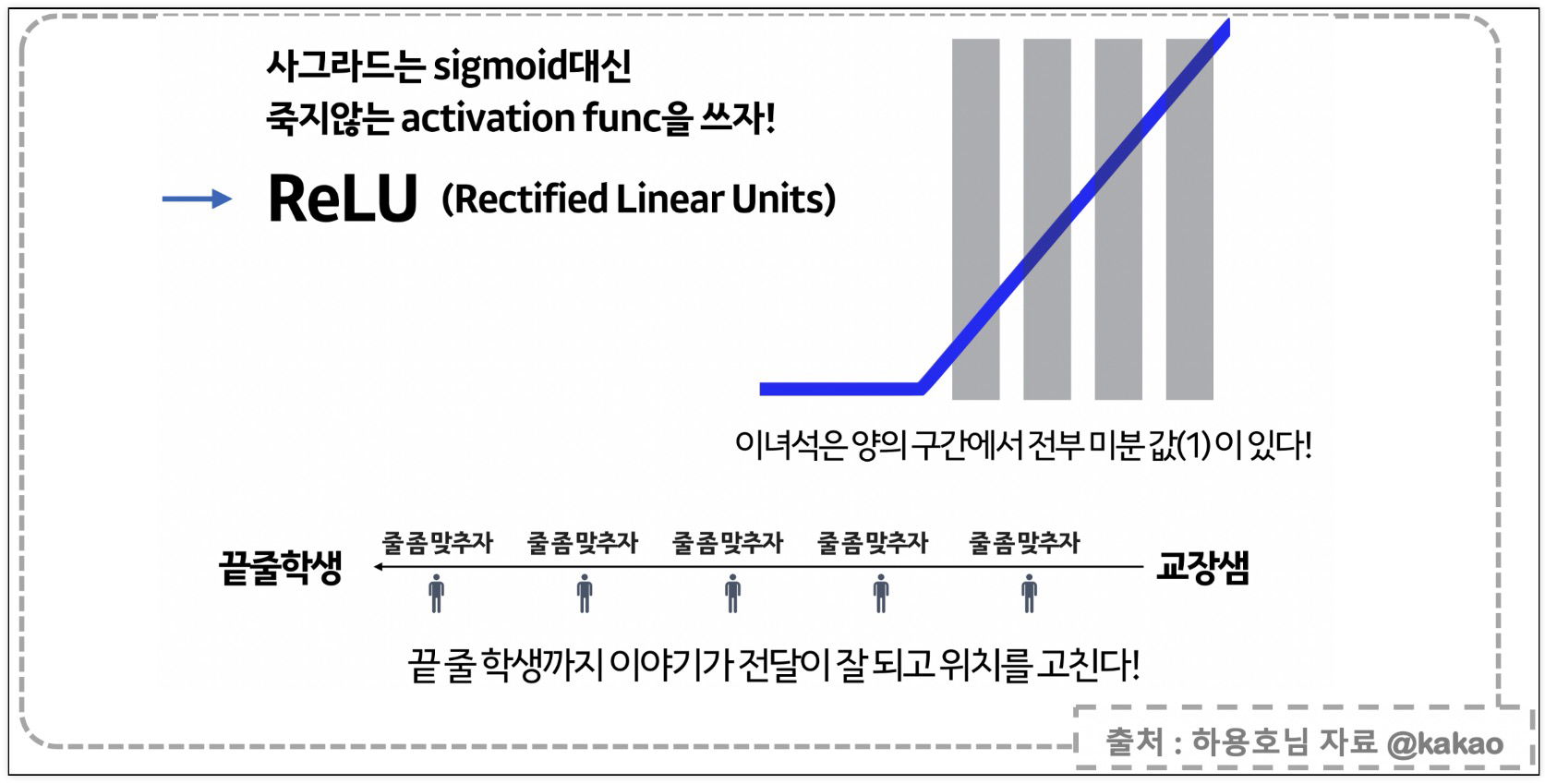

3. ReLU 등장

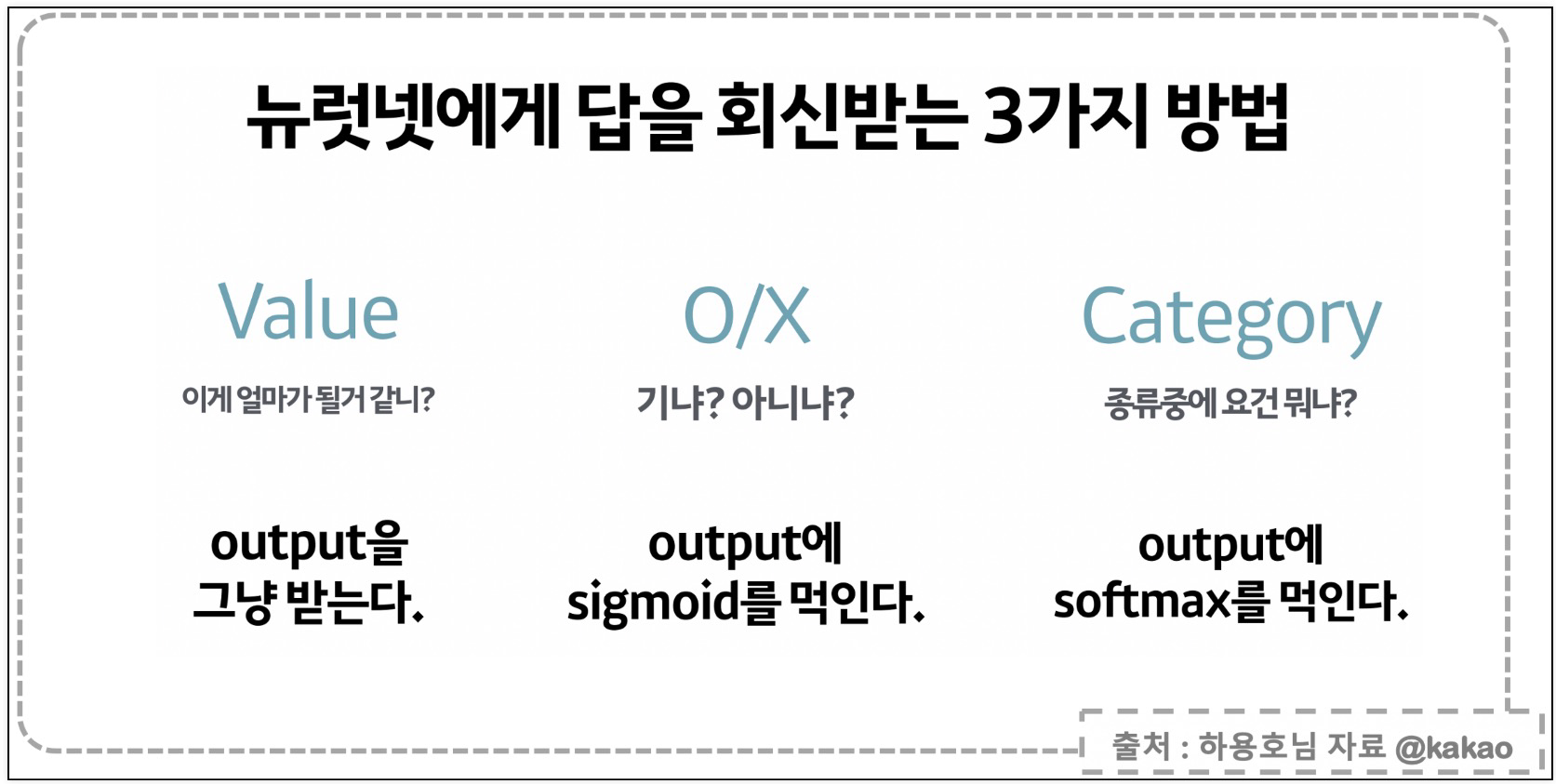

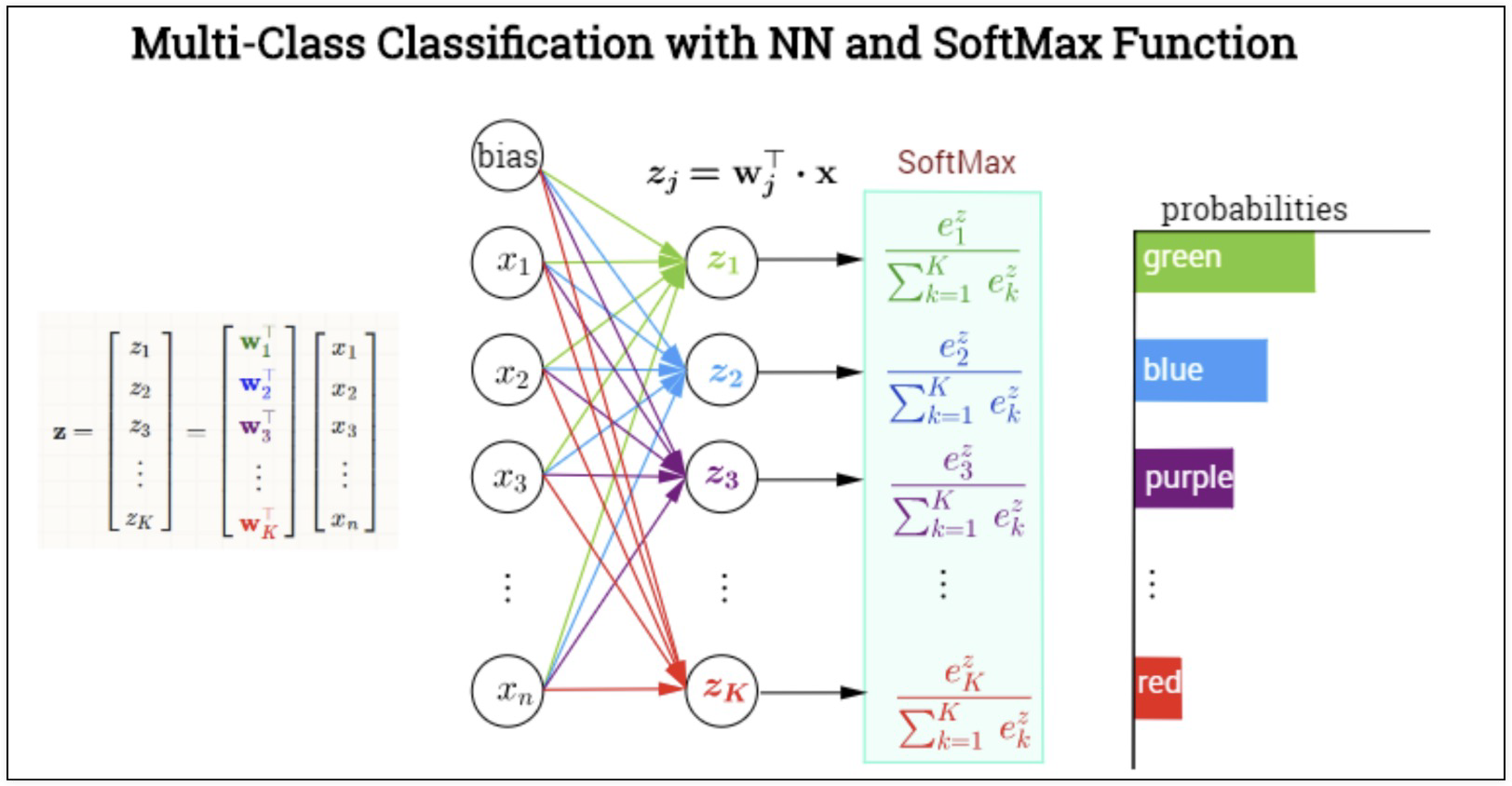

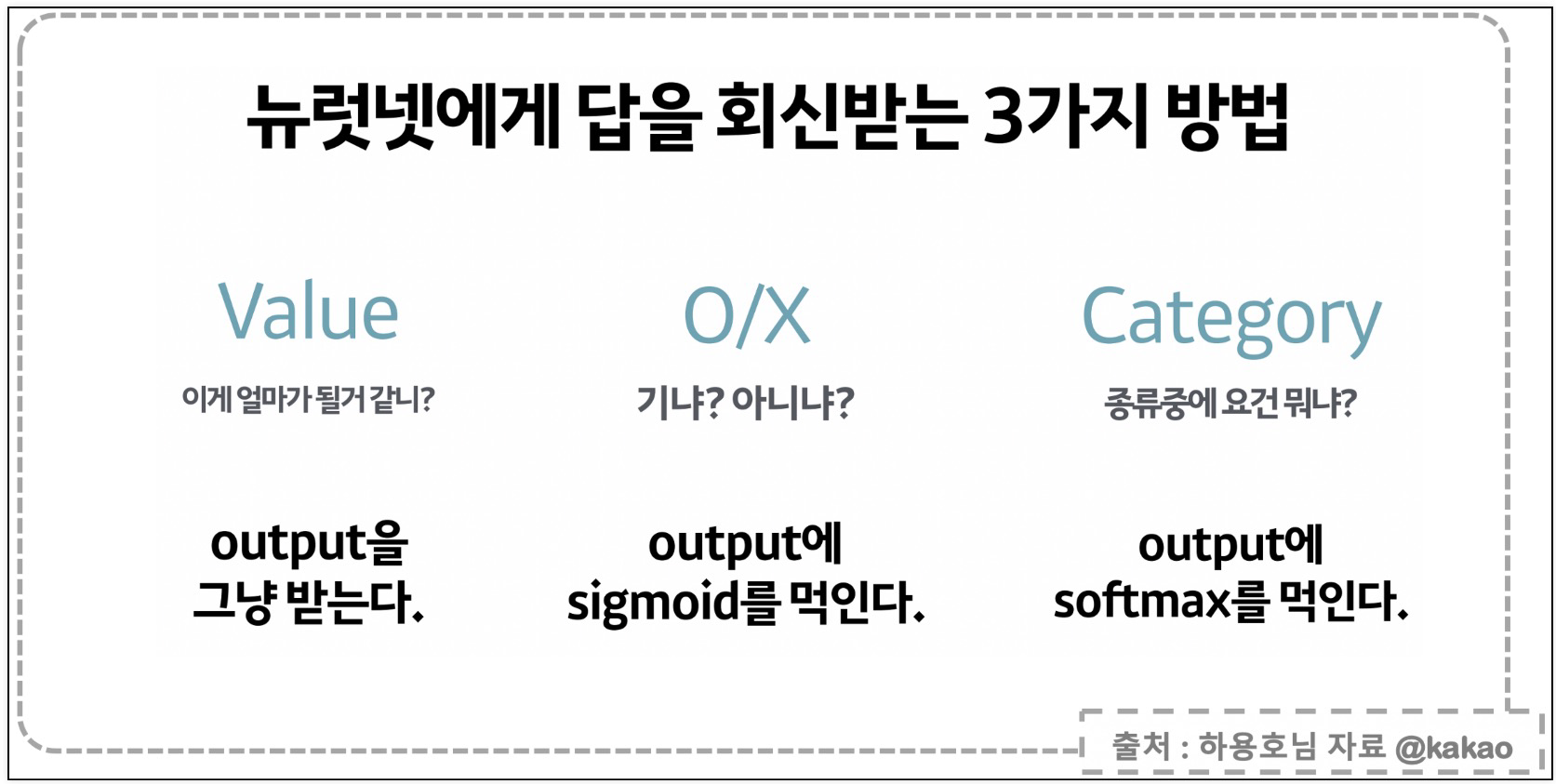

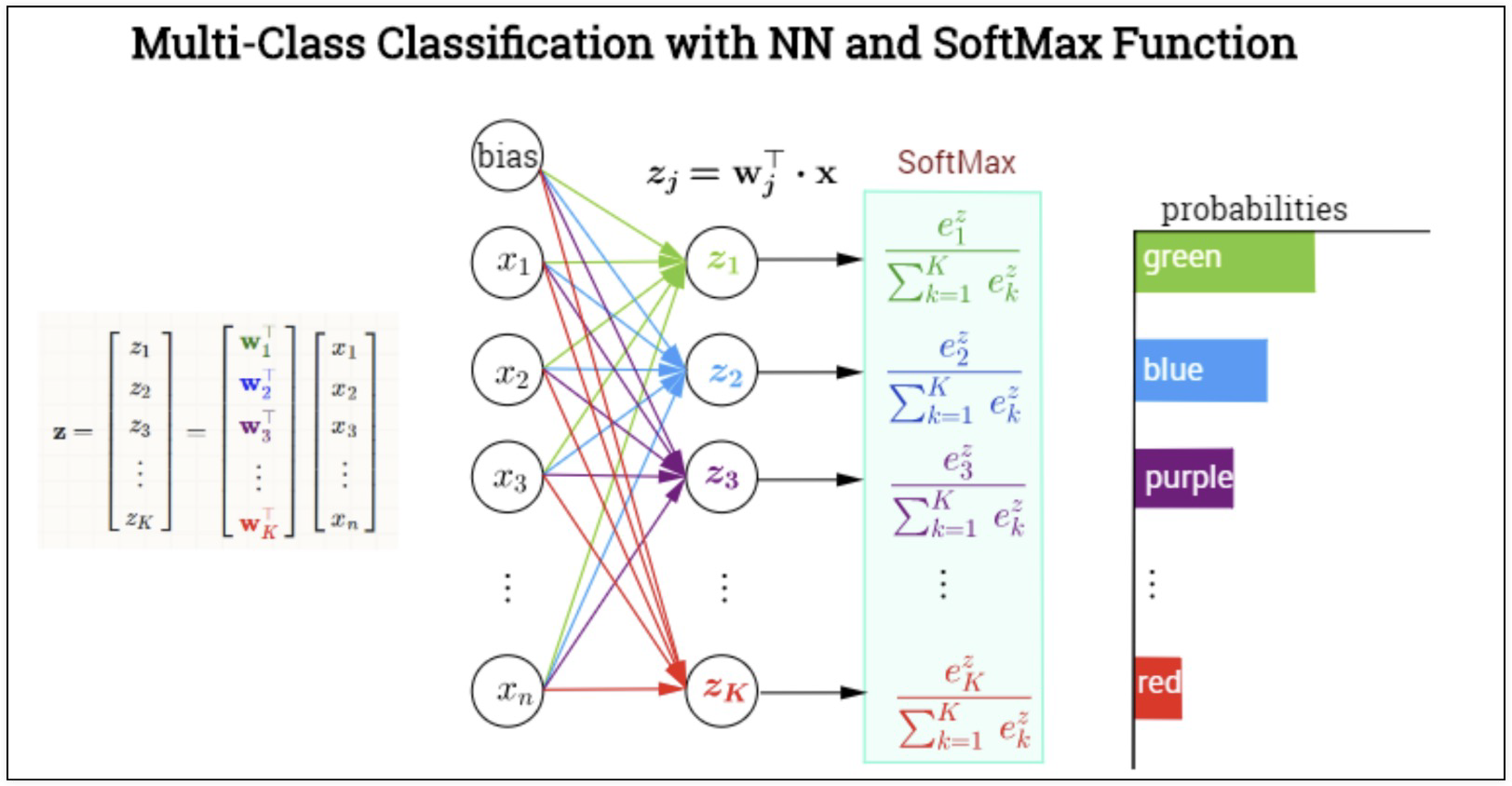

4. softmax

- , 이중 가장 높은 값을 정답이라고 한다

5. 활성화 함수의 종류

Reference

1) 제로베이스 데이터스쿨 강의자료

2) https://steadiness-193.tistory.com/244

Reference

1) 제로베이스 데이터스쿨 강의자료

2) https://steadiness-193.tistory.com/244