비지도학습의 대표적인 방법 중 하나로 차원 축소 알고리즘이 있다.

차원 축소는 수많은 정보 속에서 더 중요한 요소가 무엇인지를 알게해주는 방법이다. 비지도학습에서 여러 feature(특징)들 중에서 어떤 feature가 데이터를 가장 잘 나타내는지 알게 해주는 특징 추출의 용도로 사용된다.

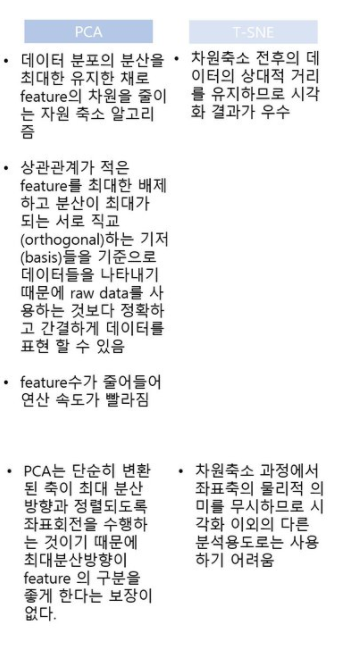

1. PCA

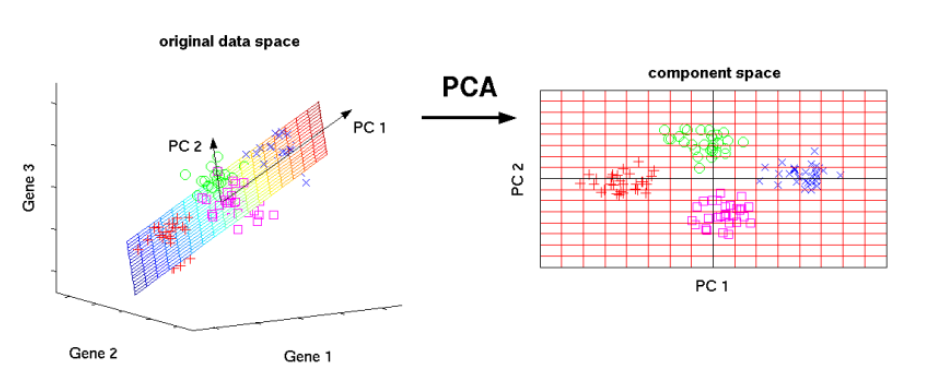

차원 축소 방법 중 PCA가 있다.

PCA는 데이터 분포의 주성분을 찾아주는 방법이다. 주성분이란 데이터의 분산이 가장 큰 방향벡터를 의미한다.

PCA는 데이터들의 분산을 최대로 보존하면서, 서로 직교하는 기저들을 찾아 고차원 공간을 저차원 공간으로 사영한다.

또한 PCA는 기존 feature중 중요한 것을 선택하는 방식이 아닌 선형 결합하는 방식을 사용한다.

차원의 수는 줄이면서 데이터 분포의 분산을 최대한 유지하기 위해 가장 분산이 긴 축을 첫 기저로 잡고 , 그 기저에 직교하는 축 중 가장 분산이 큰 값을 다음 기저로 잡는다. 이 과정을 반복하면 차원의 수를 최대로 줄이면서 데이터 분포의 분산을 그대로 유지할 수 있다.

이를 차원 축소라고 한다.

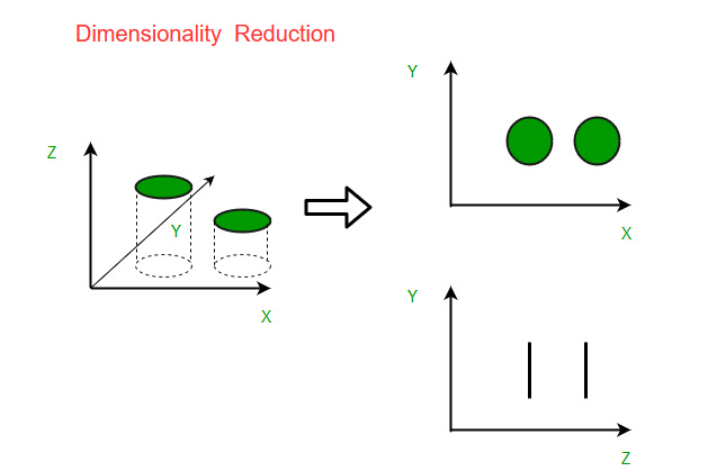

X-Y-Z 좌표축상에 존재하는 데이터를 X-Y, Y-Z 좌표축에 사영한 것이다.

(X-Y 축에 사영했다는 것은 z축을 무시한 것)(Y-Z 축에 사영했다는 것은 x축을 무시한 것)

그렇다면 원본데이터의 특성을 잘 살린것은 어떤 것일까??

X-Y가 원본데이터를 잘 살린듯하다. 다시말하면 z축 방향의 정보가 상대적으로 덜 중요하다고 말할 수있다.(z축 방향의 분산이 작다)

이렇게 찾은 가장 중요한 기저를 주성분 방향 또는 pc축이라고 한다.

PCA는 각 feature간 상관관계가 있고 이를 추릴 필요가 있을 때 유용하게 사용되는 비지도학습 방법 중 하나이다.

2. T-SNE

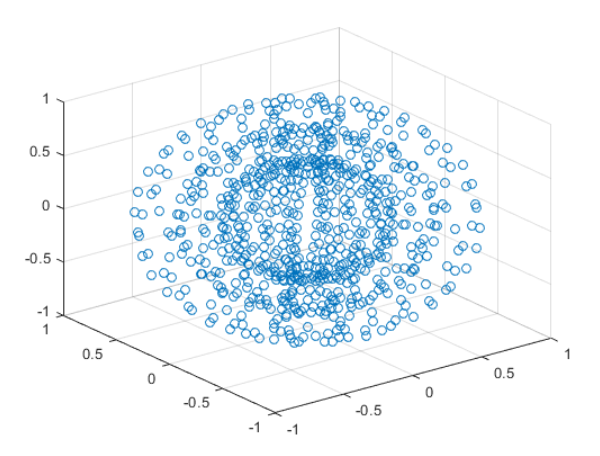

차원 축소를 할 때 비선형적인 방법으로 하는 것이 T-SNE이며, 특히 고차원의 데이터셋을 시각화하는 것에 좋다.

위의 이미지처럼 방사형적, 비선형적 데이터에서는 많은 정보량을 담기위한 pc축을 찾기 어렵다.

따라서 T-SNE를 사용하는데, T-SNE는 기존 차원의 공간에서 가까운 점들은 차원 축소된 공간에서도 여전히 가깝게 유지되는 것을 목표로 하고있다.

PCA는 데이터가 가진 고유한 물리적 정보량을 보존하는데 주력하지만, T-SNE는 고유한 물리적 정보량보다는 데이터들 간의 상대적 거리를 보존하는데 주력한다. T-SNE의 저차원 축이 아무런 물리적 의미를 가지지 못하므로 시각화에만 유리하다.

정리