keras에서 모델 만들기

from keras.models import Sequential

model = Sequential

모델 → 네트워크, 목표함수, 최적하기

keras network 정의

from keras, layers import Dense

층 쌓기

model.add(Dense(units=64, activation='relu', input_dim=100))

model.add(Dense(units=10, activation='softmax'))

컴파일

네트워크(두뇌) + 목표함수 + 최적하기

→ 네트워크가 학습할 준비가 되었다.

model.compile(loss='categorical_crossentropy', optimizer='sgd',metrics=['accuracy'])

네트워크

네트워크에 입력을 주면 출력이 하나 나온다.

-

시그모이드

0.0~1 사이의 실수만 출력을 한다.

목표 함수

- mean_squared_error → 수치 예측

- categorical_crossentropy → 다중 분류

- binary_crossentropy → 이진 분류

Optimizer

딥러닝 모델은 최적 문제를 푸는 것이다.

적정한 학습률로 학습을 시켜줘야한다.

모멘텀, 러닝 메이트

SGD, Adam, Adamax ...

batch, epochs

model.fit(x,y, batch_size = 32, epochs =10)

배치사이즈 → 몇 문항을 풀고 답을 맞추는 지

epochs → 반복 횟수

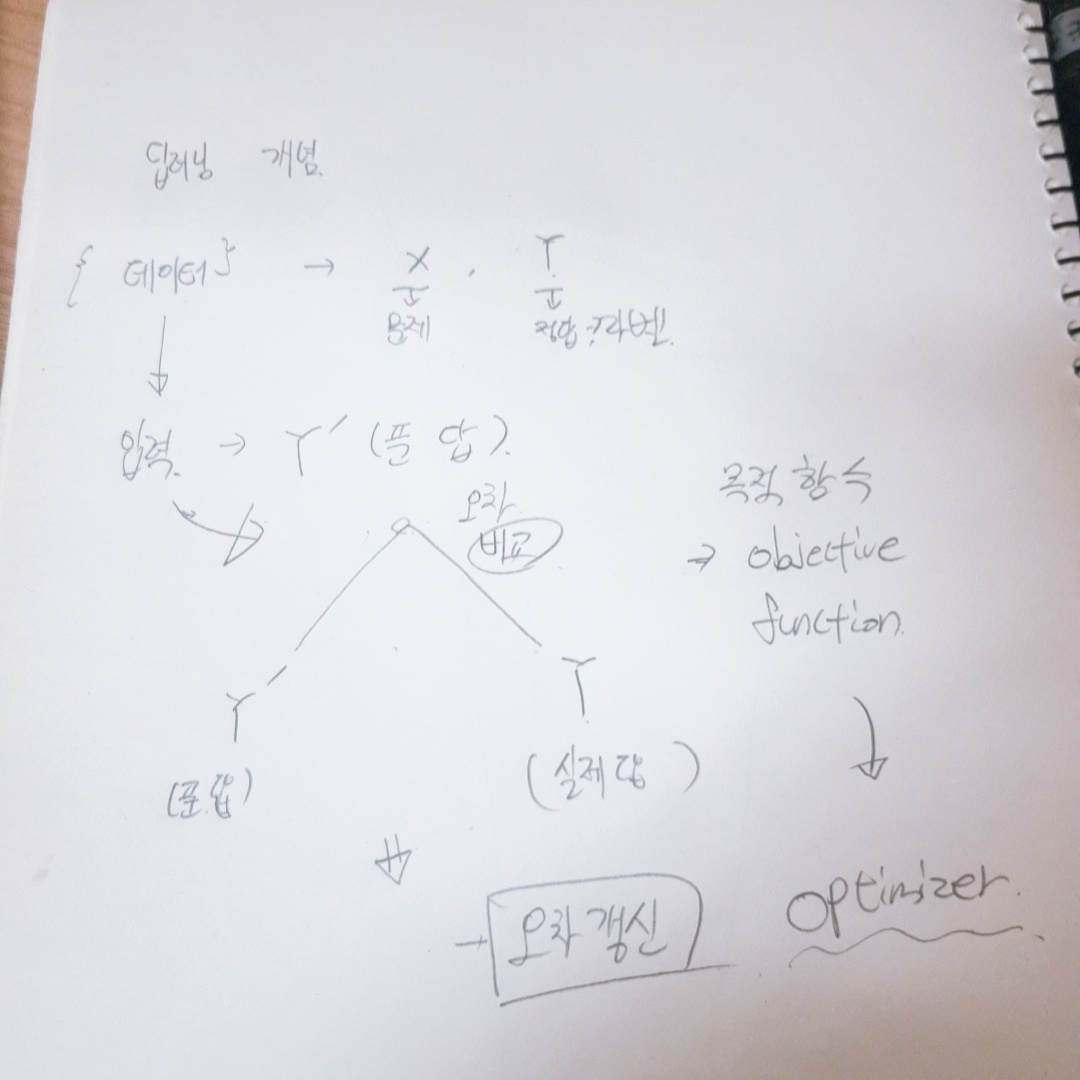

딥러닝 개념

데이터 입력 -> 목적함수 -> optimizer

목적함수 : 푼답과 실제답 비교

optimizer : 오차 갱신

실습 코드

fig, axes = plt.subplots(nrows=1, ncols=10, figsize=(10, 13),

subplot_kw={'xticks': [], 'yticks': []})

subplot → 이미지를 한번에 표현

subplot_kw={'xticks': [], 'yticks': []}) → 눈금을 안나오게 해준다

.png)