YOLO26: A Comprehensive Architecture Overview and Key Improvements

Abstract (초록)

YOLO(You Only Look Once)는 10년간 딥러닝 컴퓨터 비전의 대표 모델이었습니다. 이 논문은 YOLO 시리즈의 최신 버전인 YOLO26의 새로운 특징을 탐구합니다.

핵심 개선사항은 4가지입니다: DFL 제거, NMS-Free 추론, ProgLoss + STAL, MuSGD 옵티마이저. 이를 통해 CPU 모드에서 43% 속도 향상을 달성했다고 주장하며, GPU 없는 엣지 디바이스에서의 실시간 처리를 가능하게 합니다.

이 논문의 차별점은 단순히 공식 문서를 정리하는 것을 넘어, GitHub 소스 코드를 직접 분석하여 최초로 완전한 YOLO26 아키텍처 다이어그램을 제공한다는 점입니다.

Section 1: Introduction (소개)

Ultralytics의 YOLO가 가장 인기 있는 이유로 5가지를 제시합니다:

a. 객체 탐지, 인스턴스 세그멘테이션, 분류, 포즈 추정, OBB, 추적까지 다양한 CV 작업 지원

b. YAML 기반으로 쉽게 수정 가능

c. ONNX, TensorRT, CoreML, OpenVINO 등 다양한 포맷으로 내보내기 가능

d. 양자화(Quantization) 지원으로 속도 향상

e. 속도와 정확도의 균형, 특히 YOLO26에서는 엣지 디바이스 속도 향상에 집중

YOLO26이라는 이름의 유래: YOLOv13 다음 버전임에도 버전 번호를 건너뛰어 YOLO26이 되었습니다. 2026년에 출시(1월 14일)되었기 때문이기도 하지만, 다른 기관이 같은 해에 새로운 YOLO 버전을 출시할 경우 혼동을 유발할 수 있다는 점도 지적합니다.

논문의 핵심 주장: 공식 문서만으로는 DFL이 아키텍처 어느 블록에 위치하는지조차 알 수 없습니다. 소스 코드를 직접 분석해야 하며, 이 논문은 그 분석 결과를 처음으로 공개합니다. 슬로건은 "Built End-to-End. Built for the Edge"입니다.

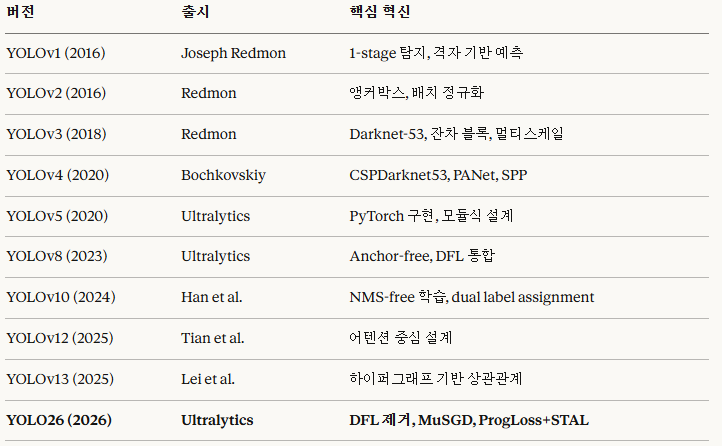

Section 2: Evolution of YOLO Models (YOLO 모델 진화)

YOLO 모델의 역사를 표로 정리합니다. 처음 4년간 3개 버전이 출시되었으나, YOLOv4(2020년) 이후 2026년까지 무려 11개 버전이 출시될 만큼 빠르게 발전했습니다.

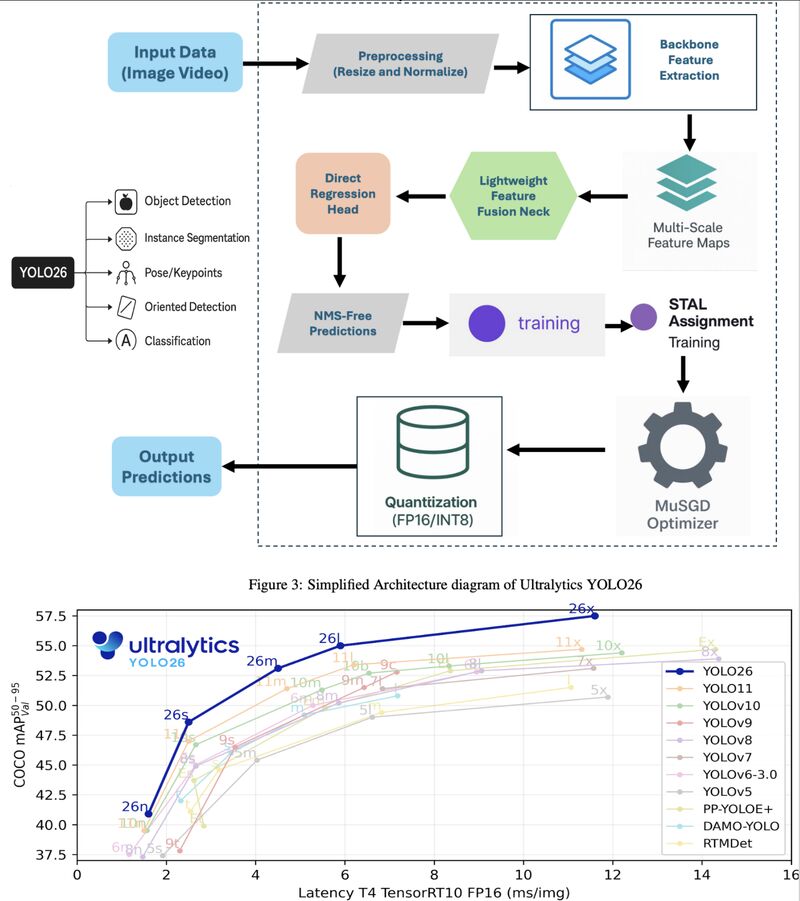

Section 3: YOLO26 Architecture (아키텍처)

아키텍처는 Ultralytics GitHub 소스 코드(yolo26.yaml, tasks.py, release 8.4.14)를 직접 분석하여 도출했습니다. 입출력 텐서 추적으로 다이어그램을 검증했습니다.

모델은 depth_multiple, width_multiple, max_channels 세 파라미터로 정의되며, 모델 크기(n/s/m/l/xl)에 따라 값이 달라집니다.

Backbone (백본)

- Conv ×2 (커널 3, 스트라이드 2): 공간 해상도를 단계적으로 절반씩 축소 (640→320→160)

- C3k2 블록: 높은 추상화 수준의 특징 추출 (파라미터: n, c3k, e)

- 블록 3, 5, 7은 추가 합성곱, 블록 4, 6, 8은 C3k2로 구성되며 이 세 블록은 Neck과 연결됨

Neck (넥)

- SPPF (Spatial Pyramid Pooling Fast): 다양한 크기의 풀링으로 다중 추상화 수준 특징 추출. YOLO26에서는 숏컷 연결이 추가되어 정보 흐름 강화

- C2PSA 블록: 셀프 어텐션 기반 전역 모델링

- Upsample + Concat: 특징 맵 해상도 복원 및 병합 (해상도 유지, 채널 수 증가)

- 마지막 C3k2 블록에는 어텐션 블록이 새로 추가됨

Head (헤드)

세 개의 탐지 헤드로 구성됩니다:

- Head 1 (C3k2 블록 16): 소형 객체 탐지 (80×80)

- Head 2 (C3k2 블록 19): 중형 객체 탐지 (40×40)

- Head 3 (C3k2 블록 22): 대형 객체 탐지 (20×20)

가장 주목할 점은 DFL이 완전히 제거되었다는 것입니다.

Section 4: Key Improvements (핵심 개선사항)

YOLO26의 아키텍처는 YOLO11과 매우 유사하지만 아래 4가지 핵심 개선이 이루어졌습니다.

4-1. SPPF 숏컷 추가

SPPF 블록 내부에 숏컷 연결을 추가하여 그래디언트 전달을 강화하고 고수준 의미 표현에서의 최적화를 안정화합니다.

4-2. DFL 제거 + NMS-Free 추론

-

DFL의 문제점: 기존 YOLO에서 DFL은 바운딩 박스 위치의 분포를 예측하여 회귀를 개선했지만, 추가 연산과 고정 회귀 범위로 인해 one-to-one 객체 할당 학습이 어렵고 NMS 의존성이 높아지는 문제가 있었습니다.

-

YOLO26의 해결책: DFL을 제거하고 좌표를 직접 예측하는 박스 회귀로 대체했습니다. 이를 통해 학습과 추론 과정이 단순화됩니다.

-

Dual Assignment (NMS-Free): YOLOv10에서 영감을 받았습니다.

- 학습 시: one-to-many + one-to-one 헤드를 동시에 사용. one-to-many는 백본/넥에 풍부한 감독 신호를 제공하고, one-to-one은 각 객체에 하나의 예측만 대응시킵니다

- 추론 시: one-to-many 헤드를 제거하고 one-to-one 헤드만 사용하여 NMS 없이 최종 탐지 결과를 직접 출력

- Top-K 선택: IoU 비교 없이 분류 신뢰도 점수 기반으로 상위 K개 예측을 선택

4-3. ProgLoss + STAL

-

ProgLoss (Progressive Loss Balancing): 학습 신호의 가중치를 시간에 따라 동적으로 조정합니다.

- 초기 단계: one-to-many 헤드에 높은 가중치 → 학습 안정화, 재현율 향상

- 후기 단계: one-to-one 헤드로 점진적 이동 → 추론 동작과 학습을 일치시킴

- 결과: 수렴이 부드러워지고, 불안정한 학습 실행이 줄어들며, 최종 성능이 일관됨

-

STAL (Small-Target-Aware Label Assignment): 기존 TAL(Task Alignment Learning)은 매우 작은 객체를 자주 무시하는 문제가 있었습니다. STAL은 이를 해결하기 위해 640×640 입력 이미지 기준으로 8×8 픽셀 이하의 소형 객체에 최소 4개의 앵커를 보장하여 아무리 작은 객체도 학습 손실에 기여하도록 만듭니다.

4-4. MuSGD 옵티마이저

LLM 학습에 사용되는 Muon 옵티마이저에서 영감을 받은 하이브리드 옵티마이저입니다.

- 일부 파라미터: Muon 스타일 업데이트 + SGD 조합

- 나머지 파라미터: 순수 SGD 유지

- 결과: 더 부드러운 최적화, 빠른 수렴, 예측 가능한 학습 동작

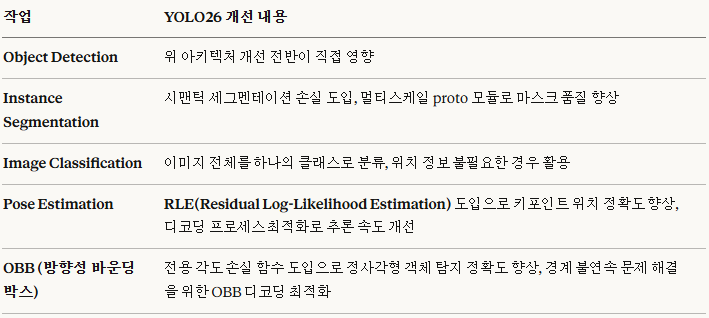

Section 5: Computer Vision Specific Tasks (다양한 CV 작업 개선)

Section 6: Performance Comparison (성능 비교)

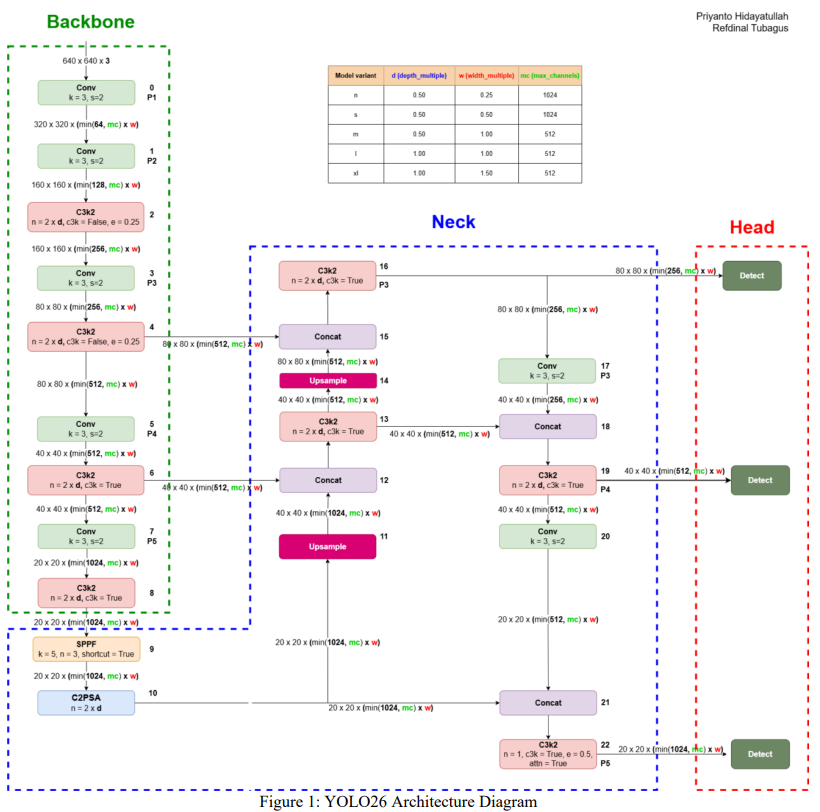

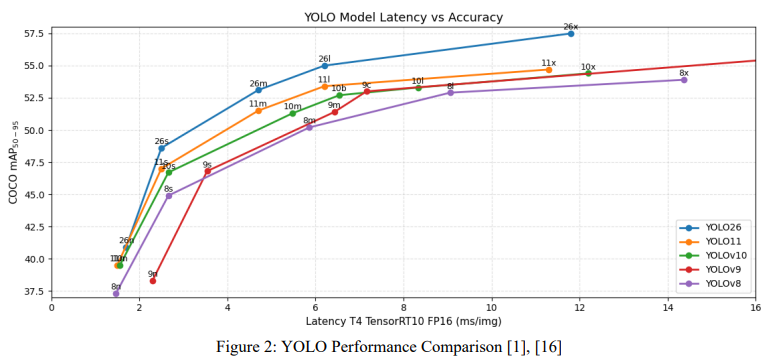

COCO 데이터셋 기준 mAP와 NVIDIA T4 GPU 기준 속도를 비교한 결과:

- 정확도(mAP): 모든 모델 크기 변형(n/s/m/l/xl)에서 이전 YOLO 버전 대비 최고 정확도 달성

- 속도: s와 m 변형만 가장 빠르며, YOLO11과 동등한 수준. 전 변형에서 가장 빠른 것은 아님

- CPU 속도: 43% 향상(엣지 디바이스 최적화)

Section 7: Conclusion (결론)

YOLO26은 아키텍처와 학습 메커니즘 모두에서 이전 버전 대비 여러 개선을 도입했습니다. 논문은 이를 다음과 같이 평가합니다:

"YOLO26은 이전 버전의 개선된 버전이지, 파괴적인 재설계는 아니다."

다만, 소형 객체 탐지 정확도 향상, 추론 단순화, 연산 비용 절감이라는 측면에서 엣지 디바이스에 적합한 실용적인 진화라고 결론 짓습니다.