Transformer Explainer 소개

Transformer 모델은 자연어 처리(NLP) 분야에서 혁신적인 변화를 가져온 모델입니다. 하지만 그 복잡한 구조와 동작 원리는 많은 사람들에게 여전히 난해합니다. Polo Club의 Transformer Explainer는 이러한 복잡성을 시각적으로 풀어주는 도구로, 사용자가 Transformer의 내부 동작을 쉽게 이해할 수 있게 도와줍니다. 이 도구는 특히 NLP 연구자와 개발자들에게 유용하며, 모델의 작동 방식을 직관적으로 파악하는 데 도움을 줍니다.

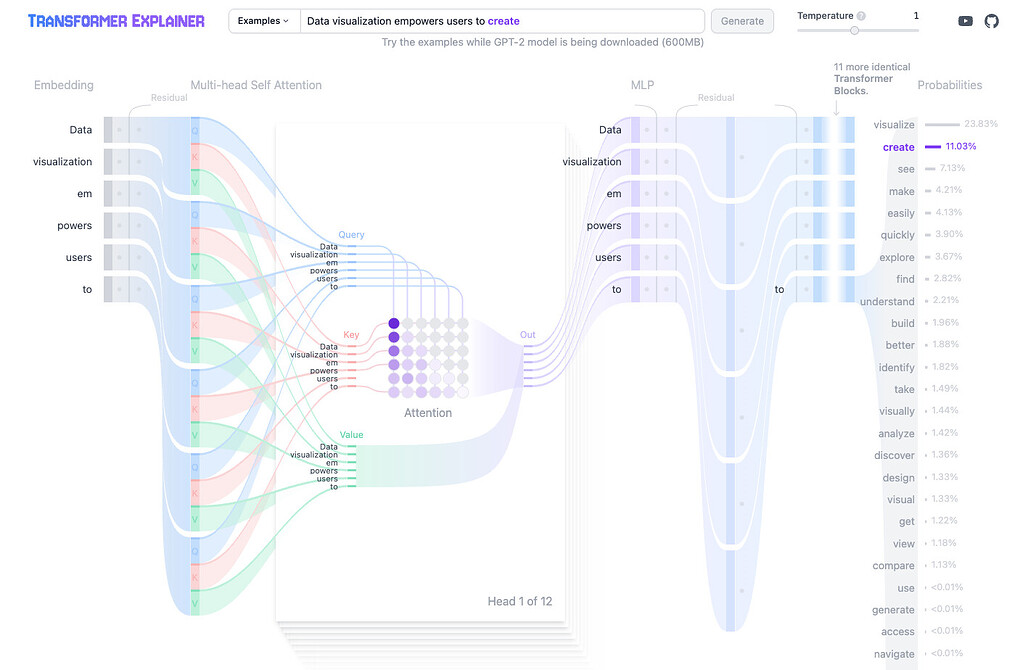

Transformer Explainer는 Transformer 기반 모델, 특히 GPT와 같은 텍스트 생성 모델의 동작 방식을 시각적으로 학습할 수 있는 인터랙티브 도구입니다. 이 도구는 웹 브라우저에서 직접 실행되는 GPT-2 모델을 통해 텍스트를 실험하고, Transformer 내부 구성 요소들이 다음 토큰을 예측하는 과정을 실시간으로 관찰할 수 있게 합니다.

모델 시각화: Transformer 모델의 작동 방식을 시각적으로 표현하여 복잡한 구조를 이해하기 쉽게 합니다.

사용자 친화적 인터페이스: 직관적인 인터페이스를 통해 사용자가 쉽게 접근하고 사용할 수 있습니다.

다양한 지원: 다양한 Transformer 모델을 지원하며, 연구자나 개발자가 필요에 따라 확장할 수 있습니다.

Transformer Explainer 데모

https://poloclub.github.io/transformer-explainer/

라이선스

Transformer Explainer는 MIT 라이선스 하에 제공됩니다.

참조

[Github]

https://github.com/poloclub/transformer-explainer?utm_source=pytorchkr&ref=pytorchkr

[YouTube]

https://youtu.be/ECR4oAwocjs