🟢 Introduction

Linear Regression모델을 만들기 위한 2가지 방법

1. 잔차 제곱합(RSS: Residual Sum of Squares)을 최소화하는 가중치와 바이어스 구함

2. 잔차 제곱합의 그레디언트(gradient) 벡터가 0이 되도록 함 (Gradient descent)

이 글에서는 방법 2를 알아가보도록 하자.

📈 경사하강법이란 무엇인가?

한마디로..

우리의 모델(여기서는 1차함수 - 직선)이 적절한 기울기 및 bias를 찾는 것이 목표!

그럼 조금씩 오차를 줄여나는 방향으로, 최적의 기울기 및 bias값을 찾자!

우리가 part05에서 생각한(가설) 선형 함수의 기울기가 양의 무한대로 증가하거나, 기울기가 음의 무한대로 감소한다고 생각해보자.

기울기가 증가함에따라 오차는 어떻게 될까?

당연히 오차는 기하급수적으로 증가할 것이다.

왜냐하면 data들과 직선의 거리가 실질적으로 엄청나게 멀어져버리는 상황이 연출되기에 오차가 증가하는 것은 당연하다.

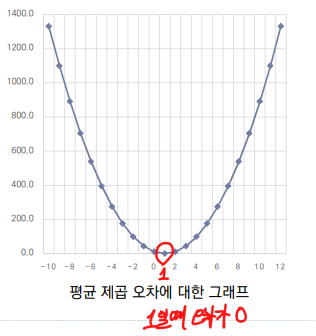

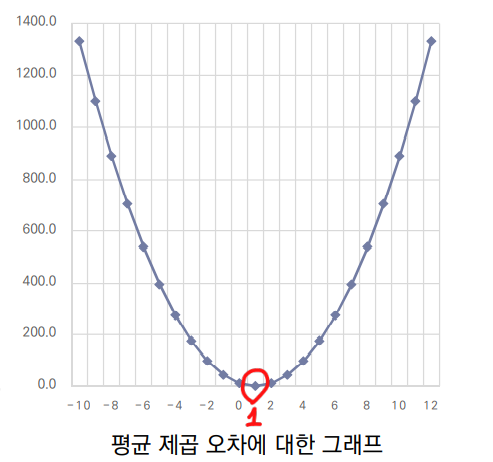

이러한 특징은 당연하게 평균제곱오차에서 유도된 특징이므로, 이를 시각적으로 평균제곱오차의 그래프를 나타냈을때도 이러한 특징이 동일하게 나타난다.

평균제곱오차는 2차함수의 그래프 이므로 다음과 같이 나타난다.

w(기울기) 값이 증가하거나 감소할수록 cost(오차)가 증가하는 모습

평균제곱오차를 통해서 나온 2차함수 그래프에서 X축은 Linear 모델의 기울기를 y축은 오차(cost)를 나타낸다.

이때, 우리의 목표는 즉 y축(cost) 값이 가장 작은 지점이 되도록하는 모델의 최적의 기울기를 찾는 것이다.

순서대로 과정을 따라가보며 이해해보자.

📈경사하강법의 과정

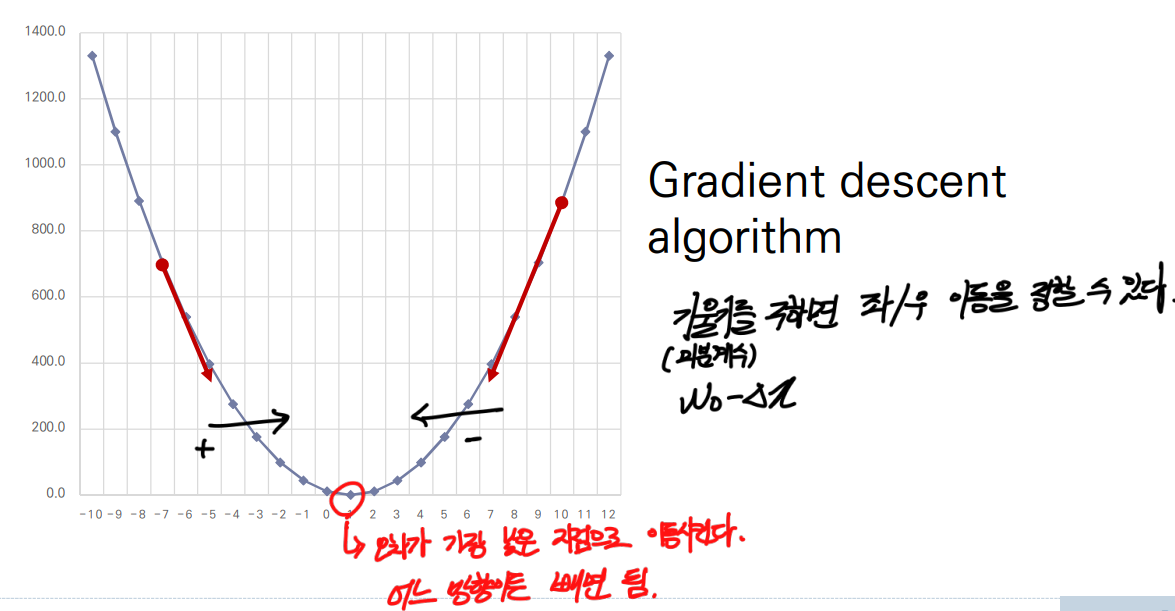

- 모델의 최적의 기울기 (cost의 값이 0이 되는 지점의 값)은 어떻게 찾을 수 있을까?

평균제곱오차 그래프의 기울기가 0인 지점이 바로, cost의 값이 0이 되는 값이다.

- 그래프의 기울기가 0이 되는 지점은 어떻게 구하는가?

그래프를 미분하면 기울기가 나온다!

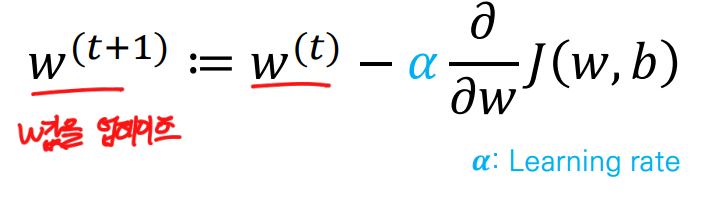

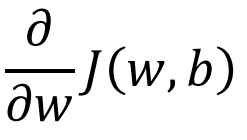

- Cost Function 을 weight를 기준으로 편미분한다는 식.

- 기존 w를 기준으로 한 지점으로 미분을 했다 (기울기를 구했다). 그럼 이제 어떻게?

이를 이용해서 w값을 업데이트 해준다!

w에서 기울기 xlr값 만큼을 빼주면, 오차가 낮아지는 방향으로 w값을 움직이게 할 수 있다! 끝!

lr에 관한 설명은 바로 아래 나온다.

- 참고로 음의 기울기, 양의 기울기 상관없이 빼면 된다. 그 이유는 음수 기울기를 0으로 수렴시키기 위해서는 기울기 값을 + 해야하는데 이는 결국 기울기 값을 빼면 -(-) = 이므로 결과적으로 더하는 것이므로 기울기 값을 + 하는 결과와 동일하다.

🛠 learning rate(학습률)

이 때, 중요한 것이 learning rate(학습률)이다. (lr로 표기)

왜 lr가 중요한가?

기울기는 로 표현되는데, 사실상 cost가 매우 크기에 기울기의 값은 매우 크게 나오게 될 것이다.

ex.) (4,100)만 보더라도 거의 25의 기울기를 가짐.

이를 w값에서 그냥 바로 뺀다면 값이 너무 커 기울기가 0에 수렴하긴 커녕 발산할 가능성이 만무하다.

따라서 적절한 lr 값(0.001 등..)을 지정함으로써 기울기가 0이되는 지점으로 수렴할 수 있도록 한다.

❕ 학습률의 주의사항

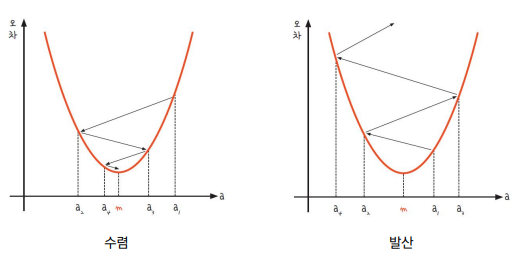

- 단, 잘못된 학습률을 지정하게되면 오른쪽과 같이 오차가 줄어드는 방향으로 가는것이 아닌, 발산하게 된다.

➰ (bias)의 업데이트 - 편미분 사용

위 예시에서는 즉, bias(y 절편)이 없는 상태로 값을 업데이트 하는 방법을 설명했다.

하지만 최적의 선을 표현하기 위해서는 어느정도의 평행이동이 필요할 것이고, 실제로는 와 같이 bias(y 절편)이 포함되어 함께 있을 것이다.

따라서 bias의 갱신(update)는 어떻게 이루어지는지 알아보자

w와 완벽하게 똑같다! 따라서 w만 알면 b는 똑같다!

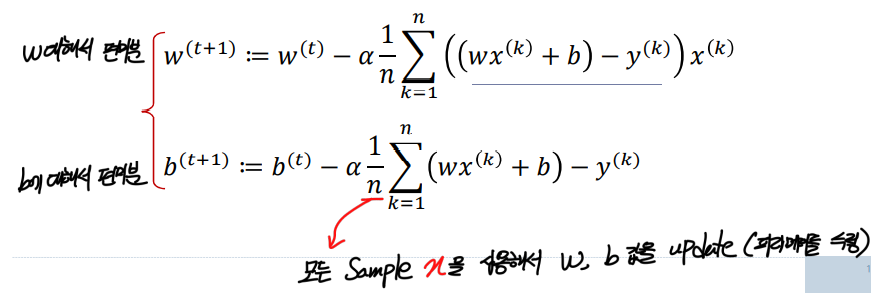

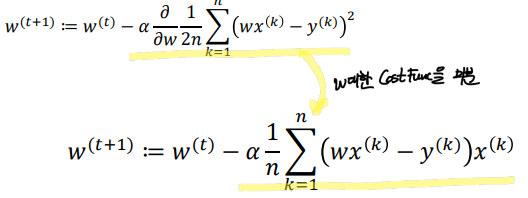

📈 (weight - 기울기)의 갱신과정

의 갱신과정을 상세히 살펴보자.

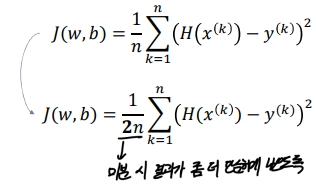

- 미분 시 결과가 단순하게 나오도록하기 위해, 평균제곱오차를 구할 때, 을 더 나눠준다.

- 에 대해 편미분을 수행하고 이값을

lr와 곱해 빼줌으로 써, 를 업데이트한다.

그렇다. 편미분의 사용이 여기서 나온다.

따라서 b를 업데이트 하기 위해서는, cost function에서 에 대해 미분하는 것이 아닌 b에대해서 미분한 값으로 업데이트 하면 된다.

📚 업데이트 과정 정리

- , 의 업데이트 과정 정리

= - (★) 빼게되는 해당 값은 b에 대해 cost Function을 편미분한 결과이다.