역전파(BackPropagation)

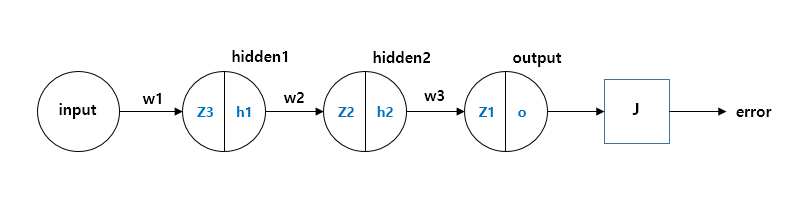

- 예시

- z1,z2,z3: 각 레이어의 노드 출력과 가중치의 합성곱.

- h1,h2,h3h_1, h_2, h_3h1,h2,h3: 각각 z1,z2,z3 값의 활성화 함수, 즉 시그모이드 함수의 결과 (각 노드의 출력). z1,z2,z3z_1, z_2, z_3

- J: 시스템의 에러를 집계하여 반환하는 손실 함수 (loss function).

손실 함수 J의 출력을 최소화하기 위해 경사 하강법(gradient descent)을 사용하여 가중치를 업데이트하기 위해 역전파(Backpropagation)를 수행한다.

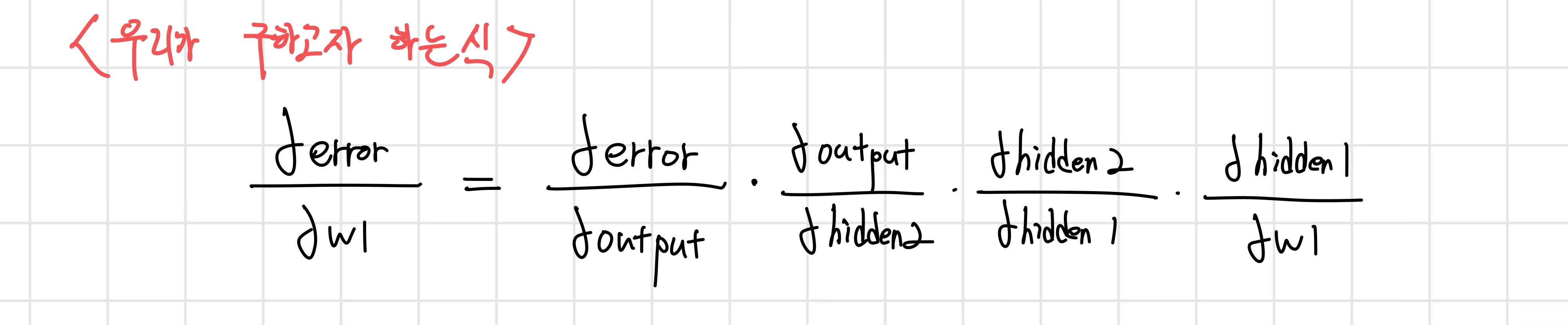

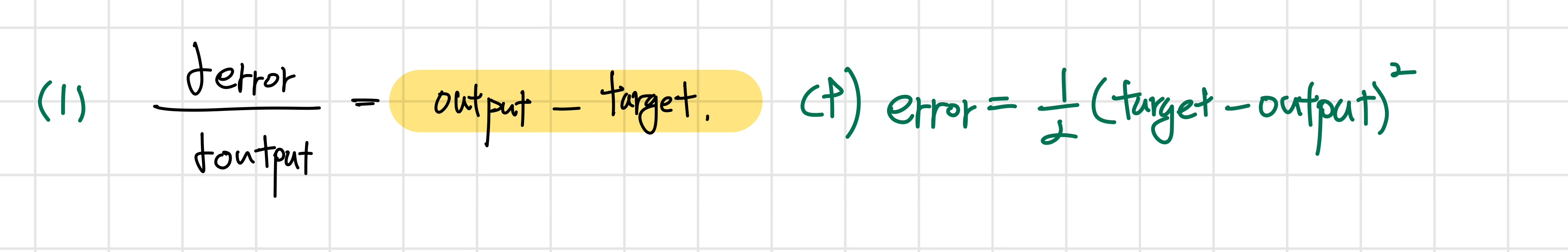

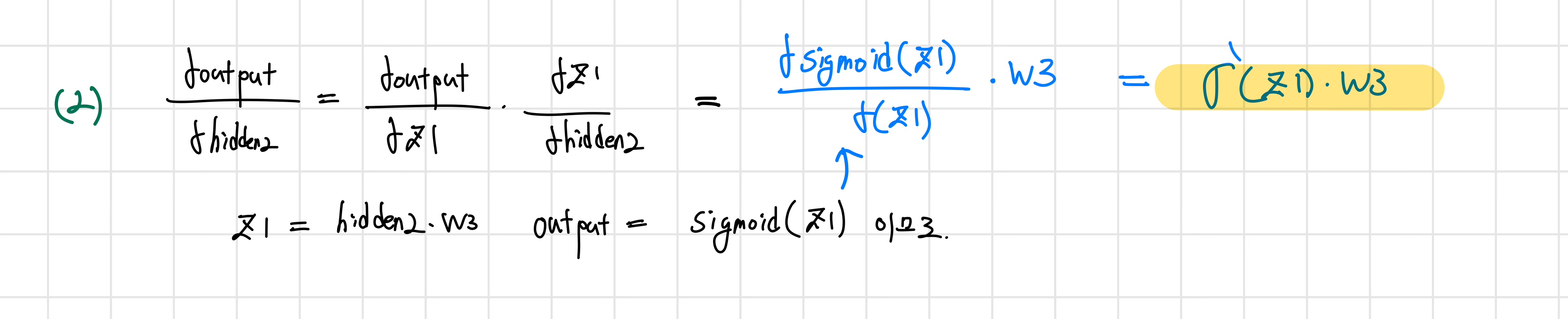

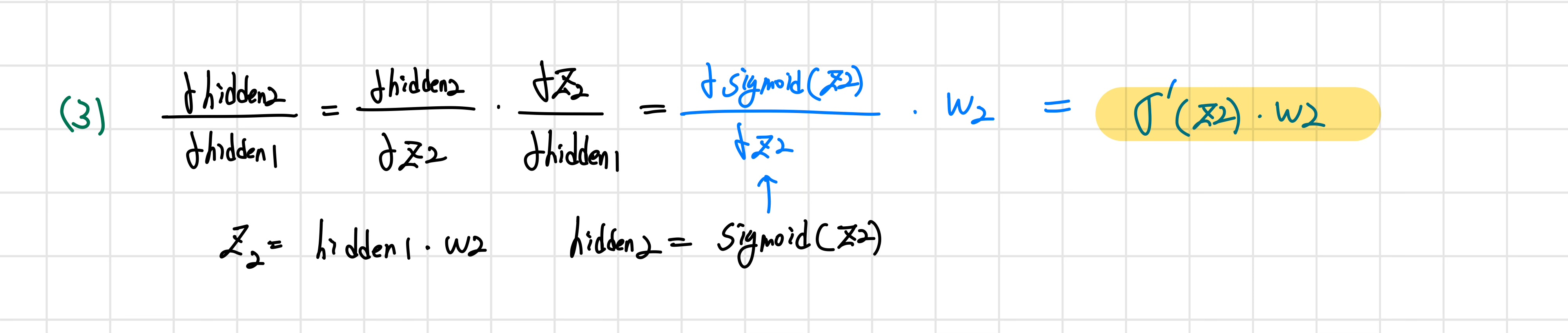

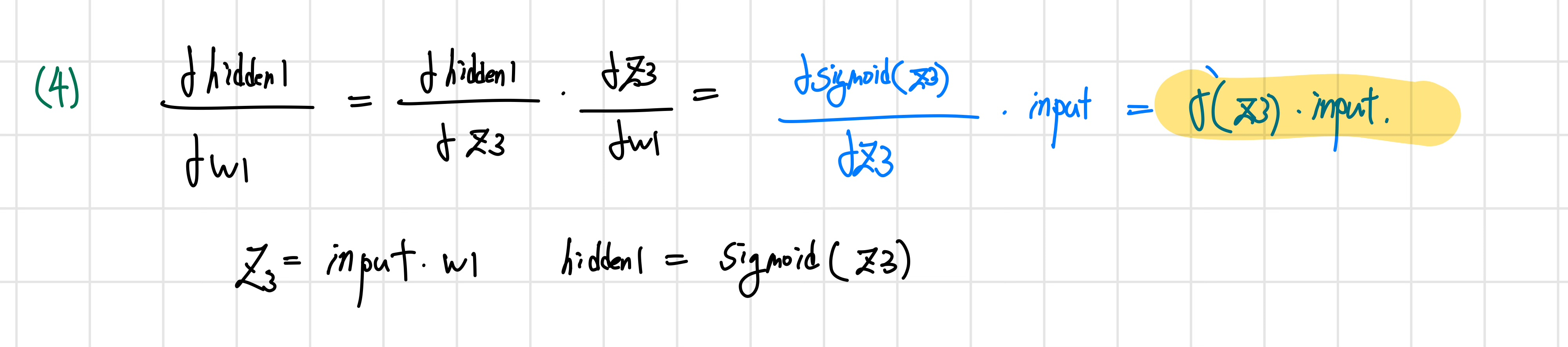

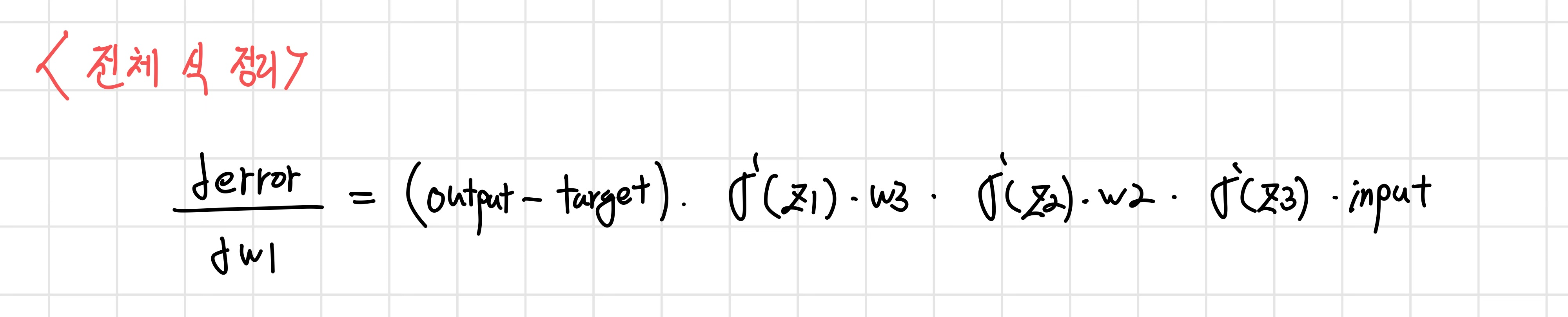

가중치 w1에 대해 미분하려면 chain rule에 따라 다음과 같이 미분이 된다.

학습 회고

기울기 소실에 대해서 공부하다가 역전파 과정에 대해서 손으로 직접 풀어보았다.

손으로 풀 생각은 없었다. 다음부턴 코드로 띡 쓸란다