LLM

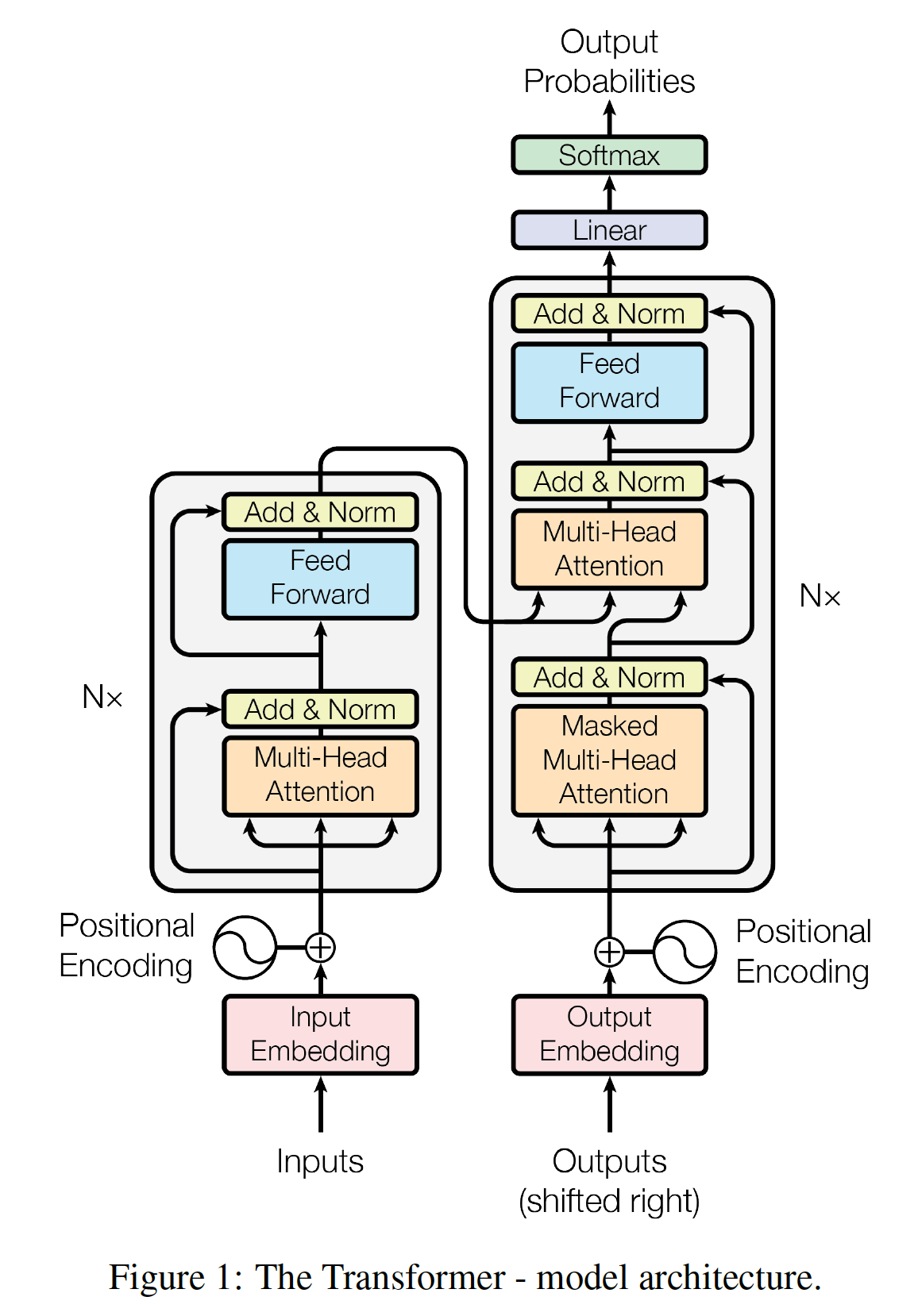

1.Transformer - Attention Is All You Need 완벽하게 이해하기

2017년 구글에서 발표한 논문 "Attention Is All You Need"는 기존의 RNN과 CNN 기반의 자연어 처리 모델을 뛰어넘는 혁신적인 transformer 구조를 제안했다. Transformer는 완전히 Attention Mechanism만으로 RNN

2025년 2월 23일

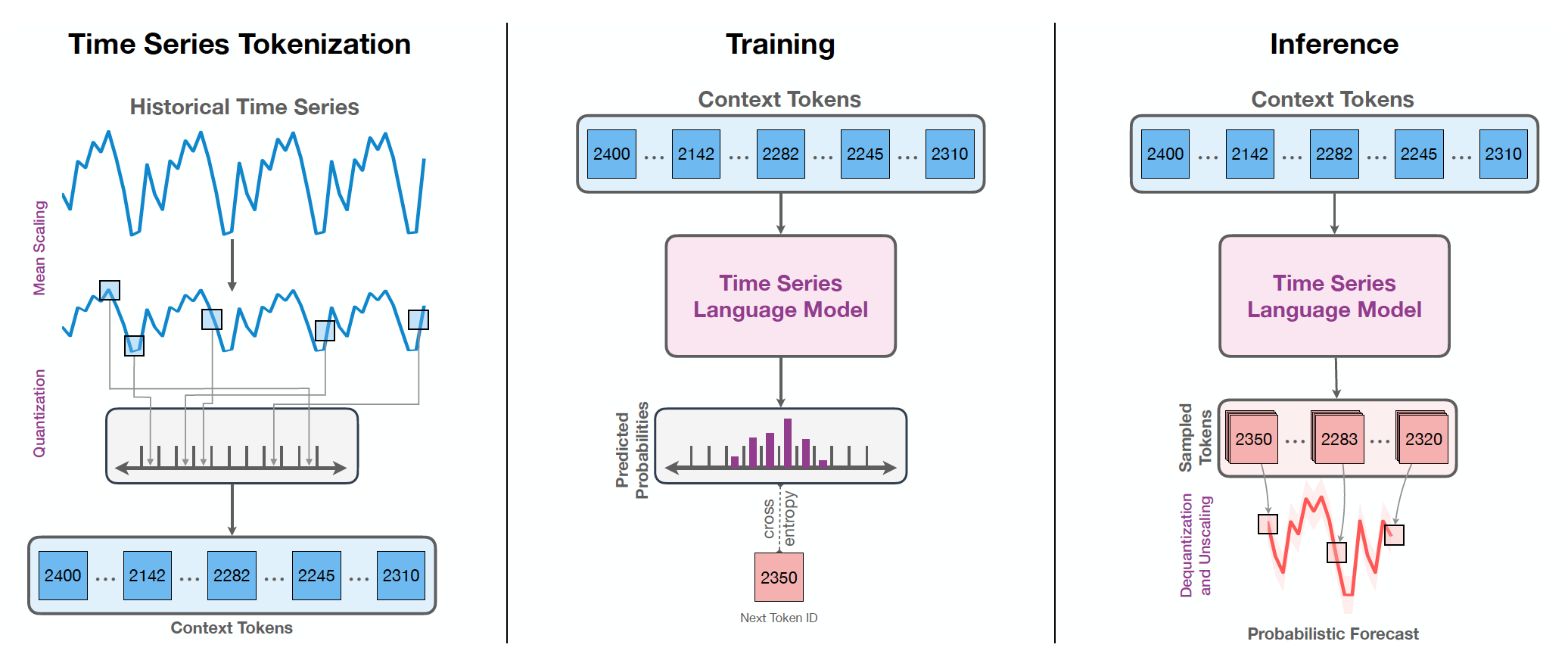

2.[Amazon] Chronos: Learning the Language of Time Series

최근 LLM의 성공은 텍스트뿐 아니라 다양한 도메인으로 확장되고 있다. 이번에 소개할 논문은 Amazon에서 발표한 Chronos (Time Series Foundation Models with Pretrained Transformers) 로, 이전에 리뷰한 PAPAG

2025년 9월 10일