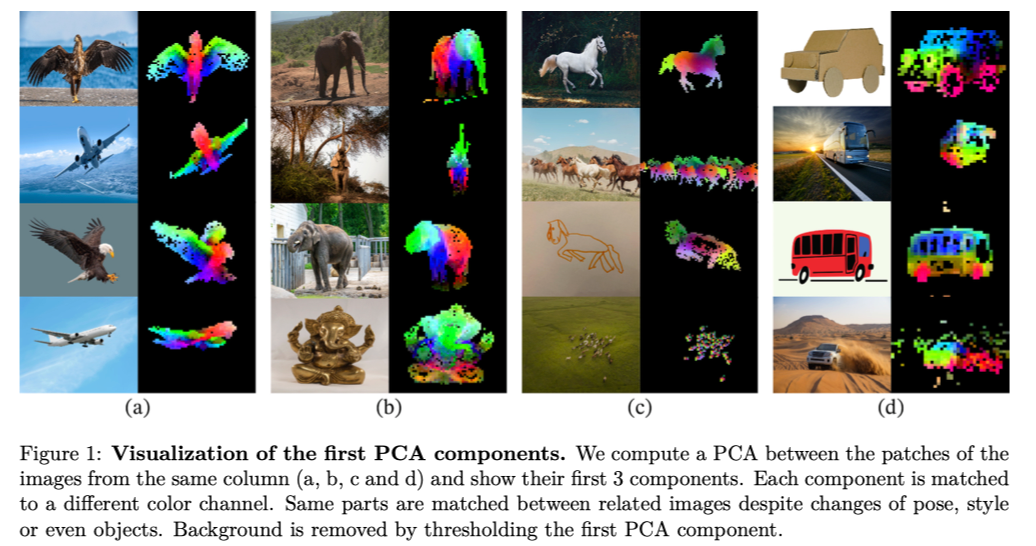

DINOv2 Figure1, DINOv2는 이미지 안에서 Object의 의미론적인 Partition을 구분할 수 있다.

0. 시작

2023년 4월 17일 DINOv2가 공개 되었다.

Blog : https://ai.facebook.com/blog/dino-v2-computer-vision-self-supervised-learning/

DINOv2의 Motivation은 Computer Vision 분야에서 FineTuning이 필요하지 않은 High Performance를 발현하는 안정적인 Backbone을 만들자! 이다.

한마디로 완벽에 가까운 Self-supervised Foundataion Model을 제시하고자 만들어졌다고 할 수 있다.

오픈-소싱(Open Sourcing)으로 발표되어서 논문과 코드 모두 아래의 깃헙에서 공부 할 수 있다.

1. DINOv2의 가치(Novelty)

사실 매력적이고 참신한 Methodology나 Approach는 없다. 하지만 논문을 보면 정말 빈틈없이 연구했다는 느낌을 받을 수 있다.

DINO의 가치는

1.1 이미지-텍스트 사전 훈련 모델의 한계점 극복

대표적인 이미지-텍스트 Pretrained Model은 CLIP(openai)이 있다.

무려 400M(4억개)의 데이터 개수를 바탕으로 멀티모달+컴퓨터비젼 씬에서 파장을 일으키고 있는 모델이다. 하지만 DINOv2는 CLIP의 Text Input 의존성을 저격한다. 그도 그럴것이 오로지 이미지로만 Self-supervised learning 기법을 통해 CLIP의 성능을 뛰어넘었기 때문이다.

.JPG)