-

gmm.py 코드 읽어보기!

GMM(분포가 6개의 가정을 한다), ANN

-

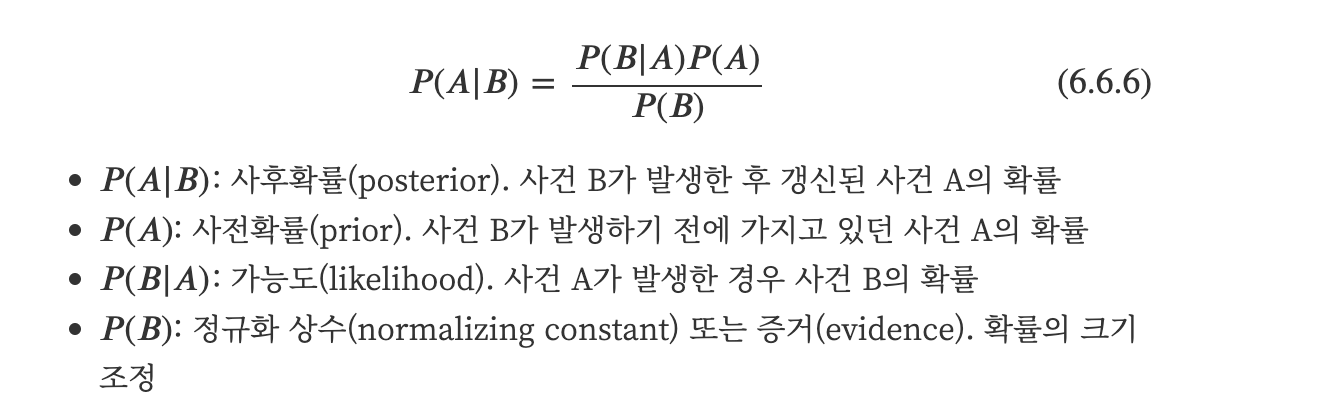

확률(Probability): 고정된 확률분포에서 어떠한 관측값이 나타나는지에 대한 확률

-

우도(가능도, Likelihood): 고정된 관측값이 어떠한 확률분포에서 어느정도의 확률로 나타나는지에 대한 확률

A: 데이터, B: 분포 (GT)

P(B|A): P(초기값) 이고 확률을 뽑을 것

P(GT|DATA) pi 우리의 가정

MLE: 데이터를 기반으로 내가 할 수 있는 최선책을 하는 것

예측한 초기 gas 를 데이터 분포하에서 억지로 만들어 내는 것

- 2,2 로 만드는 것

1 2

1 ㅣ o x

2 ㅣ x o

축이 2개 min=(x,y)에 해당하는 것이 확률분포 6개

하나의 점 위로 6개의 선이 무조건 지나감! pi(6개)

파이란 x,y 의 ㄱ,ㄴ,ㄷ???????

- P(DATA|GT)= P(GT|DATA) P(DATA)

ㅡㅡㅡㅡㅡㅡㅡㅡㅡㅡㅡㅡㅡㅡ

P(GT)

네트워크 철학: target - 예측 P(DATA) 이항시킨다.

네트워크는 좌변이 있음 / 벡터만 쓴다

모든 ANN GMM (로스를 구할 수없음, 타겟이 없어서)

MLE -> 초기의 내 억지주장이 말이 되도록 하기 위해 계속 끼워맞춘다

노드가 2개 (2,2)

네트워크!

노드 : 비슷한 데이터를 늘리는 것

- 모든것들을 다 뜯어보면 베이즈다!

확률은 베이즈의 우항을 데이터에 계속 끼워맞춰서 좌항이랑 비슷할꺼야라고 하는것 !

뉴럴렛은 target 아니까 왼쪽 아니까 오른쪽 싹다 이항시켜서 0으로 만드는 것

output은 벡터밖에 안된다

노드를 늘림 (질보다 양으로!)

likelihood (가능도: 있을 수 있는 일)

데이터에 내 분포를 끼워 맞추는 것 - MLE

확률에서는 데이터가 많아야 한다!

로그 likelihood이다 = P(B|A) 내 억지주장

MLE를 1 만들어야함!

likelihood 편견, 가정,

- 확률

통계는 CLT? 엑스바를 이용해서 -

가짜분포와 진짜분포의 차이점?

지식구체 수식추상

선형대수 (병렬로하는지 그냥 하는지 차이? )

대수에 비해 병렬 양이 많아짐 / '교점'도 늘어남 !

점에서 선 늘리는 것/ 양 늘리는 것/ 교점들에 대한 컨트롤