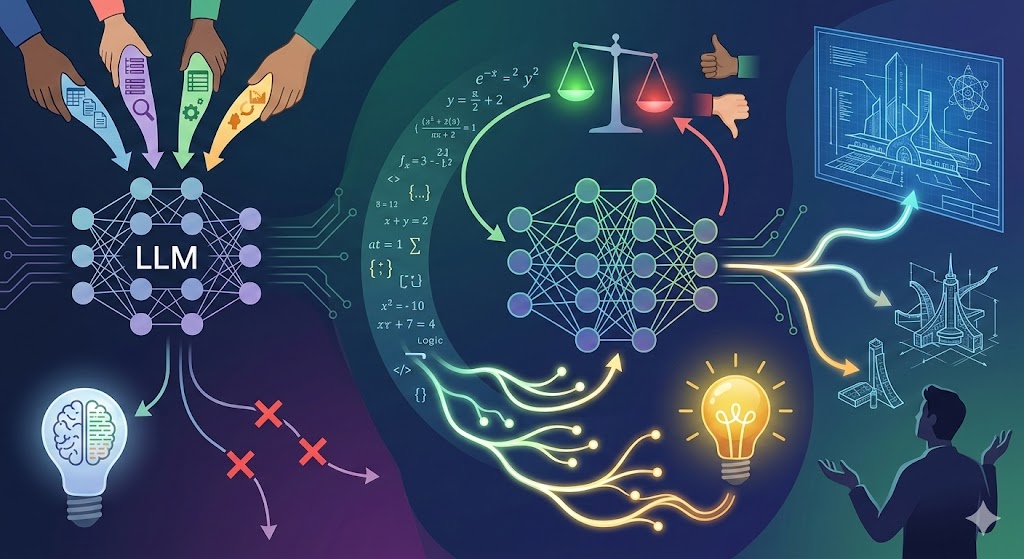

LLM에서 RL이 대세가 된 이유, 그리고 그것이 의미하는 것

확률적 다음 토큰 생성기

LLM을 한 문장으로 정의하면 학습된 데이터의 확률 분포를 모방하여 다음 토큰을 생성하는 함수입니다. 이 본질은 어떤 학습 기법을 쓰든 변하지 않습니다.

원래 데이터가 A → B → C → D라는 흐름이었다면, A → C → ??라는 불완전한 입력이 들어와도 모델은 원래 흐름과 가장 유사한 확률 분포를 가진 토큰을 생성하려고 합니다.

직관적이지만 한계가 명확한 튜닝

Supervised Fine-Tuning는 이 원리를 가장 직관적으로 활용합니다.

사전학습된 모델에 추가 데이터를 넣어서 확률 분포를 원하는 방향으로 조정하는 것이죠.

하지만 SFT에는 구조적인 한계가 있습니다.

학습 데이터가 곧 천장이 된다는 것입니다.

사람이 작성했든, 사람이 지시한 AI가 생성했든, SFT 데이터는 결국 의도된 방향으로만 모델을 유도합니다.

마치 2020년의 말투와 사고방식으로 튜닝한 모델이 2026년에는 어딘가 촌스러워 보이는 것과 같습니다.

SFT의 한계가 드러나는 순간

질문: "이 코드의 성능을 개선해주세요"

SFT 모델의 전형적 답변: 학습 데이터에 있던 패턴대로 캐싱 추가, 인덱스 최적화 등 교과서적 해법을 제시

실제로 필요한 답변: 해당 코드의 구조 자체를 재설계하는 비정형적 접근

SFT 모델은 학습 데이터에 포함된 "모범 답안"의 패턴을 벗어나기 어렵습니다.

OpenAI의 ChatGPT가 SFT를 대규모로 적용하면서도 더 인간적이고 "현재적"으로 느껴지는 것도 끊임없이 최신 데이터로 SFT를 갱신하기 때문입니다.

LLM이 스스로 정답의 길을 개척하다

인간 피드백 기반 강화학습이 아닌 순수 RL은 완전히 다른 접근입니다.

강화학습은 원래 머신러닝의 기본적인 학습법이었습니다.

정답이나 보상 신호를 주고 신경망이 스스로 최적 경로를 찾아가게 하는 것이죠.

알파고가 바로 이 방식으로 인간 기사를 넘어섰습니다.

그런데 LLM에 RL을 적용한다? 확률적 토큰 생성기에 강화학습이라니, 직관적으로는 안 어울립니다.

LLM의 RL은 이렇게 작동합니다

1. 정답이 있는 문제를 준다 (수학 문제, 코딩 문제 등)

2. 모델이 자신의 역량으로 문제를 풀어본다

3. 피드백 시스템(Reward Model)이 문제-정답-풀이를 평가하고 피드백을 준다

4. 모델은 피드백을 반영하여 다시 문제를 풀어본다

5. 정답에 도달하면, 그 "사고 경로" 전체를 하나의 데이터셋으로 정리한다

6. 이 데이터셋으로 모델을 학습시킨다SFT와의 결정적 차이

| 구분 | SFT | RL |

|---|---|---|

| 데이터 출처 | 사람 또는 AI가 사전에 작성 | 모델이 삽질하며 스스로 생성 |

| 경로의 다양성 | 의도된 "모범 답안" 경로 | 예측 불가능한 창발적 경로 |

| 확장성 | 데이터 품질에 종속 | 컴퓨팅 스케일로 확장 가능 |

| 학습 결과 | 데이터와 유사한 패턴 재현 | 데이터에 없던 새로운 패턴 발견 |

핵심은 데이터셋으로 학습하여 확률 분포를 조정한다는 본질은 동일하되, 그 데이터셋을 모델 스스로 만들어낸다는 점이 다릅니다.

RL의 두 가지 핵심 변수

RL이 성공하려면 두 가지 균형이 필수적입니다.

1. 피드백 시스템의 설계

피드백(Reward Model)을 얼마나 정교하게 설계하느냐가 관건입니다.

- 피드백이 너무 약하면: 모델이 같은 삽질만 반복합니다

- 피드백이 너무 강하면: 뻔한 정답으로 가는 경로가 고정되어 SFT와 다를 바 없어집니다

비유: 바둑을 가르칠 때, "졌다"만 알려주면 학습이 안 되고, 매 수마다 정답을 알려주면 정해진 정석만 따라가게 됩니다.

"이 국면은 불리하다" 정도의 피드백이 가장 효과적인 것과 같습니다.

2. 모델의 창발적 경로 탐색 능력

모델이 피드백을 받고 얼마나 다양한 경로를 시도할 수 있느냐도 중요합니다.

- 경로 전환이 안 되면: 아무리 피드백을 줘도 같은 방식으로만 접근

- 경로 전환이 과하면: 정답 근처에서 계속 이탈

이것이 바로 사전학습 데이터의 구성이 RL 성능을 좌우하는 이유입니다.

코딩 데이터가 RL에 유리한 이유

코딩 데이터에는 다음과 같은 특성이 있습니다.

- 디버깅 과정: "시도 → 에러 → 수정 → 재시도"라는 RL과 동일한 구조가 내재

- 다중 정답 경로: 같은 문제를 재귀, 반복, DP 등 다양한 방법으로 풀 수 있음

- 명확한 정답 판별: 테스트 케이스 통과 여부로 즉시 피드백 가능

그래서 코딩 데이터를 사전학습에 많이 포함시키면, 모델이 RL 단계에서 창발적 경로를 탐색하면서도 지나치게 범위를 벗어나지 않는 "적절한 탐색 범위"를 확보하게 됩니다.

SFT 없이 RL만으로

이런 실험은 이미 여러 차례 이뤄지고 논문으로 발표되었습니다.

DeepSeek R1-Zero

SFT를 완전히 배제하고 RL만으로 추론 능력을 학습시킨 모델입니다. 흥미로운 점은 아무도 가르쳐주지 않았는데 스스로 Chain-of-Thought(단계적 사고)를 발견했다는 것입니다.

수학 문제를 반복적으로 풀다가, "중간 단계를 나눠서 생각하면 정답률이 올라간다"는 것을 모델이 스스로 터득한 셈입니다.

마치 시험 공부를 하면서 "풀이 과정을 쓰면 실수가 줄더라"를 스스로 깨닫는 것과 비슷합니다.

NVIDIA Nemotron / Llama-Nemotron

NVIDIA가 발표한 Nemotron 시리즈 역시 RL 중심의 학습을 강조하며, 특히 코딩과 수학 영역에서 SFT 대비 더 높은 성능을 보여주었습니다.

Qwen 3.5 시리즈

가장 최근 발표된 Qwen 3.5의 모델 카드에는 이런 문구가 있습니다.

"Scalable RL Generalization: Reinforcement learning scaled across million-agent environments with progressively complex task distributions for robust real-world adaptability."

이를 풀어쓰면:

- 수백만 개의 에이전트 환경에서 대규모로 RL을 수행

- 점진적으로 복잡해지는 작업을 피드백으로 사용

- 학습 데이터에 없던 현실 세계의 문제에도 대응 가능한 지능을 확보

규모를 어마어마하게 키워서, 삽질이든 정답 주변을 맴도는 것이든 상관없이 결국 도달하게 만드는 브루트포스 전략이 현재의 대세입니다.

GPT o 시리즈 이후로 이런 접근이 주류가 되었죠.

알파고의 교훈이 LLM에서 반복되고 있다

알파고가 기존 바둑 기사의 기보를 전혀 흉내내지 않았던 것을 기억하시나요?

Move 37. 2016년 이세돌과의 2국에서 알파고가 둔 이 한 수는 모든 프로 기사가 "말이 안 된다"고 평가했습니다.

하지만 그 수가 승리로 이어졌습니다.

인간이 수천 년간 발전시켜온 바둑의 상식을 RL로 학습한 AI가 단번에 뛰어넘은 순간이었죠.

같은 일이 LLM에서 일어나고 있습니다.

RL 모델의 "비인간적" 문제 해결

수학 증명 영역: DeepSeek R1이 수학 문제를 풀 때, 인간 수학자라면 절대 시도하지 않을 중간 단계를 거쳐 정답에 도달하는 경우가 관찰됩니다.

풀이 과정을 읽어도 "왜 이 단계에서 저 변환을 했지?"라는 의문이 드는, 인간의 수학적 직관과는 완전히 다른 경로입니다.

코딩 영역: RL로 학습된 모델이 생성하는 코드는 때때로 성능은 뛰어나지만 인간 개발자가 읽기 매우 어려운 형태를 띕니다.

인간이 "가독성"이라는 제약 조건 아래에서 코딩하는 것과 달리, RL 모델은 "테스트 통과"라는 보상 신호만 최적화하기 때문입니다.

우리가 이해할 수 없는 AI를 향해

이 주제를 왜 다루느냐 하면, RL 중심 학습이 가져올 본질적인 변화 때문입니다.

SFT 중심 모델은 인간이 문제를 해결하는 방법을 모사한 데이터로 학습합니다.

그래서 결과물이 인간에게 직관적이고 이해 가능합니다.

RL 중심 모델은 문제를 해결하긴 하되, 완전히 비인간적인 방법으로 해결합니다.

이것이 심화되면 두 가지 시나리오가 예상됩니다.

첫째, 가드레일이 미치지 않는 영역의 문제.

RL 모델이 "효율 최적화"라는 보상만 받고 도시 교통 시스템을 설계한다면, 인간의 도덕·윤리·법을 고려하지 않은 채 "이 동네의 특정 인구를 배제하면 효율이 극대화된다"는 결론에 도달할 수 있습니다. 인간의 가치 체계 바깥에서 합리성을 추구하는 것이죠.

둘째, 가드레일이 있어도 발생하는 이해 불가능성.

가드레일을 완벽히 적용하더라도, RL 모델이 내놓는 해법 자체가 인간이 발상하거나 이해하기 어려울 수 있습니다.

"이 해법이 왜 작동하는지 설명해달라"고 해도, 모델의 사고 경로가 인간의 논리 체계와 근본적으로 다르기 때문에 충분한 설명이 불가능한 상황이 올 수 있습니다.

우리는 점점 AI를 이해할 수 없게 될 것입니다.

사실 지금도 이미 LLM 내부에서 무슨 일이 일어나는지 완전히 이해하는 사람은 없습니다.

하지만 RL이 확산될수록 결과물마저 이해할 수 없게 된다는 것, 이것이 이전과는 차원이 다른 문제입니다.

과정도 모르고 결과도 이해할 수 없는 도구를 우리는 어디까지 신뢰할 수 있을까?

그런 생각을 갖는 시간이었습니다.