1. 클라우드 기반 아파치 카프카 서비스

카프카는 기본적으로 자가 호스팅이 가능한 오픈소스 메시징 플랫폼이지만, 운영 및 유지보수에 대한 부담을 줄이기 위해 SaaS(Software as a Service) 형태로 제공되는 서비스들도 존재한다. 대표적으로는 AWS의 MSK(Amazon Managed Streaming for Apache Kafka)와 Confluent Cloud가 있다.

Confluent Cloud는 카프카의 핵심 개발자인 제이 크렙스가 창업한 기업에서 운영하는 공식 관리형 서비스이다. Kafka 클러스터의 설치, 구성, 운영, 확장, 보안 등을 모두 웹 기반으로 관리할 수 있도록 해준다.

🌟 장점

- Zookeeper, Broker, Topic, Connect 등 인프라 구성을 직접 하지 않아도 됨

- Kafka 클러스터의 생성을 클릭 몇 번으로 완료할 수 있고 토픽 생성, 삭제, Connect 설정, Schema Registry 관리 등도 웹 UI 기반으로 수행 가능

- AWS, GCP, Azure 등 원하는 클라우드 환경에서 실행 가능

- Kafka를 직접 운영할 때 흔히 발생하는 설정 이슈(토픽 리텐션, 파티션 조정, ACL 등)나 운영 노하우 부족에서 오는 시행착오를 줄일 수 있음

REST API를 통해 Kafka Connect를 동적으로 설정할 수 있기 때문에, 지속적으로 커넥터 기반 파이프라인을 확장해야 하는 환경에서는 직접 개발 없이도 자동화된 구성이 가능하다.

✔️ Confluent Cloud와 같은 SaaS 기반 Kafka 서비스를 도입하면 스트리밍 플랫폼 운영에 대한 부담을 줄이고 실제 데이터 처리와 서비스 로직 구현에 집중할 수 있는 개발 환경을 구축할 수 있다‼️

2. 빅데이터 플랫폼 아키텍처와 카프카

➡️ 초기 빅데이터 처리 방식

각 서비스 애플리케이션으로부터 데이터를 배치방식으로 수집해 일괄 처리하는 구조였다.

⚠️ 실시간 데이터 반영이 느리고, 파편화된 데이터로 인해 데이터의 흐름과 히스토리를 추적하기 어려운 단점이 있었다.

+개인정보 보호, 데이터 품질, 생명주기 등을 체계적으로 관리하는 데이터 거버넌스 측면에서도 유연성이 부족했다.

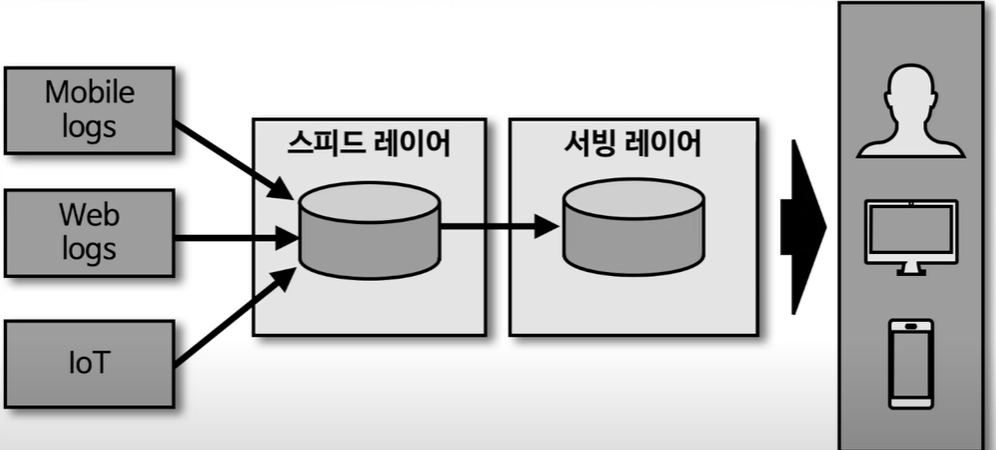

➡️ 람다 아키텍처

람다 아키텍처는 다음 세 가지 계층으로 구성된다:

- 배치 레이어: 과거 데이터를 모아 일정 주기로 일괄 처리

ex) Spark job - 스피드 레이어: 실시간 데이터 분석을 위한 계층 ex) Kafka

- 서빙 레이어: 처리된 데이터를 외부 서비스가 접근할 수 있도록 저장

실시간성과 정확도를 동시에 만족시키기 위한 목적이었지만

⚠️ 동일한 로직을 배치/실시간에 각각 구현해야 한다는 이중 관리 문제

디버깅, 배포, 모니터링 역시 두 시스템을 별도로 다뤄야 하는 번거로움이 있었다.

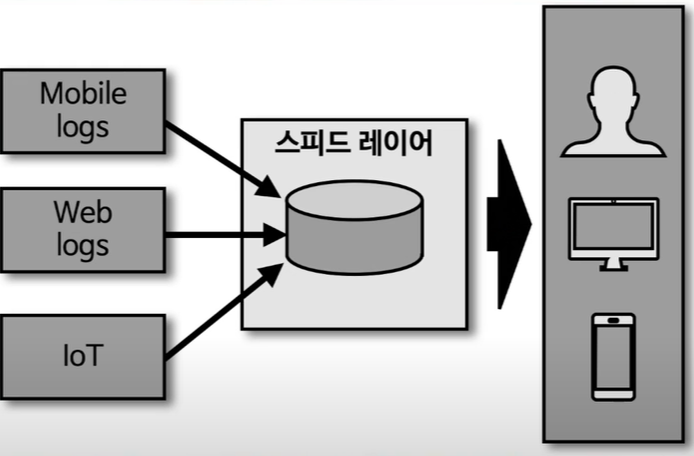

➡️ 카파(Kappa) 아키텍처

배치 레이어를 제거하고 모든 데이터를 스트리밍 기반의 스피드 레이어에서 처리하도록 구성한다.

즉 Kafka를 중심으로 운영하는 것이다. 스트리밍 처리 하나로 데이터 파이프라인을 단순화할 수 있다는 장점이 있다.

➡️ Streaming Data Lake 아키텍처

서빙 레이어마저 제거! Kafka를 일시적인 메시지 큐가 아닌 장기 저장과 쿼리 분석이 가능한 데이터 레이크처럼 사용하자는 발상!

💡 이를 위해선 두가지를 갖추어야한다.

1. 스트리밍 데이터를 배치처럼 조회할 수 있어야 한다

2. 자주 조회하지 않는 데이터는 저렴한 저장소로 자동 이전하는 기능이 필요하다

이러한 개선이 아직 진행 중이긴 하지만 Kafka가 스트리밍부터 저장,분석까지 아우르는 중심 플랫폼으로 진화하고 있다는 흐름은 분명하다.

가까운 미래에는 Kafka가 단순한 메시지 브로커가 아니라 완전한 빅데이터 플랫폼의 핵심 엔진으로 자리 잡을 가능성이 높다고 한다.

3. 아파치 카프카의 미래

카프카는 왜 이렇게까지 많이 쓰일까? 그리고 앞으로도 계속 쓰일까?

결론은 🅾️

이미 너무 많은 기업들이 핵심 데이터 파이프라인에 카프카를 사용하고 있다.

원래 카프카는 링크드인 내부에서 여러 메시지 시스템들을 붙여 쓰다가 “너무 복잡하고 유지보수 힘들다”는 이유로 만들기 시작한 거였다.

그때의 문제는 지금도 여전히 많은 기업들이 겪고 있는 문제다.

그래서 Kafka는 지금도 "필요한 기술"로 받아들여진다.

🌟특히 좋은 점은

- 데이터를 엄청 빠르게 보낼 수 있다.

- 서버만 늘리면 확장도 쉽다.

- 컨슈머가 읽어가도 데이터가 사라지지 않아서 여러 팀에서 동시에 써도 괜찮다.

이런 특성 덕분에 카프카는 네이버, 카카오 같은 대기업은 물론 빠르게 성장하는 스타트업에게도 많은 관심을 받고 있다고 한다.

초기에는 작게 시작해서 쓰다가 나중에 서비스가 커지면 그대로 확장하면 되니까 부담도 없다.

📢 요즘은 Kafka 본체만 쓰는 게 아니라

-> Kafka Streams, Connect, ksqlDB 같은 기능도 계속 늘어나고 있다.

심지어 웹에서 토픽을 만들고, 커넥터를 붙이고, 모니터링까지 할 수 있는 SaaS 서비스도 나와 있다.

즉, 카프카는 단순한 메시지 큐가 아니라 실시간 데이터 플랫폼으로 계속 진화 중이다.

앞으로도 실시간 로그, 트래픽 분석, 추천 시스템처럼 데이터를 빨리 다뤄야 하는 곳에서는 더 자주 쓰이게 될 거다.

✔️ 결론?

개발자로 일한다면 언젠가는 꼭 마주하게 될 기술이니까 가볍게라도 알아두자!!