경량화

1.[LoRA] 하이퍼파라미터 정리

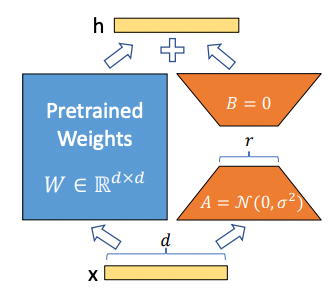

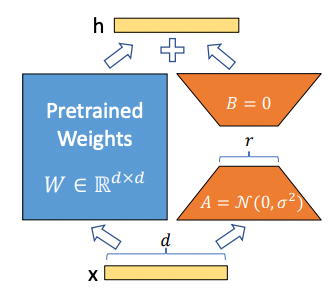

LoRA는 대형 언어 모델(LLM)의 일부 선형 변환 레이어에 “저용량 어댑터”를 추가하여, 모델 파라미터를 거의 건드리지 않으면서 새로운 태스크로 미세 조정(fine-tuning)할 수 있는 기술입니다.장점: 전체 모델을 재학습·저장할 필요 없이, 어댑터(작은 행렬)

2025년 6월 29일

LoRA는 대형 언어 모델(LLM)의 일부 선형 변환 레이어에 “저용량 어댑터”를 추가하여, 모델 파라미터를 거의 건드리지 않으면서 새로운 태스크로 미세 조정(fine-tuning)할 수 있는 기술입니다.장점: 전체 모델을 재학습·저장할 필요 없이, 어댑터(작은 행렬)