< 머신러닝 3주차 >

[수업 목표]

- 딥러닝의 역사를 배운다.

- 신경망을 만드는 데 필요한 각종 개념을 알아본다.

- 신경망을 직접 디자인해본다.

딥러닝이란?

- 머신 러닝의 한 분야

딥러닝의 다른 단어 표현

1. 딥러닝(Deep learning)

2. Deep neural networks

3. Multilayer Perceptron(MLP)

-

딥러닝의 주요 개념과 기법

- 배치 사이즈와 에폭

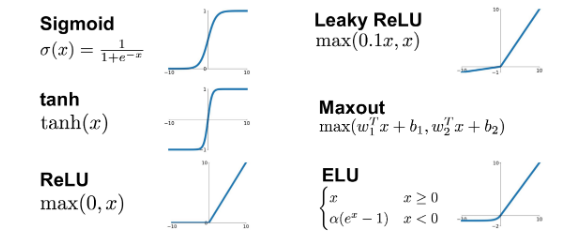

- 활성화 함수

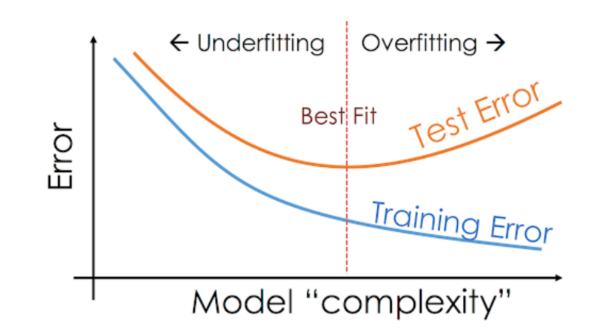

- 과적합과 과소적합

- 데이터 증강

- 드랍아웃

- 앙상블

- 학습률 조정

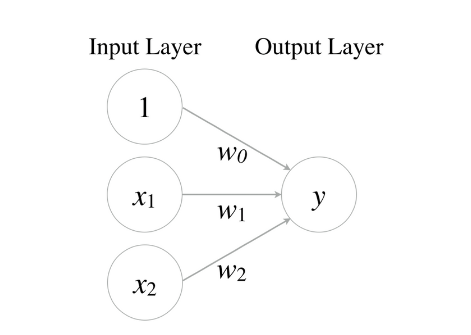

XOR 문제를 풀기 위해선 직선하나만 있으면 되는데 아래의 수식을 쓰고 그림으로 나타내면

- 이런모양을 Perceptron(퍼셉트론) 이라고 부른다.

- w0,w1,w2의 값만 잘 지정해주면 원하는 출력을 계산할 수 있다.

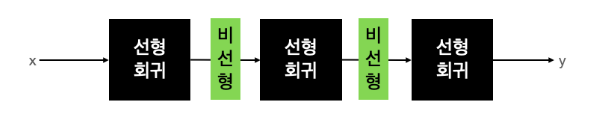

선형회귀로는 AND,OR 문제를 풀 수 있지만 XOR은 풀지 못하기에 '퍼셉트론'을 여러개 붙인

'Multilayer Perceptrons (MLP)'를 도입해 문제를 해결한다.

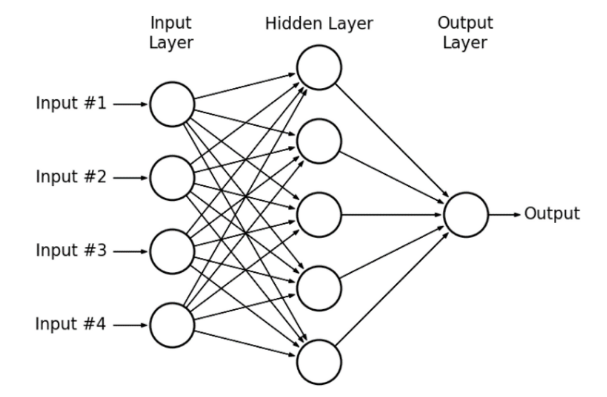

< 딥러닝 네크워크 구조 3가지 >

- Input layer(입력층): 네트워크의 입력 부분입니다. 우리가 학습시키고 싶은 x 값입니다.

- Output layer(출력층): 네트워크의 출력 부분입니다. 우리가 예측한 값, 즉 y 값입니다.

- Hidden layers(은닉층): 입력층과 출력층을 제외한 중간층입니다.

데이터셋을 작은 단위로 쪼개는 것을 'Batch'라고 한다.

데이터셋을 몇번 쪼개고 몇번 반복하는 과정을 'Iteration'이라고 한다.

쪼갠다음 몇번 반복한다라고 할때 그 반복 학습을 'epochs'라고 한다. ex) 100번 반복 - 100 epochs

- 가장 보편적으로 쓰는 함수는 ReLU(렐루)이다. 이유는 학습이 빠르고 연산 비용이 적고, 구현이 간단하기 때문이다.

- 과적합을 해결할 가장 좋은 방법은 '데이터 증강기법'을 적용시킨다. ex) 이미지 한장을 여러가지 방법으로 복사를 한다.

Dropout (드랍아웃)

- 각 노드들이 이어진 선을 없애버린다. (필요이상의 불필요한 선을 차단시킨다.)

Ensemble(앙상블)

- 딥러닝 모델을 만들어 학습시킨 후 투표하는 방법 (랜덤 포레스트 기법이랑 비슷)

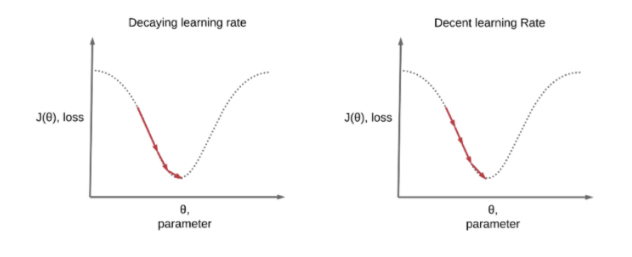

Leraning rate decay

- Local minimum에 빠르게 도달하고 싶을 때 사용.