모두를 위한 딥러닝 시즌 1

1.모두를 위한 딥러닝 시즌 1 ML lec 5

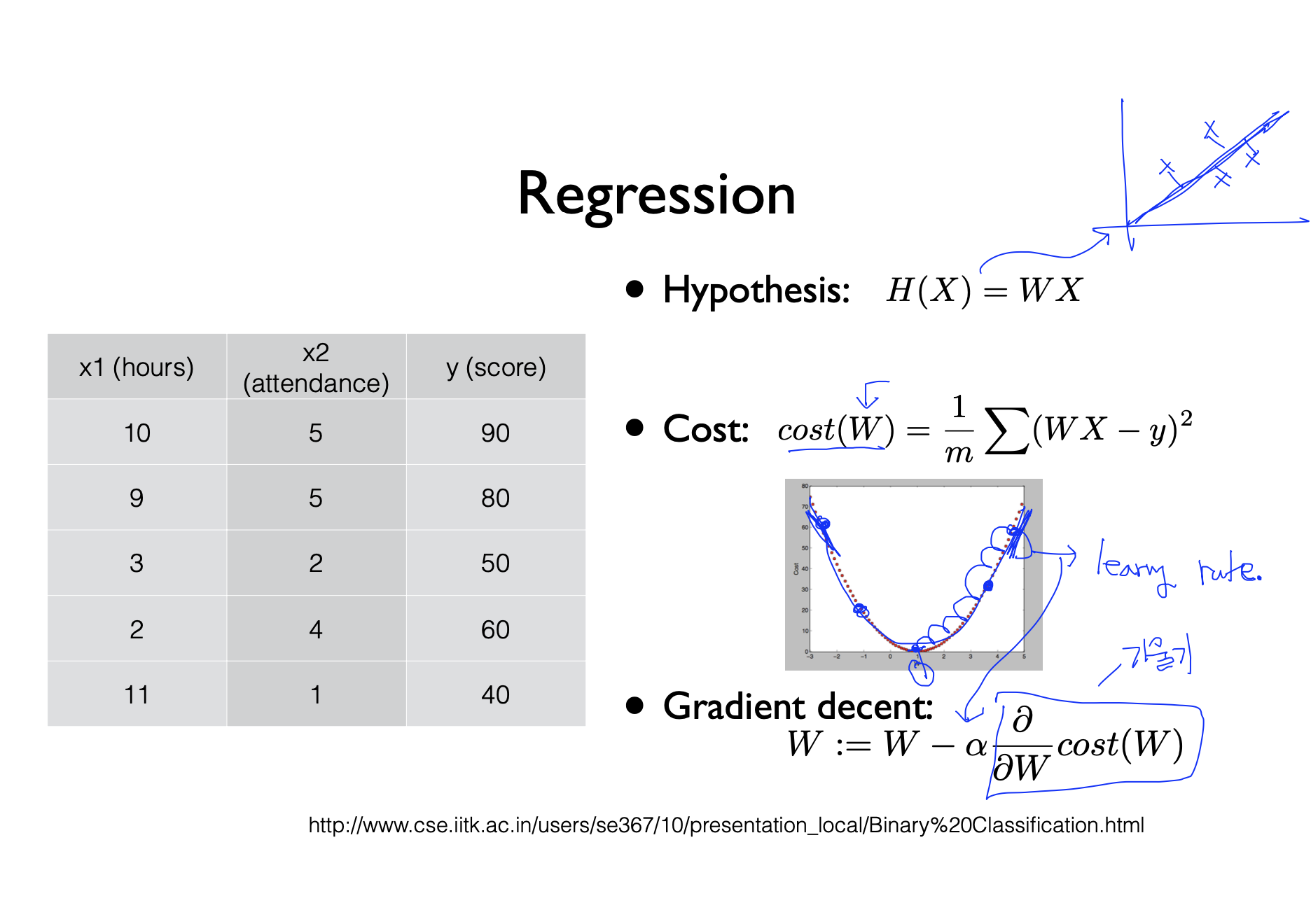

Lecture 5 -1 Logistic (regression) classification 분석은 다음과 같은 함수를 사용한다. 이때 Cost 함수는 가장 최소인 W의 값을 찾기 위한 함수이다. Cost함수에서 시그마 뒤에 나오는 부분은 가설과 실제값 차이가 얼마인지를 파악하기 위함이다. learning rate는 step의 사이즈이다. 그림에서 learn...

2021년 12월 29일

2.모두를 위한 딥러닝 시즌 1 ML lec 6

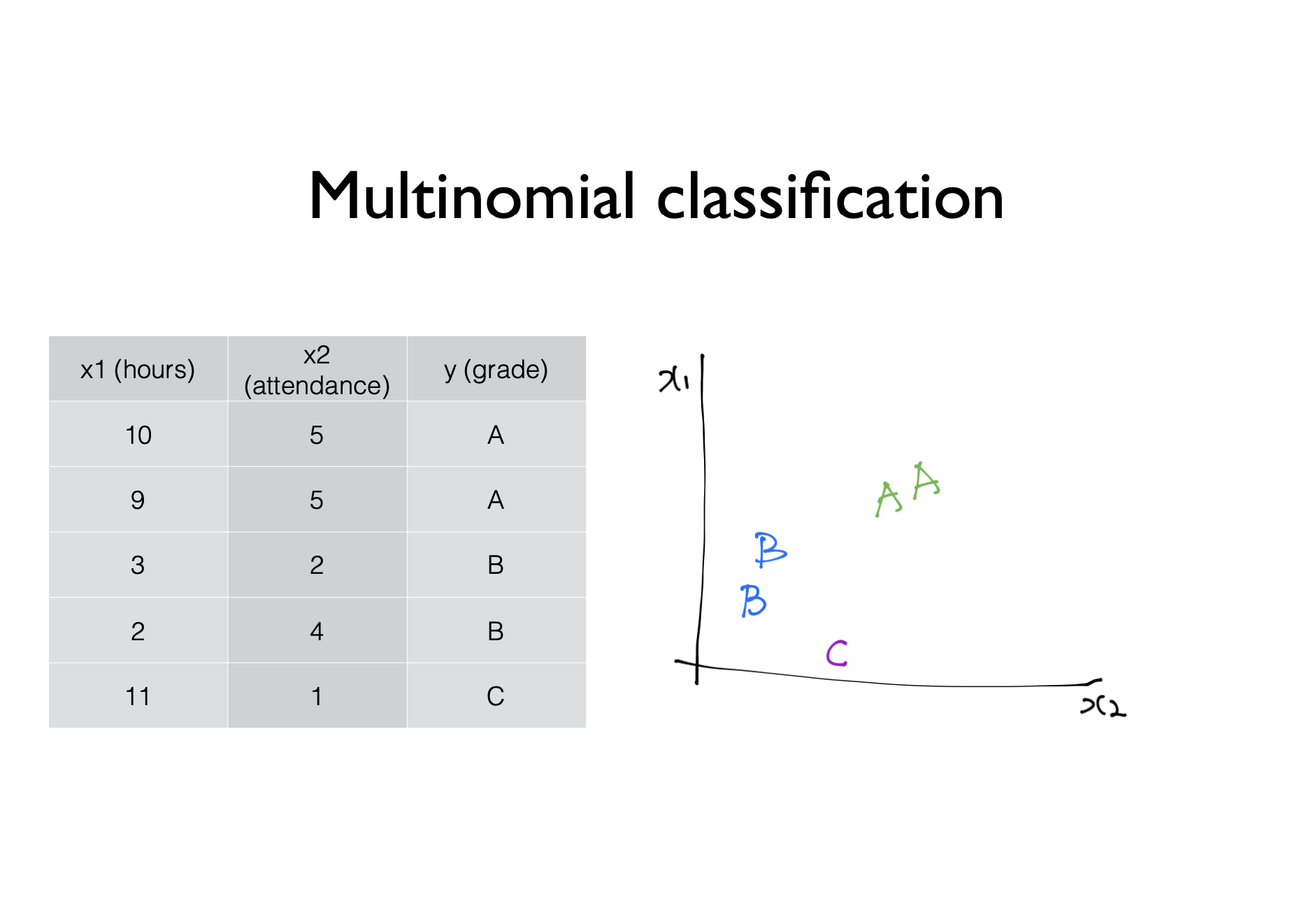

저번 강의에서 우리는 binary classification에 대해 공부했었다. binary classification은 한가지 기준으로 그렇다/아니다를 판별하는 것이었다. 그런데 2가지 이상에 대해서 판별하려면 어떻게 해야할까?

2021년 12월 29일

3.모두를 위한 딥러닝 시즌 1 ML lec 7

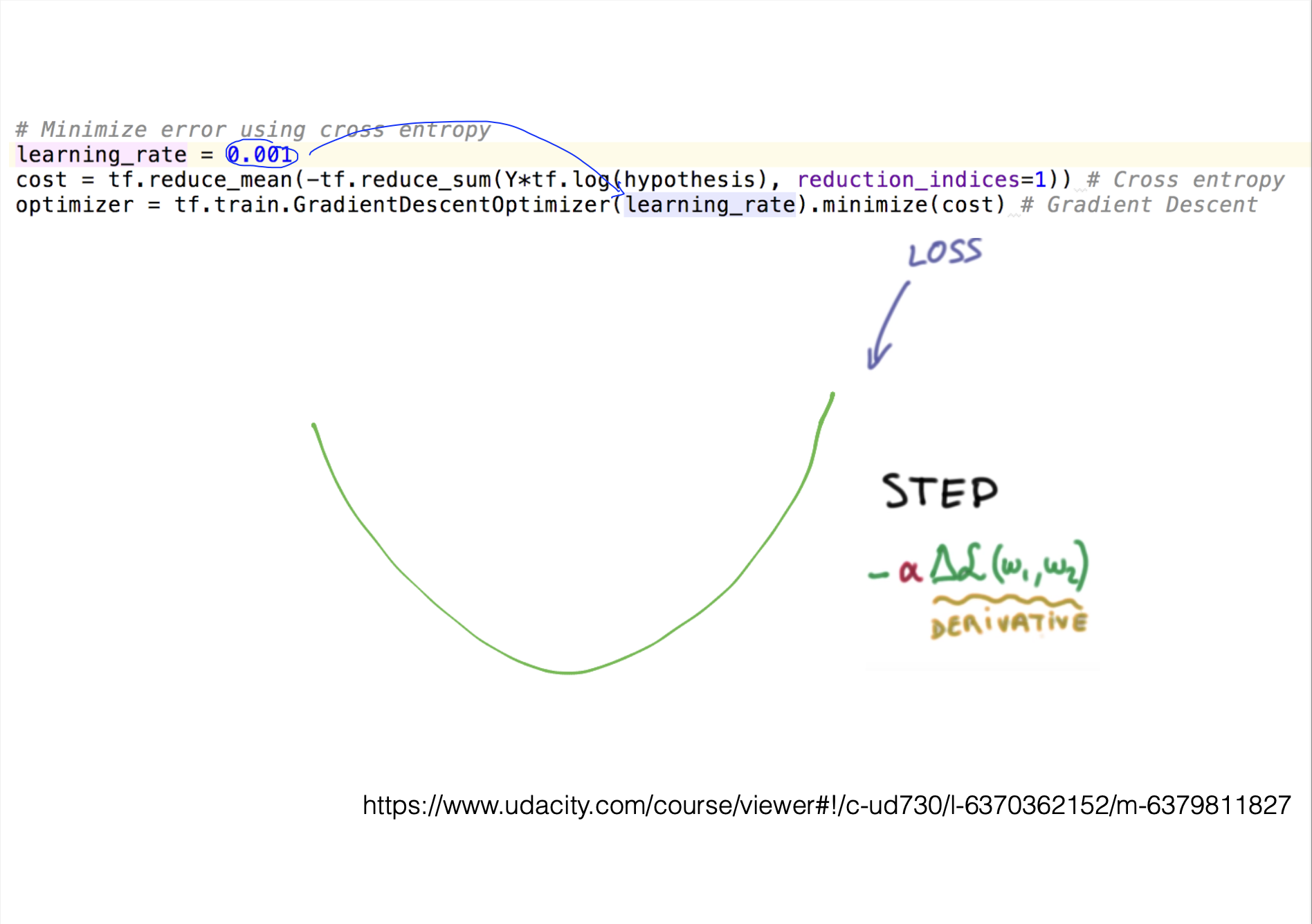

저번 시간에 Cost 함수에 대해 배우고 Gradient descent은 못하고 지나쳤는데 이번 강의는 이에 대해 배운다. 우리는 Gradient descent 함수를 Cost 함수를 정의하고 값을 최소화하기 위해 사용한다.

2021년 12월 29일

4.모두를 위한 딥러닝 시즌 1 ML lec 8

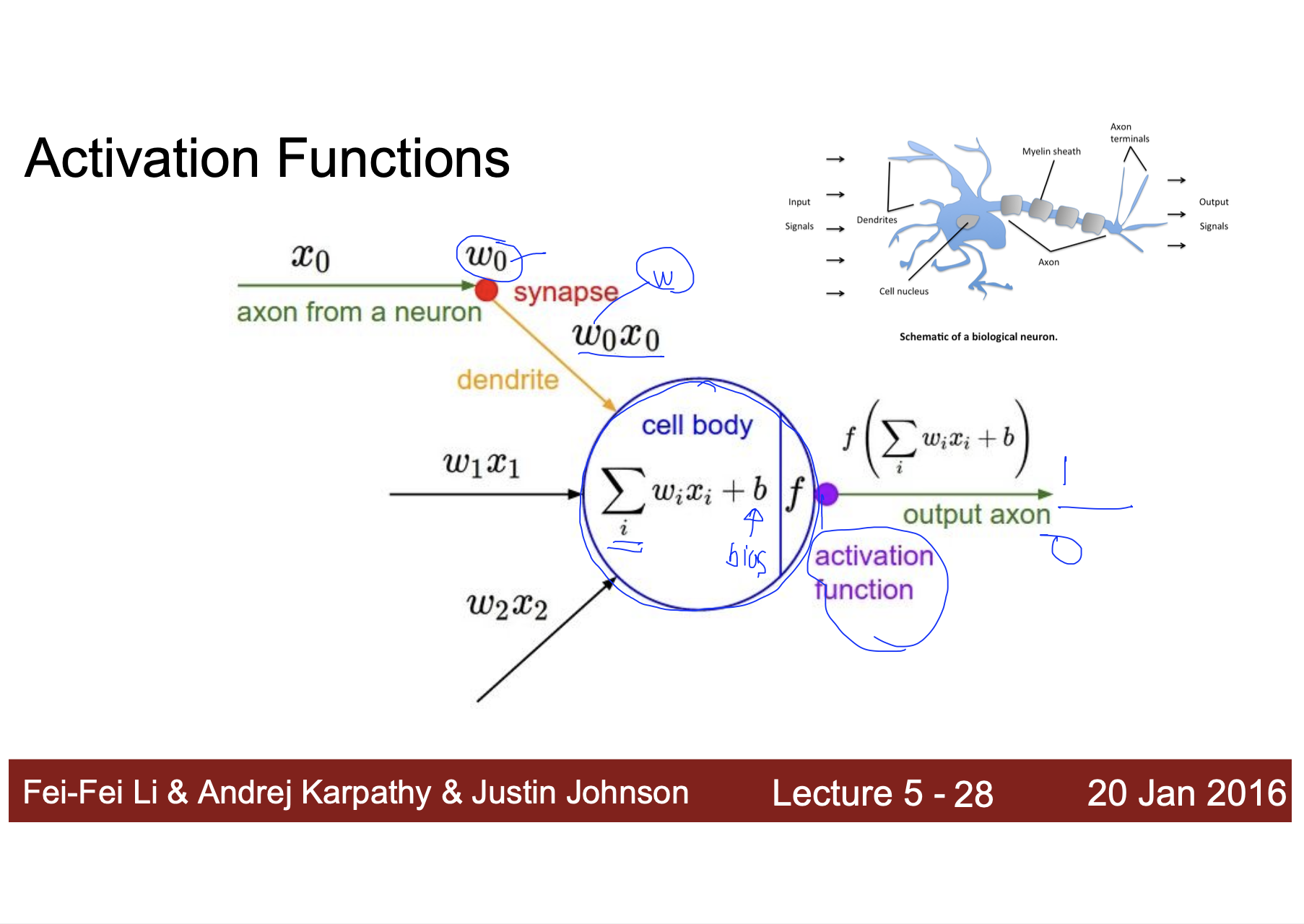

사람의 뇌는 수많은 뉴런으로 구성되어 있다. 하나의 뉴런들은 간단한 일들을 담당하지만 여러개의 뉴런이 모여 우리는 복잡한 일을 수행한다. 딥러닝은 뉴런에서 아이디어를 받아 시작되었다. 뉴런의 일을 생각해서 만든 식은 다음과 같다.

2021년 12월 29일