확률(probability)은 모든 일어날 수 있는 경우의 수 가운데 어떤 일이 일어날 가능성, 즉 범위가 [0,1]이다.

확률 분포(Probability Distribution)는 모든 가능한 결과들과 각 결과에 대응하는 확률을 나타내는 함수이다.

정리하면 확률은 단일 사건에 대한 값을 나타내지만, 확률분포는 모든 가능한 결과(확률)에 대한 '함수'를 의미한다.

변수 x에 대한 P(x)가 확률 분포를 뜻하며, 특정 사건 A에 대한 P(A)는 확률을 의미한다.

- 매개 변수 에 대한 x의 확률분포 (pdf of x parameterized by )

- 매개 변수 는 확률 변수일 수도 있고, 아닐 수도 있다.

- x는 확률 변수이다.

- 가 주어졌을 때 x의 주건부 확률 분포(pdf of x given )

- x와 는 반드시 확률 변수이다.

- x, 가 동시에 발생할 결합 확률 분포(joint pdf of x, )

- x와 는 반드시 확률 변수이다.

- 두 확률 변수 x와 는 일반적으로 서로 독립이 아니며 종속이다. (독립이면 P(x)P()로 작성하기에)

- 곱규칙으로 다음과 같이 나타낼 수 있다.

Bayes Theory(베이지안 룰)

는 우리가 추정하고자 하는 매개변수를 뜻한다. 는 실제로는 고정된 값이지만, 우리는 이 값을 정확히 알지 못하기 때문에 불확실성을 갖고 추정하고 싶어하는 값이다.

X는 이미 갖고 있는(관측한) 관측 데이터이다. (X를 1회 관측한 데이터 x들에 대한 집합 데이터를 의미) 관측치 X는 우리가 추정하고 싶은 에 대한 불확실성을 없애는 데이터로 사용된다.

: posterior probability, 사후 확률

- 사후 확률은 데이터 X를 관찰한 후의 에 대해 업데이트 된 확률을 의미한다.

- 데이터 X를 관측했을 때의 파라미터()의 확률이다.

: likelihood, 우도

- 주어진 매개변수 에서 데이터 X가 관찰될 확률을 의미한다. 이는 데이터가 특정 매개변수 값에서 얼마나 잘 설명되는지를 나타낸다.

- 중요한 점은 우도가 조건부 확률의 형태를 취하고 있지만 실제로는 확률이 아니라 값이라는 점이다. 따라서 확률과는 다르게 범위는 [0,]이다.

- 값이 클수록 주어진 매개변수 가 데이터 X에서 적합하다.

: prior probability, 사전 확률

- 사전 확률은 특정 매개변수 에 대한 사전 지식을 의미한다.

- 와닿지 않을 수 있는데, 업데이트를 하기 이전에 초기 값으로 생각하는 것이 적당하다.

: 증거(Evidence) 또는 주변확률(Marginal Probability)

- 모든 가능한 에 대해 데이터 X가 관찰될 전체 가능성을 얘기한다.

- P(X)는 정규화 상수로서 사후 확률 가 0과 1 사이의 값을 가지도록 정규화하는 역할이다. 따라서 우도의 범위가 [0,]의 범위로 가능하다.

- 일반적으로 최적화 시에 상수 취급한다. (추정하고자 하는 와 무관하기 때문에)

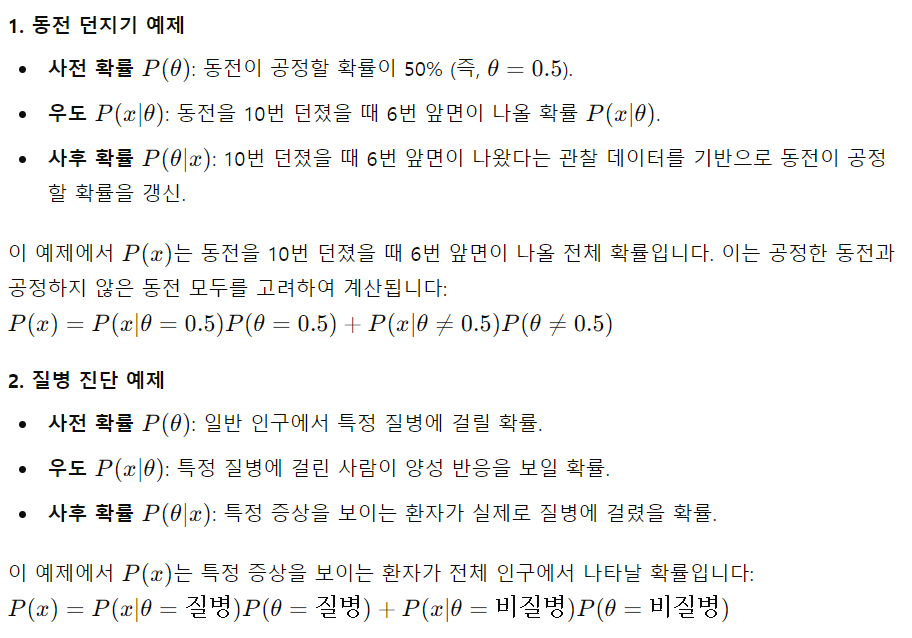

예제

MLE vs MAP

MLE(Maximum Likelihood Estimation)

- 가 최대가 되는 어떤 변수()를 찾는 방법이다.

- X는 관측치이기에 고정되어 있고, 이러한 고정된 X를 잘 설명하는 를 찾는 것이다.

- 주로 계산의 편의를 위해서 조건부 독립임을 가정하고 로그를 취해 합산 연산으로 계산한다.

위 식에서 집합 X의 하위 원소 는 조건부 독립임을 가정한다.

조건부 독립임이 가정되면 아래와 같이 작성이 가능하기 때문이다.

만약 조건부 독립이 가정되지 않으면 2번째과 3번째 항 사이의 동등함이 성립하지 않는다.

MAP(Maximum A Posteriori Estimation)

- 사후 확률은 가 최대가 되는 어떤 변수()를 찾는 방법이다.

- P(x)는 정규화를 위한 상수이기에 비례식에서는 중요치 않아 우도와 사전 확률에 비례하게 찾는다.

- 가 모두 같은 값인 uniform distribution일 때 최적화할 때, MLE와 동일한 값을 갖는다.

- 주로 계산의 편의를 위해서 조건부 독립임을 가정하고 로그를 취해 합산 연산으로 계산한다.

MLE와 least square solution

최소 제곱법(least square solution)

- 데이터에 대한 모델의 적합도를 평가하고 최적의 매개변수를 찾기 위해 사용되는 방법 중 하나이다.

- 선형대수학에서의 최소 제곱법이다.

cost function E를 위와 같이 정의한다.

여기서 x는 관측 데이터, A는 파라미터 를 x와 같은 유형의 데이터(차원)로 바꿔주는 함수이다.

여기서 를 구하려고 한다.

2차 (아래로 볼록) 함수인 E를 파라미터 에 대해 미분한 값이 0이 되게 한다. (극솟값 찾기)

식을 정리하면 아래와 같이 나온다.

가 역행렬을 구할 수 있을 시 넘기면 아래와 같은 식이 나온다.

이러한 방식으로 최적의 값을 구하는 방법이 최소 제곱법이다.

MLE와 최소 제곱법의 동등함

, ~로 엡실론이 평균이 0, 분산이 인 정규분포를 따른다고 가정하자. (엡실론은 가우시안 분포를 따르는 노이즈)

그럼 우도 함수는 다음과 같이 정규분포 식으로 표현할 수 있다.

(조건부 독립 가정)

( 가정, 로 이루어진 행렬 : )

양변을 로그로 취하고 -1씩 곱한다. (negative log)

는 상수이기 때문에 고정된 값이다.

따라서, 를 제외하고는 고정된 값이므로, 해당 값만 최적화하면 된다.

원래 MLE는 Maximize 였지만 양변에 -1씩 곱했으므로 Minimize한다.

이는 최소 제곱법과 cost function이 같아진다.

Reference

https://niceguy1575.medium.com/mle%EC%99%80-map%EC%9D%98-%EC%B0%A8%EC%9D%B4-7d2cc0bee9c

https://sanghyu.tistory.com/10

https://alida.tistory.com/92