🏆 학습목표

- N411. 신경망과 퍼셉트론의 개념 학습 - 구조, 입출력, 학습

- 퍼셉트론(Perceptron)을 이해하고 python으로 구현할 수 있다.

- 신경망(Neural network)의 원리를 이해하고 기본적인 구조를 예를 들어 신경망을 설명할 수 있다.

- 신경망이 학습된다는 개념을 이해한다.

- 신경망의 장점과 단점

🌈Warm up

1.과적합(overfit)

- 슈퍼모델 사이즈에 맞춘 바지, 일반인은 못 입는다.

- 다양한 체형을 고려한 decision boundary필요.

- 극복 : regularization, Cross Validation, 많은 데이터

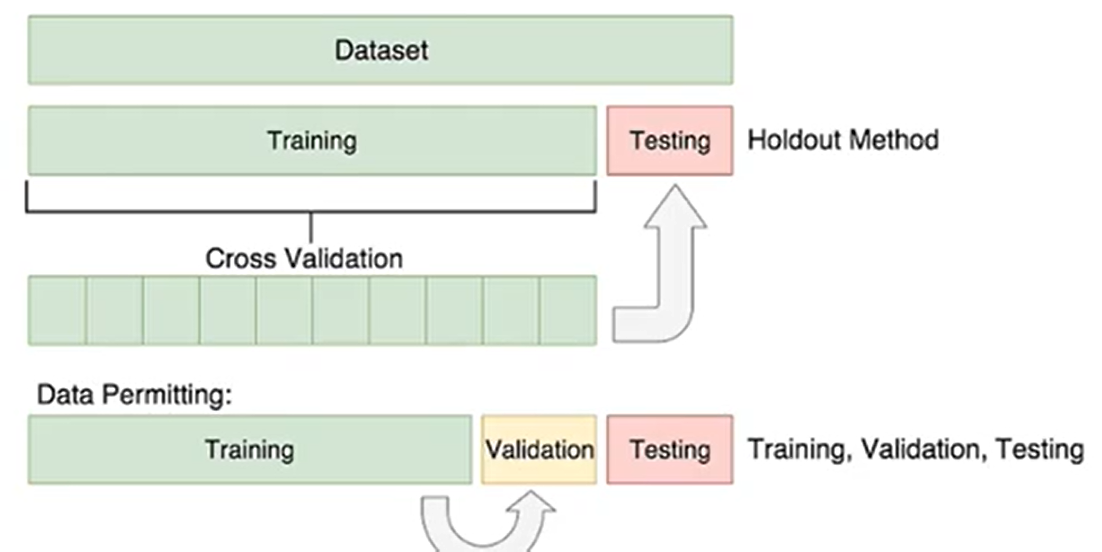

2.교차검증(cross validation)

- k개로 나눔 => 하나를 테스트셋으로 빼놓고 나머지를 훈련함 => 훈련 결과 토대로 테스트셋에 테스트해봄 => 모든 결과를 평균냄

- k번이나 실험할 수 있음. 데이터 양이 적을 때 용이.

3.data split & shuffle for ML

-

데이터 셔플은 나눠진 데이터의 쏠림이나 패턴을 피하기 위해 아주 중요. 데이터를 섞는것은 머신러닝 모델의 퀄리티 향상에 도움을 주고 예측 또한 향상시킴.

새 칼럼 만들어 랜덤한 숫자를 부여한 뒤 그 칼럼 기준으로 정렬하기 -

데이터 스플릿

데이터를 두 부분으로 나누는 것. 교차검증할 때 많이 씀.

한 부분은 예측 모델 만들 때 쓰고 다른 부분은 모델 퍼포먼스 평가할 때 쓴다. -

CV: 과적합 방지를 위해

🔥Class

퍼셉트론이란?

다수의 입력신호를 받아 하나의 신호를 출력

입력값들이 여러가지가 있음. (like 후각, 시각, 청각 등등..)

신경망을 이루는 가장 기본 단위

- 신호

LIKE 전류, 강물. 흐름을 만들고 정보를 앞으로 전달함.

BUT 실제로 흐르진 않고 0, 1로 표현

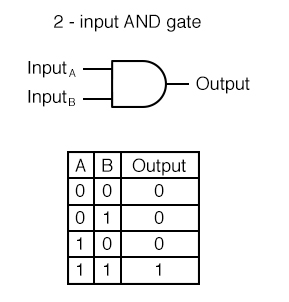

단순한 논리 게이트로 본 퍼셉트론

- AND GATE

입력신호가 모두 1일 때 1을 출력 - NAND GATE

AND gate의 결과의 반대, Not AND - OR GATE

입력신호가 하나만 1이어도 1을 출력 - XOR GATE < 퍼셉트론으로 못풀어서 새로운 방법 고안

입력신호가 다를 때 1을 출력

신경망의 기본 구조

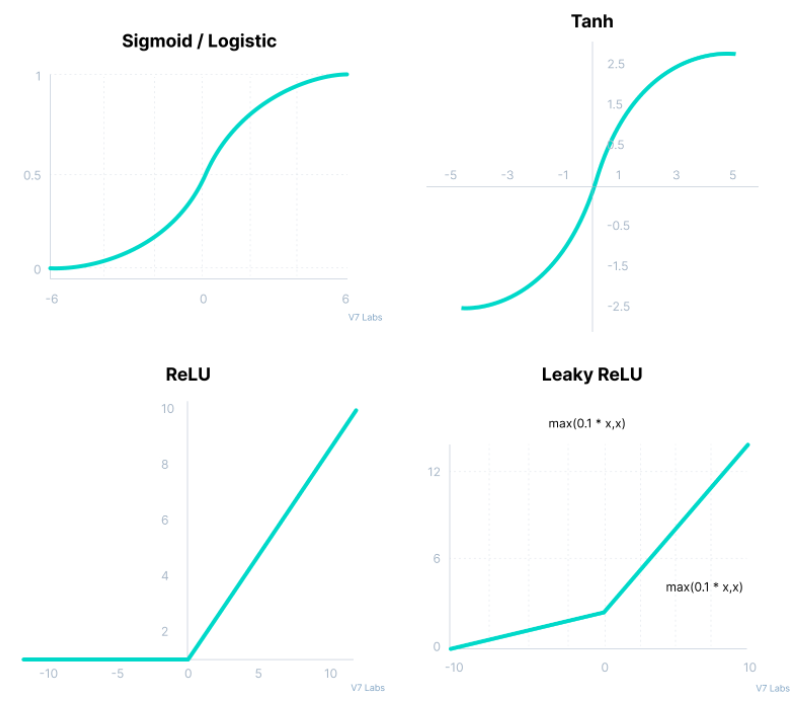

- ✨활성화함수(Activation function)

Step Function

Sigmoid Function

ReLU(Rectified Linear Unit)

Softmax

- Tensorflow 신경망 예제

Value normalization

Min-Max Normalization

Z-Score Normalization

model.compile 손실 파라미터

binary_crossentropy

categorical_crossentropy

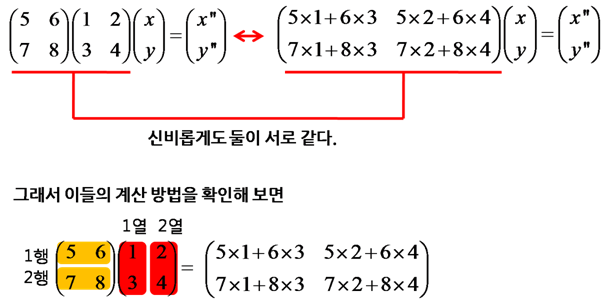

❗ 행렬의 곱셈

A * B

A의 열과 B의 행은 같아야 함 그래야 곱셈가능

| A | 1 | 2 |

|---|---|---|

| 1 | ||

| 2 |

x

| B | 1 |

|---|---|

| 1 | |

| 2 |

👩햄버거 3개, 콜라 2개 구입

| 🍔 | 🥤 | |

|---|---|---|

| M사 | 1500 | 1000 |

| L사 | 1000 | 500 |

| A | |

|---|---|

| 🍔 | 3 |

| 🥤 | 2 |

| 지불금액 |

|---|

| M사 = 6500 |

| A사 = 7000 |

M사: 1500 x 3 + 1000 x 2 = 6500

L 사: 2000 x 3 + 500 x 2 = 7000

python으로 신경망 제작

- 신경망 연산

신경망 층 (Layer)- 입력층 (Input Layers)

노드의 개수를 조절할 수 없다. 입력값에 따라서 자동으로 정해지는 값이기 때문이다. - 은닉층 (Hidden Layers)

노드의 개수는 모델을 구축하는 사람이 직접 설계할 수 있다. - 출력층 (Output Layers)

노드개수, 모양에 따라서 모델의 정의가 달라질 수 있다.

- 입력층 (Input Layers)

넘나 TMI

부트캠프 중에 심한 좌절감을 느끼고 하차 체크인까지 신청했다 ㅠㅠ

하지만 같은 공부를 하는 분들이 이거 원래 어려운 거라고

몇 년을 공부해도 어려운 거니까

단순히 어렵다는 이유만으로는 하차 안했으면 좋겠다고 그랬다.

그래서 마음을 다시 다잡았다.

동기가 중요하다. 처음에 이걸 왜 시작했는지. 그거 하나 보고 버티는거다.

이미지 딥러닝 이건 내가 해보고싶었기 때문이다.

엉망진창인 모래성이어도 완성하는게 아무것도 없는 모래밭보단 낫지 않을까?

그만둘거라고 팽팽 놀아서 다시 시작하려니 골치아프지만 그래도 따라잡아보자 ㅠㅠ!