논문 제목: NeuroDiff: Scalable Differential Verification of Neural Networks using Fine-Grained Approximation

📕 Summary

Abstract

이 논문은 안전이 중요한 시스템에서 매우 중요한 구조적으로 유사한 신경망의 차등 검증 문제를 다룹니다.

저자들은 피드포워드 ReLU 네트워크에서 미분 검증의 정확도와 계산 효율성을 크게 향상시키는 기호적이고 세분화된 근사화 기법인 NeuroDiff를 제안합니다.

Introduction

이 논문은 특히 잘못된 동작이 치명적인 결과를 초래할 수 있는 안전이 중요한 시스템에서 원본 신경망과 압축 신경망의 동등성에 대한 공식적인 보장의 중요성을 강조하며, 신경망을 검증하거나 테스트하는 기존 기법은 단일 네트워크 검증에 초점을 맞추거나 미분 검증을 위한 느슨한 근사치를 제공하는 등 동등성에 대한 공식적인 보장이 부족하다고 지적하고 있습니다.

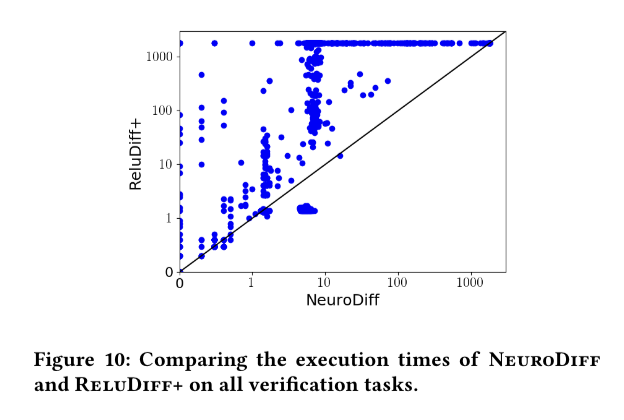

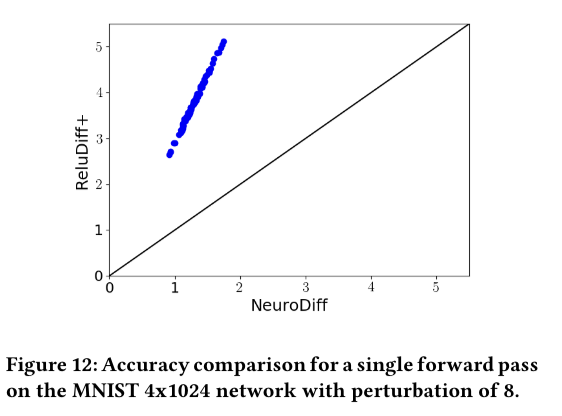

이 논문에서는 피드포워드 ReLU 네트워크에서 미분 검증의 정확도와 계산 효율성을 크게 향상시키는 기호적이고 세분화된 근사 기법인 NeuroDiff를 소개합니다. NeuroDiff는 새로운 볼록 근사법과 기호 변수를 활용하여 오류가 누적된 뉴런을 표현함으로써 최첨단 도구인 ReluDiff에 비해 정확도와 속도가 향상되었으며, 실험 평가를 통해 NeuroDiff가 기존 방법보다 최대 1000배 빠르고 5배 더 정확하다는 것을 입증했습니다.

📕 Solution

Algorithm

이 논문은 신경망의 차등 검증을 위한 기호적이고 세분화된 근사 기법인 NeuroDiff를 제안합니다. 두 네트워크 간의 차이를 보다 정확하게 경계 짓기 위해 새로운 볼록 근사법을 도입하고, 오차가 누적된 뉴런을 표현하기 위해 기호 변수를 사용하며, 저자는 NeuroDiff를 최첨단 도구인 ReluDiff와 비교하여 차등 검증 작업에서 뛰어난 속도와 정확성을 입증합니다.

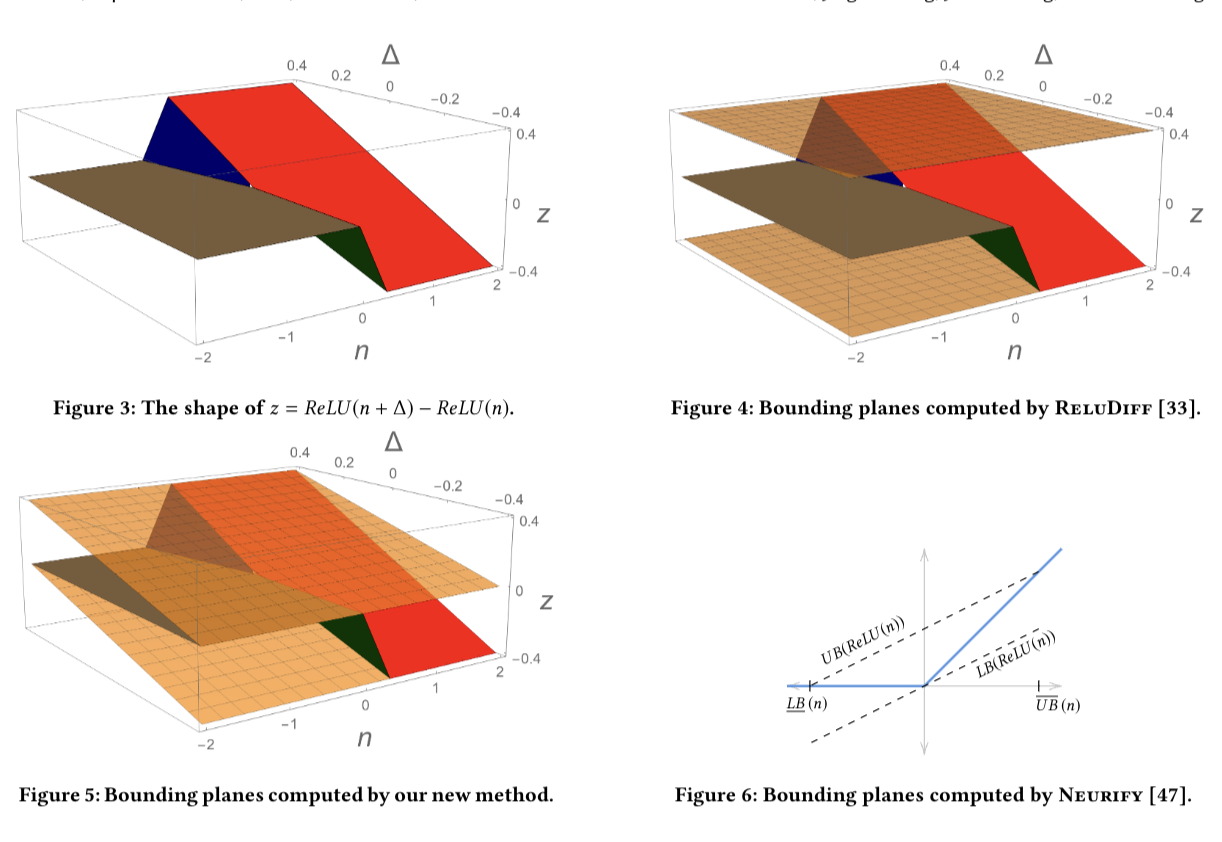

이 논문에서는 두 네트워크 간의 차이에 대한 하한과 상한을 계산하기 위해 간격 산술과 구체화를 사용하는 방법에 대해 언급하며, 순진한 접근 방식의 한계와 정확도를 향상시키기 위해 ReluDiff가 차이 경계를 계층별로 계산하는 방법에 대해서도 논의합니다.

이 논문은 regression testing, differential assertion checking, and incremental symbolic execution 기법에서 영감을 얻었습니다. 다양한 미분 검증 작업에 대한 실험적 평가를 수행하여 NeuroDiff의 효과를 입증합니다.

Lemma 4.1 and 4.2

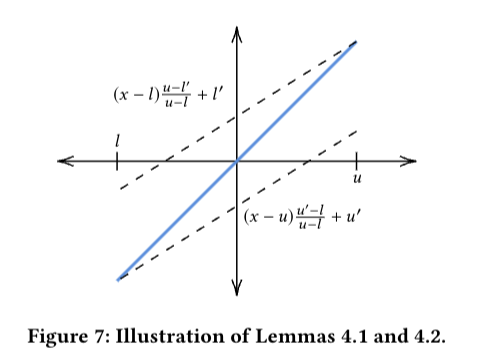

정리 4.1 은 하한 l과 상한 u를 갖는 변수 x에 대해, l ≤ l' ≤ 0인 상수 l' 이 존재한다면, x(x - l) ≤ u - l' ≤ u - l'은 다음과 같다고 기술합니다.

정리 4.2는 하한 l과 상한 u를 갖는 변수 x의 경우, 0 ≤ u' ≤ u'와 같은 상수 u'가 있다면, u' ≤ (x - u) ≤ u' - l이 된다는 것을 말해줍니다.

Lemma 4.3 and 4.4

정리 4.3은 ReLU 함수에 대한 경계로, ReLU(n) - n ≤ max(-n, 0)을 나타냅니다.

정리 4.4는 선형 함수에 대한 경계로, n' - ReLU(n' - ) ≤ min(n', 0)을 나타냅니다.

📕 Conclusion

NeuroDiff vs ReLuDiff

NeuroDiff: 기호적이고 세분화된 근사화 기법

ReluDiff: 정확도 향상을 위해 레이어별로 차이 간격을 계산

Contribution

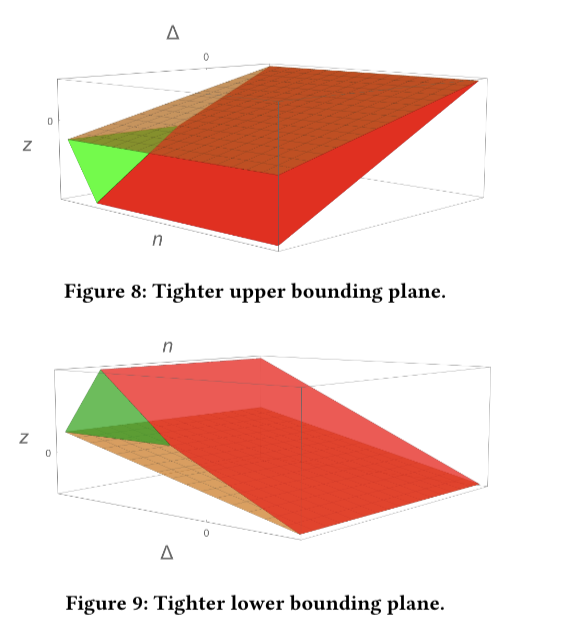

이 논문은 구조적으로 유사한 두 신경망의 해당 뉴런 간의 차이를 보다 정확하게 경계 짓는 새로운 볼록 근사치를 제안하여 차등 검증의 정확도를 향상시킵니다.

저자는 숨겨진 계층의 뉴런을 나타내는 기호 변수를 도입하여 근사치 오류의 전파를 완화하고 차등 검증의 정확도를 더욱 향상시킵니다.

이 논문에서 제안한 기술인 NeuroDiff는 최첨단 도구인 ReluDiff에 비해 속도와 정확도가 크게 향상되어 최대 1000배 빠르고 5배 더 정확합니다.

이 논문은 대규모 미분 검증 작업에 대한 실험 결과를 제시하여 속도와 정확도 측면에서 NeuroDiff의 효과를 입증합니다.

새로운 볼록 근사치와 NeuroDiff의 기호 변수 사용의 조합은 개별적인 기여보다 더 큰 이점을 제공합니다.