-

colab > 새 노트북

-

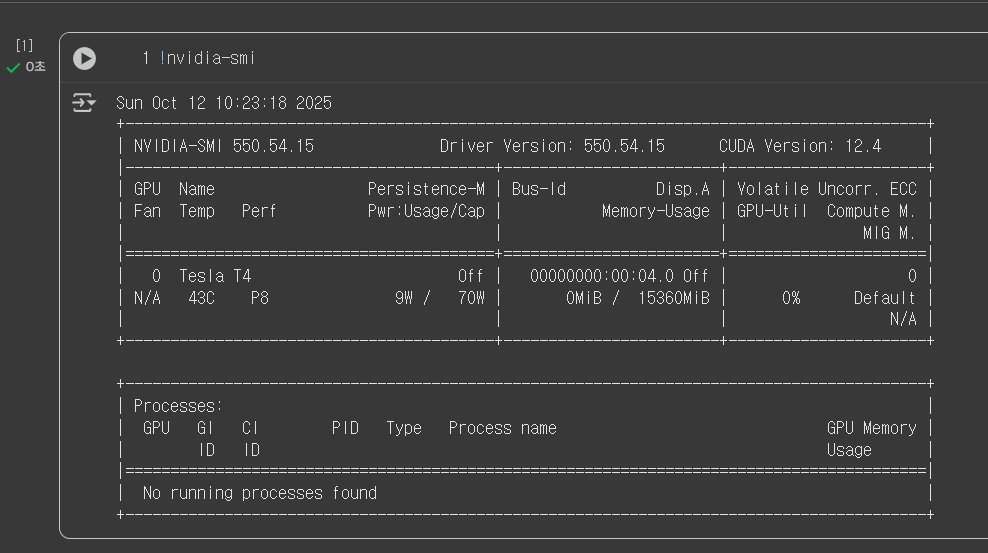

런타임유형변경 -> T4GPU

-

!nvidia-smi

엔비디아 시스템모니터링인터페이스 -

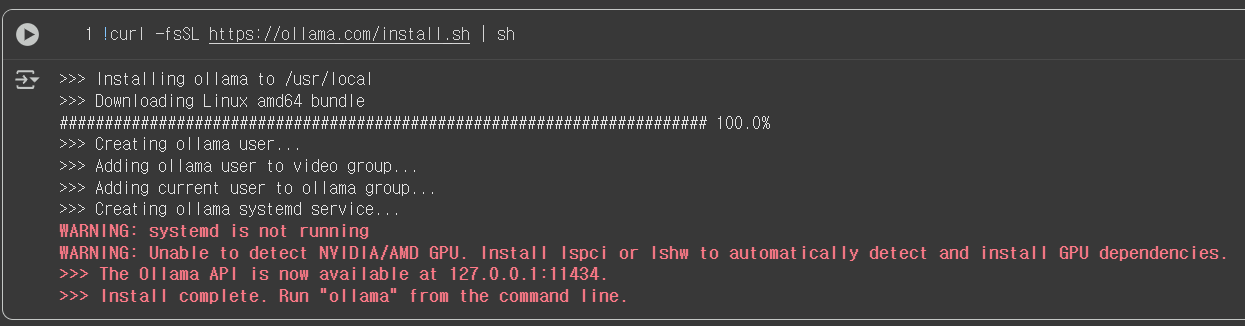

ollama install

!curl -fsSL https://ollama.com/install.sh | sh

-

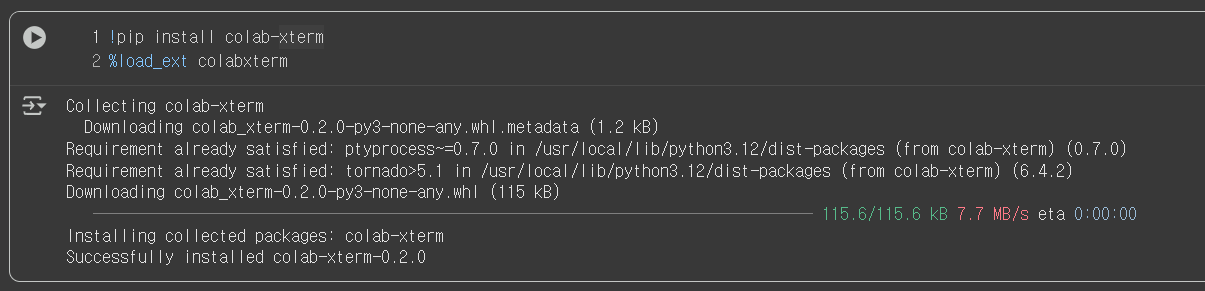

터미널 패키지 설치

!pip install colab-xterm

%load_ext colabxterm

-

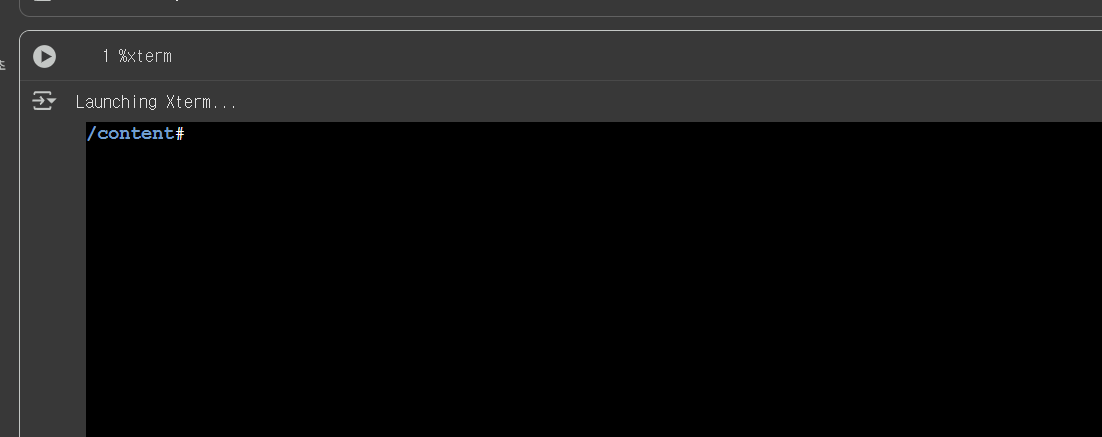

터미널 띄우기

%xterm

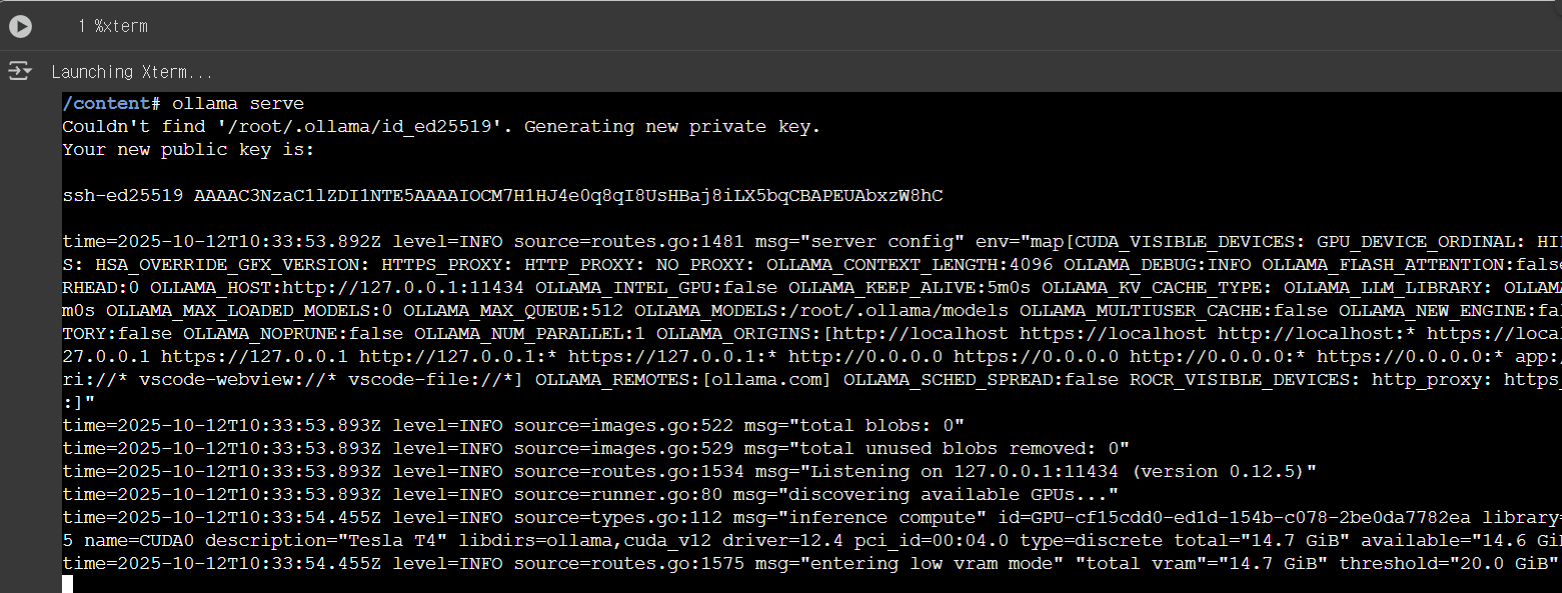

- 터미널 창에서 ollama serve 실행

ollama serve

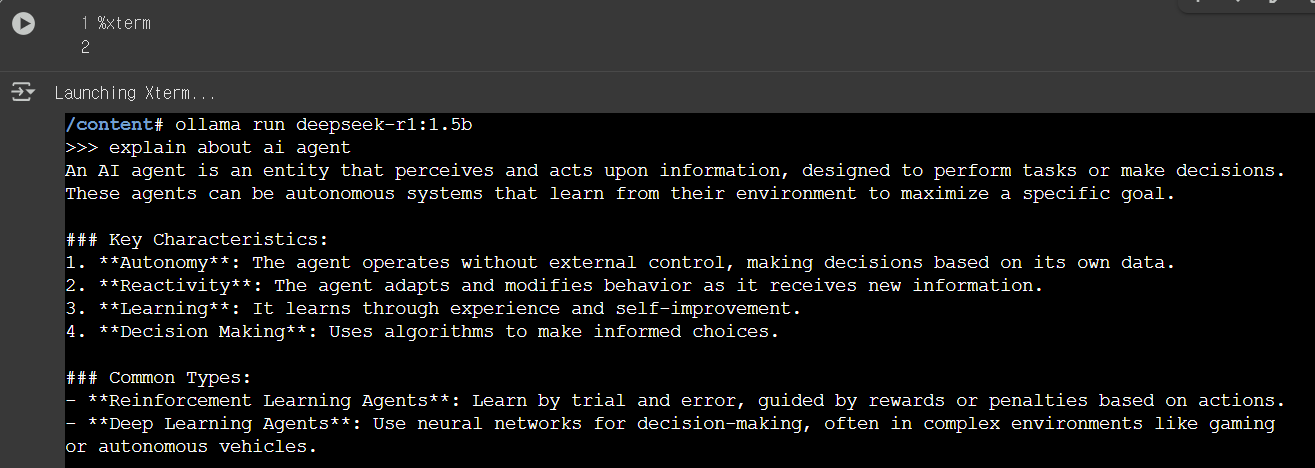

8.터미널 추가 띄워서 ollama run deepseek-r1:1.5b 받음

그냥 용량이 작아서...

ai agent 에 대해서 설명해 보라고 했다

-

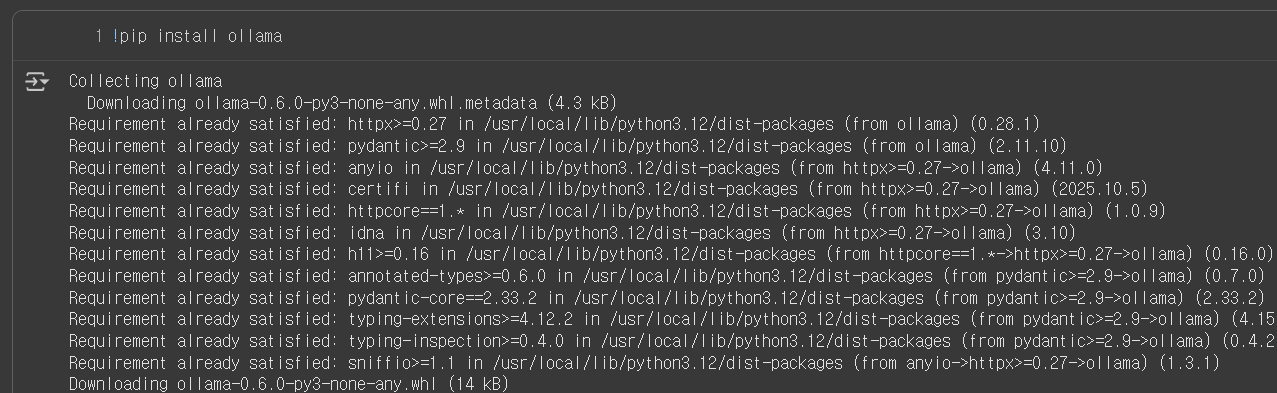

ollama 를 파이썬에서 쓰기 위한 라이브러리 설치

!pip install ollama

-

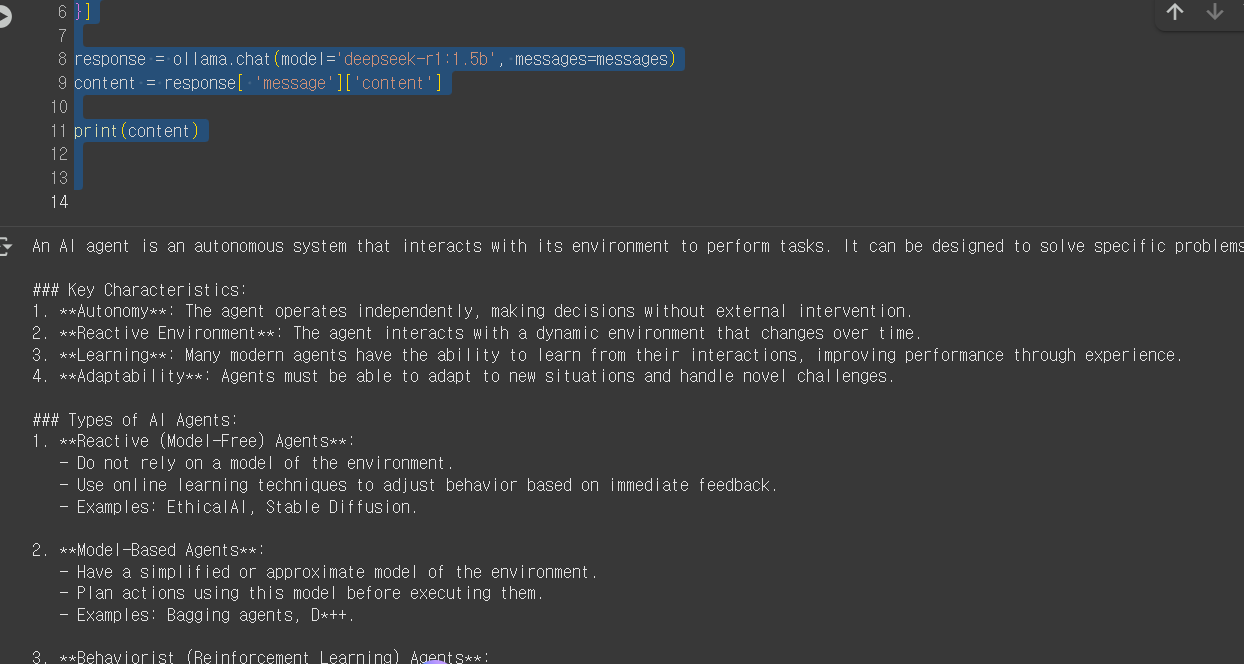

소스 작성 및 실행

import ollama

messages = [{

'role' : 'user',

'content' : 'explain about ai agent'

}]

response = ollama.chat(model='deepseek-r1:1.5b', messages=messages)

content = response[ 'message']['content']

print(content)