딥러닝 기초 3일차 정리

모델의 실전 근육키우기!! (일반화 & 정규화)

1.딥러닝의 영원한 숙제 : 과적합(Overfitting)

- 과적합 : 모델이 학습 데이터의 패턴뿐만 아니라 노이즈(불필요한 정보)까지 통째로 외워버린 상태.

- 현상 : 학습 데이터에 대한 Loss는 계속 떨어지는데, 검증(Validation) 데이터에 대한 Loss는 오히려 올라감.

- 목표 : 훈련 오차와 데이터 오차 사이의 간극을 줄여 '일반화(Generalization)'를 달성하는 것.

2.역전파(Backpropagation)와 옵티마이저 심화

어떻게 가중치를 효율적으로 업데이트할 것인가에 대한 고민임.

- 역전파 : 출력층의 오차를 입력층 방향으로 거슬러 올라가며 전파하는 과정임. 이때 Chain Rule(연쇄법칙)이 핵심적인 역할을 함.

- 옵티마이저(Optimizer)의 진화

- SGD : 가장 기본적인 경사하강법. 단순하지만 일반화 성능이 의외로 좋을 때가 있음.

- Momentum : 관성을 추가하여 경사면을 따라 더 빠르게 내려가게 돕는다.

- Adm : 현재 가낭 많이 쓰는 국룰 옵티마이저. 방향(Momentum)과 보폭(RMSProp)을 동시에 고려하여 똑똑하게 최적화함.

3.과적합을 막는 정규화(Regularizatin) 기법

모델이 특정 데이터에만 매몰되지 않도록 '제약'을 거는 방법들임.

- Weight Decay(L2 Regularization) : 가중치() 값이 너무 커지지 않게 패널티를 줌. 모델이 특정 피처에 과도하게 의존하는 것을 방지함.

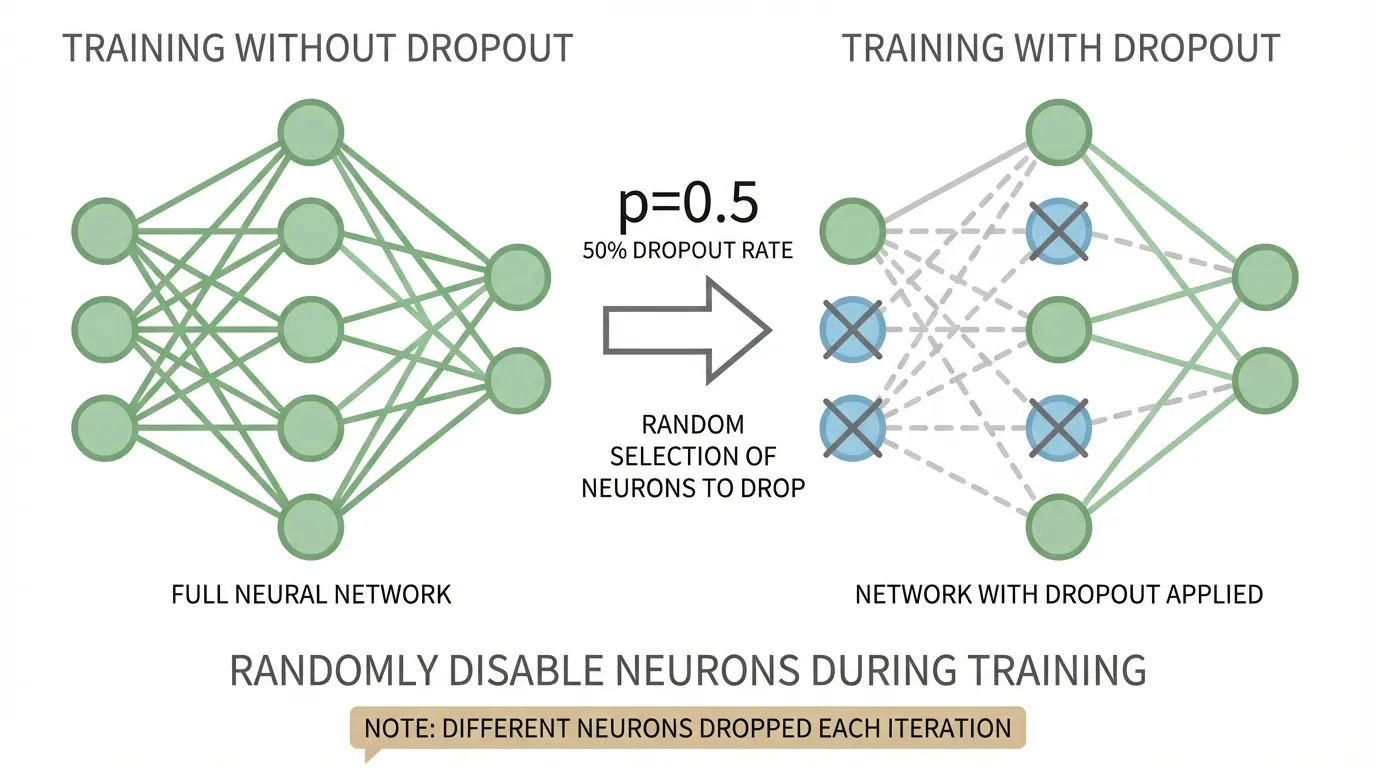

- Dropout(드롭아웃) : 학습 시 무작위로 일부 노드르 '꺼버림'.이를 통해 모델이 특정 경로에 의존하지 않고 더 강건하(Robust)특징을 배우게 함.

- Batch Normalization(배치 정규화) : 각 레이어를 통과할 때마다 데이터의 분포를 일정하게 맞춰줌. 학습 속도가 빨라지고 초기화에 덜 민감해지는 효과가 있음.

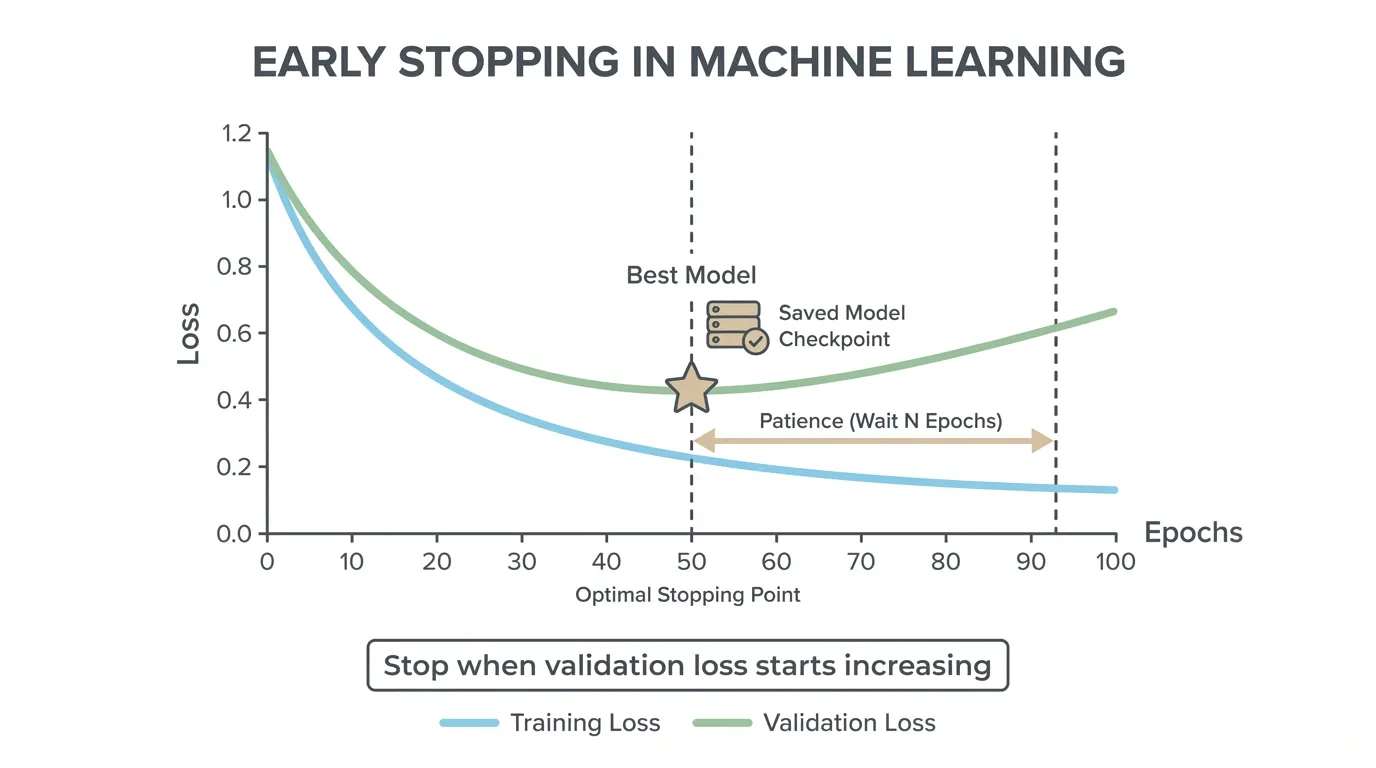

4.실무 필수 테크닉 : 조기 종료(Early Stopping)

수능 공부도 너무 오래 하면 오히려 역효과가 나듯, 딥러닝도 적절할 때 멈춰야 함.

- 원리 : 매 에폭(Epoch)마다 검증 데이터의 손실(Val Loss)을 체크함.

- 판단 기준 : Val Loss가 일정 횟수(patience) 이상 개선되지 않으면 학습을 강제로 중단하고, 가장 성능이 좋았던 시점의 모델을 저장함.

💡 요약

- 모델의 목표는 학습 데이터가 아닌 새로운 데이터를 잘 맞히는 것이다.

- Adam 옵티마이저와 Dropout은 실무에서 가장 먼저 고려되는 옵션이다.

- Early Stopping을 통해 과적합이 발생하기 직전의 가장 좋은 모델을 확보해야 한다.