이번주 딥러닝 기초에 대해서 배웠다.

내용들을 정리하면서 한번더 공부하기!

1. 머신러닝 vs 딥러닝

모든 문제에 딥러닝이 정답은 아님. 데이터와 문제의 복잡도에 따라 선택해야 한다.

- 머신러닝(ML) : 데이터가 숫자로 가볍게 표현되고 양이 적을 때 사용한다.(예 : 선형회귀, 결정트리, XGBoost 등)

- 딥러닝(DL) : 이미지, 자연어처럼 숫자로 바로 표현하기 어렵고 데이터 양이 방대할 때 필수적이다. 즉, 인공신경망을 활용해 복잡한 비선형 문제를 해결하는 과정이다.

2. 딥러닝의 핵심 단위 : 퍼셉트로(Perceptron)

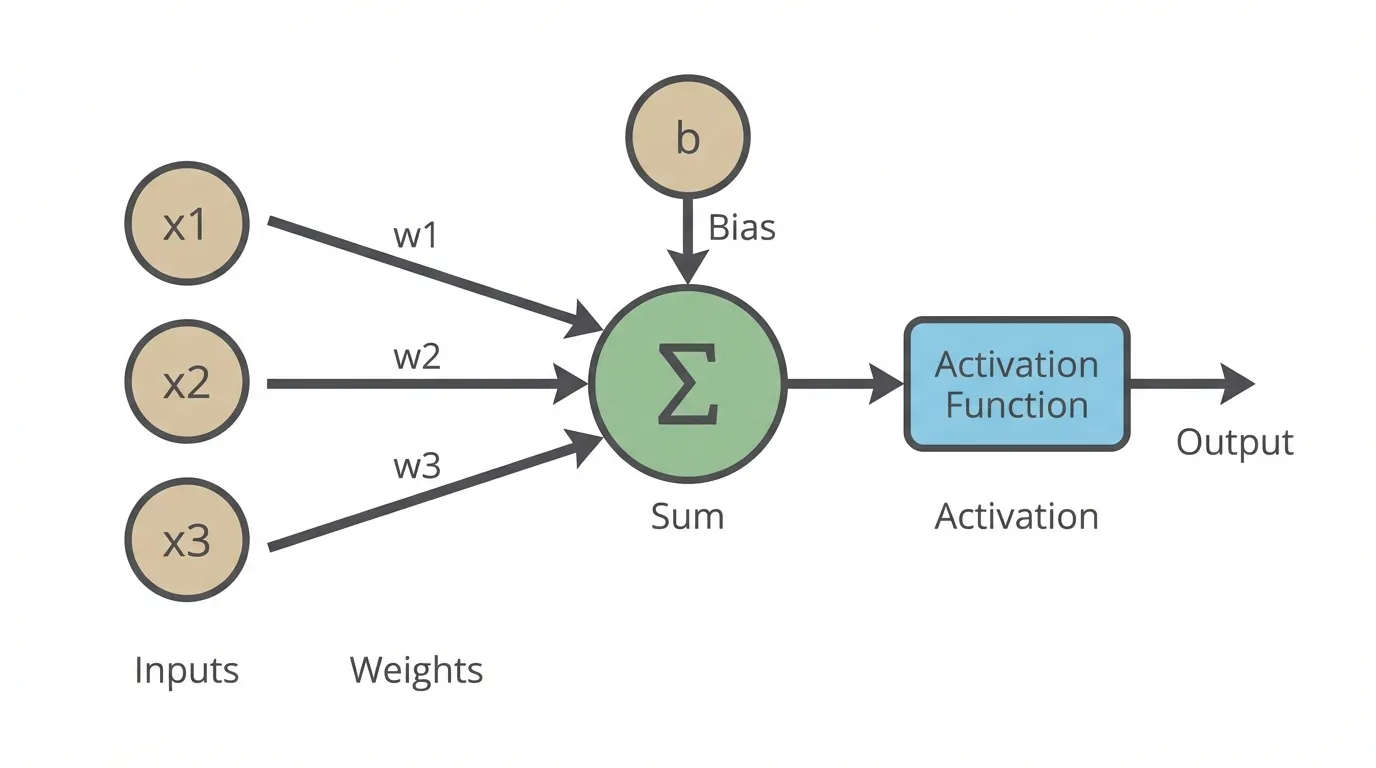

딥러닝은 아주 단순한 '퍼셉트론'을 수없이 많이 쌓아 올린 것이다.

-

구조 : 입력값()에 가중치()를 곱하고 편향()을 더한 뒤, 활성화 함수를 통과시킨다.

-

활성화 함수(Activation Function)

- 신경망에 비선형성을 부여하는 마법의 도구임. 이게 없다면 층을 아무리 쌓아도 단층 모델과 다를 바가 없음.

- sigmoid : 결과를 0~1사이로 수렴하게 만든다.

- ReLU : 음수 0, 양수는 그대로 통과시키는 가장 대중적인 함수임.

- Softmax : 마지막 출력층에서 여러 선택지 중 확률이 가장 높은 것을 고를 때 사용함.

3.학습의 매커니즘 : 순전파와 역전파

학습은 결국 손실함수를 0으로 만드는 과정임.

- 순전파(Forward Pass) : 데이터가 입려긍에서 출력층으로 흐르며 예측값을 내놓는 과정임.

- 손실 함수(Loss Function) : "내 예측이 얼마나 틀렸나?"를 수치화함.(회귀:MSE, 분류:CrossEntropy 등)

- 역전파(Backward Pass) : 미분(Gradient)을 통해 출력층에서 거꾸로 올라가며 가중치를 수정함.

- 경사하강법(Gradient Descent) : 손실 함수의 기울기를 따라 낮은 곳(정답)으로 한 발자국씩 이동하는 최정화 기법임.

4.실전 준비 : PyTorch Tensor 조작하기

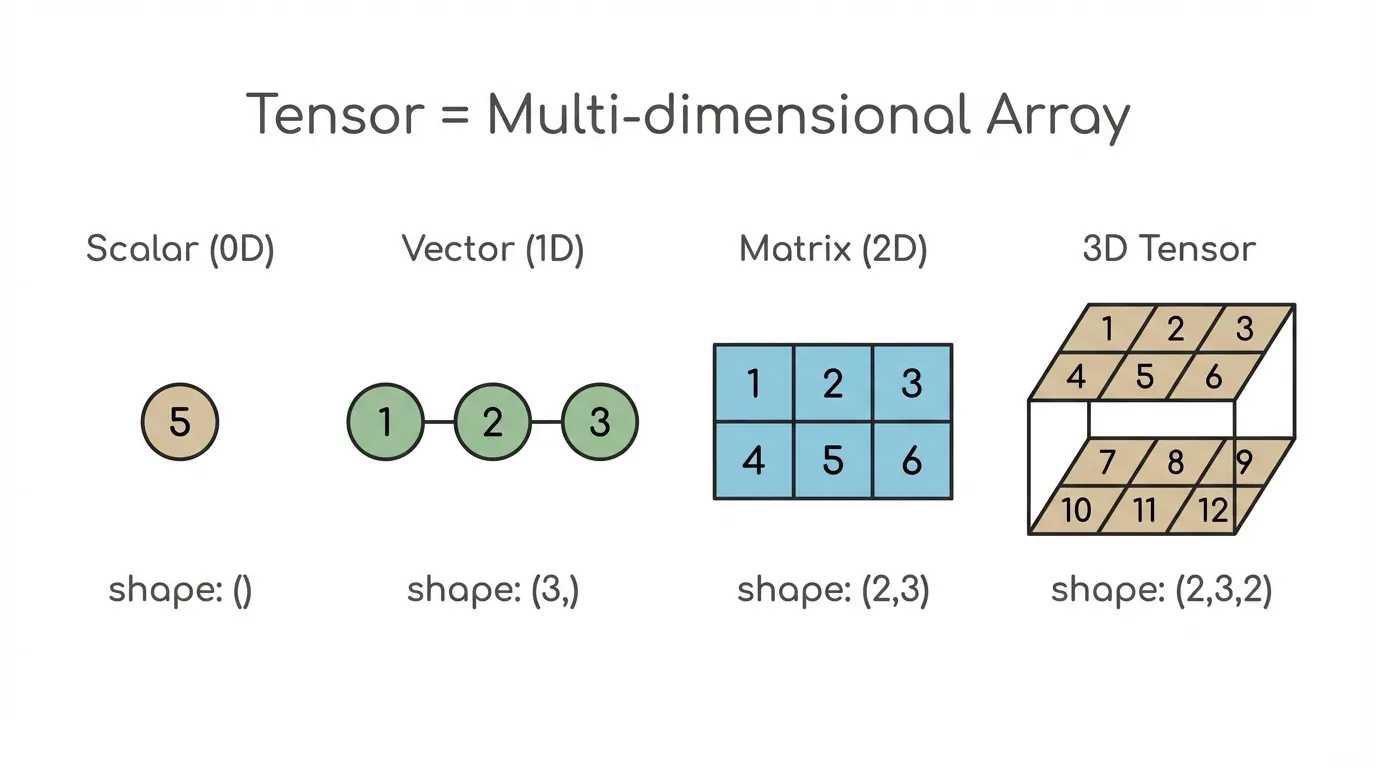

딥러닝의 모든 연산은 행렬곱이며, 이를 처리하는 단위가 바로 Tensor임.

-

Tensor : GPU 연산이 가능한 다차원 행렬임

-

필수 체크 사항

- shape : 데이터의 차원을 확인하는 습관!

- device : 현재 데이터가 CPU가 있는지 GPU(CUDA)에 있는지 확인해야 연산 에러가 안난다.

-

핵심 조작

- view / reshape : 데이터의 전체 개수는 유지하면서 모양만 바꾼다.(가장 많이 씀!)

- transpose / permute : 차원의 순서를 바꿀 때 사용함.