Bootstrap in machine learning

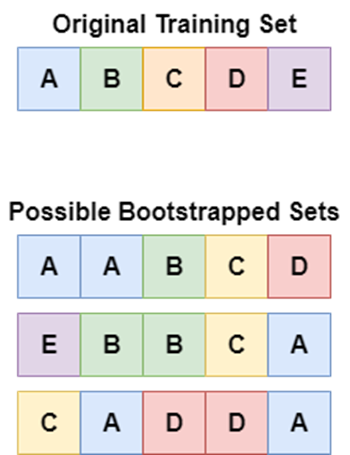

In statistics and machine learning, bootstrapping is a resampling technique that involves repeatedly drawing samples from our source data with replacement, often to estimate a population parameter. By “with replacement”, we mean that the same data point may be included in our resampled dataset multiple times.

- Bootstrap은 training set 내 data의 분포가 고르지 않은(즉, class가 불균형한) 경우 random sampling을 통해 training data의 양을 조절하는 방법으로 사용됨.

예, 개와 고양이를 분류하는 classifier 모델을 training할 때, training set에 개 사진 1,000장과 고양이 사진 10장이 있는 경우. 항상 '개'로 판단하는 classifier도 정확도가 99%. 이럴 때, 고양이 사진 data를 늘려주는 방법으로써 Bootstrap이 사용됨.

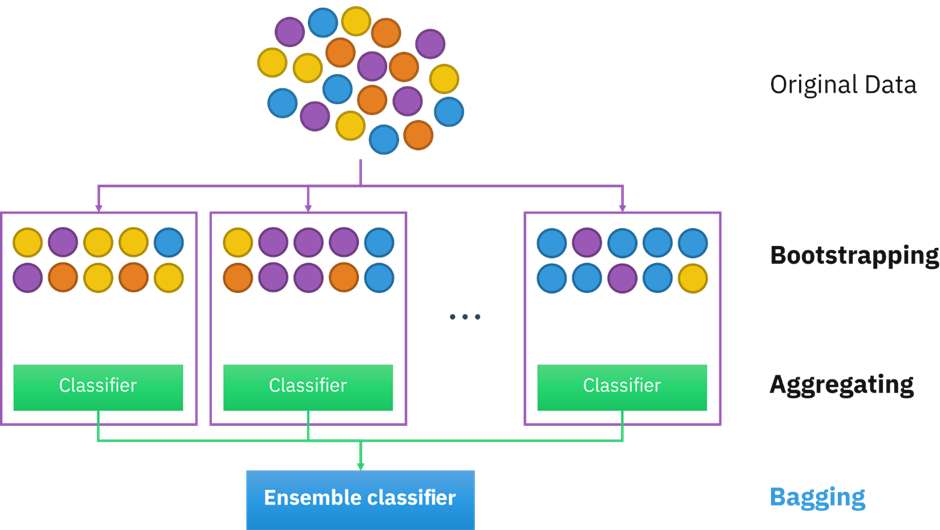

Bootstrapping은 over-fitting을 줄이기 위한 방법으로도 사용되는데 이를 Bagging(Bootstrap aggregating)이라고 함.

- Bagging is an ensemble learning technique that helps to improve the performance and accuracy of machine learning algorithms.

data가 충분히 많지 않아도 Bootstrapping을 활용하면, model ensemble 가능.

- training data를 random sampling을 한 뒤, 동일한 algorithms을 돌리면, 서로 다른 n개의 모델이 생성됨. 각각의 모델은 사용된 training data에 어느정도 over-fitting이 되겠지만, 모델 n개를 활용하여 이들의 평균을 활용하면 각각의 모델에 개별적으로 over-fitting된 결과를 상쇄할 수 있음.

Bootstrap 참고)

- https://www.mastersindatascience.org/learning/machine-learning-algorithms/bootstrapping/

- https://www.analyticsvidhya.com/blog/2020/02/what-is-bootstrap-sampling-in-statistics-and-machine-learning/

Bagging 참고)