0. Intro

udemy hadoop 강의에서는 Virtual Machine에 Linux 이미지를 올려 실습한다. 여기에 필요한 건 8GB 이상의 RAM 이라는 점이다... 하지만 내 노트북은 딱 8GB짜리라 돌아가진 않고, Mac의 경우엔 M1을 지원하지 않는다.

강의를 그냥 들어볼까 했지만, Spark나 Kafka 등 재밋는 실습 내용이 있어 GCP, vscode 실습 환경을 구축해보기로 하였다.

1. VM 인스턴스 생성

인스턴스는 free-tier가 아니기 때문에 비용이 발생한다.

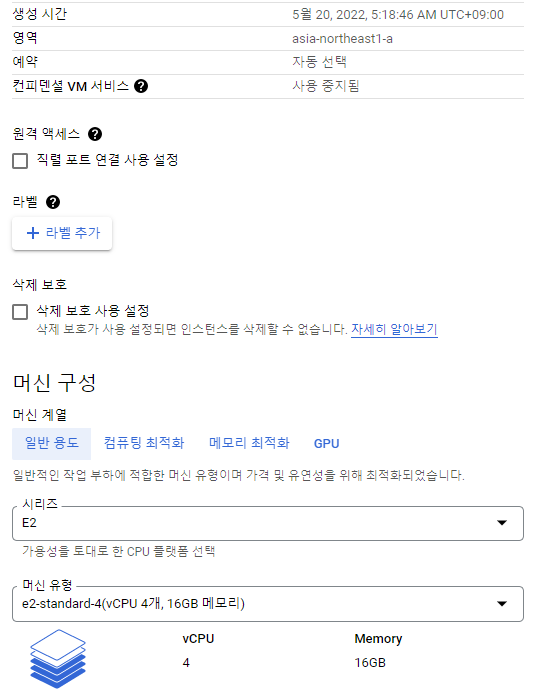

영역은 가격이 싼 서울로 선택했다. 머신도 물론 싼 E2 시리즈. 본 실습에는 8GB 그 이상의 메모리가 필요하므로 e2-standard-4 머신을 선택하였다.

방화벽을 설정해서 hadoop에서 쓰이는 port(Ambari와 HDFS의 경우 기본 8080, 2222번)만 열어주었다. 그리고 vscode에서 remote ssh IP 설정을 매번 바꾸지 않기 위해서 고정 IP 설정 해놓았다.

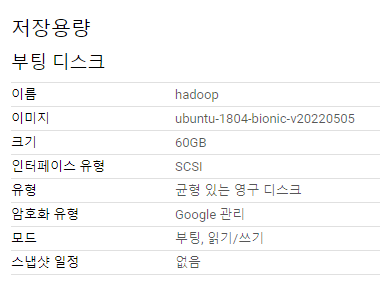

이미지 크기도 크고, 실습을 위해서는 디스크 크기가 40GB이상 필요하기 때문에 여분 공간을 더해서 부팅 디스크를 60GB로 늘려놓았다. OS의 경우, 가장 익숙한 ubuntu 18.04!

SSH 통해 연결 성공!

2. Docker 설치

도커 설치 부분은 Docker 공식 홈페이지를 참고하여 설치하였다.

3. Sandbox image 설치

- 이미지를 가져오기 위해 WGET 설치

sudo apt-get install wget - CLOUDERA에 접속하여 Docker HDP 2.6.5 링크 복사하기. wget 통해 이미지 zip 파일 가져오기.

wget https://archive.cloudera.com/hwx-sandbox/hdp/hdp-2.6.5/HDP_2.6.5_deploy-scripts_180624d542a25.zip - zip 파일을 풀기위한 zip 설치

sudo apt-get install zip - zip 파일 풀어 설치를 위한 sh 파일 얻기

unzip HDP_2.6.5_deploy-scripts_180624d542a25.zip -d HDP - sh 스크립트 명령어 동작 및 도커 이미지 설치

cd HDP sudo bash docker-deploy-hdp265.sh - docker sandbox 이미지 구동

sudo docker start sandbox-hdp sudo docker start sandbox-proxy

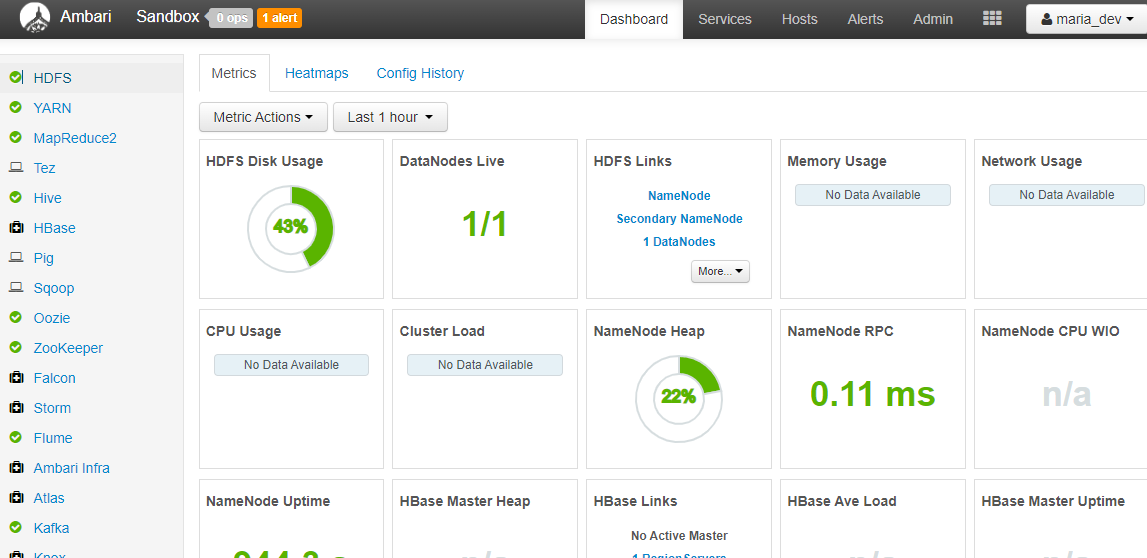

4. Ambari & HDFS 접속 Test

-

웹에서 [인스턴스 외부 ip주소]/8080 을 입력해서 Ambari maria_dev 계정으로 접속하면 다음과 같은 화면을 확인할 수 있다.

-

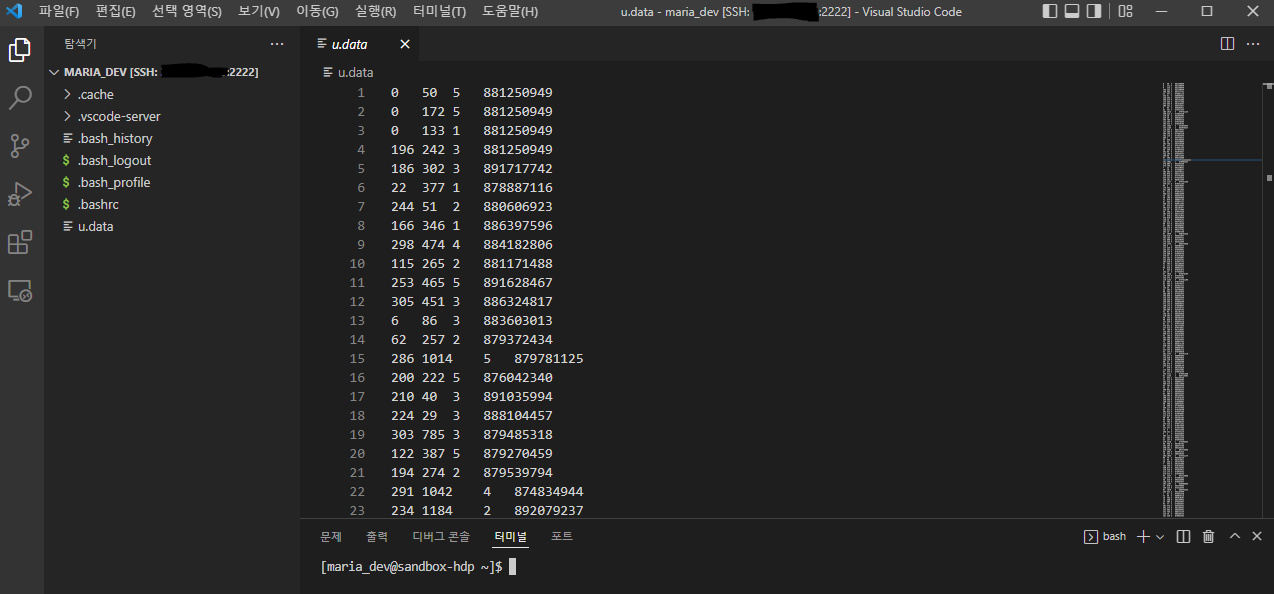

vscode ssh에서 maria_dev@[외부 ip주소]:2222 로그인을 통해 다음과 같이 HDFS에 접속할 수 있다.