- 이제 자동미분을 회귀직선에 사용해보자

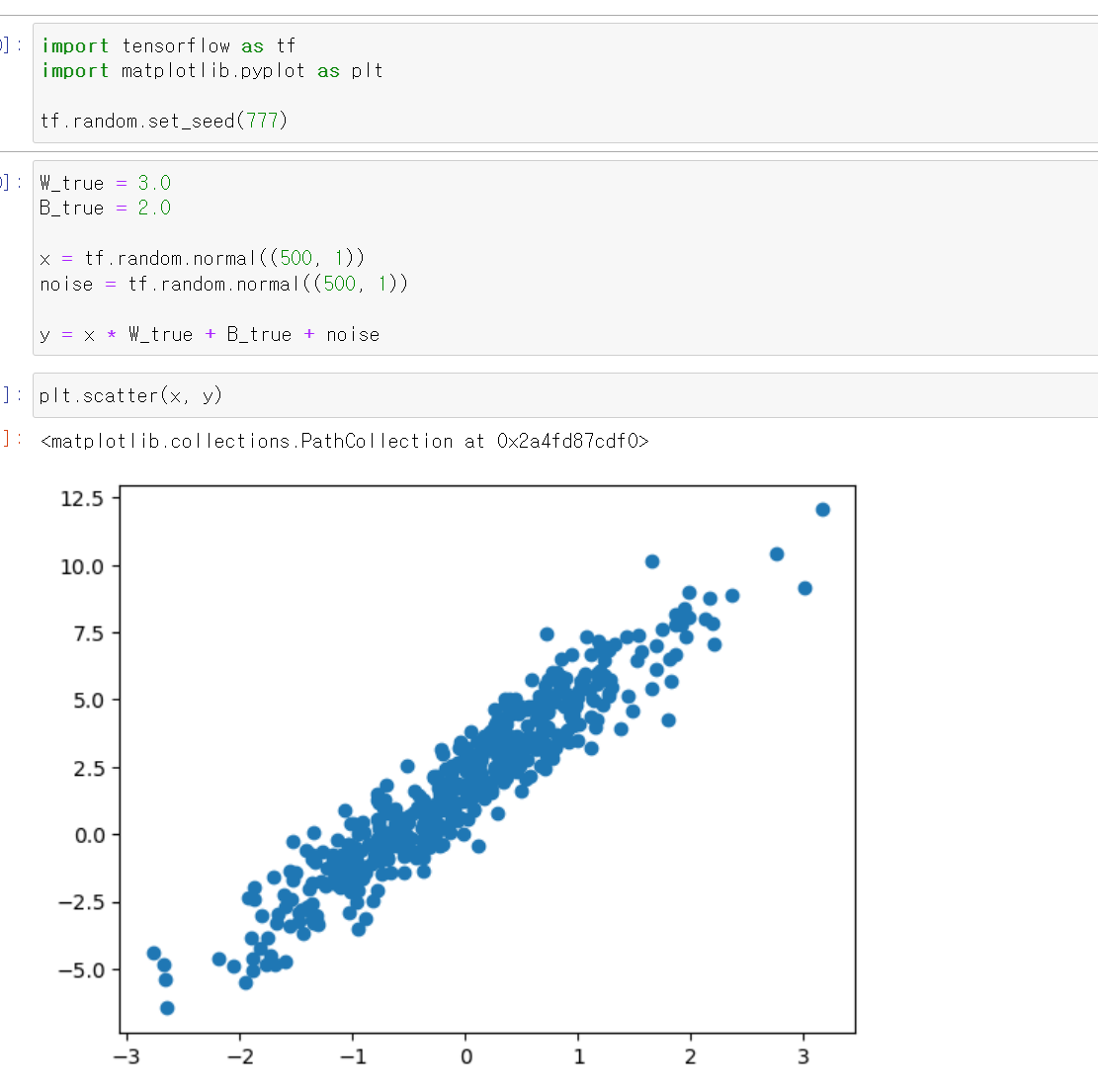

- 먼저 기울기 3, 절편 2 그리고 x는 랜덤이며, 분포를 형성하기 위해 noise를 추가해서 하나의 회귀직선을 scatter를 통해 표현했다.

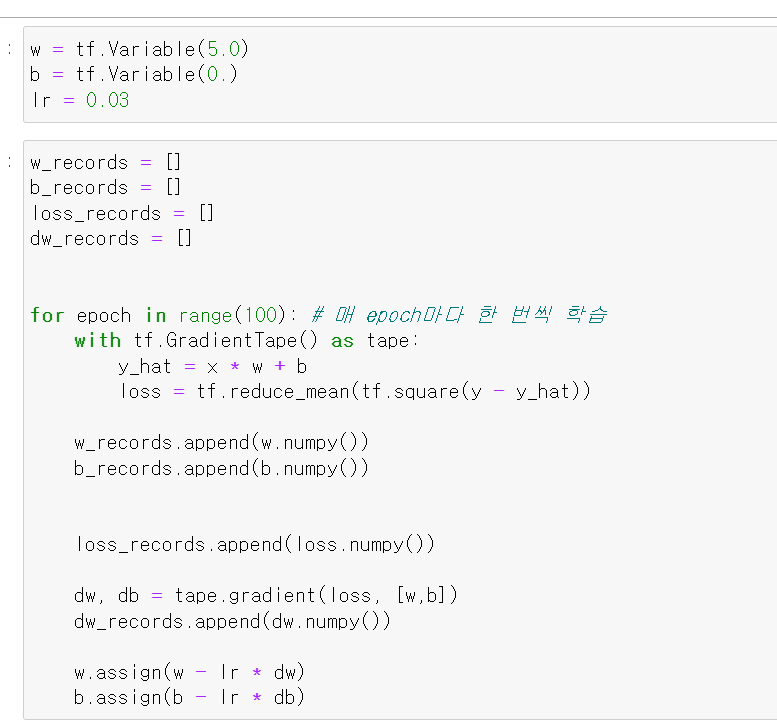

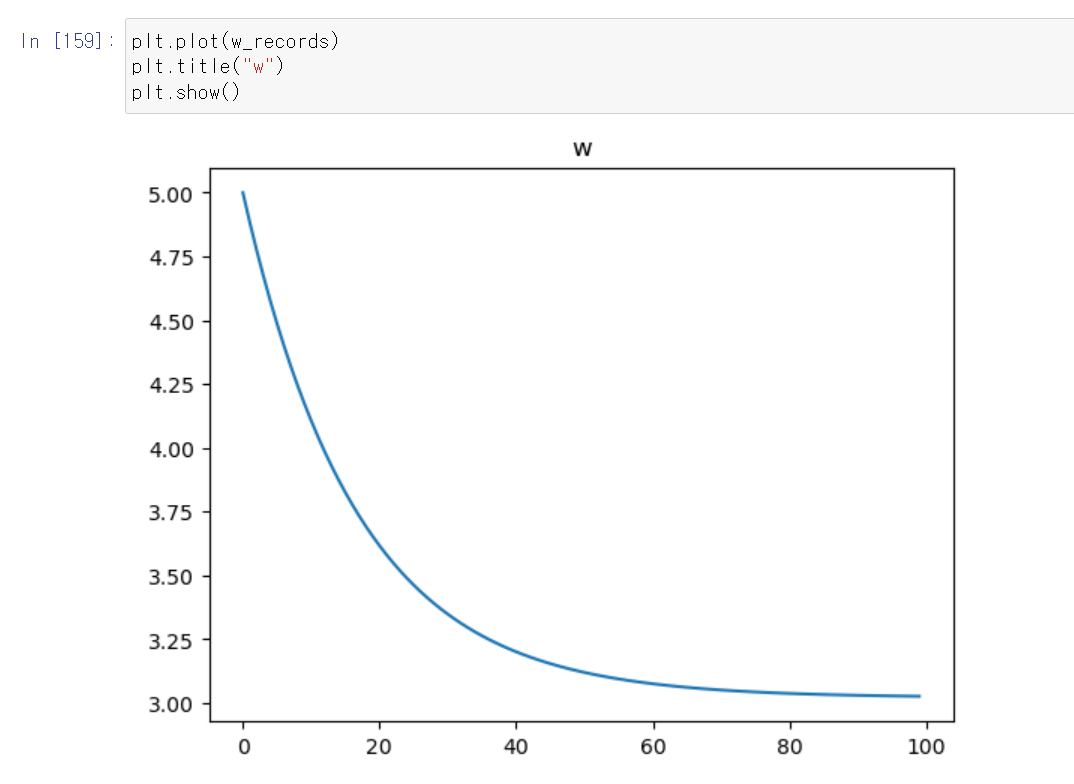

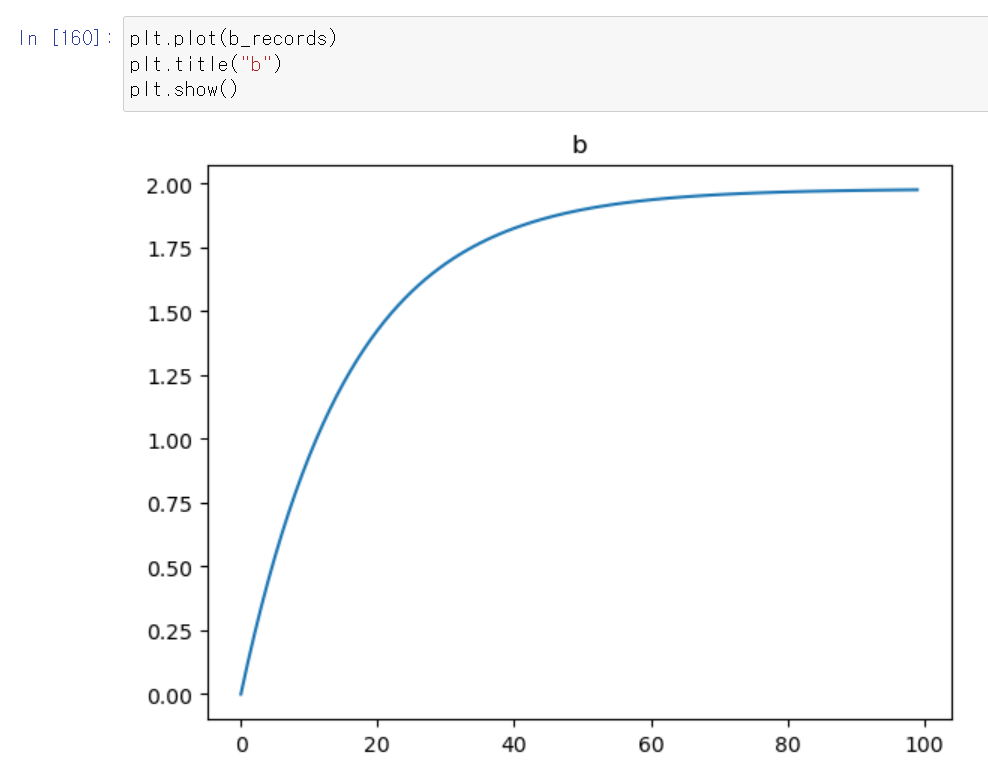

- 그리고 임의의 변수값 w는 5, b는 0으로 주고 학습 과정에서 기울기의 값에 따라 너무 한 번에 튀지 않게 learning rate값을 0.03으로 줬다.

- lr값의 경우 loss를 미분했을 때 기울기가 음수일 경우 기울기 절편에 더하고, 양수일 경우 빼서 극점을 구하는데 lr값을 주지 않으면 값이 너무 한 번에 튀기 때문에 학습이 제대로 안 될 수도 있다.

- 이제 loss값에서 편미분한 dw, db 두 기울기와 절편값을 lr값에 곱해서 실제 기울기와 절편에 뺴준다.

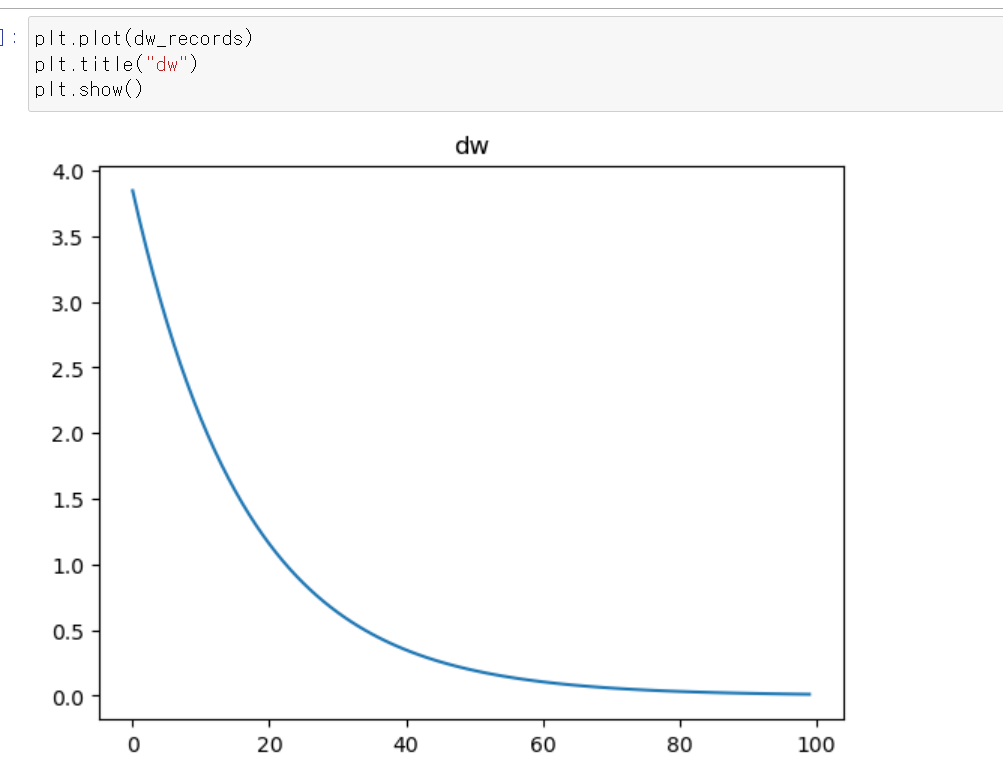

- 편미분 값은 극점에 가까워질수록 기울기가(원래 함수의 기울기x, loss값에 대한 편미분한 기울기)0에 가까워진다.

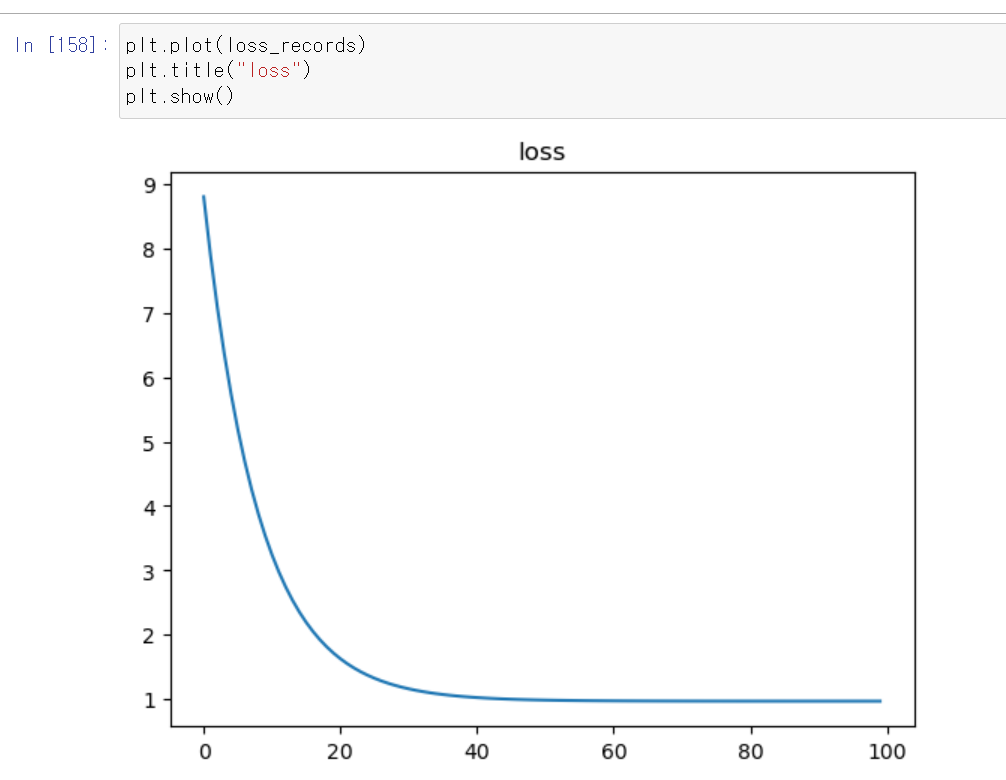

- loss값은 기울기와 절편을 조정할수록 점점 작아진다.

- 당연히 에러가 가장 적게 나타나는 loss값의 극점을 찾아가기 때문이다.

- w기울기는 원래 참변수값인 3에 가까워진다.

- b절편에 경우에도 임의로 넣은 0에서 점점 원래 값이 2에 가까워진다.