[CV] ResNet

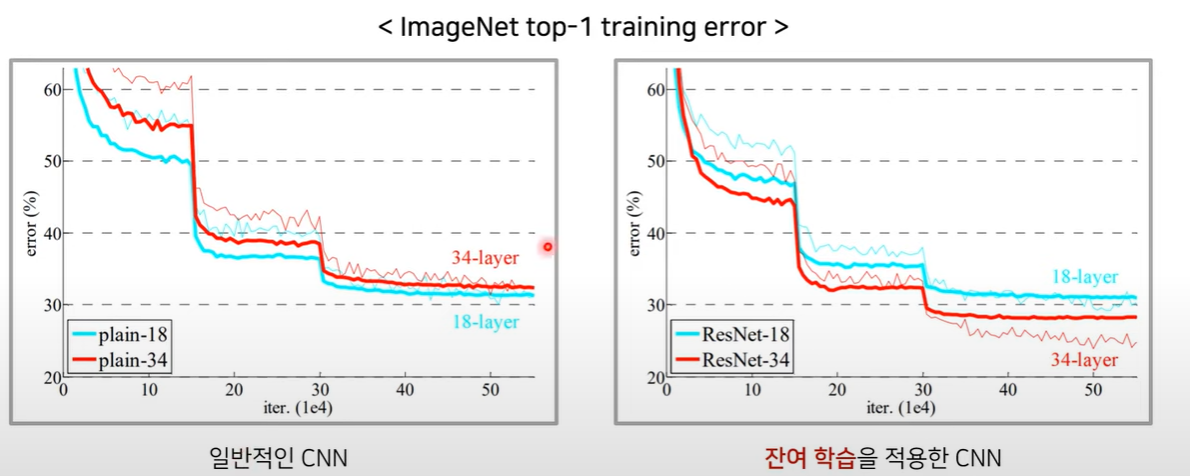

네트워크 깊게 만들기 위해 잔여학습 (residual learning)사용

네트워크가 깊어질수록 풍부한 feature 추출할 수 있음

일반 CNN에선 네트워크가 너무 깊어지면 오히려 성능이 줄어드는 문제를 해결

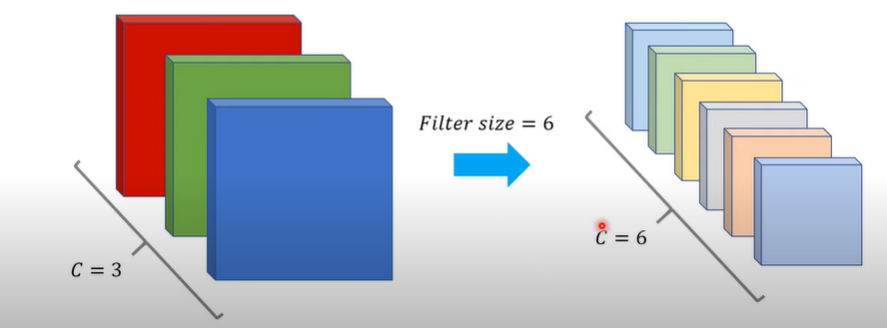

CNN 모델의 feature map

일반적으로 CNN에서 레이어가 깊어질수록 채널의 수가 많아지고 너비와 높이가 줄어든다.

컨볼루션 레이어의 서로 다른 필터들은 각각 적절한 feature 값을 추출하도록 학습된다.

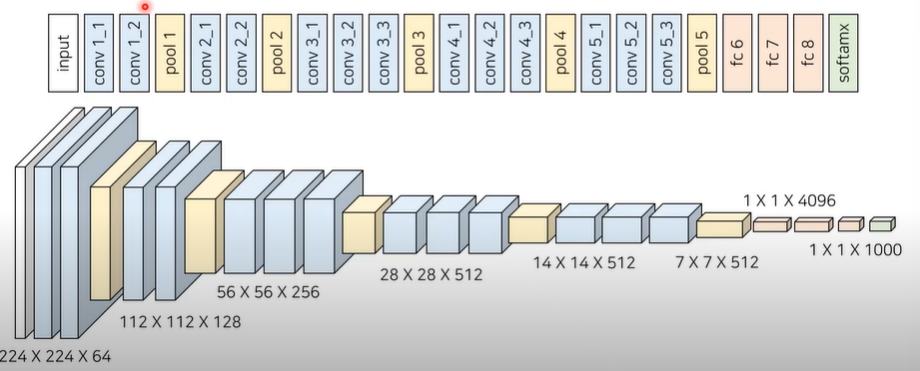

VGG 네트워크는 작은 크기의 3X3 convolution filter를 이용해 레이어의 깊이를 늘려 우수한 성능을 보인다. 하지만 파라미터 수가 너무 많다는 단점.

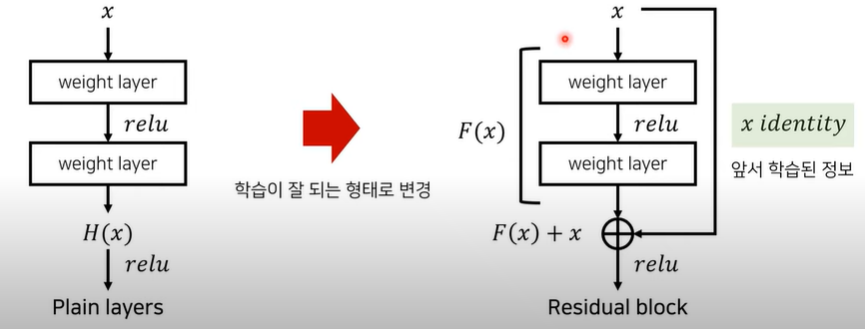

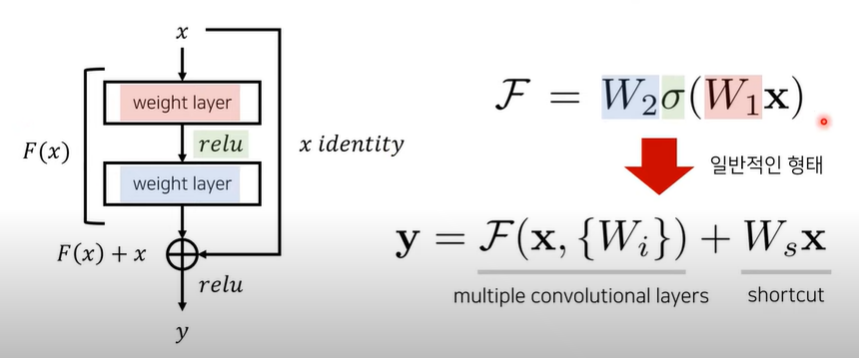

보통 input에 weight layer(conv) 적용해 특징을 추출

relu같은 activation function을 거쳐 non linear

이상적으로 동작하는 H를 학습하긴 어렵기 때문에 조금 더 학습이 잘되는 F(x)를 사용하자는 아이디어.

앞서 학습된 정보를 그대로 가져오고 잔여 정보인 F만 추가적으로 학습해서 더해준다.

전체를 학습하는 것보단 훨씬 쉬움.

이전까지의 아키텍처와 다르게 레이어가 깊어질수록 성능이 향상된다.