RNN / LSTM / GRU는순서를 순차적으로 처리한다는 명확한 장점을 가졌지만, 그만큼 명확한 한계도 있었다.

- 병렬화가 어렵다

- 시퀀스가 길어질수록 비효율적이다

이 문제를 해결하려는 방향에서

다음과 같은 시계열 모델들이 등장한다.

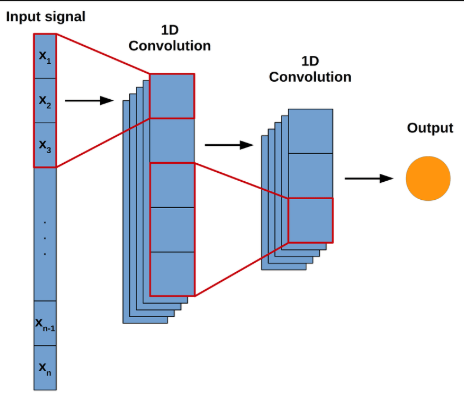

1. 1D CNN (Convolutional Neural Network for Time Series)

핵심 개념

시간 축 위에서 패턴을 “국소적으로” 훑는다

- 이미지의 가로·세로 대신

- 시간 축 하나만 놓고 컨볼루션

짧은 구간의 패턴을 반복적으로 감지한다.

시계열을 어떻게 보나?

- 시계열 = 1차원 신호

- 커널 = 짧은 시간 패턴 탐지기

예:

- 급격한 상승

- 특정 파형

- 반복되는 로컬 패턴

언제 쓰는가?

- 국소 패턴이 중요할 때

- 전체 순서보다는 형태(shape) 가 중요할 때

- 시계열 길이가 길고 빠른 학습이 필요할 때

예:

- 센서 신호

- 진동 데이터

- 음성 파형

- 설비 이상 감지

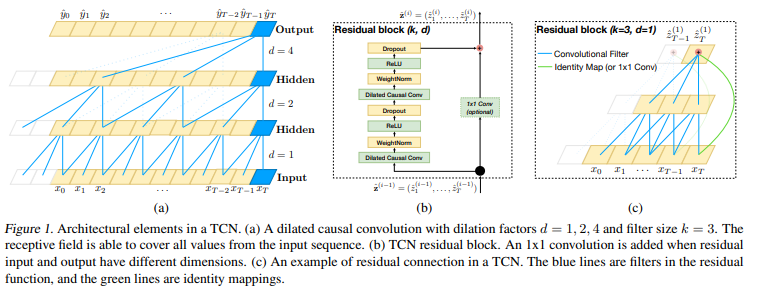

2. TCN (Temporal Convolutional Network)

TCN은 시계열 전용으로 설계된 CNN이라고 보면 된다.

핵심 개념

CNN으로 RNN의 역할을 대체하자

TCN은 다음 두 가지를 결합한다.

- Causal Convolution

→ 미래를 보지 않음 - Dilated Convolution

→ 적은 층으로 긴 과거를 커버

시계열을 어떻게 보나?

- 순서를 지키면서

- 점점 더 넓은 과거를 컨볼루션으로 본다

즉,

RNN처럼 과거를 누적하지만

순차 계산은 하지 않는다

언제 쓰는가?

- 중·장기 의존성이 필요한 시계열

- RNN의 순차 계산이 느릴 때

- 병렬 학습이 중요한 환경

예:

- 시계열 예측

- 로그 분석

- 제어 시스템

- 산업 데이터

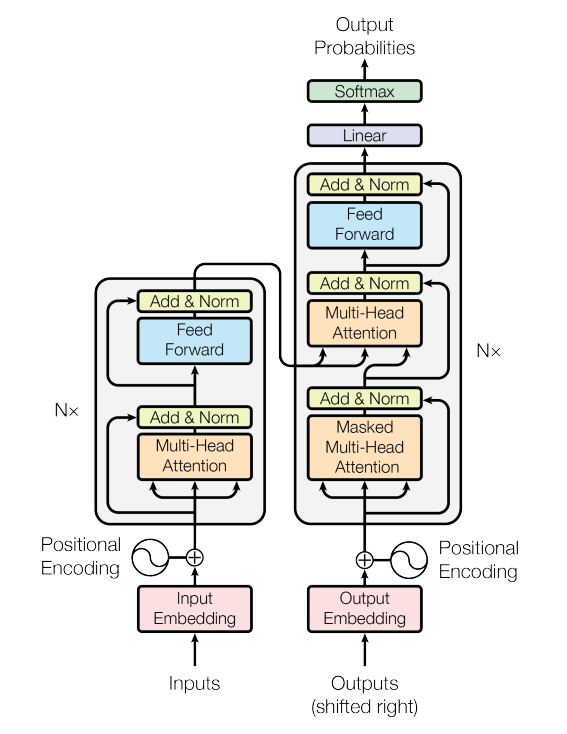

3. Transformer

Transformer는 시계열뿐 아니라 자연어 처리 전반의 패러다임을 바꾼 모델이다.

핵심 개념

모든 시점을 동시에 보고, 중요한 것만 선택한다

- 순차 처리 없음

- 모든 시점 간의 관계를 한 번에 계산

- 중요도는 Attention 으로 결정

시계열을 어떻게 보나?

- 시계열 = 토큰 시퀀스

- 각 시점은 서로를 직접 참조 가능

- 거리와 상관없이 관계를 학습

즉,

“얼마나 오래됐는지”보다

“얼마나 중요한지”가 더 중요하다

언제 쓰는가?

- 아주 긴 시계열

- 복잡한 전역 패턴

- 다변량 시계열

- 충분한 데이터와 연산 자원 존재

예:

- 장기 예측

- 멀티 센서 시계열

- 복잡한 상호작용이 있는 데이터